La relativité saisie sur le vif

Le rêve, révélateur de la conscience

L’attaque des vers marins

La relativité saisie sur le vif

Le rêve, révélateur de la conscience

L’attaque des vers marins

Inscrivez-vous à notre newsletter hebdomadaire

« C’est ce qui sert à combler les rides ? »

Voilà ce qu’entendent souvent Nadine Nassif et Marie Madeleine Giraud quand elles expliquent qu’elles conduisent des recherches sur le collagène. Ce n’est pas surprenant : cette macromolécule fait partie des substances phares de la cosmétique « anti-âge ».

Pourtant, l’efficacité du collagène dans ce domaine est loin d’être prouvée. Surtout, son véritable intérêt est tout autre. La structure torsadée de ce polymère, et la façon dont ses fibrilles s’agencent, qui s’apparente à celle de cristaux liquides, en fait un architecte des tissus vivants : on trouve le collagène dans la matrice des os, les tendons, les ligaments, la cornée, le derme… Les deux chercheuses ont appris à en comprendre finement les propriétés, et ont constitué une véritable librairie tissulaire de collagène, à même d’être employée dans la réparation de l’os, de la cornée, de la dentine ou du derme. Ces perspectives ouvertes à la médecine régénératrice sont l’aboutissement d’une exploration interdisciplinaire qui a débuté dès les années 1970. Il a fallu bien des années aussi à d’autres experts de la réparation pour trouver comment soigner non pas les corps mais les vaisseaux des nations coloniales du XVIIIe siècle. Alors que celles-ci

se disputaient les mers, la nature les freina un temps : des vers marins se mirent à dévorer le bois des coques en quantité. Les puissances maritimes expérimentèrent différentes parades, sans succès. La République des lettres y consacra d’étonnants efforts, rapporte l’historienne des sciences Armel Cornu. La solution, in fine ? Le cuivre, en placages minces, sauva les navires, les rendant au passage plus rapides. La science est capable de réparer les corps comme les objets, à condition d’être patient – le temps de la confrontation au réel est incompressible.

Aucune analyse automatisée ne peut se substituer à un test clinique, aucune simulation de résistance des matériaux ne peut totalement se substituer à des essais standardisés. On aimerait en cette ère de conflits exacerbés que cette fructueuse patience inspire ceux qui optent pour le temps expéditif de l’escalade armée à choisir plutôt celui, plus lent, mais ô combien plus constructif, de la réparation. n

Laurent Augusto, écologue (Inrae), Jean-Paul Ebran, physicien (CEA), Blaise Fleury, ingénieur (SOITEC), Vincent Gauci, écologue (université de Birmingham), Éric Gourgoulhon, physicien (LUX), Nicolas Laporte, astrophysicien (LAM), Claude Semay, physicien (université de Mons), Hélène Zéphir, neurologue (CHU de Lille)

06 La fonte des calottes et le paradoxe groenlandais

07 L’écorce : puits ou source de gaz à effet de serre ?

10 Maladie de Crohn : vers un nouveau diagnostic

11 Une exolune géante autour de HD 206893 B ?

13 L’origine des « nombres magiques » se précise

Cahier partenaire - pages I à III (après la p. 23)

Archéosismologie : des bâtiments historiques comme sismomètres

parrainé par

COSMOLOGIE

première génération d’étoiles en vue

José María Diego Rodríguez

Les astronomes espèrent bientôt repérer les étoiles primordiales, formées alors que l’Univers n’avait pas plus de 3 % de son âge actuel.

HISTOIRE DES SCIENCES

Armel Cornu

Ou comment la prolifération brutale en mer d’un mollusque, le taret commun, au XVIIIe siècle, a profondément marqué l’histoire de la marine.

60 La vie dans tous ses états Briques du vivant et projets sociaux Perig Pitrou

62 Les sciences à la loupe Les véritables assises de l’université Yves Gingras

64 Redresseur de code La douloureuse leçon de Richard Sutton Thomas Gerbaud

66 Retour sur image Voir le changement climatique : histoire et avenir d’une courbe Charlotte Bigg

68 Regards

« Je » est une interface François Lassagne

LETTRES D’INFORMATION

Toutes les semaines, l’essentiel de Pour la Science Soyez informé chaque mois des sorties de toutes nos publications

Profitez de nos offres promotionnelles

Et aussi : des newsletters thématisées

Inscrivez-vous ou scannez ce code : www.pourlascience.fr

Nadine Nassif et Marie Madeleine Giraud

L’étude des propriétés d’autoassemblage d’une protéine longtemps cantonnée aux promesses anti-âge ouvre de nouvelles voies à la médecine réparatrice.

44 54

SCIENCES COGNITIVES

« Le rêve défie nos intuitions sur la conscience »

Entretien avec Ludwig Crespin-Jouan

En recrutant des outils empruntés aux neurosciences, à la psychologie expérimentale et à la linguistique, les chercheurs étudient le rêve et en tirent des enseignements profonds sur la conscience.

PHYSIQUE

V. Helm, T. Juffmann et P. Schattschneider

Des physiciens sont parvenus à observer pour la première fois l’effet Terrell-Penrose, un phénomène étrange prédit par la relativité restreinte.

70 Logique & calcul Inépuisables polyominos Jean-Paul Delahaye

Simples en apparence, ces formes constituées de carrés accolés ont engendré un foisonnement de jeux, mais aussi d’intéressants problèmes mathématiques.

76 Art & Science

L’art extraterrestre Loïc Mangin

78 Livres

80 Chroniques de l’évolution Sinsk, l’extinction sous-estimée du Cambrien Hervé Le Guyader

86 Idées de physique Un collé serré bien poli Jean-Michel Courty et Édouard Kierlik

88 Science & gastronomie Glycérine et propylène glycol : des cousins comestibles Hervé This

90 L’équation Naît-il plus d’enfants à la pleine lune ? Florian Freistetter

En couverture : © Marie Madeleine Giraud

Ce numéro comporte un courrier de réabonnement posé sur le magazine, diffusé à une sélection d’abonnés et un encart « First Voyage » posé sur le magazine, diffusé à l’ensemble des abonnés.

La fonte de la calotte groenlandaise contribue à la montée globale des océans. Mais localement, elle produit l’effet inverse : le soulèvement de l’île et la modification de la gravité pourraient faire reculer la mer de plusieurs mètres d’ici à 2100.

Lorsque la calotte groenlandaise fond, le niveau des océans monte. C’est l’une des conséquences les mieux établies du réchauffement climatique. Pourtant, près des côtes du Groenland, le phénomène pourrait produire l’effet inverse : la mer devrait reculer d’ici à la fin du siècle. En effet, cette hausse globale masque de fortes disparités régionales : le niveau de la mer n’évolue pas partout de la même

manière. Et, de façon contre-intuitive, autour du Groenland, il pourrait même baisser ! Des mesures géodésiques par satellite indiquent en outre que ce mouvement serait plus rapide que ce que prévoyaient certains modèles. Pour mieux comprendre cette dynamique, Lauren Lewright, de l’université Columbia, aux États-Unis, et ses collègues ont modélisé la réponse méca nique de la Terre dans sa globalité, dont la lithosphère (les « plaques »

La perte de la glace sur le Groenland conduit à l’élévation de l’île.

de la Terre) et le manteau, et ont focalisé leur attention sur le Groenland. « Les processus sont connus, la nouveauté de l’étude est de les quantifier conjointement, du mieux qu’on puisse faire, en sollicitant une énorme puissance de calcul dont on n’ose pas imaginer l’empreinte carbone », souligne Laurent Husson, de l’Institut des sciences de la Terre, à Grenoble. Avec une superficie d’environ 2,2 millions de kilomètres carrés (soit quatre fois la France métropolitaine), le Groenland est recouvert par une calotte glaciaire de plusieurs kilomètres d’épaisseur. Cette masse de glace exerce une pression considérable sur la lithosphère. Lorsque la calotte perd de la masse – environ 262 gigatonnes par an actuellement –, la charge diminue et le sol se soulève progressivement : c’est le phénomène d’ajustement isostatique glaciaire, déjà pris en compte dans le sixième rapport du Giec (Groupe d’experts intergouvernemental sur l’évolution du climat). Le niveau marin relatif (c’est-à-dire la hauteur de la mer par rapport au sol) autour du Groenland baisse alors, même si le niveau global des océans continue d’augmenter. La modélisation de la réponse du sous-sol groenlandais dépend fortement de ses propriétés mécaniques, en particulier de la viscosité du manteau terrestre, encore mal connue dans cette région. Pour contraindre

ces paramètres, les chercheurs ont comparé leurs modèles à l’évolution du niveau marin au cours des derniers millénaires. Ils ont notamment pris en compte la déglaciation du début de l’Holocène, il y a environ 10 000 ans, ainsi que la croissance de la calotte pendant le Petit Âge glaciaire, entre le XIVe et le XIX e siècle. Ces analyses suggèrent que le manteau sous le Groenland serait moins visqueux que prévu lors de déformations rapides. Cela implique une réponse amplifiée du soulèvement actuel.

À l’horizon 2100… À partir de ces contraintes, les chercheurs ont estimé l’évolution future du niveau marin relatif autour du Groenland. Selon leurs projections, celui-ci pourrait diminuer d’environ 0,9 mètre d’ici à 2100 dans un scénario de faibles émissions de dioxyde de carbone, et d’environ 2,5 mètres dans un scénario de fortes émissions, chaque estimation étant associée à des marges d’incertitude importantes.

La baisse du niveau marin modifiera les environnements côtiers. Certains écosystèmes marins pourraient émerger progressivement, ce qui les mettrait en péril. Les conséquences seront aussi d’ordre économique : les populations vivent majoritairement sur le littoral et dépendent fortement des infrastructures portuaires pour la pêche et le commerce. Une baisse du niveau marin de l’ordre du mètre ou davantage rendrait certains ports plus difficiles d’accès, même si l’adaptation sera tout de même plus facile que dans les régions où le niveau montera ! n

Sean Bailly

L. Lewright et al., Nature Communications, 2026.

L’écorce : puits ou source de gaz à effet de serre ?

L’écorce des arbres, comme cet eucalyptus, contient tout un microbiote qui participe aux échanges gazeux entre la plante et l’atmosphère.

Une nouvelle histoire s’écrit depuis peu, qui met une fois de plus les arbres sur le devant de la scène. On connaît leur importance dans la séquestration du carbone via leurs feuilles et le processus de photosynthèse, et plus récemment via les interactions de leurs racines dans le sol. Or, ces dernières années, différentes équipes ont constaté que, selon les conditions d’humidité du sol, les troncs pouvaient absorber ou émettre du méthane. Par ailleurs, les bactéries vivant dans l’écorce utilisent le méthane pour produire leur énergie. Pok Man Leung, de l’université Monash, en Australie, et ses collègues ont précisé davantage ces échanges gazeux à travers l’écorce, en s’intéressant au méthane, mais aussi au dihydrogène et au monoxyde de carbone, deux gaz qui ont des effets indirects sur le bilan énergétique global de la Terre. Les chercheurs ont étudié huit espèces d’arbres communs de l’est de l’Australie, dans trois écosystèmes différents. Dans les forêts aux sols bien drainés, Pok Man Leung et ses collègues confirment que ces gaz sont consommés par les bactéries des

écorces. Selon eux, dans ces milieux, les arbres agissent probablement comme un puits de monoxyde de carbone, comme pour le méthane. Il en va autrement dans les marécages et les plaines inondables où le sol, saturé d’eau, produit ces gaz, qui pénètrent dans les arbres par leurs racines et finissent par être émis au niveau de l’écorce du bas des troncs. Et même si les bactéries de l’écorce atténuent ces émissions, ces forêts humides restent une source nette. Le dihydrogène est le seul gaz pour lequel toutes les espèces étudiées sont un puits net. Il est encore difficile de faire un bilan global à l’échelle de la planète de l’importance de ces processus, tant les écosystèmes sont variés. Mais ces résultats affinent déjà la contribution des forêts dans les cycles atmosphériques mondiaux et in fine la régulation du climat. n

Isabelle Bellin Pok Man Leung et al., Science, 2026.

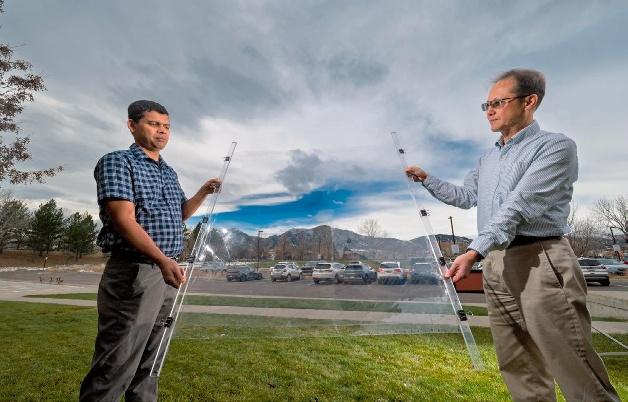

En contrôlant la taille de pores nanométriques dans un réseau de nanotubes de silicone, des chercheurs montrent qu’il est possible de concilier isolation thermique et transparence optique – deux propriétés longtemps jugées incompatibles.

Alors qu’elles ne représentent que 8 % en moyenne de la superficie d’un bâtiment (et jusqu’à 30 % sur les constructions modernes), les fenêtres sont responsables d’une grande part des pertes de chaleur. À une époque où l’on cherche à mieux isoler les constructions, elles représentent donc un point faible. Le double vitrage, avec une lame d’air entre deux couches de verre, a de meilleures performances que le vitrage simple, mais est-il possible de faire mieux ? Les aérogels sont des matériaux poreux, remplis d’air, et sont de bons isolants thermiques. Ils ont cependant l’inconvénient de disperser la lumière : ils sont bien translucides, mais pas transparents.

Le problème vient du fait que le diamètre des pores n’est pas contrôlé dans ces matériaux.

L’équipe d’Ivan Smalyukh, de l’université du Colorado, à Boulder, aux États-Unis, a mis au point une solution en contrôlant les dimensions caractéristiques d’un matériau de synthèse constitué d’un maillage de nanotubes de silicone. Les chercheurs ont alors mesuré les propriétés de leur matériau, surnommé Mochi (acronyme anglais pour « isolant thermique mésoporeux optiquement transparent »). Résultats : la conductivité thermique est de 10 milliwatts par mètre et par kelvin. C’est près de deux fois moins que l’air à 25 °C et cent fois moins que le verre. Le système à double vitrage

Les deux chercheurs tiennent une couche de Mochi étalée sur un film plastique transparent.

dans lequel le Mochi remplace la couche d’air a une résistance thermique équivalente à celle d’un mur isolé, mais avec une épaisseur bien moindre. Par ailleurs, la transparence est supérieure à 99 %.

Les chercheurs se sont aussi interrogés sur la longévité de leur matériau. Ils ont réalisé des tests de vieillissement accéléré (cycles d’humidité et de chaleur) et évalué la durée de vie du Mochi à vingt ans. Cette durabilité pourrait même être augmentée en insérant le matériau entre deux couches de verre.

Le défi de l’industrialisation

Pour finir, l’équipe a aussi évalué le coût économique de ce matériau. Elle estime que la fabrication d’un mètre carré coûterait environ 42 euros (50 dollars américains). Des prix comparables à ceux des aérogels ou du double vitrage. Un investissement qui serait rapidement compensé par les économies réalisées sur le chauffage. Si l’équipe d’Ivan Smalyukh parvient à déployer la production du Mochi à très grande échelle, peut-être que ce matériau équipera les maisons de demain et sera à la base de la rénovation des habitations actuelles. n

S. B.

A. Bhardwaj et al., Science, 2025.

Le Yangzi se porte mieux

Depuis les années 1950, les conditions environnementales du plus grand fleuve chinois, le Yangzi Jiang, ne faisaient que se dégrader avec des populations et une diversité de poissons en forte baisse. Les autorités ont pris des mesures drastiques en 2021, avec notamment une interdiction stricte de la pêche. Sébastien Brosse, du CRBE, et ses collègues chinois viennent de montrer sur des données enregistrées entre 2018 et 2023 que la diversité est de nouveau à la hausse avec le retour d’espèces menacées. Science, 12 février 2026.

Record quantique

En mécanique quantique, il n’y a pas de limite de taille sur les systèmes dans une superposition d’états. Cependant, en pratique, comme la moindre perturbation externe fait s’effondrer cette configuration, plus un système est grand plus il est difficile de le maintenir dans une superposition d’états. L’équipe de Markus Arndt, de l’université de Vienne, vient de battre un record en mettant un ensemble de 7 000 atomes de sodium dans une superposition de positions séparées de 133 nanomètres.

Nature, 21 janvier 2026.

L’information cachée du croassement

Lorsque le mâle grenouille pousse la sérénade, il espère attirer une femelle pour s’accoupler. Mais la femelle percevrait bien plus d’information dans ce chant que les seules qualités du partenaire. Julianne Pekny, de l’université de Californie à Davis, et ses collègues ont constaté que la vitesse du chant dépend de la température de l’eau : elle est d’autant plus rapide que l’eau est chaude, signalant ainsi que les conditions sont idéales pour la ponte. Front. Ecol. Environ., 12 février 2026.

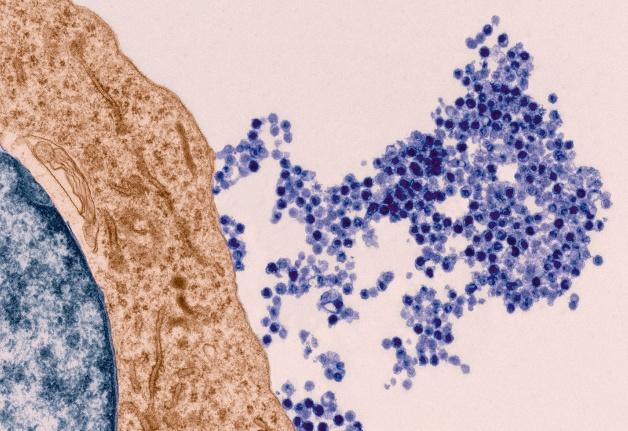

La sclérose en plaques (SEP) est une maladie auto-immune inflammatoire et neurodégénérative potentiellement invalidante sur le plan moteur, sensitif et cognitif. Sa cause exacte reste mal connue. Le virus Epstein-Barr (EBV), très répandu et notamment responsable des mononucléoses infectieuses, est un facteur de risque avéré. L’hypothèse dominante à ce sujet suggère qu’une protéine du virus, EBNA1, présente des similarités avec des protéines de notre système nerveux central. Conséquence : chez certains individus, le système immunitaire reconnaît par erreur EBNA1 dans ces dernières et enclenche une réponse, entraînant une cascade inflammatoire et des dégâts tissulaires à l’origine des manifestations cliniques de la sclérose en plaques. Ces réactions qui ciblent « par erreur » nos propres tissus sont dites « croisées ». Ce mécanisme concernerait plusieurs protéines de notre système nerveux central, avec des implications variées dans le déroulement de la maladie. Certaines protéines ont déjà été identifiées, mais d’autres font l’objet de soupçons sans que le lien n’ait été

encore formellement établi. C’est le cas de la molécule ANO2 qu’Olivia Thomas, du département de neurosciences de l’institut Karolinska, à Stockholm, et ses collègues ont étudiée. Les chercheurs ont d’abord confirmé que les cellules immunitaires qui reconnaissent spécifiquement EBNA1 – des lymphocytes T – s’activent contre ANO2 in vitro. Mais injectées chez des souris saines, elles ne déclenchent pas la maladie. En revanche, chez des souris modèles de la SEP, les symptômes s’accentuent. Olivia Thomas et son équipe soupçonnent que ces lymphocytes ne sont pas capables, seuls, de pénétrer le système nerveux central et donc d’être à l’origine de la pathologie. Mais celleci semble altérer les barrières qui isolent le système nerveux du système immunitaire. n

Marguerite Jamet O. G. Thomas et al., Cell, 2026.

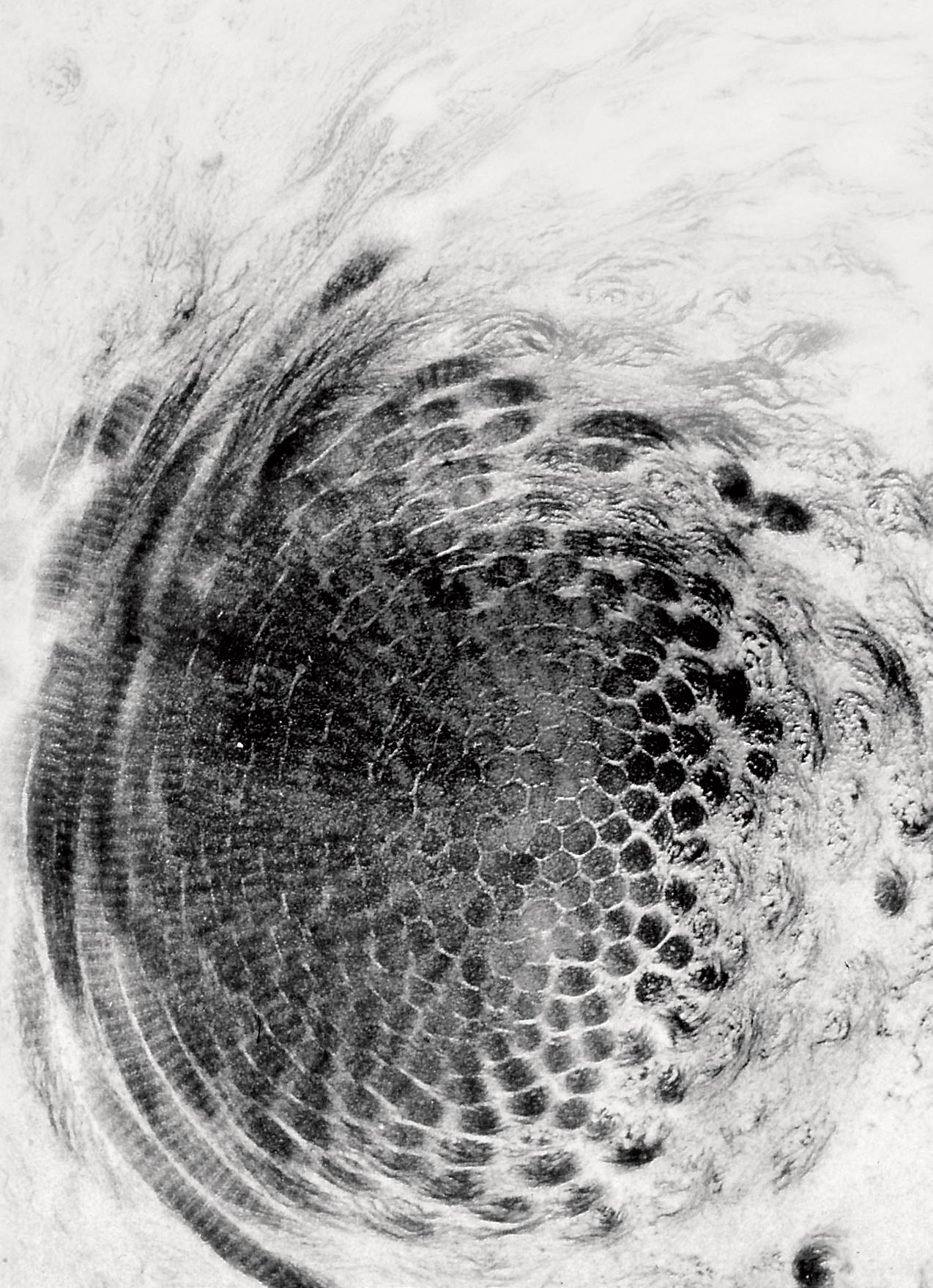

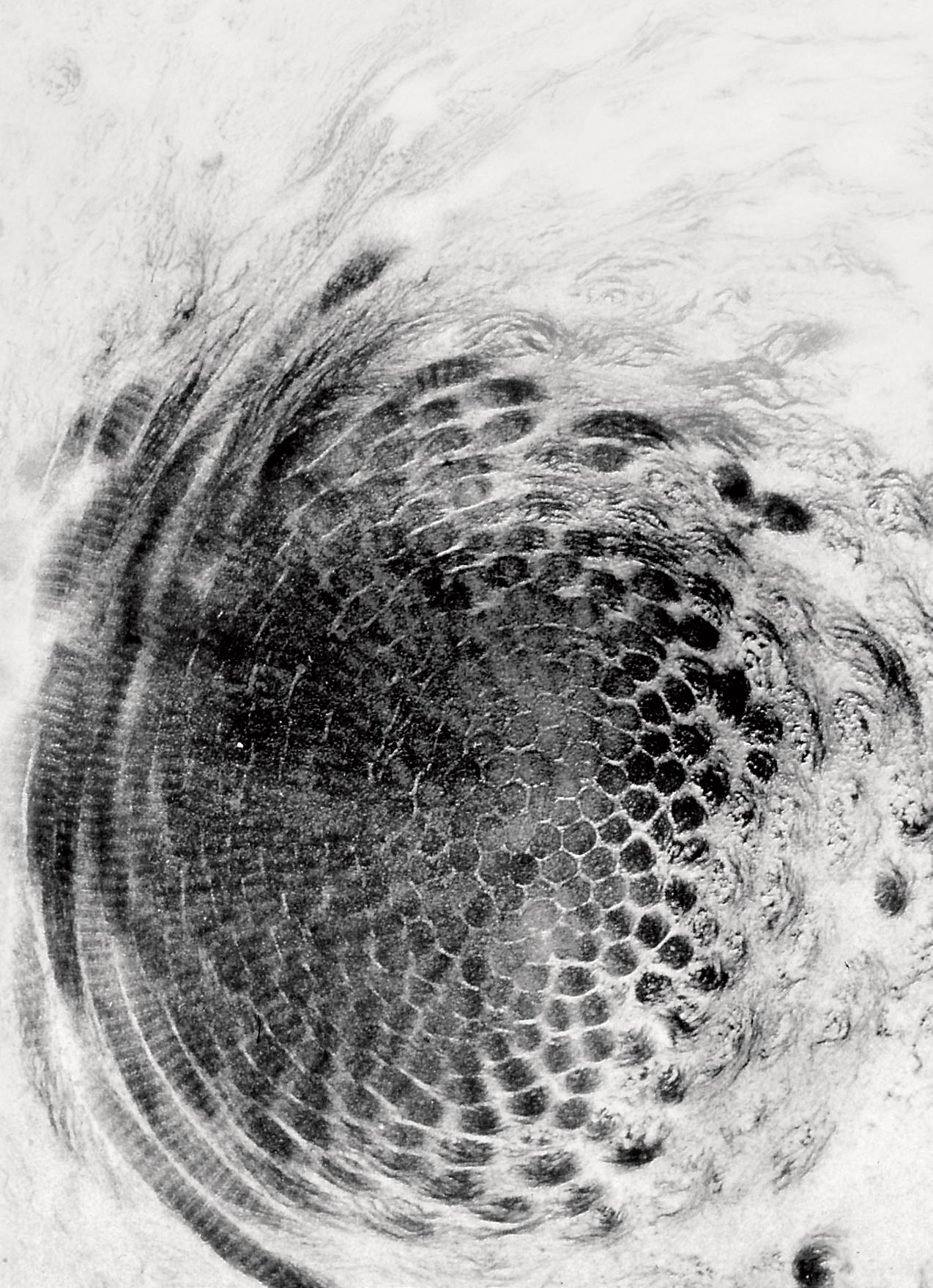

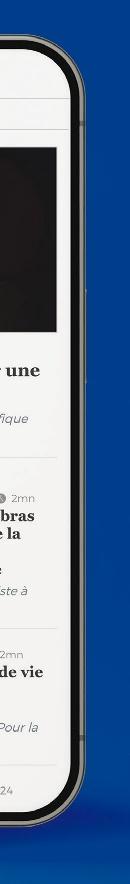

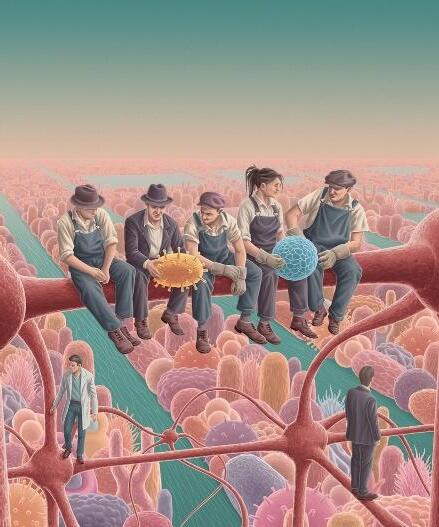

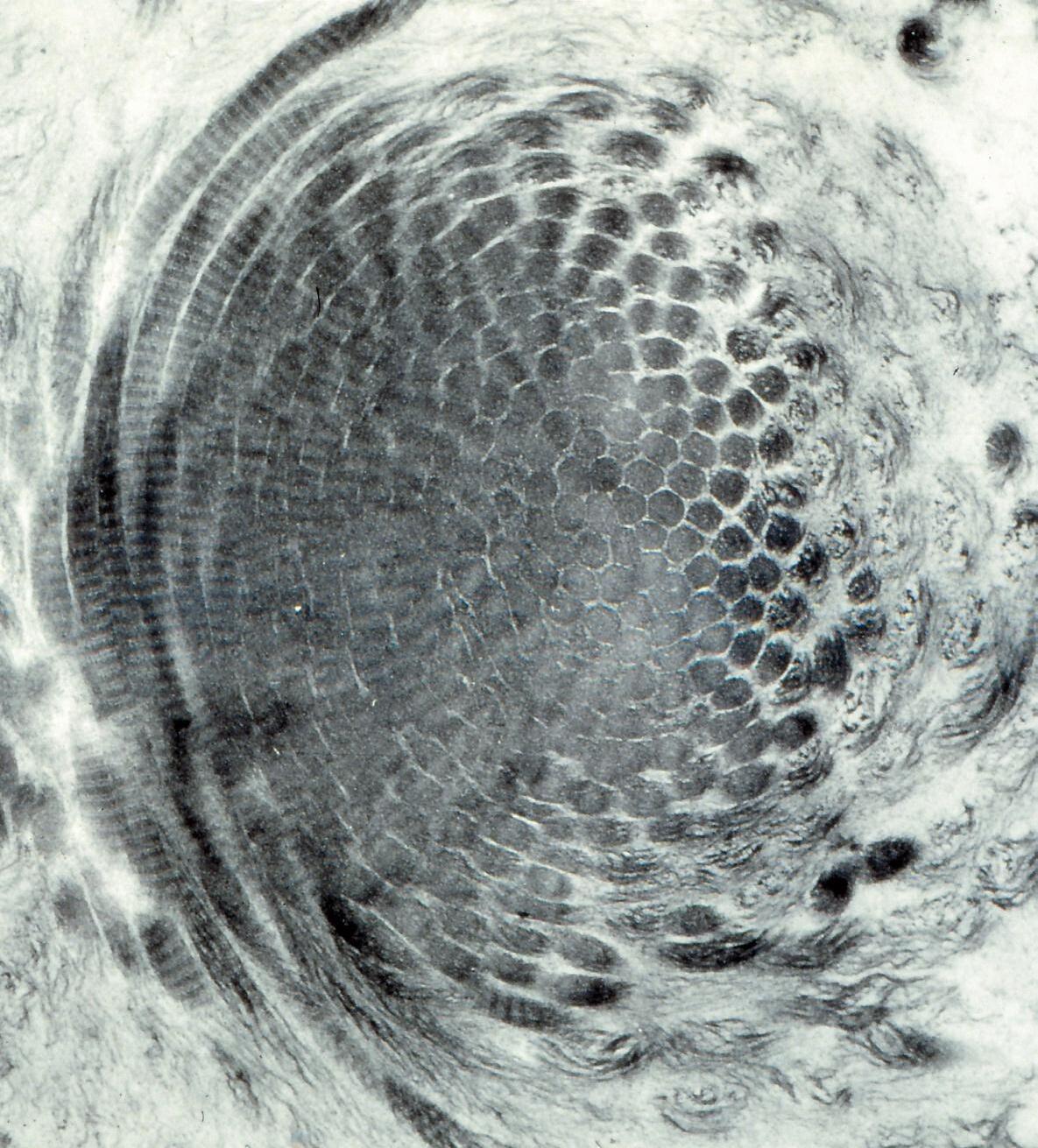

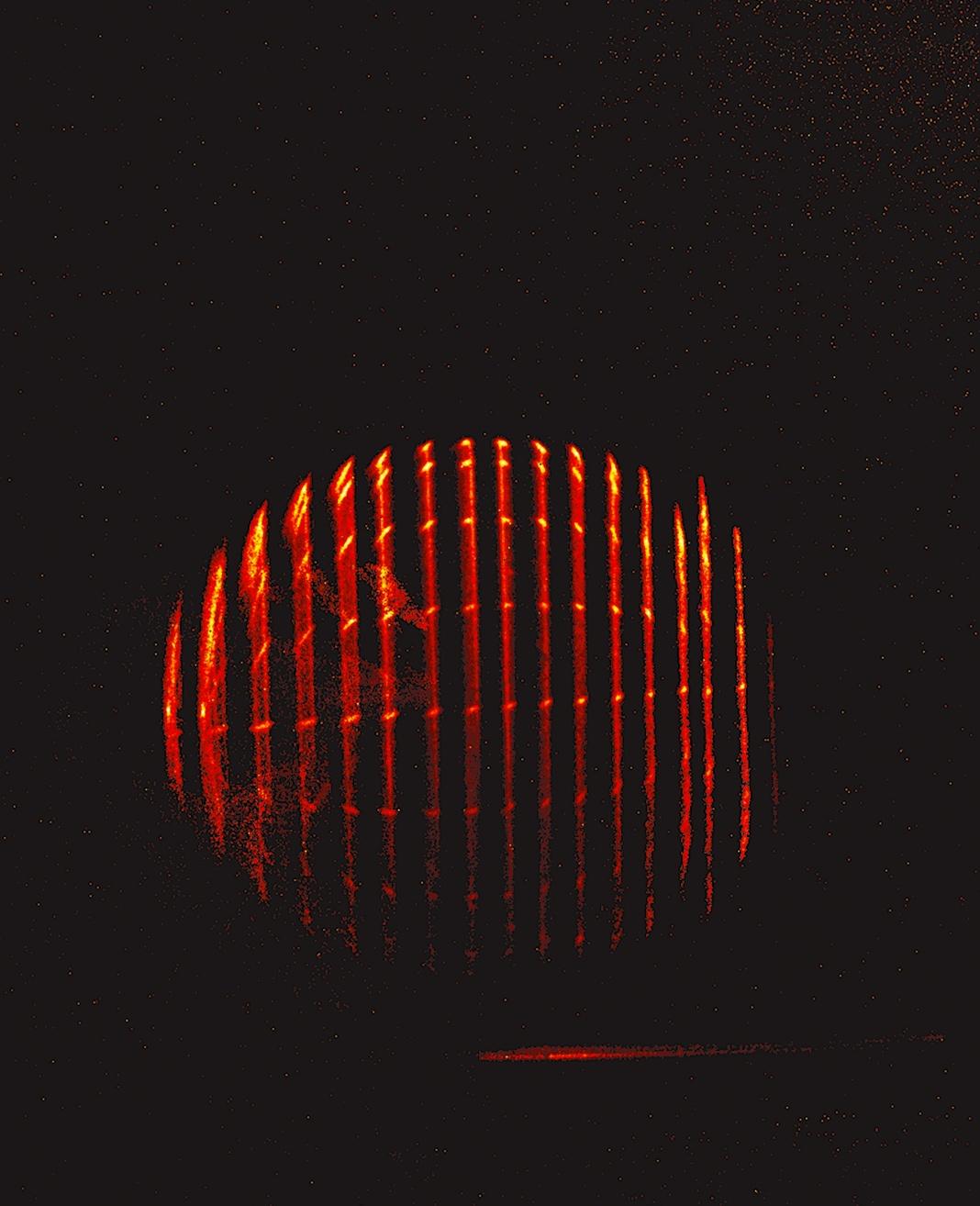

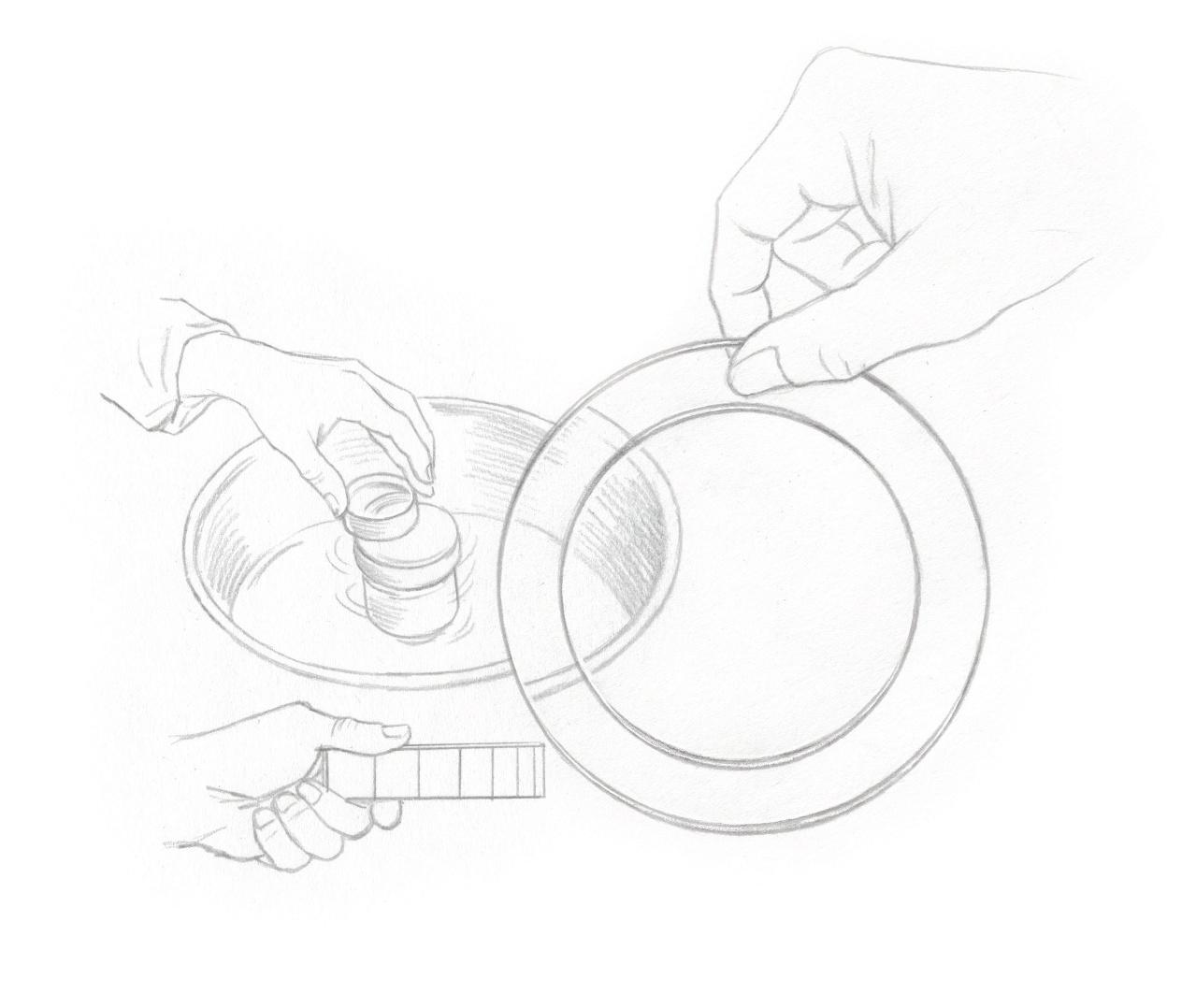

Le collagène des os, l’ADN des chromosomes, la chitine de la carapace des arthropodes… dans les organismes vivants, nombre de macromolécules s’assemblent en une structure en « twist cholestérique » similaire à celle qui est photographiée ici en microscopie électronique à transmission, obtenue in vitro avec des fibrilles de collagène. On arrive aujourd’hui à imiter cette structure avec du collagène dans des conditions physiologiques.

Nadine Nassif et Marie Madeleine Giraud

Ou comment l’étude des propriétés d’autoassemblage d’une protéine longtemps cantonnée aux promesses anti-âge ouvre de nouvelles voies pour la médecine régénératrice.

«Ah oui, ça sert à combler les rides ? » C’est une réponse habituelle quand nous disons que nous travaillons sur le collagène. Largement majoritaire dans le corps humain, cette protéine forme la matrice des os, des tendons, des ligaments, de la cornée, du derme et d’autres tissus, mais elle est surtout connue du grand public pour des raisons de marketing lié à la médecine anti-âge. Les chercheurs ont appris au fil des ans à apprivoiser cette macromolécule, les biologistes ont su l’extraire et la purifier, les physicochimistes en décrire la structure et les propriétés. Cette maîtrise a permis la proposition de produits commerciaux. La cosmétique anti-âge et plus récemment le domaine des compléments alimentaires ont beaucoup fait parler d’elle. Or, dans ces domaines, son efficacité est loin d’avoir été prouvée.

En injection cutanée pour combler les rides, les formulations actuelles en collagène ont une durée de vie limitée. Peu concentrées pour des questions de coût et de procédé (au-delà d’un certain seuil, il devient trop visqueux), elles ne fonctionnent que quelques mois, avant que des enzymes ne dégradent la protéine. Il faut donc recommencer périodiquement les injections, ce qui est cher et lassant, sans compter les réactions allergiques qu’elles déclenchent

L’ESSENTIEL

Dans les années 1970, une équipe de biologistes montra que des macromolécules comme le collagène s’assemblent en une structure 3D torsadée qui s’apparente à celle de cristaux liquides.

En reproduisant cet état au laboratoire avec du collagène, l’équipe a créé des matrices denses mimant, selon leur concentration, celles de l’os, de la peau ou de la cornée. Testés récemment chez l’animal, ces biomatériaux réparent les tissus avec une efficacité proche de celle de l’autogreffe et ouvrent de nouvelles possibilités en chirurgie humaine.

parfois. Quant aux crèmes à base de collagène contre le relâchement cutané, elles sont inefficaces pour une raison simple : à cause de sa taille et de sa faible solubilité, cette macromolécule ne peut pas traverser l’épiderme. Pour une absorption cutanée, on utilise des formes hydrolysées ou d’autres peptides de plus petite taille, mais on perd alors les fonctions et les propriétés de la molécule native.

Enfin, le collagène est vendu très cher en complément alimentaire. Or, comme toutes les protéines ingérées, il est alors digéré et dégradé sous la forme d’acides aminés, ses constituants. La protéine d’origine n’est donc pas nécessaire pour fabriquer du beau collagène. Une alimentation variée est a priori tout aussi efficace et beaucoup moins coûteuse !

En fait, dans le futur, il est plus probable que l’usage du collagène sera pertinent non en cosmétique, mais pour la réparation tissulaire. En effet, cette macromolécule présente des propriétés physiques étonnantes d’autoassemblage en édifices ordonnés tridimensionnels qui se révèlent remarquables pour réparer les os et d’autres tissus du corps. L’histoire de cette découverte a commencé dans les années 1970, dans l’équipe du biologiste Yves Bouligand, au Centre de cytologie expérimentale du CNRS, à Ivry-sur-Seine. Quelque cinquante

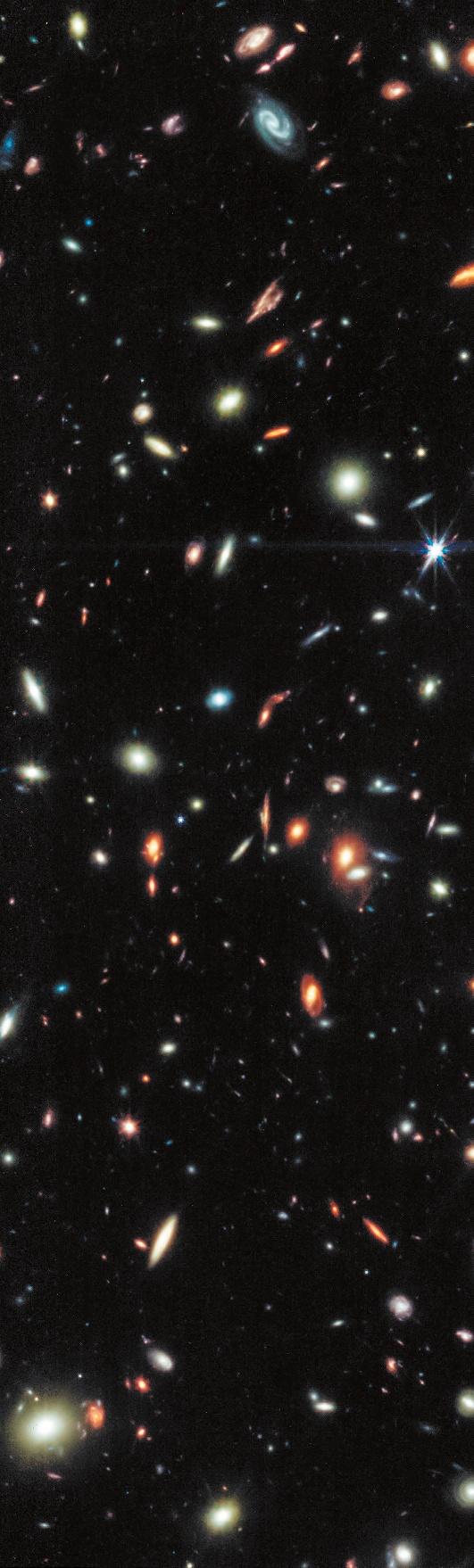

Heureusement, le JWST est arrivé à bon port et a lancé ses opérations à l’été 2022. Depuis lors, l’observatoire a commencé à répondre à certaines des plus grandes questions de l’astronomie, tout en en soulevant de nouvelles. L’une des plus grandes surprises est la découverte que des trous noirs supermassifs, dont certains font plus de 1 million de fois la masse du Soleil, existaient alors que l’Univers n’avait pas plus de 3 % de son âge actuel. Comment des trous noirs aussi massifs ont pu se former il y a si longtemps reste à ce jour une énigme. Les astrophysiciens ont certes imaginé un scénario : peut-être des trous noirs moins massifs se sont-ils formés à partir de la mort explosive des premières étoiles, appelées « étoiles de population III », et que ces trous noirs ont ensuite fusionné sous l’influence de la gravité pour former des trous noirs de 1 million de masses solaires. Mais comment des milliers de Cosmologie

José María Diego Rodríguez

Les astronomes espèrent bientôt repérer les étoiles primordiales, formées alors que l’Univers n’avait pas plus de 3 % de son âge actuel.

le jour de Noël 2021, aux côtés d’autres astronomes, j’ai regardé le télescope spatial James-Webb (JWST) décoller de Guyane française pour entamer son voyage d’un mois vers sa destination, à 1,5 million de kilomètres de la Terre. Le trajet fut riche en moments angoissants, en particulier pendant la semaine où le bouclier thermique du télescope, de la taille d’un court de tennis, s’est lentement déplié comme un origami depuis sa configuration de lancement, pas plus grande qu’un bus.

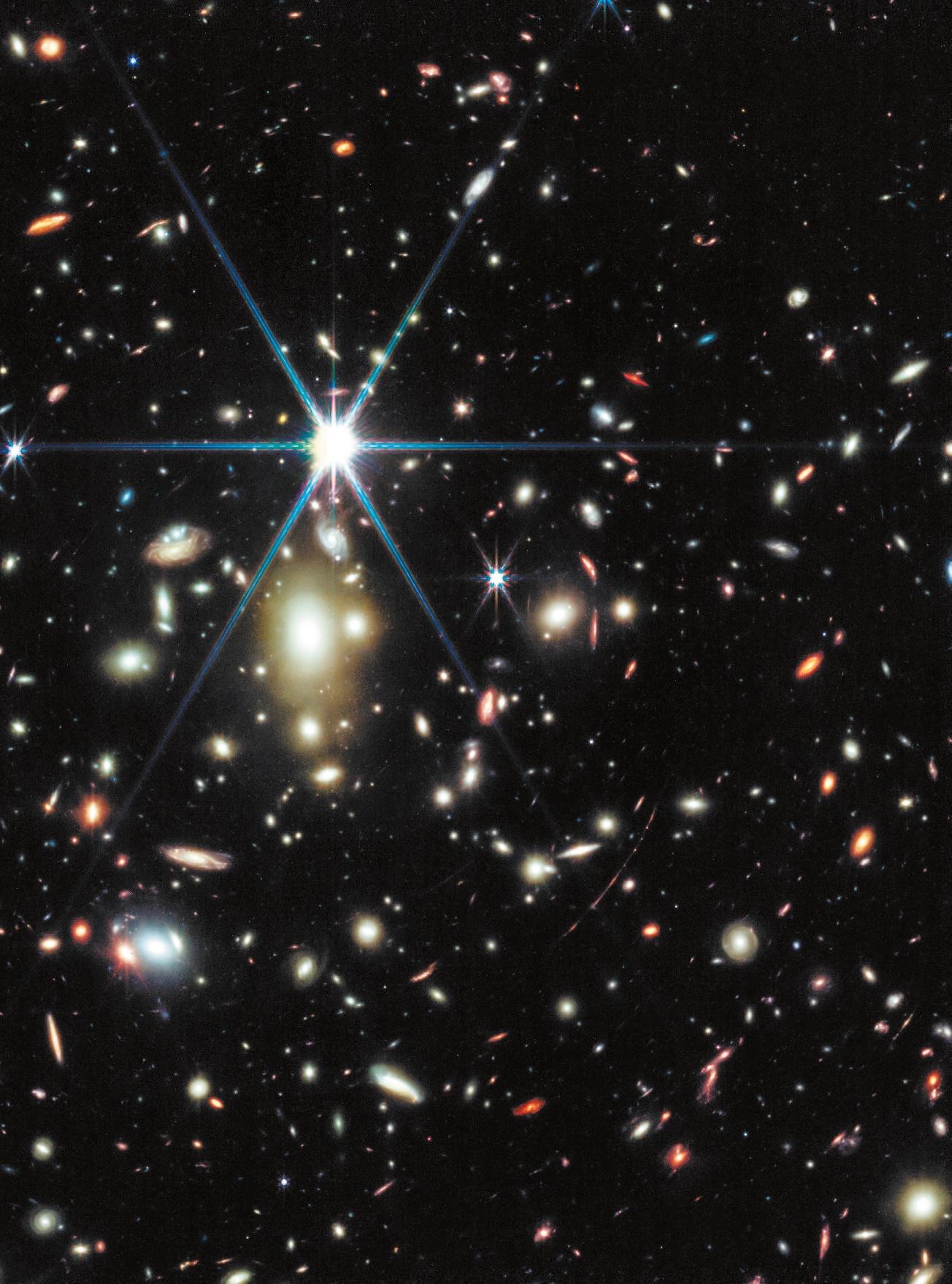

© Nasa, ESA, CSA ; Science : Dan Coe (STScI/Aura for ESA, JHU), Brian Welch (Nasa-GSFC, UMD) ; traitement d’images : Zoltan Levay

Earendel, l’actuelle détentrice du record de l’étoile la plus lointaine jamais observée, est entourée d’un cercle sur cette image du télescope spatial James-Webb, de la Nasa. L’étoile se trouve à l’intérieur de l’arc du Soleil levant (Sunrise Arc), une galaxie datant de l’univers primitif, dont l’image est agrandie et déformée par un amas de galaxies jouant le rôle de lentille gravitationnelle.

L’essentiel

Les astronomes cherchent à observer les étoiles de population III, les toutes premières à s’être formées.

Ces étoiles géantes, composées uniquement d’hydrogène et d’hélium, ont créé les premiers éléments lourds nécessaires à l’apparition des planètes et de la vie.

Comme ces étoiles sont trop lointaines pour nos télescopes actuels, les scientifiques utilisent les lentilles gravitationnelles. Ce phénomène naturel se produit lorsque la masse colossale d’amas de galaxies déforme l’espace-temps et agrandit l’image d’objets situés derrière eux jusqu’à 10 000 fois.

Ou comment la prolifération brutale en mer d’un mollusque, le taret commun, au XVIIIe siècle, a profondément marqué l’histoire de la marine.

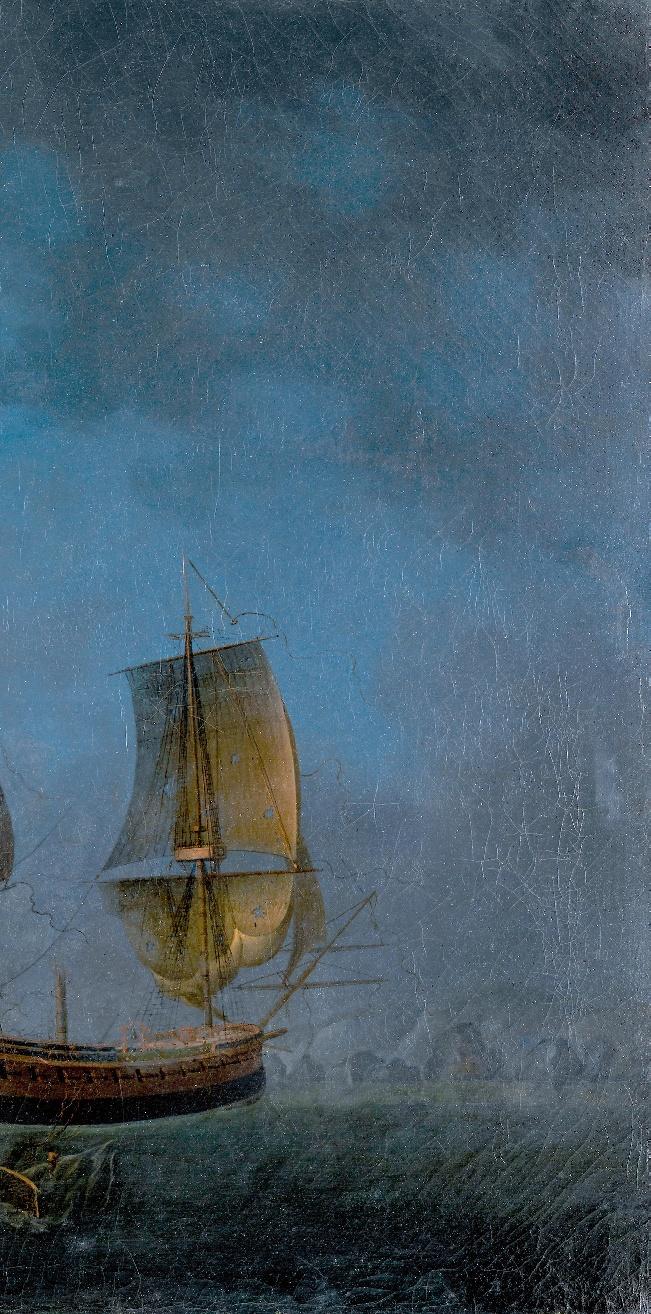

Combat de la Belle-Poule contre l’Aréthuse, 17 juin 1778, par Auguste Louis de Rossel (1789). C’est la frégate Belle-Poule (à gauche) qui fit l’objet du premier test en France du doublage de cuivre, en 1772, pour lutter contre le taret commun.

Pendant un siècle, les tentatives se succèdent pour élaborer une technologie capable de repousser l’animal.

La France et l’Angleterre explorent la piste du doublage de cuivre, mais de nombreux problèmes chimiques et mécaniques limitent sa longévité.

L’utilisation du cuivre augmente aussi la dépendance aux pays fournisseurs.

étudier l’histoire du cuivre conduit parfois à emprunter des chemins inattendus. C’est ainsi que pendant mon postdoctorat, je me suis retrouvée à enquêter sur un fléau qui s’est abattu sur les flottes européennes de l’époque moderne. Au XVIIIe siècle, dans les ports du roi de France, on s’affole face à de nouveaux ennemis de la flotte française. Les navires, qui ont pourtant l’habitude de subir les attaques de la tempête, des canons et des pirates, tremblent face à ces adversaires inattendus, « plus méprisables en apparence et pourtant très capables de nuire ». Le coupable n’est pas une puissance rivale, mais vient directement de la mer : un petit mollusque appelé « taret commun » ou Teredo navalis. Une véritable armée de ces vers marins dévore peu à peu le bois qui constitue les vaisseaux de la flotte française et semble résister à tous les assauts.

Le problème devient vite catastrophique. Les vers marins ont toujours fait partie des aléas de la mer, et remplacer les planches d’un navire de temps à autre quand le sel, les coquillages et les vers les ont trop endommagées fait partie de l’entretien normal d’un navire. Mais au XVIIIe siècle, les vers marins deviennent subitement destructeurs à des niveaux jamais vus de mémoire récente. Ils se multiplient « par milliers », écrivent les naturalistes de l’époque (par millions, en réalité) et rongent les vaisseaux « avec tant de fureur, que le bois des bordages en est tout criblé », ce qui met tout navire attaqué par ces vers en grand danger de « faire eau, et de périr ».

L’enjeu n’est pas négligeable. Une grande partie des revenus de la France de l’Ancien Régime dépend de sa flotte, sans parler de sa défense militaire. Le pays est alors en pleine expansion coloniale. Des colons s’installent en grand nombre en Amérique du Nord, en Louisiane et dans les plantations esclavagistes des îles Caraïbes. Ces dernières colonies, en particulier, représentent un profit immense pour la couronne française. Mais les plantations à sucre sont très exigeantes en matière de ressources et

En recrutant des outils empruntés aux neurosciences, à la psychologie expérimentale et à la linguistique, des chercheurs étudient le rêve et en tirent des enseignements profonds sur la conscience. Explications avec le philosophe Ludwig Crespin-Jouan.

LUDWIG CRESPIN-JOUAN agrégé et docteur en philosophie, est chercheur associé à l’université Clermont-Auvergne. Il conduit depuis 2010 des recherches sur la conscience et le rêve, à l’interface de la philosophie de l’esprit et des sciences cognitives.

Vous avez une formation de philosophe, comment en êtes-vous arrivé à étudier les rêves par l’intermédiaire des sciences expérimentales ?

Ludwig Crespin-Jouan : Au départ, je m’intéressais à la conscience. Et le rêve me paraissait un terrain d’expérimentation formidable, car il met en jeu toute une série de phénomènes qui questionnent nos intuitions et nos définitions sur le sujet. Pour commencer, il semble à première vue dissocié de ce qu’on appelle la « conscience d’accès » (par opposition à la « conscience phénoménale », qui désigne l’aspect expérientiel, l’effet que cela fait d’être conscient). Selon Ned Block, professeur de philosophie et de psychologie à l’université de New York, un état mental est conscient au sens de l’accès quand il est disponible pour le raisonnement et permet le contrôle de la parole et de l’action. Or ce qui est frappant dans le rêve, c’est qu’il s’agit d’un état conscient qui paraît intense d’un point de vue expérientiel, mais qui reste enfermé dans le sommeil : il est en grande partie déconnecté des entrées sensorielles et des sorties comportementales. En conséquence, il ne peut pas guider la parole et l’action « en direct ». Il est seulement rapportable a posteriori, et encore pas toujours, loin de là : les scientifiques estiment que nous rêvons plusieurs heures par nuit et nous n’en avons au mieux que quelques souvenirs en tête le matin ; dans l’immense majorité des cas, les rêves sont donc oubliés au fur et à mesure, avant de pouvoir être racontés. Le plus étonnant est que nous sommes parfois capables de les voir de l’extérieur. La neurologue Isabelle Arnulf, à la Pitié-Salpêtrière, étudie ainsi le trouble du comportement en sommeil paradoxal, une pathologie qui conduit les patients à extérioriser leurs rêves : ils vont par exemple grimper un escalier invisible, travailler à leur atelier, combattre d’impalpables ennemis… tout en restant parfaitement endormis. Réveillés pendant cet épisode, la plupart racontent un rêve qui concorde avec leur comportement, mais quelques-uns – moins de 1 sur 200 –n’ont jamais le moindre souvenir de rêver, ni même le sentiment d’avoir rêvé. Ces derniers ne sont donc pas en mesure d’attester qu’ils ont des expériences conscientes pendant leur sommeil, alors que les scientifiques qui les observent de l’extérieur le peuvent. Ce sont même eux qui les en assurent au réveil ! Pour un philosophe comme moi, « biberonné » à Descartes (pour qui chacun est la seule autorité sur ce qu’il pense), c’est assez paradoxal.

Mais si les songes ne sont pas rapportables « en direct », voire ne le sont jamais, comment être sûr que ces patients, et les rêveurs en général, vivent une expérience consciente ? Certaines théories postulent que les souvenirs de rêve sont une construction réalisée au réveil, à partir d’une activité mentale inconsciente qui court pendant le sommeil…

L. C.-J. : Ces théories sont largement discréditées aujourd’hui. Plusieurs travaux montrent que nous sommes bel et bien conscients pendant que nous rêvons. En effet, si les songes correspondaient à une sorte d’activité mentale inconsciente, ils s’effaceraient très vite de notre mémoire : les perceptions inconscientes (telles qu’une image située en périphérie du champ visuel ou un son auquel on ne prête pas attention) disparaissent ainsi en quelques secondes au maximum. Or les rêves s’ancrent plus durablement dans le cerveau, comme l’ont montré une série d’expériences astucieuse visant à créer un jalon dans les scénarios oniriques. En 1969, David Koulack, de l’université d’État de New York, a par exemple envoyé une légère décharge électrique sur le poignet de volontaires endormis, ce qui les a conduits à rêver d’événements congruents, par exemple qu’on les piquait ou qu’on les frappait à cet endroit ; et ils s’en sont souvenus quand on les a réveillés trois minutes plus tard. Si cet événement n’avait pas été vécu consciemment pendant le rêve, il n’aurait jamais pu être rapporté aussi longtemps après.

L’enfermement des songes dans le sommeil est en tout cas particulièrement intéressant pour les neuroscientifiques : il permet d’étudier le « noyau expérientiel » de la conscience, indépendamment des sorties comportementales et des entrées sensorielles. Ou tout au moins de s’en rapprocher, car le rêve n’est pas non plus une forme de conscience phénoménale pure : le rêveur raisonne sur ce qu’il croit percevoir, prend des décisions sur cette base, discute avec les personnages qu’il rencontre…

Que nous a appris le rêve sur ce noyau de la conscience ?

L. C.-J. : En 2017, Francesca Siclari, alors à l’université de Lausanne, et ses collègues ont cherché à en découvrir le fondement cérébral. Grâce à un électroencéphalographe à haute densité, ils ont identifié le réseau minimal qui doit être actif pour que le cerveau crée un rêve. Ce réseau comprend

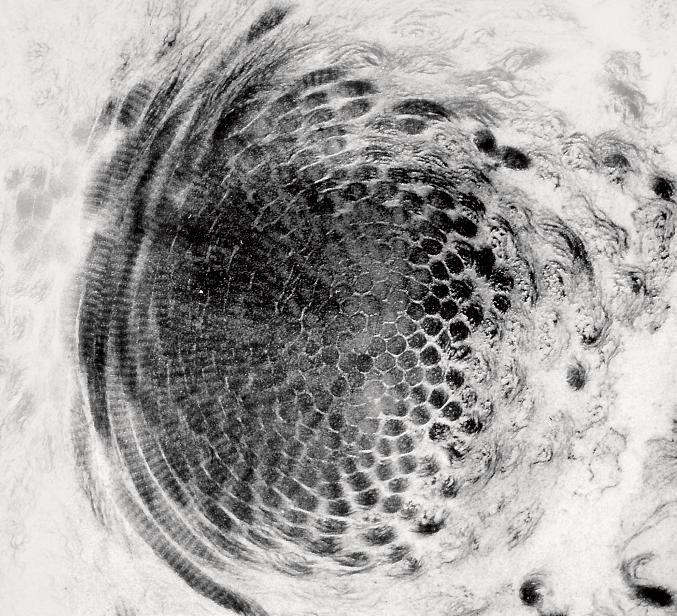

Des physiciens sont parvenus à observer pour la première fois l’effet Terrell-Penrose, un phénomène étrange prédit par la relativité restreinte.

Des physiciens ont artificiellement ralenti le temps pour révéler l’étrange effet Terrell-Penrose, une conséquence de la relativité restreinte. Cette image montre ainsi une sphère se déplaçant à une vitesse apparente proche de celle de la lumière.

dans sa nouvelle de science-fiction

Le Nouvel Accélérateur, publiée en 1901, H. G. Wells décrit une drogue qui accélère le métabolisme d’une personne d’un facteur 1 000. Pour les deux protagonistes qui testent vaillamment la potion, le monde semble étrangement ralenti, presque figé. L’histoire a poussé l’un d’entre nous, Peter Schattschneider, de l’université de technologie de Vienne, à se demander : si nous pouvions ralentir le temps, pourrions-nous voir des photons uniques voler à travers l’espace ? Pourrions-nous observer des phénomènes relativistes ? En particulier, pourrions-nous entrevoir les effets d’une prédiction théorique étrange appelée « effet Terrell-Penrose » ?

Cette prédiction stipule que des objets se déplaçant à une vitesse proche de celle de la lumière doivent apparaître comme curieusement pivotés, autour d’un axe perpendiculaire au mouvement. Cette notion semble aller à l’encontre d’une autre

L’essentiel

Bien que prédit mathématiquement en 1959, l’effet Terrell-Penrose n’avait jamais été observé en conditions réelles, car il nécessite des vitesses proches de celle de la lumière, impossibles à atteindre pour des objets massifs en laboratoire.

Afin de contourner cette difficulté, des physiciens ont utilisé la photographie ultrarapide et des lasers pulsés pour simuler ces vitesses et capturer le mouvement de la lumière sur des objets fixes ou légèrement déplacés.

Grâce à cette méthode, ils ont observé qu’une sphère aplatie redevenait visuellement sphérique et qu’un cube aplati paraissait pivoter, mettant en évidence expérimentalement l’effet TerrellPenrose.

prédiction de la théorie de la relativité restreinte d’Einstein connue sous le nom de « contraction de Lorentz », qui soutient qu’à mesure que la vitesse d’objets se déplaçant approche celle de la lumière, ces objets se contractent, dans la direction du mouvement. Bien que l’effet Terrell-Penrose ait été pris en compte dans des expériences de pensée et simulé sur ordinateur, il n’avait jamais été démontré dans la vie réelle.

La perspective d’un test en conditions réelles est restée en sommeil jusqu’à récemment, lorsque le collègue de Peter Schattschneider, le physicien spécialiste des technologies quantiques Philipp Haslinger,

dans la même université, lui a parlé des expériences conduites dans le cadre du projet Seec [un projet liant science et art, à l’université Stanford, aux ÉtatsUnis, ndlr], qui ambitionne de visualiser la manière dont la lumière se déplace sur les surfaces. Il lui a montré une vidéo dans laquelle une impulsion laser semble se déplacer à une vitesse de quelques mètres par seconde, soit environ 1 milliardième de la vitesse de la lumière seulement. L’idée de ralentir le temps était de nouveau là : le nouvel accélérateur de Wells allait finalement prendre forme, non pas à l’aide d’une potion magique, mais d’un système de photographie ultrarapide.

Photographie ultrarapide

Mais les scènes du projet Seec étaient des images fixes, l’objet ne bougeait pas. Et si l’on accélérait le sujet photographié à une vitesse proche de celle du laser ? Verrait-on alors la contraction de Lorentz ? Ou verrait-on plutôt l’effet Terrell-Penrose, encore plus étrange ? Presque immédiatement, nous avons élaboré le plan d’une expérience. Lorsque deux d’entre nous, Peter Schattschneider et Thomas Juffmann, également à l’université de technologie de Vienne, nous sommes rencontrés dans le laboratoire de ce dernier, nous avons constaté que nous étions tous deux inspirés par l’histoire de H. G. Wells.

Peter Schattschneider s’est associé au projet Seec (Philipp Haslinger, Thomas Juffmann et l’artiste Enar de Dios Rodríguez), ainsi qu’aux étudiants de master Victoria Helm et Dominik Hornof, pour démontrer l’effet Terrell-Penrose en laboratoire pour la première fois. Si nous réussissions, nous mettrions en évidence un phénomène prévu par la physique relativiste qui n’avait jamais été observé. Nous montrerions également que la théorie de la relativité offre encore des surprises plus d’un siècle après son introduction…

Pour comprendre ce qu’est exactement l’effet Terrell-Penrose, il faut d’abord considérer la contraction de Lorentz, l’une des prédictions les plus déconcertantes de la relativité restreinte. Selon celle-ci, la longueur d’un objet se déplaçant à la vitesse v rétrécit le long de la direction du mouvement lorsqu’elle est mesurée par un observateur immobile. Le facteur de compression est √(1-v2/c2), où c est la vitesse de la lumière.

Perig Pitrou

La biologie de synthèse et sa diversité de pratiques sont mobilisées dans des projets sociaux variés. Autant d’occasions de s’interroger sur les risques liés à certaines biotechnologies.

ce n’était en 2003 qu’un simple concours de projets pour étudiants de l’institut de technologie du Massachusetts (MIT), à Cambridge, aux États-Unis. Et puis, au fil des années, c’est devenu un événement international qui se tient depuis 2022 chaque année à Paris. Il s’agit de l’International Genetically Engineered Machine Competition, ou iGEM, c’est-à-dire une « compétition internationale de machines génétiquement modifiées ». S’inspirant des grands jamborees organisés par le mouvement scout, cette World Expo of Synthetic Biology réunit plusieurs centaines d’équipes d’étudiants et d’étudiantes venant d’une soixantaine de pays, qui défendent des projets d’applications possibles de la biologie de synthèse dans différentes catégories (santé, environnement, alimentation, éducation…).

« Biologie de synthèse » ? Les travaux de Michel Morange, biologiste et historien des sciences à l’École normale supérieure, à Paris, montrent comment cette expression recouvre des interventions très diverses sur le vivant, et soulignent que les innovations dans ce domaine doivent être replacées dans leur contexte historique afin d’en mieux cerner les continuités et les ruptures.

Lors d’une enquête menée à l’iGEM en 2014, afin de mieux comprendre comment la vie peut être appréhendée comme un processus de fabrication, je me suis intéressé à la dimension technique et sociale de ces pratiques où le faire l’emporte sur la connaissance. Dans le même temps, ces activités d’assemblage des briques du vivant sont mobilisées dans des constructions sociales fort diversifiées.

Dans Synthetic : How Life Got Made, Sophia Roosth, anthropologue et historienne des sciences à l’université Harvard, relate ses observations effectuées au MIT dans les années 2000 pour étudier les univers sociaux associés à la biologie de synthèse. On peut inscrire la fabrication d’organismes modifiés dans une logique où le brevetage du vivant est un moyen de tirer profit des innovations biotechnologiques, à l’image de Craig Venter, figure de l’entrepreneur dans une nouvelle ère du capitalisme.

Mais l’autrice explique comment l’idée de bricolage, au cœur des tiers lieux mettant en valeur le do-it-yourself, insère également la biologie de synthèse dans le registre de l’économie du partage. L’iGEM incarne ces deux dimensions :

l’accent placé sur les innovations et les possibles applications commerciales n’empêche pas la compétition de reposer sur les principes de l’open source. Dans leurs projets respectifs, toutes les équipes doivent en effet utiliser les mêmes briques du vivant mises à disposition pour la compétition et surtout partager les procédés mis en place pour les combiner.

L’enjeu est aussi de déterminer comment un dialogue avec la société s’instaure autour des usages et des potentiels dangers associés à ces pratiques. Sur cette voie, les expérimentations en art et en design sont à l’origine d’autres projets collectifs. Financé par les universités Stanford et d’Édimbourg, l’ouvrage Synthetic Aesthetics fournit un exemple de la volonté de favoriser ce dialogue.

La designer Alexandra Daisy Ginsberg propose ainsi un « design pour la 6e extinction », un scénario mis en image explorant comment la création d’organismes modifiés est susceptible de rendre des services écosystémiques, en dépolluant l’air ou les sols.

Tout ceci est-il sans danger ? La question n’est pas sans pertinence, comme l’attestent les interventions de représentants du FBI à iGEM pour informer sur les potentiels mauvais usages de la biologie de synthèse.

Dans le même ordre d’idées, une conférence a été organisée en 2025 à l’institut Pasteur pour réfléchir aux risques inédits que font courir les expérimentations dans le domaine de la vie en miroir, des organismes dont les molécules seraient des images inversées dans un miroir de celles qui existent dans la nature. Tous ces exemples montrent qu’indépendamment des usages sociaux inventés pour employer de nouvelles biotechnologies, il est crucial de construire des espaces collectifs pour faire circuler les savoirs scientifiques. n

Perig Pitrou directeur de recherche au CNRS, au laboratoire d’anthropologie sociale du Collège de France, où il dirige l’équipe Anthropologie de la vie

BIBLIOGRAPHIE

V. Cooper, La biologie synthétique face au spectre de la vie miroir, Pour la Science n° 581, 2026.

S. Roosth , Synthetic : How Life Got Made, University of Chicago Press, 2017.

A. D. Ginsberg (dir.), Synthetic Aesthetics : Investigating Synthetic Biology’s Designs on Nature, MIT press, 2014.

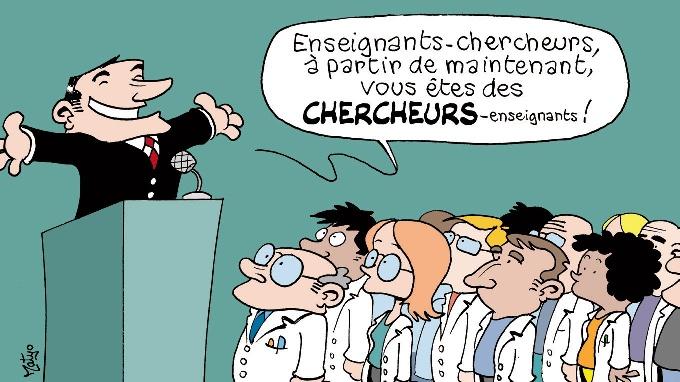

Yves Gingras

Alors que se tiennent en France, ce premier semestre 2026, des assises sur le financement des universités, les discours sur ces institutions tendent à passer sous silence un de leurs fondements clés : l’enseignement.

le 8 janvier 2026, le ministre français de l’Enseignement supérieur, de la Recherche et de l’Espace, Philippe Baptiste, a convoqué des « assises » pour faire le point sur le mode de financement des universités. Le terme est entendu ici au sens de comité composé de membres qui se réunissent pour discuter d’une question, mais il désigne, à l’origine, le support sur lequel quelque chose repose. L’assise représente donc « un élément fondamental qui garantit l’équilibre, la résistance et l’intégrité face aux défis et aux épreuves », précise le site le-dictionnaire.com.

De fait, les véritables assises de l’université moderne sont formées de deux bases : l’enseignement et la recherche. Ce modèle, marqué par la fondation de l’université de Berlin en 1809, a constitué une transformation fondamentale de la mission de l’université. Jusque-là vouée à l’enseignement alors que la recherche était incarnée dans les académies, la nouvelle institution, pensée par le philosophe et linguiste prussien Wilhelm von Humboldt, fusionna ces deux missions et fit ainsi émerger la figure de l’« enseignant- chercheur ». Depuis la fin du XIXe siècle, l’Amérique

du Nord a largement suivi ce modèle, mais la France – imitant l’Union soviétique – a plutôt choisi de concentrer la recherche (et donc les chercheurs) au sein du CNRS créé en 1939, considérant que la structure universitaire ne permettait pas de l’accueillir.

Les choses ont évolué avec la création des unités mixtes de recherche (CNRS-universités) au cours des

1 604 200

c’est le nombre d’étudiants inscrits à l’université en France. Parmi eux, 69 600 sont en doctorat, soit 4,3 % des effectifs.

Source : EESRI 2025

années 1960 et, surtout, avec la loi de 2007 relative aux libertés et responsabilités des universités (LRU), qui a donné davantage d’autonomie et de pouvoirs aux universités pour les aligner sur le modèle dominant à l’international. Néanmoins, l’État encadre encore largement cette « autonomie » et, dans nombre de

domaines, les organismes hors université demeurent des lieux privilégiés de la recherche.

Chose certaine, partout où le modèle humboldtien s’est imposé, les deux missions de l’université sont devenues de plus en plus déséquilibrées, particulièrement depuis les années 2000 avec la compétition internationale entre universités et la course aux classements, lesquels mettent fortement l’accent sur le niveau des activités de recherche. L’enseignement s’est ainsi vu peu à peu déprécié dans les discours des dirigeants alors même qu’il demeure au cœur des activités des universités, les étudiants de premier cycle composant toujours la majorité des inscrits et la formation de chercheurs de niveau doctoral ne dépassant généralement pas 25 % des effectifs. Malgré cette réalité évidente, les efforts des présidents d’universités et des ministres de l’enseignement supérieur pour le valoriser restent marginaux. Leurs interventions se focalisent sur les « chercheurs étoiles » et sur les millions d’euros obtenus auprès de divers organismes de recherche.

Ces discours sont en fait l’expression de « l’emprise du champ scientifique sur le champ universitaire », pour reprendre le titre d’un article que Brigitte Gemme (ma doctorante d’alors) et moi avons publié en 2006. Le champ universitaire a longtemps obéi à une logique différente de celle du champ scientifique. Le premier est un espace d’abord national (et maintenant plus ou moins globalisé) dans lequel les institutions sont en concurrence pour attirer des étudiants ; le second est un espace de compétition entre chercheurs qui visent à accroître (par leurs publications) leur capital scientifique et symbolique. Ce n’est

L’oubli de la place centrale de l’enseignement dans la mission de l’université a peut-être atteint son paroxysme en France dans le discours de Philippe Baptiste qui, le 29 octobre 2025, lors d’une audition au Sénat, qualifia les enseignants-chercheurs de « bande de nuls », car ils n’obtenaient pas assez d’octrois de recherche au niveau européen. La même fixation sur la recherche se voit aussi dans les déclarations de présidents d’universités qui disent avoir trouvé quelques millions d’euros pour attirer dans leurs institutions des « chercheurs étoiles » des États-Unis, alors même que la majorité des universités françaises sont en déficit budgétaire ! Une fuite

qu’au cours de la seconde moitié du XX e siècle que ces deux champs sont devenus très liés, alors même que les budgets de recherche ont crû jusqu’aux années 1980. Les publications, budgets et brevets d’invention étant plus faciles à mettre en avant que les qualités d’un bon enseignant ou d’un programme de formation original, on comprend que la tendance à miser sur la recherche plutôt que sur l’enseignement soit devenue dominante et se soit imposée comme critère de « qualité » des universités se prétendant de « classe mondiale ».

en avant que le président Emmanuel Macron a lui-même actée en annonçant en mai 2025 avoir trouvé 100 millions d’euros pour convaincre des chercheurs étrangers (lire : « américains ») de « choose France »… Outre qu’on peut se demander si ces chercheurs enseigneront en français dans leur université d’accueil, parions que celles et ceux qui quitteront les ÉtatsUnis pour fuir Donald Trump auront la surprise de découvrir que leur nouveau laboratoire sera probablement logé dans un édifice en décrépitude et mal chauffé, et que leur université

Les deux missions de l’université sont devenues de plus en plus déséquilibrées, particulièrement depuis les années 2000

d’accueil aura peu de moyens pour l’entretenir et payer leurs salaires sur le long terme.

C’est cette emprise excessive de la logique du champ scientifique sur celle du champ universitaire qui explique ces discours et décisions somme toute irrationnels des dirigeants. Dirigeants qui oublient un fait important : l’écrasante majorité des étudiants n’ont pas vocation à devenir chercheurs, mais plutôt à s’intégrer dans la société après une licence ou peut-être un master pour contribuer ensuite à son développement culturel, social et économique. Il est grand temps de rétablir un juste équilibre entre les deux « assises » de l’université pour que cette institution garde vraiment les yeux rivés sur sa double mission. n

Yves Gingras professeur d’histoire et sociologie des sciences à l’université du Québec à Montréal, directeur scientifique de l’Observatoire des sciences et des technologies, au Canada L’AUTEUR

Jean-Paul Delahaye

Simples en apparence, ces formes constituées de carrés accolés ont engendré un foisonnement de jeux, mais aussi d’intéressants problèmes mathématiques.

les polyominos – nom parfois orthographié « polyminos » – sont les formes planes d’un seul tenant, avec ou sans trous, qu’on obtient en collant par leurs côtés un nombre fini de carrés de même taille. Il y a par exemple douze polyominos constitués de cinq carrés, appelés « pentaminos » (voir l’encadré 1). Les douze pentaminos sont énumérés et représentés dès 1907 par Henry Dudeney dans son célèbre livre d’énigmes mathématiques The Canterbury Puzzles (paru en français sous le titre Les Énigmes de Canterbury). Entre 1937 et 1957, de nombreux résultats concernant les polyominos sont publiés dans le journal Fairy Chess Review. Ce n’est cependant qu’en 1953 que le mathématicien américain Solomon Golomb propose ce nom de « polyomino », et c’est surtout la rubrique de Martin Gardner de novembre 1960 dans la revue Scientific American qui popularise les problèmes à leur sujet. Plusieurs livres leur ont depuis été consacrés, dont un ouvrage signé Solomon Golomb paru en 1965 puis complété en 1996. Dénombrer les polyominos constitués d’un nombre donné de carrés est un défi qui a suscité des travaux approfondis. En dépit de ces efforts, on ne connaît à l’heure actuelle aucune formule générale donnant cette quantité. On sait seulement dénombrer les polyominos constitués d’un petit nombre

L’AUTEUR

Jean-Paul Delahaye professeur émérite à l’université de Lille et chercheur au laboratoire Cristal (Centre de recherche en informatique, signal et automatique de Lille)

de carrés : il y a un seul domino (constitué de deux carrés), deux triominos (constitués de trois carrés), cinq tétraminos (constitués de quatre carrés), douze pentaminos (constitués de cinq carrés), trente-cinq hexaminos (constitués de six carrés).

Dénombrements

Pour aller plus loin dans cette énumération, il faut préciser ce que l’on considère comme des polyominos équivalents, qu’il ne faut donc pas compter plusieurs fois (voir le tableau page 72)

– On peut considérer, ce qui est l’option la plus courante, que deux polyominos sont identiques si l’un s’obtient à partir de l’autre en opérant une ou plusieurs fois une rotation et/ou une symétrie par rapport à une droite (un retournement). Avec cette convention, on parle de « polyominos libres ». C’est implicitement cette notion que nous avons utilisée dans le début de ce texte.

– Si l’on s’interdit les retournements, on parle alors de « polyominos unilatéraux » (one-sided, en anglais). Il y a 18 pentaminos unilatéraux (pour seulement 12 pentaminos libres), car les pentaminos F, L, N, P, Y et Z se dédoublent.

– Si l’on s’interdit aussi les rotations, on parle de « polyominos fixes ». Il y a 63 pentaminos fixes.

– Même si ce n’est pas le cas dans cet article, certaines conventions rejettent les formes avec des trous, qui ne sont alors pas considérées comme des polyominos.

Chose étonnante : concevoir et mettre au point de bons algorithmes pour dénombrer les polyominos est un problème difficile, qui a donné lieu à toute une série d’articles mathématiques, dont certains ont paru très récemment. Mais même les meilleures

méthodes se heurtent rapidement au temps de calcul ou à l’espace mémoire nécessaires : les records de décompte sont donc, aujourd’hui encore, limités aux petites valeurs pour le nombre de carrés constituant les polyominos.

On peut en particulier citer l’article du mathématicien canadien Hugh Redelmeier paru en 1981 dans la prestigieuse revue Discrete Mathematics , qui a été amélioré en 2024 par Gill Barequet et Gil Ben-Shachar. Dans ce dernier papier, les deux chercheurs parviennent à dénombrer les polyominos fixes constitués de 70 carrés. Il y en a : 18 500 792 645 885 711 270 652 890 811 942 343 400 814

Concernant les polyominos unilatéraux, John Mason est parvenu à démontrer, en 2023, que ceux constitués de 50 carrés sont au nombre de : 4 300 365 220 322 020 871 043 392 169

La recherche de formules approchées pour dénombrer les polyominos constitués de n carrés, pour n un entier quelconque, est une question mathématique véritablement délicate. On sait aujourd’hui que le nombre A n de polyominos fixes constitués de n carrés croît exponentiellement avec n, c’està-dire qu’il croît comme rn, avec r une certaine constante appelée « constante des polyominos » ou parfois « constante de David Klarner », en hommage au premier à l’avoir définie. Les derniers résultats de recherche au sujet de cette constante indiquent que 4,00 253 ≤ r ≤ 4,5252.

Quand on sait approximer le nombre de polyominos fixes constitués d’un grand nombre de carrés, on peut approximer le nombre de polyominos libres constitués du même nombre de carrés. En effet, quand

Les pentaminos sont les polyominos constitués de cinq carrés accolés par leurs côtés. Il y en a douze, et aucun d’entre eux n’a de trou. On les nomme avec les lettres de l’alphabet en s’inspirant de leur forme (voir ci-dessous)

Un puzzle très populaire consiste à assembler les douze pentaminos libres pour former un rectangle. C’est possible pour les rectangles de tailles 6 × 10, 5 × 12, 4 × 15 et 3 × 20. Pour le rectangle de taille 6 × 10, il y a 2 339 assemblages différents qui conviennent. Pour le rectangle de taille 5 × 12, il y a 1 010 solutions. Il y en a 368 pour le rectangle de taille 4 × 15, et deux solutions pour le rectangle 3 × 20 (voir ci-dessous pour ce dernier cas)

Un problème moins classique consiste à recouvrir par 9 pentaminos différents chaque pentamino dont la taille des carrés a été multipliée par trois (voir ci-dessous)

Hervé Le Guyader

Un gisement fossilifère récemment découvert en Chine prouve à quel point la crise Sinsk, il y a environ 513,5 millions d’années, a façonné la biodiversité.

àquelque 400 kilomètres à l’ouest de Wuhan, dans le comté de Huayuan, à la limite ouest de la province du Hunan, en Chine du Sud, une carrière d’une épaisseur de 12 mètres a révélé ces cinq dernières années un trésor inestimable pour les paléontologues : un gisement fossilifère d’une rare richesse, qu’une importante équipe réunie par Maoyan Zhu, de l’institut de géologie et de paléontologie de l’Académie chinoise des sciences, à Nanjing, vient de décrire. Les schistes de ce gisement, datés de 512 millions d’années, contiennent faune et flore de cette époque – un véritable biote qui s’est fossilisé dans les sédiments profonds de l’océan qui, à l’époque, couvrait cette région. Les animaux dominent, avec une large proportion d’espèces endémiques, mais

L’AUTEUR

Hervé Le Guyader professeur honoraire de biologie évolutive à Sorbonne Université, à Paris

aussi certaines observées dans un seul autre gisement (lui aussi d’une grande richesse), les schistes de Burgess, dans les Rocheuses canadiennes.

Parmi les nombreux animaux décrits, plus d’un tiers sont des arthropodes, mais on trouve aussi des éponges, des annélides (des vers), des mollusques et des brachiopodes (des animaux bivalves à symétrie dorsoventrale, différente de celle des mollusques bivalves). Certains cousins des vertébrés les accompagnent, comme des hémichordés et des tuniciers, mais pas de vertébrés, qui commençaient juste à émerger. La qualité des fossiles est exceptionnelle, avec une préservation stupéfiante des tissus mous, donnant accès à des spécimens très qualitatifs. Par la structure des membres, de la bouche, de l’intestin, les anatomistes ont réussi à attribuer à presque toutes les espèces une situation écologique précise, ce qui leur a donné sans équivoque la structure globale de l’écosystème. On se rend ainsi compte que bon nombre de ces animaux étaient soit carnivores, soit filtreurs, et que presque tous étaient pélagiques : ils nageaient en

pleine eau. Peu d’entre eux, comme les éponges, étaient benthiques. Un gisement extraordinaire, donc. Mais ce n’est pas tout, car sa situation temporelle éclaire aussi un événement capital, largement sous-estimé jusqu’à maintenant : la crise Sinsk. Pour bien comprendre de quoi il s’agit, il faut revenir plus d’un siècle plus tôt, aux premiers pas de la paléontologie du Cambrien, la période géologique entre 538,8 millions et 486,8 millions d’années.

Une explosion cambrienne sans histoire ?

Tout a commencé en 1909, quand Charles Walcott, de la Smithsonian Institution, a découvert la richesse fossilifère des schistes de Burgess, en Colombie-Britannique. Pendant plusieurs années, il a collecté des milliers de spécimens, mais il a fallu attendre les années 1970 pour que des paléontologues à l’université de Cambridge, au Royaume-Uni, Harry Whittington et ses doctorants Derek Briggs et Simon Conway Morris, revoient complètement cette faune paléozoïque datée du Cambrien moyen, il y a environ

a Cet animal à spicules trouvé dans le biote de Huayuan a été classé dans le genre Allonia, de la famille éteinte des chancelloriidés, qui ressemblent à des éponges.

L’intestin de ce fossile d’une nouvelle espèce d’arthropodes du clade des fuxianhuiidés a été préservé.

Cette éponge du genre Leptomitus porte encore des traces de matière organique préservée.

C’est le nombre de fossiles du biote de Huayuan que Maoyan Zhu et ses collègues ont formellement classés parmi les quelque 50 000 qu’ils ont étudiés.

L’équipe a identifié 161 espèces – 153 animaux, 6 algues et 2 cyanobactéries (par les stromatolithes qu’elles ont laissés, des structures laminaires caractéristiques en calcaire) – dont 59 % sont nouvelles.

Au moins 308 genres d’éponges archéocyathes, décrits dans des gisements sibériens du début du Cambrien, vivaient avant la crise Sinsk. Le biote de Huayuan, postérieur à la crise, ne compte que 33 espèces d’éponges, incluant 14 nouveaux genres.

Coller sans colle du verre ou de l’acier ? C’est possible, en polissant suffisamment les surfaces pour les rendre le plus planes possibles. La force de Van der Waals s’occupe du reste.

Flûte ! Le vase est tombé et s’est cassé… Comment le réparer ? Impossible de recoller les morceaux en les pressant l’un contre l’autre ! Et cela même si les cassures semblent nettes. Pourtant, en les mettant en contact, deux fragments de mica fraîchement clivés se réassemblent aussi solidement qu’ils l’étaient avant qu’on les sépare. Et cela sans aucune colle. Et l’on peut aussi solidariser durablement des bouts d’acier ou des pièces de verre par simple contact. Dans ce dernier cas, l’adhérence peut être si forte qu’il devient impossible de séparer les pièces assemblées sans les briser. On parle alors de « contact optique ». Comment est-ce possible ? Par un polissage approprié des surfaces et

LES AUTEURS

Jean-Michel Courty professeur de physique à Sorbonne Université, au laboratoire Kastler-Brossel

Édouard Kierlik professeur de physique à Sorbonne Université, au LPTMC (CNRS, SU)

en laissant agir les forces intermoléculaires à courte portée.

Commençons par les cales étalons, des blocs de métal ou de céramique qui jouent dans les ateliers de mécanique le rôle de référence de longueur pour calibrer des instruments de mesure ou effectuer des réglages fins. Elles se présentent comme des parallélépipèdes rectangles dont une des dimensions – la distance entre deux faces opposées dites « mesurantes » – est définie, en fonction de sa classe de précision, avec des incertitudes allant de quelques dixièmes de millimètre (mm) jusqu’à seulement quelques dizaines de nanomètres (nm).

Réunions d’étalons

En pratique, on achète un jeu de plusieurs dizaines de cales avec lesquelles on peut obtenir une grande variété d’épaisseur ou de longueurs avec un incrément aussi fin que 1 micromètre. Pour obtenir une taille qui n’est pas déjà fournie, on accole ces cales. Le résultat est une pièce unique de la longueur voulue avec une excellente précision. Ce procédé, nommé wringing, se fait manuellement et est

réversible : on peut désassembler les cales. Il n’en demeure pas moins qu’on arrive à faire adhérer deux blocs de métal en les faisant juste glisser l’un sur l’autre et en les pressant. Ce comportement exceptionnel trouve son origine principale dans la force de Van der Waals. Cette force attractive d’origine quantique s’exerce entre tous les atomes et les molécules, même neutres, et est due à l’interaction électrostatique résiduelle entre les charges qui les constituent. Peu intense et de courte portée, c’est elle qui assure la cohésion de la matière qui nous environne. Quel est son rôle ici ? On peut estimer par le calcul la force par unité de surface qui résulte de ces interactions, entre deux plaques parfaitement planes en vis-à-vis et séparées par une distance nanométrique. Elle est proportionnelle à l’inverse du cube de cette distance avec un coefficient de proportionnalité caractéristique des matériaux des plaques et de l’air ou du liquide qui les sépare. Pour les cales étalons et une configuration acier/air/acier, cette constante est de l’ordre de 1,3 × 10 – 20 joules. Pour une

On peut rendre solidaires des blocs de métal, par exemple des cales étalons (des blocs d’acier, en bas à gauche), ou bien des disques de verre (ci-contre), du moment qu’ils sont bien polis, par exemple avec un outil à support de poix (au deuxième plan)

C’est l’ordre de grandeur de la force nécessaire pour séparer deux surfaces d’acier parfaitement planes distantes de 10 nm.

séparation de 10 nm, la force d’attraction vaut 1,3 newton par centimètre carré (N/cm 2), de quoi supporter une masse de 130 grammes (g). C’est assez pour maintenir les 250 g d’une cale étalon typique (3,5 cm × 0,9 cm × 10 cm) avec sa surface de contact de 3 cm2. En revanche, du fait de sa décroissance extrêmement rapide, la force n’est plus que de 0,00000 025 N/cm 2 pour une séparation de 1 micromètre : elle ne supporte plus grand-chose !

Comment alors approcher deux surfaces à une distance d’une fraction

C’est l’action d’assembler des cales étalons en acier.

de millimètre ? Lorsque ces surfaces sont parfaitement planes, c’est facile. C’est ce qui arrive avec le mica. Ce minéral est constitué de feuillets, maintenus ensemble par des ions et les forces de Van der Waals, mais qui demeurent faciles à séparer. Lorsqu’on clive un morceau de ce minéral, on obtient des surfaces atomiquement planes sur des zones très larges de sorte que si on remet au contact les deux surfaces fraîchement séparées, elles se recollent et la force nécessaire pour les séparer à nouveau est quasi

C’est la précision obtenue sur la longueur de cales en acier de 1 centimètre de longueur.

identique à celle qui a été déployée pour le clivage initial.

Mais comment faire avec les autres matériaux ? Le cas le moins difficile, et le premier à avoir été mis en œuvre, est avec le verre. Un peu de préparation est nécessaire, car même si les vitres ou les miroirs semblent parfaitement plats et lisses, leur surface peut être très légèrement courbe et, à l’échelle microscopique, elle est assez rugueuse : elle présente des aspérités avec des vallées et des pics. Ces derniers sont les premiers en contact lorsqu’on approche