Le destin suspendu des échantillons martiens

Quand les IA écrivent des programmes

Les mesures qui font trembler l’énergie noire

Le destin suspendu des échantillons martiens

Quand les IA écrivent des programmes

Les mesures qui font trembler l’énergie noire

Quand la science en train de se faire se donne à entendre

Les scientifiques du Collège de France partagent leurs découvertes, dernières recherches, réflexions sur la science, et anecdotes de labo... Découvrez le podcast de Pour la Science

DES ENTRETIENS EXCLUSIFS

LES DERNIÈRES AVANCÉES SCIENTIFIQUES

LE MEILLEUR DE LA SCIENCE

Disponible sur toutes les plateformes

La recherche médicale est complexe, elle implique des milliers de chercheurs. Elle se fonde notamment sur des essais cliniques s’étalant souvent sur des années. Et la plupart du temps, ses premières victoires sont modestes, imparfaites, décevantes parfois face aux espoirs que certaines annonces ont pu susciter.

Souvenons-nous, comme le rappelle le neurologue Nicolas Villain, des premiers pas des traitements contre le sida, aux effets peu durables, marqués par des effets secondaires importants. Avec les trithérapies actuelles, l’affection par le VIH est une maladie chronique contrôlable. Souvenons-nous aussi des limites des premières chimiothérapies, qui ont pu être remarquablement dépassées, pour de nombreux cancers, en particulier grâce aux thérapies ciblées et à l’immunothérapie.

Le front de la lutte contre la maladie d’Alzheimer pouvait sembler figé. Il progresse pourtant, avec l’arrivée récente de nouveaux traitements et outils de diagnostic. Ceux-ci restent à parfaire, comme l’est la compréhension fondamentale de la maladie. Mais les perspectives s’ouvrent pour améliorer le quotidien des personnes atteintes par cette ennemie de la mémoire. Dans un tout autre domaine, c’est en se souvenant des premières esquisses de programmes de retour sur Terre d’échantillons martiens, au début des années 2010, que l’on

mesure la réussite de la mission confiée au rover Perseverance… Et que l’on s’émeut de la déroutante décision de l’administration américaine de ne pas financer sa prolongation, abandonnant sur le sol martien de précieux indices d’une éventuelle présence de la vie outre Terre. Ceux qui se souviennent que le modèle standard de l’Univers s’appuie depuis le début des années 2000 sur l’assimilation de la mystérieuse énergie noire à une constante seront surpris d’apprendre que de nouvelles mesures viennent battre en brèche cette conviction – ouvrant de profondes questions cosmologiques. Vous ne vous en souveniez pas ? Nos archives pourvoiront à cet oubli. Voilà tout l’intérêt d’un journal approchant la cinquantaine : l’évolution de la connaissance, ses pas de côtés, ses renversements autant que ses confirmations pérennes, s’y donnent à lire, au fil de ses archives. n

Lucie Berkovitch, psychiatre et chercheuse (GHU Paris psychiatrie et neurosciences), Maud Boyet, géochimiste (Laboratoire magmas et volcans), Grégoire Loïs, ornithologue (MNHN), Sandrine Prat, paléoanthropologue (MNHN), Isabelle Séguy, paléodémographe (Ined)

06 D’une éruption volcanique à la peste noire

08 D’où venait l’impacteur qui a créé la Lune ?

10 Contourner les mutations non-sens

11 Le « coup de pouce » du castor pour les pollinisateurs

12 De l’ordre dans le chaos de la fragmentation

– Points de vue –

58 La vie dans tous ses états L’hybride, au cœur du vivant Perig Pitrou

60 Sciences à la loupe Financement de la recherche : une liberté académique comme une autre ?

Yves Gingras

62 Redresseur de code Quand les programmes écrivent des programmes Thomas Gerbaud

64 Retour sur image Le ciel nocturne vidé de ses étoiles Charlotte Bigg

66 Regards L’appel du féral

Loïc Mangin

COSMOLOGIE « Desi » fait trembler l’énergie noire

Nathalie Palanque-Delabrouille Quelle est la nature de l’énergie noire ?

Les récents résultats du projet Desi sèment le trouble.

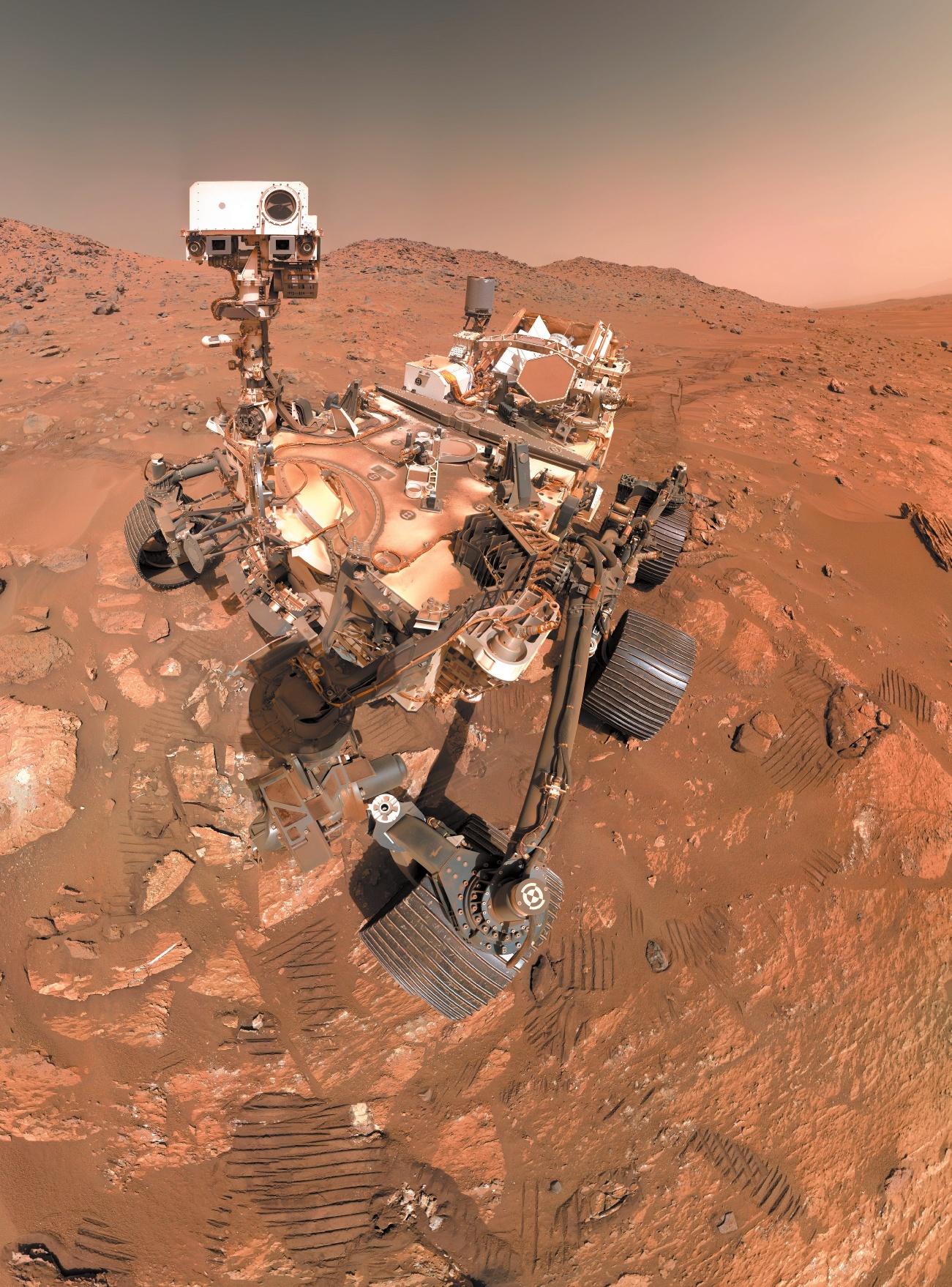

PLANÉTOLOGIE Seuls sur Mars

Jonathan O’Callaghan

Le rover Perserverance a collecté des échantillons martiens afin de les rapporter sur Terre. Ils risquent fort de ne jamais quitter la Planète rouge.

GÉO-INGÉNIERIE

Géo-ingénierie : quelle place dans les scénarios climatiques du Giec ?

Entretien avec Lou Stührenberg Sociologue de l’innovation, la scientifique décrypte la manière dont les scénarios du Giec intègrent les technologies de géo-ingénierie.

34 42 52

LETTRES D’INFORMATION

Toutes les semaines, l’essentiel de Pour la Science Soyez informé chaque mois des sorties de toutes nos publications

Profitez de nos offres promotionnelles

Et aussi : des newsletters thématisées

Inscrivez-vous ou scannez ce code : www.pourlascience.fr fr

MÉDECINE

Diagnostic : que valent

les nouveaux tests sanguins ?

Bruno Dubois

De nouveaux tests accélèrent le diagnostic de la maladie. lls ne devront pas être généralisés à toute la population.

RECHERCHE CLINIQUE

Cibler les plaques amyloïdes, une stratégie à double tranchant

Liz Seegert

Les avantages des traitements ciblant les plaques amyloïdes de la maladie d’Alzheimer sont controversés.

NEUROPHARMACOLOGIE

Attaquer sur tous les fronts

Esther Landhuis

Les approches thérapeutiques contre la maladie se multiplient.

RECHERCHE CLINIQUE

– Culture –

68 Logique & calcul

Nouveaux records pour la conjecture de Proth-Gilbreath Jean-Paul Delahaye

C’est une vieille énigme au sujet des nombres premiers, qui interroge depuis près de cent cinquante ans. Deux chercheurs viennent, indépendamment, de réaliser de nouveaux progrès.

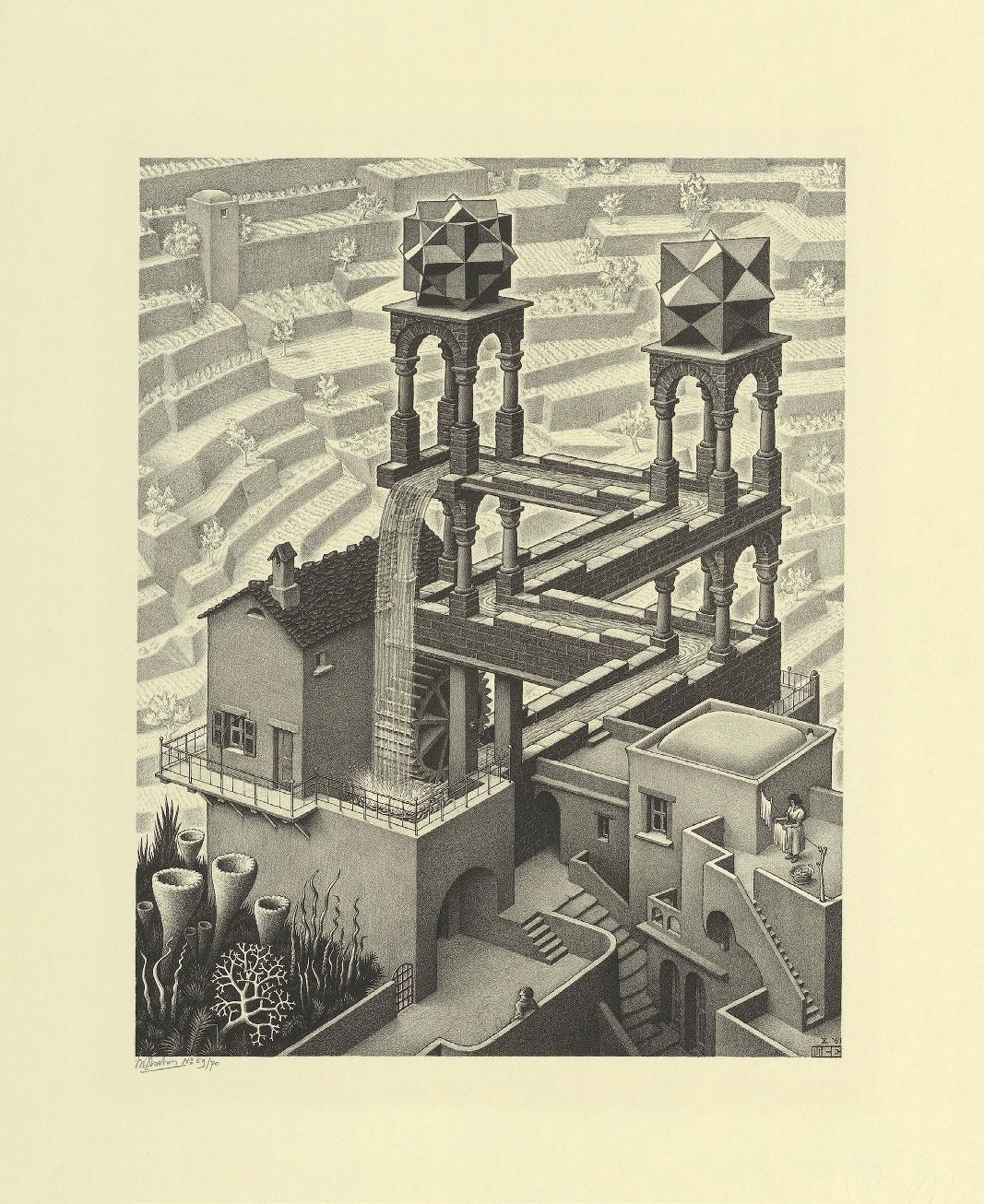

74 Art & Science

L’arpenteur des mondes impossibles Loïc Mangin

78 Livres

80 Chroniques de l’évolution

Les multiples conquêtes du milieu terrestre Hervé Le Guyader

84 Idées de physique

« Un, on pousse, deux, ça mousse, trois, ça lave » Jean-Michel Courty et Édouard Kierlik

88 Science & gastronomie Phosphates et polyphosphates : une grande famille sous surveillance Hervé This

90 L’équation Florian Freistetter 16 18 24 28

« Les avancées sur les anti-amyloïdes ont redynamisé la recherche »

Entretien avec Nicolas Villain

Le neurologue détaille les perspectives qui s’ouvrent après l’approbation de nouveaux traitements.

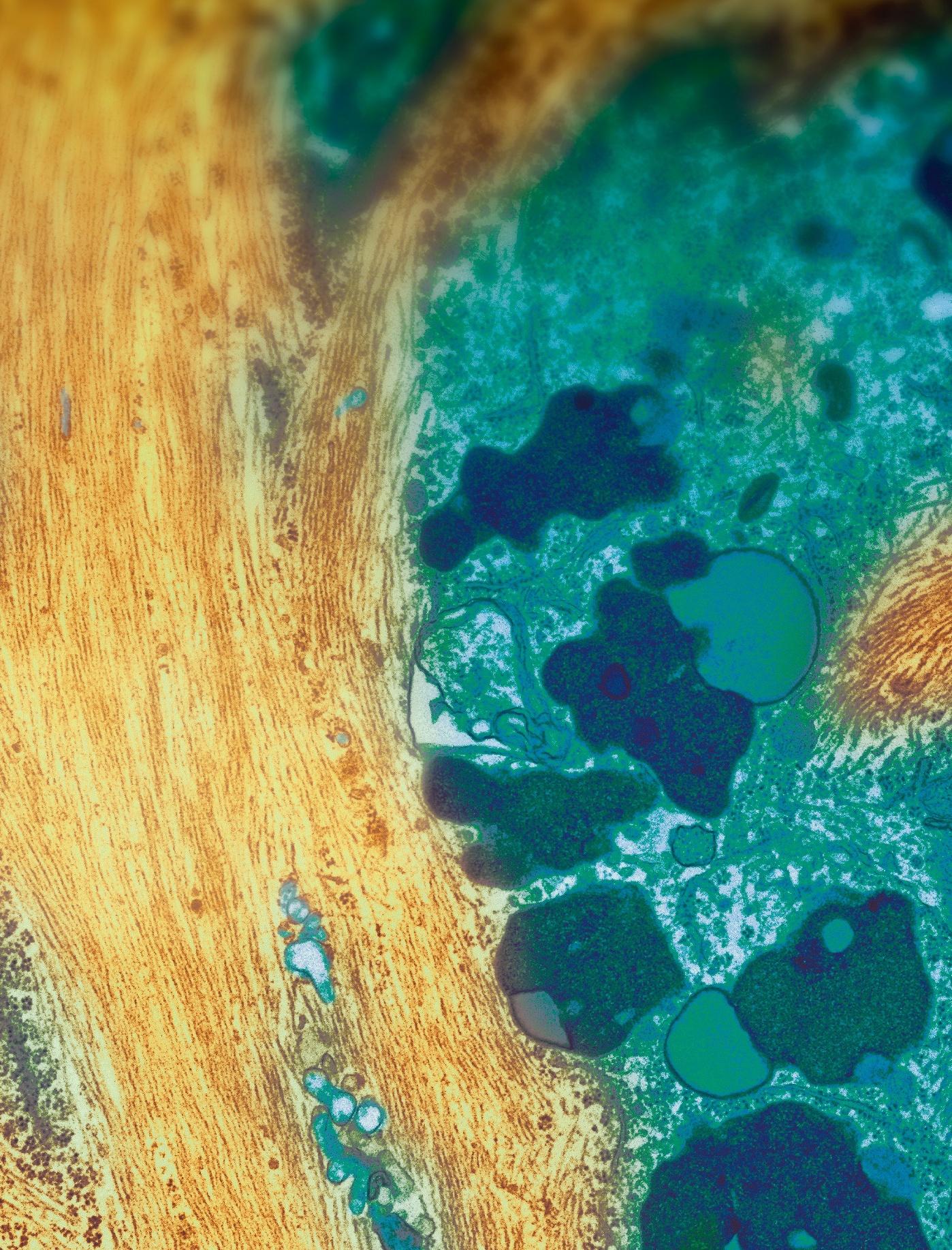

En couverture : © Science Photo Library / Deerinck, Thomas / NCMIR

Ce numéro comporte un courrier de réabonnement posé sur le magazine pour une sélection d’abonnés.

De façon surprenante, une éruption volcanique majeure, survenue vers 1345, aurait entraîné un enchaînement d’événements qui ont créé les conditions idéales à la propagation fulgurante de la peste noire.

Àpartir de 1347, une épidémie effroyable s’abat sur l’Europe. En à peine quatre ans, près de vingt millions de personnes sur le continent meurent de la peste noire. L’histoire de Yersinia pestis, la bactérie responsable de la maladie, est relativement bien connue. En 2022, une équipe avait remonté sa trace jusqu’à sa source géographique, en Asie centrale, dans le massif de Tian Shan, situé à la frontière entre la Chine, le Kirghizistan, le Kazakhstan et l’Ouzbékistan. De là, la maladie est arrivée dans les ports italiens à bord de navires marchands avant de se propager à travers le continent. On estime qu’entre 70 % et 80 % des personnes qui contractaient la maladie succombaient. « La question qui hante les historiens depuis longtemps est de savoir pourquoi cette pandémie a été aussi violente, rapide, avec une diffusion géographique et une mortalité inégalées », commente Isabelle Séguy, chercheuse à l’Ined. Récemment, Martin Bauch, de l’institut Leibniz pour l’histoire et la culture de l’Europe de l’Est, à Leipzig, en Allemagne, et Ulf Büntgen, de l’université de Cambridge, au Royaume Uni, ont apporté un éclairage nouveau à notre compréhension de cet épisode sombre de l’histoire du continent.

Dans les domaines des géosciences et de la climatologie, il est bien connu que certaines éruptions

volcaniques intenses peuvent perturber les conditions météorologiques à l’échelle du globe sur plusieurs saisons. L’émission d’aérosols soufrés dans la haute atmosphère contribue à augmenter la réflexion du rayonnement solaire vers l’espace et induit un refroidissement anormal pendant un temps dans certaines régions de la planète. Ces perturbations se traduisent parfois par des récoltes mauvaises.

L’analyse de carottes de glace en Antarctique et au Groenland permet de découvrir des épisodes d’émission substantielle d’aérosols d’origine volcanique et de les dater. Par exemple, une forte concentration de particules a été détectée en 1257, ce qui correspond à l’éruption du volcan Samalas, dans l’actuelle Indonésie. Or on retrouve aussi une signature similaire vers 1345, mais la source volcanique

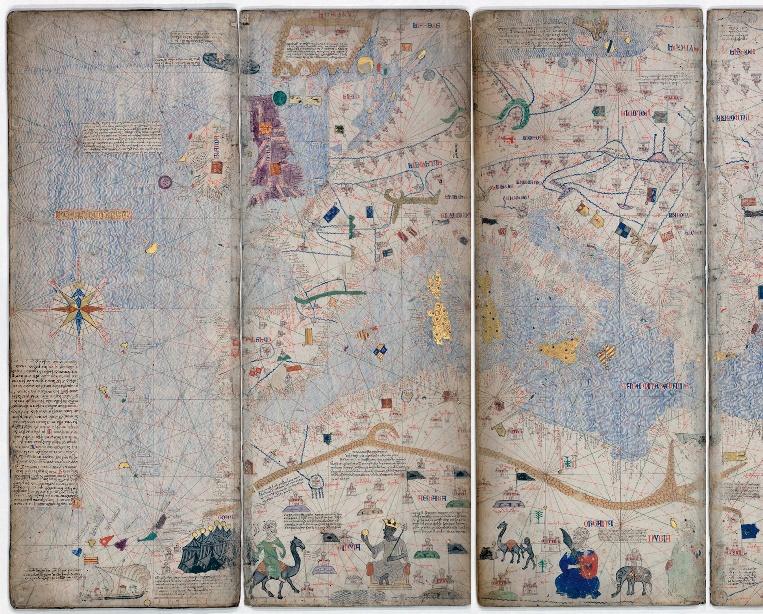

Élaboré en 1375, l’Atlas catalan est un portulan, une sorte de carte indiquant les routes maritimes dans le bassin méditerranéen. On y perçoit l’importance des échanges dans toute la région. Le personnage en vert, en haut du cinquième panneau, n’est autre que Djanibeg, le khan de la Horde d’Or à l’époque de la peste noire.

associée reste à identifier. En outre, des témoignages d’époque rapportent une visibilité atmosphérique réduite, ce qui confirmerait la présence d’aérosols dans l’air.

Martin Bauch et Ulf Büntgen ont suggéré qu’une ou plusieurs éruptions ont précédé l’épidémie de peste noire, dans les années 1345 ou 1346. Des textes de cette période, en France et en Italie, mentionnent des étés exceptionnellement froids et humides. La production agricole a été mauvaise et le continent a connu des vagues de famine simultanément en Espagne, en France, sur une partie de l’Italie, en Égypte et au Levant. Cette synchronicité renforce l’idée d’une cause climatique globale et non d’une mauvaise saison locale. C’est donc une population déjà affaiblie qui voit arriver Yersinia pestis en 1347. Cette situation pourrait expliquer en partie le taux de mortalité élevé.

Les deux chercheurs ont alors analysé la situation en Italie et ont

argumenté que la production céréalière du sud de l’Italie ne suffisait pas pour subvenir aux besoins des régions touchées par la famine. Les archives historiques révèlent que le prix du blé à cette époque était au plus haut et que des mesures ont été prises pour interdire l’exportation de céréales et pour organiser leur importation. Les républiques de Venise et de Gênes ont alors signé un traité pour mettre fin à un conflit avec la Horde d’Or, l’empire mongol de cette époque, de sorte que la levée de l’embargo sur les céréales en provenance de la mer Noire est actée en avril 1347.

Ce contexte météorologique et politique permet d’expliquer pourquoi l’épidémie s’est manifestée d’abord dans des grands ports italiens à la fin de l’année 1347 – la bactérie aurait été véhiculée par des puces se nourrissant de poussière de céréales dans les cales des bateaux – avant de se propager aux régions voisines – Venise autorisant l’export de céréales vers Padoue

en mars 1348. Certaines villes, comme Rome et Milan, n’ont pas été touchées par la première vague de l’épidémie… elles n’avaient pas importé de blé en provenance des côtes de la mer Noire. En revanche, des villes comme Marseille ont été affectées dès décembre 1347, probablement du fait d’échanges avec des navires génois.

Paradoxalement, c’est en cherchant une solution pour la sécurité alimentaire que les cités italiennes ont précipité la deuxième grande épidémie de peste en Europe, la précédente datant du règne de l’empereur romain Justinien, au VIe siècle de notre ère. « Cette épidémie reste gravée dans les mémoires collectives, ravivées pour le grand public par la pandémie de Covid19 », conclut Isabelle Séguy. n Sean Bailly M. Bauch et U. Büntgen, Communications Earth & Environment, 2025.

Planétologie

Grâce à des analyses isotopiques, des chercheurs ont montré que Théia, le corps qui a percuté la Terre pour donner naissance à la Lune, se serait formée plus près du Soleil que notre planète.

Il y a environ 4,5 milliards d’années, l’histoire de notre planète a basculé. Alors que le Système solaire n’avait que quelques dizaines de millions d’années, un objet massif, nommé Théia, a percuté la protoTerre. Et la Lune est née des débris de la collision. Puisque l’impacteur a été détruit lors de la collision, difficile de dire quelle était sa taille, sa composition ou son lieu d’origine. Sur ce dernier point, différentes hypothèses ont été considérées : celle d’un astéroïde provenant de la ceinture située entre l’orbite de Mars et celle de Jupiter, celle d’un objet beaucoup plus lointain formé dans les contrées glacées au delà de l’orbite de Neptune ou celle d’un corps issu d’une région

bien plus proche de la Terre, voire sur une orbite encore plus resserrée autour du Soleil. Pour départager ces hypothèses, Timo Hopp, géochimiste à l’institut MaxPlanck de recherche sur le Système solaire, en Allemagne, et ses collègues ont étudié la composition isotopique en fer de différentes roches terrestres et lunaires ainsi que de météorites tombées sur Terre. Ces données renseignent sur le lieu de formation de ces corps, car la composition varie selon la distance au Soleil. En raison du gradient de température dans le disque protoplanétaire, les éléments les plus volatils et les plus légers (eau, hydrogène…) ne peuvent se condenser qu’à grande distance de l’étoile. Les corps nés loin

Vue d’artiste de la collision entre la Terre et Théia, dont les débris ont donné naissance à la Lune.

du Soleil accumulent ainsi davantage de glaces et de matériaux légers. Ce phénomène a aussi une influence sur les isotopes d’un même élément (qui se distinguent par leur nombre de neutrons) : selon les conditions de température et d’irradiation, certains isotopes sont un peu favorisés par rapport à d’autres lors de la constitution des matériaux. La composition isotopique des objets célestes conserve ainsi la trace de l’environnement dans lequel ils se sont formés.

Signature isotopique

L’équipe autour de Timo Hopp a caractérisé la composition isotopique du fer de quinze roches terrestres, six échantillons lunaires ramenés par les missions Apollo et de chondrites à enstatite, des météorites dont la composition est considérée comme représentative des matériaux constitués dans la région interne du Système solaire, à l’instar de la Terre. En combinant leurs mesures et celles d’autres isotopes, les chercheurs ont comparé les résultats aux prédictions de scénarios théoriques et ont conclu que Théia se serait formée un peu plus près du Soleil que la Terre. n

Évrard-Ouicem Eljaouhari

T. Hopp et al., Science, 2025.

Comment Lucy cohabitait-elle avec une autre espèce d’australopithèque ?

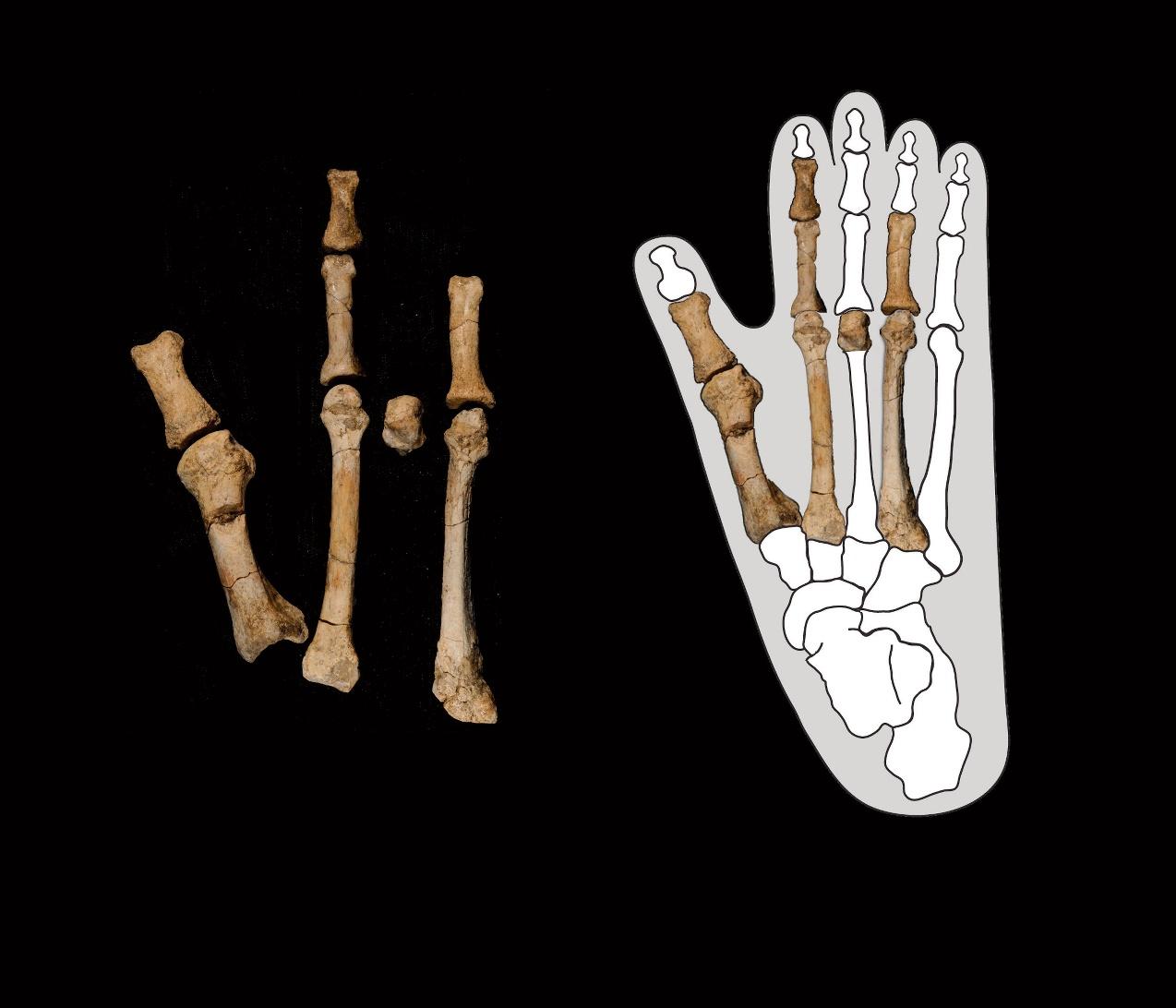

n 2015, la découverte d’une nouvelle espèce fossile étoffait la buissonnante famille des hominines. C’est grâce à deux fragments de mandibule que les paléoanthropologues avaient identifié Australopithecus deyiremeda, qui vivait au milieu du Pliocène, il y a 3,4 millions d’années, dans la région de l’Afar, au nord de l’Éthiopie. Or, à cette époque, une autre espèce du même genre, Australopithecus afarensis, occupait aussi cette région. Si son nom sonne plus familier, c’est parce qu’il s’agit de l’espèce à laquelle appartient le célèbre spécimen surnommé Lucy. Avec l’identification de nouveaux fossiles d’A. deyiremeda , dont des fragments du pelvis, du crâne, de la mandibule et des dents, Yohannes

HaileSelassie, directeur de l’Institut des origines humaines, à l’université de l’Arizona, et ses collègues précisent les conditions de cette cohabitation. Ces restes viennent, en particulier, éclairer la découverte faite en 2009 d’un pied partiel, surnommé « pied de Burtele » (ci-dessus) qui n’avait pas pu à l’époque être associé à une espèce et qui, aujourd’hui, est identifié comme appartenant à A. deyiremeda

D’un point de vue morphologique, les éléments infracrâniens (situés en dessous du crâne) et de la mandibule et les dents d’A. deyiremeda présentent des caractéristiques plus primitives que celles de son « cousin » contemporain A. afarensis. En particulier, le pied de Burtele est doté d’un grand

orteil opposable, idéal pour grimper aux arbres. Cette morphologie diffère donc de celle de l’espèce de Lucy. L’analyse de l’émail des dents indique que les repas d’A. deyiremeda étaient constitués de feuilles et de fruits de divers arbres et arbrisseaux, là où ceux d’A. afarensis comprenaient aussi des graminées, des succulentes, des graines, des racines, des insectes et, parfois, de petits vertébrés. n

William Rowe-Pirra

Y. Haile-Selassie et al., Nature, 2025.

Bruno Dubois

De nouveaux tests accélèrent le diagnostic de la maladie d’Alzheimer. Autorisés par l’agence américaine du médicament, ils pourraient arriver bientôt en France. Mais ils ne devront pas être généralisés à toute la population.

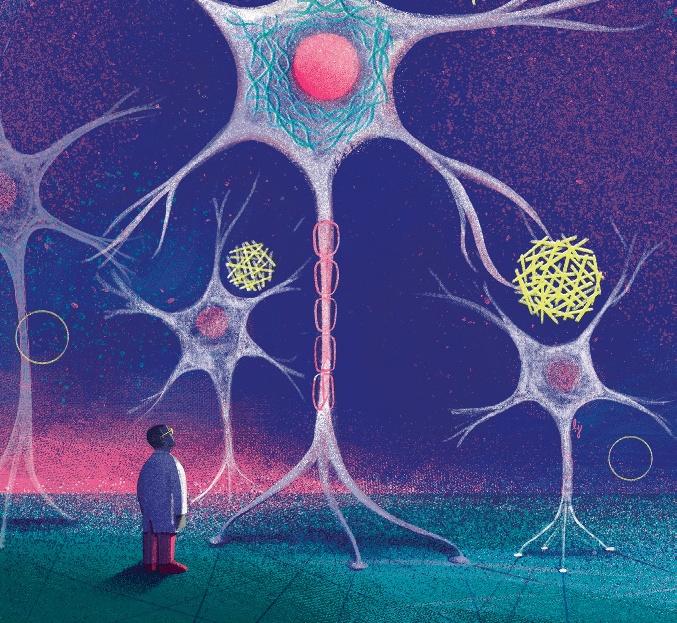

e diagnostic de la maladie d’Alzheimer repose sur deux éléments : un syndrome clinique caractéristique, incluant généralement des troubles de la mémoire, et la présence de lésions spécifiques du cerveau, liées à l’accumulation de protéines tau et amyloïdes anormales. Il est aujourd’hui possible, grâce à des techniques de mesure ultrasensibles, d’isoler ces protéines anormales dans le sang, signe indirect de leur présence dans le cerveau.

Aux États-Unis, l’agence sanitaire, la Food and Drug Administration (FDA), a approuvé au printemps 2025 la commercialisation d’un dosage sanguin, le Lumipulse G pTau217/β-Amyloid, proposé par la société Fujirebio. Le test utilise la technologie d’immunodosage enzymatique chimioluminescent, lors duquel les protéines tau et amyloïdes anormales se fixent sur des anticorps reliés à des particules émettant un signal lumineux, ce qui permet de repérer leur quantité avec précision. Résultat : 91,7 % des personnes testées positivement ont ensuite révélé, en imagerie cérébrale par PET-scan (tomographie

L’essentiel

Des tests sanguins pour diagnostiquer la maladie d’Alzheimer arrivent sur les marchés américain et européen.

Ils dosent dans le plasma sanguin les protéines tau et amyloïdes anormales, deux biomarqueurs de cette pathologie.

Toutefois, la présence de ces protéines anormales dans le sang n’implique pas forcément que l’on va développer la maladie.

D’où l’importance de bien encadrer ce nouveau diagnostic.

par émission de positons), la présence de lésions neuronales. Et, à l’inverse, 97,3 % des patients ayant reçu un résultat négatif au test ne portaient pas de lésions. En octobre 2025, la FDA a par ailleurs autorisé l’utilisation d’un test sanguin similaire, Elecsys pTau181 Plasma, développé par la société Roche. Ce produit a également reçu la certification européenne. L’entreprise rapporte que dans un essai clinique portant sur 312 participants, le test a exclu correctement la maladie dans 97,9 % des cas.

Changement radical pour les patients

Bruno Dubois professeur de neurologie à Sorbonne Université, directeur du Centre des maladies cognitives et comportementales à l’hôpital de la Pitié-Salpêtrière, à Paris, membre de l’Académie nationale de médecine*

* Bruno Dubois n’a aucun lien d’intérêt avec les entreprises citées dans cet article. L’AUTEUR

Pourquoi est-ce une percée majeure ? Jusqu’au début de ce siècle, le repérage des lésions cérébrales n’était possible qu’après le décès des patients, par examen du cerveau. Le diagnostic n’était donc pas formellement établi de leur vivant. Tout a changé en 2004 avec la visualisation des lésions grâce au PET-scan lésionnel. L’injection par voie sanguine d’un ligand radioactif se fixant sur les lésions amyloïdes a permis de révéler leur existence in vivo , confirmant alors le diagnostic. Quelques années après, l’étude de la concentration des protéines tau et amyloïdes a été possible dans le liquide céphalorachidien, prélevé par ponction lombaire. Cet examen est devenu, depuis, la référence pour la confirmation du diagnostic. Nous faisons près de 500 ponctions lombaires par an dans mon service, à la Salpêtrière. Mais ce geste est invasif.

Le dosage plasmatique constitue ici une nouvelle étape, beaucoup plus simple, pour relier les

BIBLIOGRAPHIE

S. Pahlke et al., Blood-based biomarkers for detecting Alzheimer’s disease pathology in cognitively impaired individuals within specialized care settings :

symptômes cliniques à la maladie d’Alzheimer et permettre un repérage plus précoce des patients. Rappelons qu’aujourd’hui la moitié seulement sont diagnostiqués, et souvent de façon tardive, au stade de démence. Or un repérage précoce permet de bénéficier d’interventions multidomaines : correction d’éventuels facteurs de risque, prescription de médicaments symptomatiques ou de disease modifiers, des traitements ciblant les mécanismes biologiques à l’origine de la maladie qui commencent à arriver sur le marché et seront réservés principalement à des patients au début de leur affection.

Bien sûr, ces tests ont leurs limites. Un dosage positif suggère la présence de lésions amyloïdes ou tau dans le cerveau des patients, mais n’est pas une preuve de maladie d’Alzheimer ! Car les lésions précèdent la survenue des symptômes de plusieurs années… Et malgré la présence de ces protéines anormales dans le sang, certains individus ne développeront peut-être jamais la maladie. Nous avons ainsi montré, dans notre service, que seuls 20 % des sujets âgés cognitivement normaux mais avec des biomarqueurs positifs ont développé la maladie après sept ans de suivi.

Il faut donc insister sur la grande prudence avec laquelle cet examen devra être effectué dans l’avenir et ne le réserver qu’à des sujets avec des troubles de la mémoire objectivés par les tests cognitifs. S’il est autorisé en France, il doit être proposé uniquement à des patients présentant déjà un déclin cognitif confirmé par des tests, et être utilisé en conjonction avec d’autres informations cliniques. Cela écartera le risque de conclure à tort à une maladie d’Alzheimer en cas d’une plainte de mémoire banale liée à l’âge. Il ne pourrait être question de proposer ce test chez tout sujet, après 70 ans par exemple, dans l’incapacité où nous sommes de connaître le risque réel de développer un jour la maladie, ou de proposer un traitement préventif, tout au moins aujourd’hui, en cas de positivité. Au-delà de ces réserves, il faut tout de même, bien entendu, insister sur la révolution scientifique que représente l’aventure des biomarqueurs et dont le test plasmatique est le dernier avatar. n

A systematic review and metaanalysis, Alzheimer’s Dement., 2025. G. B. Frisoni et al., New landscape of the diagnosis of Alzheimer’s disease, The Lancet, 2025.

Liz Seegert

Les plaques amyloïdes de la maladie d’Alzheimer, présentes précocement dans le cerveau des patients qui en sont atteints, sont la cible d’une nouvelle classe de médicaments. Une cible attrayante, mais aux avantages discutables et controversés.

jusqu’à il y a encore une dizaine d’années, à l’annonce du diagnostic de la maladie d’Alzheimer, les médecins n’avaient aucune option thérapeutique disponible à proposer contre la perspective d’une démence progressive. Depuis, une famille de médicaments a vu le jour, qui permettraient peut-être de ralentir l’avancée de la pathologie. Un bel espoir, mais qui se paie cher : ces médicaments à l’efficacité encore discutée provoquent de sérieux effets secondaires parmi lesquels des hémorragies cérébrales susceptibles parfois d’entraîner la mort.

Cette nouvelle classe de médicaments, appelés « thérapies anti-amyloïdes », cible les plaques de peptides β-amyloïdes agrégés, retrouvées très précocement dans le cerveau des patients atteints. Ces amas pathologiques, qui se nichent entre les neurones, sont considérés comme une caractéristique spécifique de la pathologie et possiblement l’une des causes principales de la mort neuronale. Pourtant, bien que quelques études aient montré que ces médicaments réduisent efficacement l’accumulation des plaques amyloïdes, l’effet sur le déclin cognitif serait marginal, comme le montrent collectivement une quarantaine d’études menées depuis 2018. Selon quelques experts, les thérapies anti-amyloïdes auraient le potentiel d’offrir aux

L’essentiel

Les thérapies antiamyloïdes offrent un espoir limité contre Alzheimer : ces médicaments, qui ciblent les plaques de peptides β-amyloïdes, réduisent leur accumulation, mais n’ont qu’un effet modeste sur le déclin cognitif.

Leur usage est réservé aux patients au stade précoce, avec une efficacité incertaine sur le long terme, et comporte des risques d’effets secondaires graves. Les coûts annuels des traitements, incluant suivi et examens, dépassent les 30 000 euros.

Les neurologues restent divisés entre prudence et adoption croissante, dans un contexte d’acceptation grandissante par les patients.

patients un temps supplémentaire d’autonomie de l’ordre d’une année. Cette observation est cependant à considérer prudemment, dans la mesure où les essais cliniques ne s’appuient encore que sur dixhuit mois de données publiées.

Une année gagnée

Mais si le bénéfice réel de ces thérapies est discutable, les inconvénients sont, eux, très concrets, et leur utilisation est encore fortement controversée. En effet, lors des essais cliniques, pas moins de 40 % des participants ont souffert de gonflements du cerveau, et 28 % d’hémorragies cérébrales. Des troubles connus sous le nom d’« anomalies d’imagerie liées à l’amyloïde » (Aria), et susceptibles d’entraîner un certain nombre de handicaps, voire de provoquer la mort. Devant la gravité de ces effets secondaires, de nombreux chercheurs et cliniciens se sont montrés sceptiques lorsque les médicaments ont été introduits sur le marché. C’était notamment le cas d’Anelyssa D’Abreu, qui dirige le département de neurologie cognitive et comportementale de l’université de Virginie et qui était initialement réticente à l’idée de proposer les thérapies anti-amyloïdes à ses patients. Cependant, après avoir longuement réfléchi, la neurologue a considéré qu’il était important de leur proposer l’option. Selon elle, lorsque les personnes sont encore autonomes, retarder la progression vers une démence totale fait toute la différence. Et aujourd’hui, parmi les quelque cinquante patients traités par thérapie anti-amyloïdes dans son service, aucun n’a encore expérimenté de sévères effets secondaires.

En France, en 2025, 1,4 million d’individus sont atteints par la maladie d’Alzheimer, soit presque 10 % des personnes âgées de plus de 65 ans. Un chiffre qui sera presque multiplié par 2 en 2050, d’après France Alzheimer. Les États-Unis ne sont pas épargnés,

Les approches thérapeutiques contre la maladie d’Alzheimer se multiplient à mesure que se précise la compréhension de cette pathologie.

lEsther Landhuis

a maladie d’Alzheimer est un adversaire coriace. Pendant plusieurs décennies, chercheurs et entreprises pharmaceutiques se sont efforcés de trouver un traitement capable d’endiguer le déclin cognitif qui lui est associé, sans succès. Mais ce combat a pris un tournant significatif ces dernières années avec la mise sur le marché américain des premières thérapies ciblant les plaques amyloïdes. En effet, cette autorisation marque la volonté de s’attaquer aux causes primaires de la maladie et non plus seulement à ses symptômes. Cette nouvelle stratégie exige cependant d’identifier les premières altérations qui, initialement invisibles, en entraînent d’autres en cascade, jusqu’à provoquer la dégénérescence neuronale et le déclin cognitif. Une question qui déchaîne les débats au sein de la communauté scientifique.

Dans cette quête, deux cibles candidates ont d’abord retenu l’attention : les plaques de protéines β -amyloïdes et les enchevêtrements neurofibrillaires de la protéine tau. Ces agrégats s’accumulent respectivement entre et au sein des neurones bien avant les premiers symptômes. Du fait de leur apparition précoce, ils ont longtemps été considérés comme l’une des causes principales de la maladie et ciblés avec acharnement par la recherche. Et, de fait, les nouveaux traitements (lecanemab et donanemab) se lient aux protéines β-amyloïdes et réduisent l’accumulation d’agrégats, avec un effet modéré sur le déclin cognitif.

Mais le processus qui mène des premiers dysfonctionnements de l’organisme à la démence reste encore flou, d’autant que des protéines β-amyloïdes et tau s’accumulent aussi dans d’autres types de neurodégénérescence. Dans le cas de la maladie d’Alzheimer, on observe en général un délai de

vingt à trente ans entre la première détection de plaques amyloïdes et un déclin cognitif patent. De plus, une étude qui cherchait à établir le risque de développer la maladie à partir du « statut amyloïde » des patients a mis en évidence que moins d’un quart des femmes de 75 ans sans altérations cognitives chez qui on détecte des plaques amyloïdes dans le liquide céphalorachidien ou par imagerie cérébrale développeront la maladie. Ces résultats suggèrent que l’accumulation de plaques ne suffit pas à induire la progression de cette pathologie. La communauté scientifique s’est donc lancée à la recherche de nouvelles cibles thérapeutiques.

En analysant les séquences d’ADN des patients, des chercheurs ont identifié des variants de gènes associés au risque de développer la maladie. L’implication de certains de ces gènes souligne que l’activité immunitaire et l’inflammation jouent ici un rôle crucial. D’autres recherches suggèrent que certains changements du style de vie réduiraient ces risques. Selon un rapport paru en 2024, on éviterait ou retarderait près de la moitié des cas de démence dans le monde en prenant des mesures pour cibler quatorze facteurs de risque modulables, dont la perte auditive et le manque d’activité physique, ou encore le diabète, le tabagisme et d’autres facteurs de risque vasculaires – dont beaucoup ont aussi un impact sur l’activité immunitaire et l’inflammation. n

L’AUTRICE

Esther Landhuis journaliste scientifique basée dans la baie de San Francisco et docteure en immunologie

Ce texte est une adaptation de l’article « A multipronged assault », publié par Scientific American en octobre 2025 dans le cadre d’un dossier financé par Eisai Inc. et produit indépendamment par Scientific American.

Enchevêtrements neurofibrillaires de tau

La maladie d’Alzheimer est caractérisée par l’agrégation de protéines tau hyperphosphorylées au sein des neurones a et de peptides β-amyloïdes entre les neurones b Au cours du temps, ces protéines forment respectivement des enchevêtrements neurofibrillaires et des plaques qui entraînent des altérations neuronales c et la mort des cellules. Mais la plupart des patients accumulent aussi d’autres protéines comme l’α-synucléine ainsi que des altérations des vaisseaux sanguins, qui précèdent parfois l’apparition des plaques amyloïdes. Des études récentes suggèrent également que l’inflammation, les réactions immunitaires et les facteurs de risque vasculaire joueraient un rôle essentiel dans la maladie.

SECTIONS TRANSVERSALES DU CERVEAU

Sain Dégénérescence précoce Dégénérescence tardive

Plus de cent essais cliniques sont en cours sur des molécules thérapeutiques variées, dont chacune cible un ou plusieurs contributeurs potentiels à la pathologie. « Nous y arriverons étape par étape », explique la neurologue Sudha Seshadri, fondatrice et directrice de l’institut Glenn-Biggs pour la maladie d’Alzheimer et les maladies neurodégénératives, au Texas. « Les traitements anti-amyloïdes sont une pièce du puzzle, les médicaments immunomodulateurs en seront probablement une autre », affirme-t-elle. Il sera aussi important de contrôler le risque vasculaire, qui est « essentiel, indépendamment du reste ».

Les mécanismes ci-dessous sont considérés comme des éléments clés dans le développement de la maladie d’Alzheimer.

Les récepteurs des neurotransmetteurs

Ces protéines ancrées à la surface des neurones reçoivent des signaux issus d’autres cellules et jouent un rôle essentiel dans l’apprentissage et la mémoire. Des traitements bloquent leur activité lorsqu’elle est délétère, d’autres renforcent leur action en empêchant la dégradation des neurotransmetteurs.

Peptide β-amyloïde

Lorsqu’elle est mal repliée, cette protéine s’agrège et forme des plaques entre les neurones. Plusieurs traitements approuvés aux États-Unis visent à empêcher leur formation.

Neuro-inflammation

L’accumulation de formes anormales de protéines β-amyloïdes et tau est susceptible de l’activer. Elle entraîne des altérations neuronales irrémédiables et un déclin cognitif. Deux axes stratégiques sont explorés : stimuler l’immunité contre les agrégats et limiter l’inflammation.

Tau

Cette protéine stabilise la structure interne des cellules. Hyperphosphorylée dans la maladie d’Alzheimer, elle s’agrège au sein des neurones. Plusieurs essais cliniques en cours ciblent ses formes pathologiques pour détruire ces agrégats et empêcher leur formation.

Plasticité synaptique

La capacité du cerveau de modifier ses connexions lors de l’apprentissage et de la mémorisation est altérée dans la maladie d’Alzheimer.

malade

Microglie c

Enchevêtrements neurofibrillaires de tau Plaque amyloïde

Métabolisme des glucides

C’est l’ensemble des processus par lesquels le corps convertit les nutriments en énergie. Chez les patients atteints de la maladie, il est anormalement faible dans des structures cérébrales importantes pour la mémoire et la cognition. Des essais cliniques sont en cours pour le stimuler.

Système vasculaire

Au niveau du système nerveux central, les vaisseaux sanguins forment une interface dynamique, la barrière hématoencéphalique, qui permet l’acheminement des nutriments vers les neurones tout en protégeant le cerveau contre les agents pathogènes. Sa dégradation est associée à de nombreuses maladies neurodégénératives, dont la maladie d’Alzheimer. Deux voies sont en cours d’exploration : renforcer la barrière pour limiter la neuro-inflammation et la perméabiliser de manière contrôlée pour laisser passer les molécules thérapeutiques.

Facteurs de croissance et hormones

Ces molécules protègent les neurones des altérations et stimulent la formation de nouvelles cellules. Une stratégie consiste à en fournir davantage au cerveau pour améliorer sa protection.

Régulateurs épigénétiques

Ces protéines et autres molécules modulent l’expression des gènes sans modifier leur séquence. Ce faisant, elles influent sur l’accumulation de protéines ß-amyloïdes et tau anormales, ou d’autres molécules pathologiques.

Neurogenèse

Chez l’humain, ce processus de formation des neurones a lieu essentiellement au cours du développement. Le stimuler est une piste pour contrer la perte neuronale due à la neurodégénérescence et restaurer les altérations cognitives.

Le stress oxydant

La surabondance d’espèces réactives de l’oxygène par rapport aux molécules antioxydantes capables de les éliminer altère le fonctionnement des neurones en entraînant l’oxydation de leurs composants. Des essais cliniques en cours visent à renforcer l’activité d’enzymes qui neutralisent les espèces réactives de l’oxygène.

L’homéostasie des protéines

Ce processus contrôle la synthèse, le repliement et la dégradation des protéines dans les cellules. Il s’altère dans la maladie d’Alzheimer. Des thérapies sont explorées pour stimuler des processus cellulaires qui empêchent la production de protéines mal repliées et facilitent leur dégradation.

APOE

Ce gène, qui code l’apolipoprotéine E, existe sous trois formes (ε2, ε3 et ε4). Le variant ε4 est l’un des plus importants facteurs de risque génétique de développer la maladie. Un seul exemplaire de ce variant multiplie ce risque par 4 – et deux exemplaires, par 25 – par rapport aux gens avec deux exemplaires du variant le plus courant, ε3. Ces derniers ont un risque 40 % plus élevé de développer la maladie que ceux qui portent un allèle ε3 et un allèle ε2.

« Les

Les traitements anti-amyloïdes récemment approuvés aux États-Unis, bien que très imparfaits, ont relancé les investigations de l’industrie pharmaceutique. Le neurologue Nicolas Villain, spécialiste de la maladie d’Alzheimer, détaille les perspectives qui s’ouvrent, entre meilleure définition de la maladie, nouvelles cibles et apports attendus des thérapies géniques.

NICOLAS VILLAIN

est neurologue clinicien à l’Institut de la mémoire et de la maladie d’Alzheimer (IM2A) à l’hôpital de la Pitié-Salpêtrière, à Paris. Il est aussi chercheur à l’Institut du cerveau (ICM), sur le même site.

Vous travaillez sur la maladie d’Alzheimer. Qu’est-ce qui fait sa spécificité par rapport à d’autres maladies neurodégénératives ?

La maladie d’Alzheimer se distingue d’abord par le fait qu’elle atteint précocement les réseaux cérébraux impliqués dans la mémoire épisodique et d’autres fonctions cognitives, ce qui se traduit, au début, par un tableau clinique typiquement centré sur la perte de la mémoire. Elle se caractérise ensuite par une signature neuropathologique très spécifique, avec l’agrégation de la protéine tau à l’intérieur des neurones et de la protéine β-amyloïde entre les neurones, sous forme d’amas qui constituent les lésions cardinales de la maladie.

Des troubles amnésiques, ou des agrégats de protéines tau ou amyloïdes, sont présents dans d’autres maladies neurodégénératives, comme les démences frontotemporales, dans lesquelles on retrouve notamment des agrégats de protéines tau. Peut-on considérer ces autres pathologies comme des maladies dérivées de la maladie d’Alzheimer ?

Par définition, sans dépôts de protéines β-amyloïdes et de protéines tau en quantité suffisante, on ne parle pas de « maladie d’Alzheimer ». En revanche, on a appris au cours des quinze dernières années qu’il existe des maladies neurodégénératives qui miment cliniquement et anatomiquement cette pathologie, en touchant les mêmes régions cérébrales, tout en étant liées à d’autres types d’agrégats protéiques. Par ailleurs, l’« Alzheimer pur » est probablement minoritaire : à l’autopsie, on retrouve presque toujours, en plus des lésions amyloïdes et tau prédominantes, des dépôts plus discrets d’autres protéines comme l’α-synucléine ou la TDP-43, typiques d’autres maladies dégénératives ; on parle alors de « copathologies ».

Est-ce que la mise en évidence de ces maladies qui se rapprochent de la maladie d’Alzheimer, sans en relever strictement, remet en question la définition de la maladie d’Alzheimer ?

Effectivement, cette accumulation de données remet en cause nos catégories traditionnelles, et un mouvement fort pousse aujourd’hui à redéfinir les maladies neurodégénératives sur une base

strictement biologique. Certaines grandes associations de patients, notamment aux États-Unis, défendent l’idée que la maladie d’Alzheimer devrait être définie avant tout par la présence de plaques amyloïdes et de lésions tau, quels que soient les symptômes et les régions touchées ; de la même façon, la maladie de Parkinson serait redéfinie comme une « synucléinopathie intraneuronale ». Cette approche a l’avantage de simplifier le diagnostic et de rendre plus lisible le développement de thérapies ciblant une protéine donnée, puisqu’on identifie un coupable principal. Toutefois, elle risque de gommer la complexité des mécanismes en jeu : même lorsqu’on élimine les plaques amyloïdes, les patients continuent de décliner, ce qui montre qu’on ne peut pas réduire la maladie à une seule lésion. Un autre écueil de cette redéfinition tient au fait qu’il existe de nombreux, voire probablement une majorité de « porteurs sains » de ces agrégats, notamment ceux qui sont typiques des maladies d’Alzheimer et de Parkinson : des personnes qui ont des dépôts typiques au cerveau mais qui ne développeront jamais de symptômes. Si on focalise la définition de ces maladies sur les agrégats, cela l’élargit à l’ensemble de ces porteurs asymptomatiques, ce qui risque de banaliser le diagnostic et de diluer la gravité qu’il recouvre.

Des thérapies dites « anti-amyloïdes » viennent d’être refusées en France contre la maladie d’Alzheimer, quelles sont les cibles de ces thérapies ?

Le lecanemab, l’un des anticorps anti-amyloïdes récemment évalués, cible et détruit préférentiellement les formes oligomériques de β -amyloïde, c’est-à-dire des assemblages intermédiaires entre la forme soluble physiologique, et les plaques très agrégées. Les données expérimentales suggèrent d’ailleurs que ce sont surtout ces oligomères qui sont neurotoxiques, alors que les formes les plus agrégées, les plaques en elles-mêmes, sont probablement beaucoup moins délétères.

Quel est le rôle physiologique de la ��-amyloïde ?

Nous savons qu’il s’agit d’un peptide produit par plusieurs types cellulaires du cerveau – neurones,

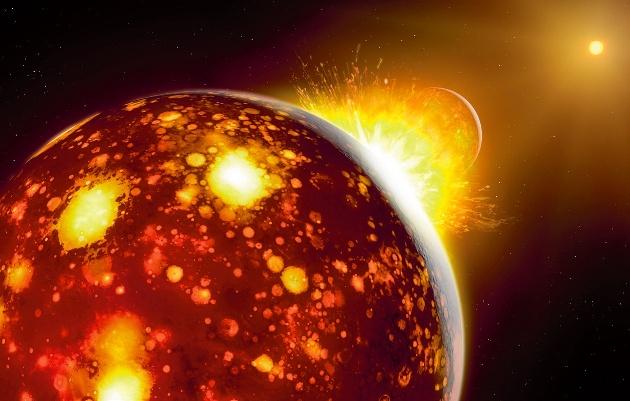

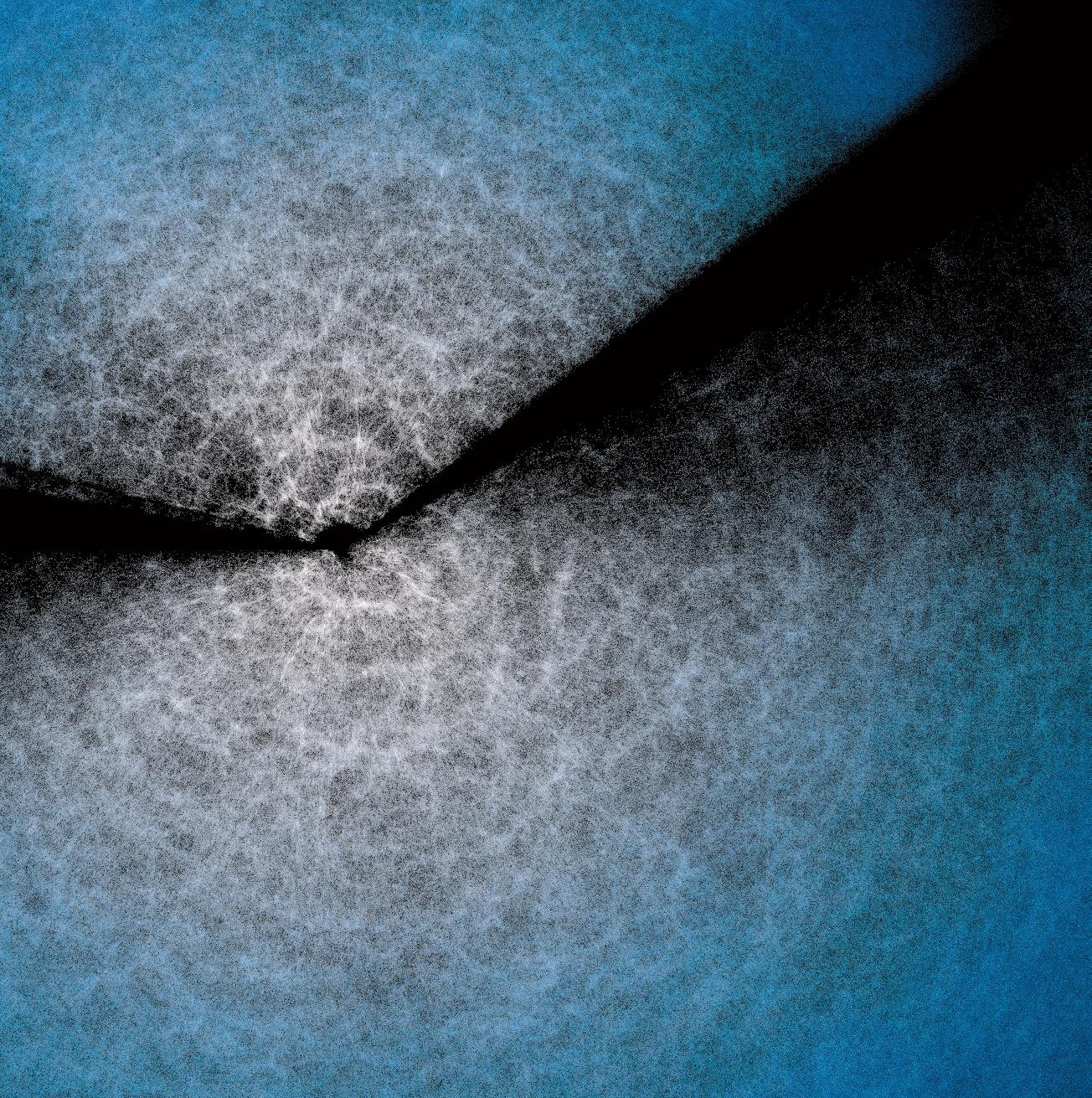

Nathalie Palanque-Delabrouille

L’énergie noire est probablement l’une des plus grandes énigmes de la cosmologie, si ce n’est de la physique tout entière. Quelle est la nature de cette composante de l’Univers ? Le projet « Desi » s’attaque à cette question et ses récents résultats sont inattendus.

dès le début des années 1920, l’idée que l’Univers puisse évoluer apparaît peu à peu. Le chanoine belge Georges Lemaître développe un modèle selon lequel le cosmos serait en expansion à partir d’un « atome primitif ». De son côté, le théoricien russe Alexander Friedmann démontre que les équations de la relativité générale (une théorie formulée quelques années plus tôt par Albert Einstein et qui décrit la relation entre la matière et la courbure de l’espace-temps) admettent des solutions d’univers non statique. Ainsi, en 1929, quand l’astronome américain Edwin Hubble met en évidence que toutes les galaxies qu’il observe semblent s’éloigner de nous, ces résultats s’imposent aussitôt comme la première preuve éclatante de l’expansion de l’Univers. Hubble constate par ailleurs que la vitesse de récession des galaxies, c’est-à-dire celle à laquelle elles s’éloignent de nous, est d’autant plus importante que les galaxies sont lointaines, selon une relation aujourd’hui connue comme la loi de Hubble (et parfois nommée « loi

de Hubble-Lemaître ») : v = Hd, où le coefficient de proportionnalité entre la vitesse v et distance d est noté H, en hommage à Hubble.

Une fois admis que l’Univers est en expansion, il paraît naturel de s’interroger sur la manière dont cette expansion a évolué au cours de son histoire. Dès les premiers cours de science physique, on nous enseigne que la gravité est une force attractive sur toute forme de matière, quelle qu’elle soit, et même sur le rayonnement électromagnétique : la lumière qui nous parvient de galaxies éloignées est déviée par la présence d’objets massifs, tels d’autres galaxies ou amas de galaxies, près de la ligne de visée, conduisant parfois à de spectaculaires arcs gravitationnels. Cette attraction universelle de la gravité nous mène à penser que la matière présente dans l’Univers devrait ralentir l’expansion cosmique, tout comme le champ gravitationnel de la Terre ralentit les objets qui tentent de s’en éloigner. Reste à tester cette hypothèse, ce que de spectaculaires explosions stellaires, des supernovæ, vont rendre possible.

L’essentiel

L’Univers est en expansion accélérée. En cause, une énigmatique énergie noire qui agirait comme une force répulsive.

Sa nature est inconnue, mais jusqu’à présent postuler l’existence d’une constante cosmologique rendait bien compte des observations.

Grâce au programme

Desi, les scientifiques ont construit une carte tridimensionnelle où ils peuvent étudier l’histoire de l’expansion de l’Univers.

Les résultats récents montrent que la dynamique de l’énergie noire ne serait pas celle d’une constante cosmologique. Elle aurait changé au cours du temps.

Aperçu de la carte tridimensionnelle conçue avec les trois premières années de données de Desi. La Terre se trouve au centre et plus les points sont bleus, plus les objets sont lointains. La carte est coupée en deux parties, car il n’est pas possible de voir les galaxies qui se trouvent dans le plan de la Voie lactée.

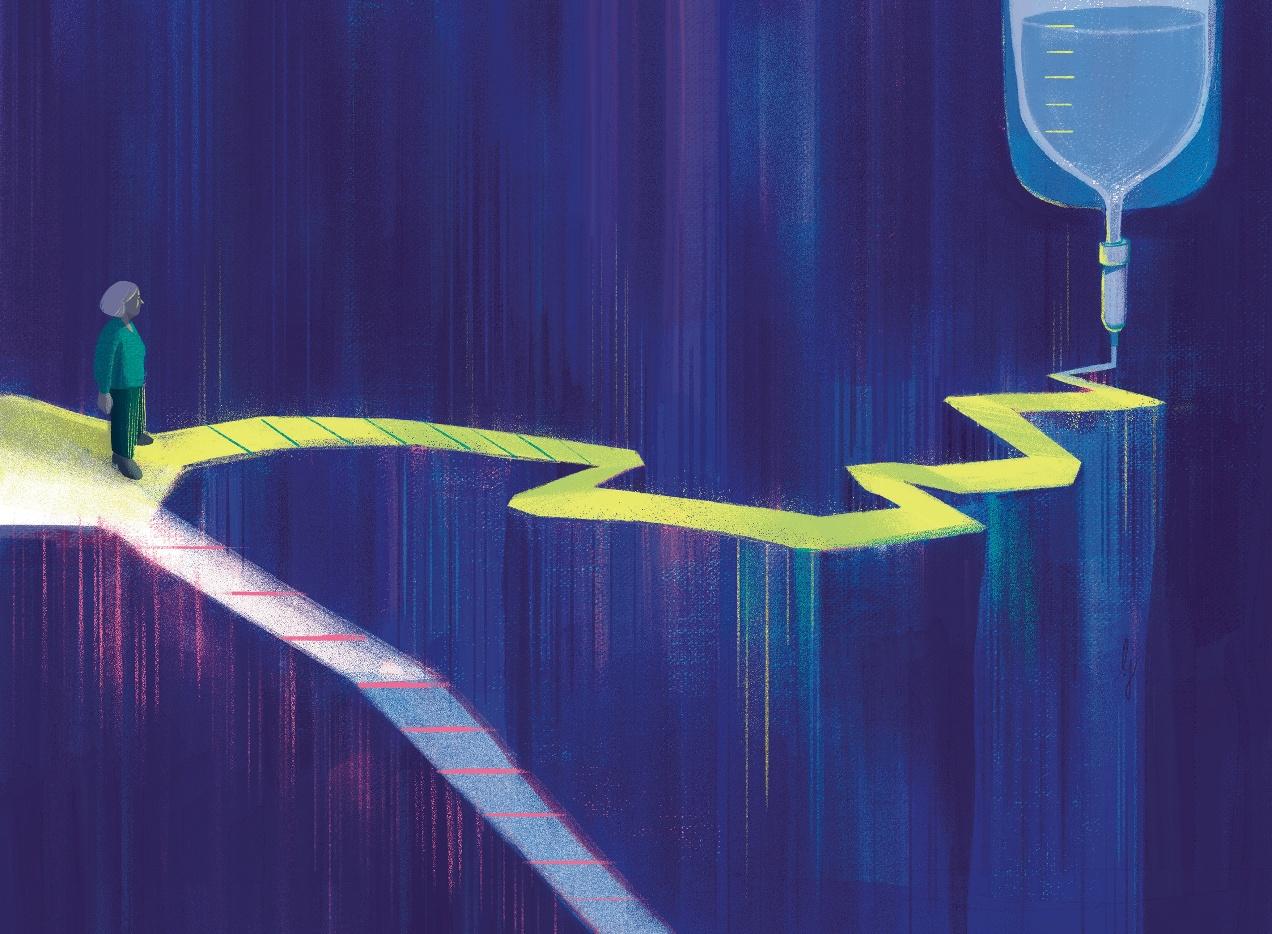

Jonathan O’Callaghan

La Nasa a dépensé des milliards de dollars pour collecter des échantillons martiens afin de les rapporter sur Terre. Ils risquent fort de ne jamais quitter la Planète rouge.

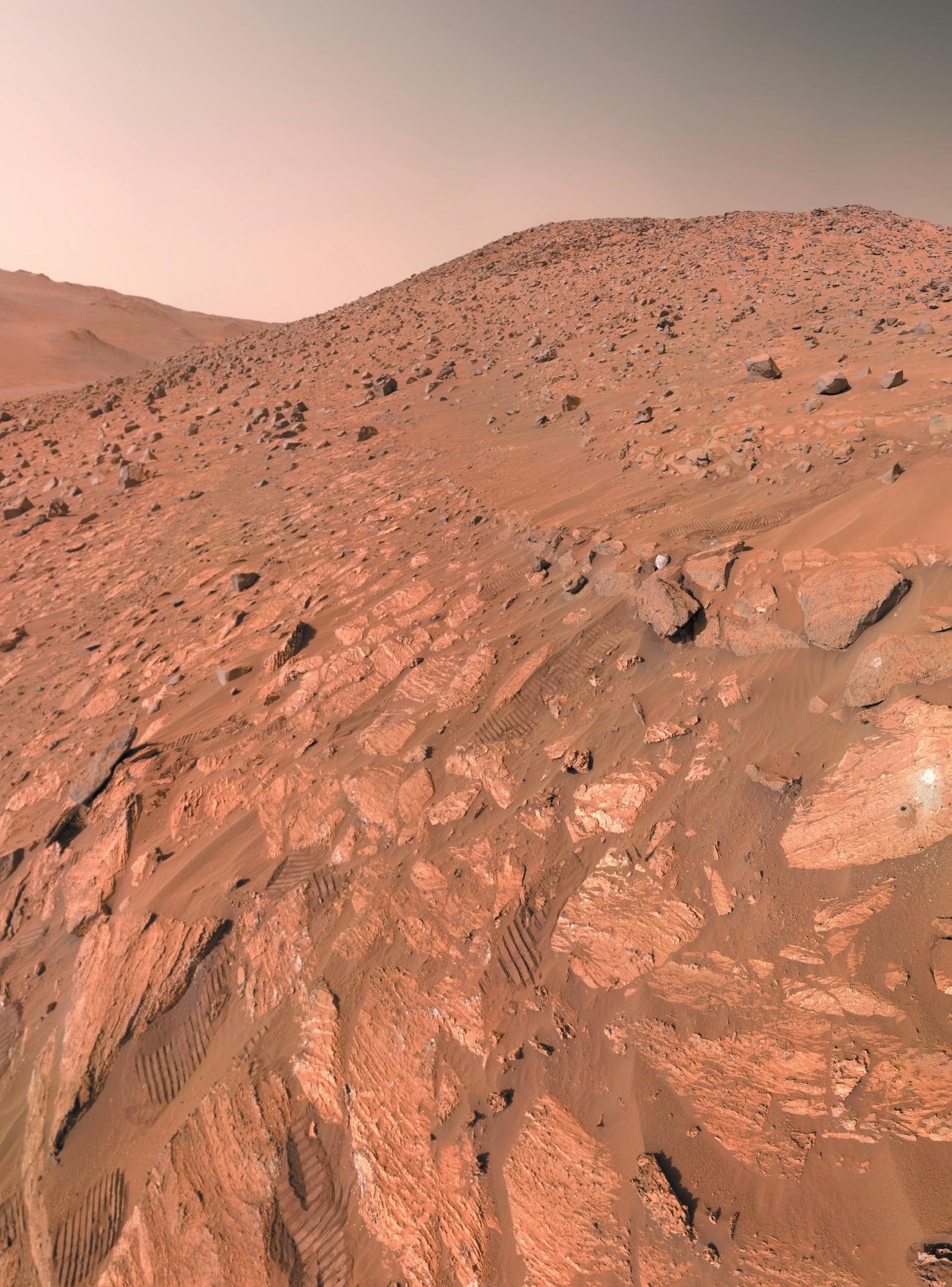

alors que vous lisez ces lignes, l’un des explorateurs planétaires automatisés les plus avancés jamais construits arpente la surface de Mars. Soutenu par une équipe de centaines de scientifiques sur Terre, le rover Perseverance a déjà parcouru une distance équivalente à celle d’un marathon pour répondre à certaines des plus grandes questions concernant notre proche voisine : à quoi ressemblait la planète il y a des milliards d’années ? A-t-elle jamais été habitable ? A-t-elle abrité la vie ?

Le rover Perseverance a collecté des échantillons martiens potentiellement porteurs de traces de vie ancienne. Ces fragments, pour livrer leurs secrets, attendent leur transfert vers la Terre.

La mission Mars Sample Return, censée les rapporter, est menacée par des dépassements budgétaires, des retards et des décisions politiques incertaines.

Des initiatives privées promeuvent des solutions moins coûteuses avec un retour possible dès 2031, alors que la Chine prévoit sa propre mission martienne.

L’un des sites rocheux visités par Perseverance, nommé Cheyava Falls, est parsemé de minéraux riches en fer dont les caractéristiques ont ravivé l’espoir des scientifiques, en septembre 2025, de trouver enfin des réponses à ces questions. Sur Terre, la présence de ces minéraux signifie généralement que des microbes dont le métabolisme mobilisait du fer y ont autrefois vécu. Est-ce également le cas sur Mars ? Un échantillon de Cheyava Falls est conservé en toute sécurité dans le compartiment de stockage du rover. Si on parvient à l’expédier jusqu’à un laboratoire terrestre, on pourra conduire une analyse

approfondie, apportant des éléments de réponse inédits.

Mais le projet de voyage de Cheyava Falls vers notre planète semble s’être perdu dans les limbes. Le rover Perseverance figure la première phase d’une mission en plusieurs étapes, visant à ramener des échantillons de Mars sur Terre, désignée sous le nom de Mars Sample Return (MSR). La prochaine étape ne tient cependant qu’à un fil, depuis que l’administration Trump a proposé d’annuler la partie « retour » du programme. Au moment de la mis sous presse de cet article, le Congrès américain a voté en faveur de cette annulation . Cette situation consterne les scientifiques, qui rêvaient depuis longtemps de mettre la main sur des roches martiennes. « Nous travaillons depuis des décennies pour que cela se réalise », explique Vicky Hamilton, planétologue à la branche du Colorado du Southwest Research Institute. Alors que Perseverance est parvenu à prélever les échantillons tant convoités, les scientifiques sont confrontés à la perspective de les abandonner sur Mars. « C’est un crève-cœur », lâche la chercheuse.

Perseverance a collecté des dizaines d’échantillons de roche au cours de son exploration. Issues de douze sites, les carottes prélevées ont été stockées à son bord, dans des tubes de collecte.

Géo-ingénierie

L’Académie des sciences a récemment publié un rapport sur la géo-ingénierie. Vraie promesse ou illusion technophile ?

Lou Stührenberg, qui étudie les scénarios d’atténuation du changement climatique, nous explique comment cette option est considérée par les spécialistes du Giec et à quel point elle est intégrée dans les modèles.

LOU STÜHRENBERG

est doctorante au centre de sociologie de l’innovation et au centre de mathématiques appliquées (Mines Paris – PSL – CNRS), ainsi que jeune déléguée pour le climat auprès du ministère de la Transition écologique. Elle étudie la façon dont les scénarios d’atténuation du changement climatique sont élaborés.

Qu’entend-on exactement par « géo-ingénierie » ?

Ce terme regroupe toutes les techniques visant à modifier le climat de façon intentionnelle. Il faut donc à la fois que l’intervention soit à grande échelle et que l’effet sur le climat soit l’objectif premier, pas seulement un effet secondaire.

On distingue en général deux catégories de techniques. La première vise à éliminer le dioxyde de carbone (CO2) de l’atmosphère – on parle de carbon dioxide removal (CDR) ou d’« émissions négatives » – et à le stocker dans les couches géologiques profondes. Elle comprend elle-même deux sous-catégories principales. Les technologies dites BECCS (bioenergy with carbon capture and storage) effectuent cette capture par la plantation de biomasse (des arbres ou des plantes à croissance rapide comme l’eucalyptus), qui est ensuite brûlée pour produire de l’énergie, tandis que le CO2 qui en résulte est capté en sortie de cheminée. Les technologies DACS (direct air capture and storage) capturent le CO2 directement dans l’atmosphère, en aspirant l’air grâce à des sortes de ventilateurs géants.

La seconde catégorie de la géo-ingénierie cherche à agir sur le rayonnement solaire, pour en renvoyer une partie plus importante dans l’espace et limiter la fraction piégée par les gaz à effet de serre. On parle de solar radiation modification (SRM) – pardon pour tous les acronymes ! Plusieurs techniques sont envisagées : repeindre en blanc certaines surfaces (routes, toits des bâtiments, etc.), pour augmenter leur réflexivité, envoyer des petits miroirs dans l’espace, diffuser des aérosols à diverses altitudes dans l’atmosphère (cette piste est par exemple étudiée pour augmenter la réflexivité des nuages marins)…

Certaines technologies sont par ailleurs « à la limite » de la géo-ingénierie, comme celles qui visent à capturer le CO2 en sortie d’usine (carbon capture, utilisation and storage, ou CCUS). Elles aboutissent à une réduction des émissions et non à des émissions négatives, de sorte qu’elles sont plutôt classées dans les techniques d’atténuation. Mais il existe des recoupements entre ces technologies (les BECCS s’appuient notamment sur les CCUS pour capter le CO2 issu de la combustion de la biomasse), ce qui explique le choix de l’Académie des sciences de les analyser dans le même rapport.

Actuellement, les modélisations du Giec intègrent-elles la géo-ingénierie ?

Oui, tout au moins les techniques visant à éliminer le CO2 de l’atmosphère. Elles sont même massivement intégrées. Les mesures envisagées

comprennent par exemple une reforestation importante – bien sûr couplée à la production d’énergie par combustion de la biomasse et à la séquestration du CO2 qui en résulte, sans quoi ce n’est pas considéré comme de la géo-ingénierie. Les technologies DACS sont également intégrées dans les scénarios et les modèles. Ce n’est en revanche pas le cas des projets de modification du rayonnement solaire incident.

Qu’entendez-vous par « massivement intégrées » ?

Quelles quantités de CO2 les modèles évalués par le Giec envisagent-ils de capturer par ces technologies ?

Dans le cinquième rapport du Giec – l’avant-dernier publié –, l’ordre de grandeur était de 12 gigatonnes de CO2 par an à l’horizon 2100. Cela correspond à plus du quart des émissions actuelles (40 gigatonnes par an) et à une multiplication par 6 000 des quantités réellement retirées aujourd’hui (2 millions de tonnes par an) ! Dans ces scénarios, le secteur de l’électricité devenait le principal puits de carbone terrestre, puisque la combustion de la biomasse plantée pour absorber le CO2 produit de l’énergie…

Mais dès leur parution, ces chiffres ont été très critiqués, voire jugés complètement irréalistes : ils auraient nécessité une surface équivalente à plusieurs fois la taille de l’Inde pour la culture de biomasse, ce qui aurait posé d’énormes problèmes en matière d’occupation des sols et de ressources alimentaires. Ils ont en outre provoqué des débats sur la confiance à accorder aux modèles. Dans son sixième et dernier rapport, le Giec est bien plus prudent sur ces technologies : leurs nombreuses limites sont soulignées et les quantités de carbone à capturer dans l’atmosphère ont été divisées par environ quatre. Mais ces quantités restent tout de même très importantes.

Une étude publiée en 2025 par le chercheur américain Matthew Gidden et ses collègues vient de fortement réduire les capacités de stockage du carbone : ne va-t-elle pas conduire à diminuer encore ces estimations, et plus généralement le potentiel de la géo-ingénierie ?

Cette étude conclut en effet que l’on pourra stocker environ 1 460 gigatonnes de carbone dans les couches sédimentaires terrestres, contre environ 14 000 selon les estimations précédentes – soit une division par 10 des capacités de stockage ! Elle montre également que certains des scénarios évalués par le Giec pourraient dépasser cette limite

Yves

Gingras

Accepter ou non des fonds de tel ou tel industriel… nombre de chercheurs se trouvent un jour confrontés à cette question. Mais ont-ils toute latitude pour y répondre ?

depuis quelques années, la question de la liberté dont disposent les chercheurs est largement discutée dans de nombreux pays. En France, un rapport récent met en avant une série de propositions pour « défendre et promouvoir la liberté académique ». Cependant, ces débats se focalisent toujours sur les atteintes à la liberté en provenance de gouvernements, d’entreprises ou de groupes de pression divers qui s’appliquent à interdire des résultats de recherche leur déplaisant.

Absente de ces débats somme toute répétitifs est une réflexion sur les pressions qu’exercent des groupes ayant des convictions idéologiques ou morales pour que les chercheurs ou leurs employeurs refusent certaines sources de financement que ceux-là considèrent comme immorales. Or, comme on va le voir en analysant surtout les controverses passées autour des fonds de recherche provenant de l’industrie du tabac, ces pressions morales auprès des scientifiques, des universités et des centres de recherche soulèvent la question rarement discutée de l’extension de la notion de liberté académique. L’exercice de celle-ci se limite-t-il

au choix des thèmes de recherche et à l’interprétation des résultats ou inclut-il également celui des sources de financement permettant de mener à bien ces projets ? Les chercheurs ontils toute latitude, évidemment dans le respect des lois en vigueur, d’accepter des fonds de sources que certains jugent illégitimes ou immorales alors qu’eux-mêmes sont convaincus

Pendant quinze ans, la compagnie Philip Morris a financé l’institut fondé en 1995 en Californie par le biologiste Sydney Brenner à hauteur de 15 millions de dollars par an.

(à tort ou à raison) que ces sources n’affectent aucunement leurs travaux ni l’interprétation des résultats ?

Depuis les années 1950, l’industrie du tabac a subventionné de nombreuses recherches fondamentales dans le domaine biomédical. La crédibilité de ce secteur ayant depuis chuté

vertigineusement, les pressions se sont faites fortes pour que les universités et les hôpitaux interdisent à leurs chercheurs d’accepter des fonds provenant de ces compagnies. Aussitôt, les scientifiques bénéficiant de ces financements ont fait valoir qu’une telle décision brimerait leur liberté académique. En 1996, par exemple, Sydney Brenner (futur lauréat du prix Nobel de physiologie ou médecine, en 2002), directeur du nouvel Institut de sciences moléculaires à La Jolla et Berkeley, aux États-Unis, déclara que la généreuse subvention de 15 millions par an, échelonnée sur quinze années, qu’il avait obtenue de la compagnie de tabac Philip Morris pour la fondation de cet institut n’était accompagnée d’aucune restriction.

Une dizaine d’années plus tard, les dirigeants des campus de l’université de Californie ont été à leur tour confrontés à des pressions pour interdire aux chercheurs d’accepter des fonds de l’industrie du tabac. La question de la liberté académique a alors mené le conseil d’administration à refuser une telle directive. Après plusieurs mois de débats houleux, il a conclu que les dix campus sous sa juridiction ne pouvaient pas

empêcher un chercheur de demander et d’obtenir des fonds d’un organisme quelconque, car cela était contraire à la liberté académique. C’est au chercheur qu’incombe la responsabilité du choix, encadré bien sûr par les règlements et clauses contractuelles habituelles imposées par les universités.

On peut comprendre que les scientifiques, qui ont toujours besoin d’argent pour faire avancer leurs recherches, hésitent à refuser des sources même quand elles sont décriées par certains groupes. Le cas des travaux de Stanley Prusiner sur ce qu’il nommera en 1982 des « prions » est particulièrement éclairant. Considérés alors comme plutôt hétérodoxes, ses travaux ont

biologistes d’accepter des financements provenant de cigarettiers. Selon son vice-président de la recherche, ces organismes se servaient de la bonne réputation de l’hôpital et de ses scientifiques pour promouvoir des objectifs nullement en accord avec ceux de l’institution.

Des choix variés face aux pressions

Plus récemment, l’université d’Utrecht, qui avait accepté en 2018 qu’un de ses professeurs en économie reçoive une subvention de la compagnie de tabac Philip Morris International, a finalement retourné les fonds à la suite des pressions exercées par la Fondation néerlandaise

Les chercheurs sont-ils libres d’accepter des fonds de sources que certains jugent illégitimes ?

bénéficié de fonds importants de la compagnie de tabac RJ Reynolds au moment où le neurologue perdait, au début des années 1980, l’appui de l’institut médical Howard Hughes. Ces fonds importants ont ainsi été cruciaux pour le succès de ses recherches, couronnées du prix Nobel de médecine en 2017.

Certaines institutions ont en revanche cédé aux pressions et banni ces sources de fonds pour des raisons d’image et de crédibilité. Dès 1994, l’hôpital général du Massachusetts a ainsi interdit à ses médecins et

contre le cancer (KWF). L’université a alors décidé de payer elle-même l’étude du professeur, qui devait porter sur la contrebande des cigarettes au sein de l’Union européenne, et a justifié sa décision en invoquant le débat social sur le tabac et les exigences de partenaires qu’elle considérait comme plus importants pour sa mission.

Les débats sur la légitimité des sources de financement touchent bien sûr d’autres secteurs. En 2014, la firme TransCanada Pipelines a proposé à l’Institut des sciences de la mer (situé à Rimouski) la création

d’une chaire de recherche sur le bélouga, alors que son projet de port pétrolier risquait d’accélérer le déclin de l’espèce. La tentation était forte chez les chercheurs d’accepter cette offre, mais Greenpeace ayant fait fuiter le plan de communication de la compagnie qui montrait que la chaire était une opération de greenwashing, ceuxci ont finalement refusé le projet. En somme, le choix d’accepter ou non certains financements varie selon les institutions et les chercheurs. Alors, jusqu’où s’étend réellement la liberté académique ? Idéalement, c’est au chercheur à en définir les contours et à décider sans contrainte, au nom de ses convictions, d’accepter ou de renoncer à certaines sources de financement. n

Yves Gingras professeur d’histoire et sociologie des sciences à l’université du Québec à Montréal, directeur scientifique de l’Observatoire des sciences et des technologies, au Canada L’AUTEUR

Jean-Paul Delahaye

C’est une vieille énigme au sujet des nombres premiers, qui interroge depuis près de cent cinquante ans. Deux chercheurs viennent, indépendamment, de réaliser de nouveaux progrès.

parmi les amateurs de mathématiques qui ont émaillé l’histoire de la discipline, on trouve d’intéressants personnages. François Proth (1852-1879) est l’un d’eux. On sait de lui qu’il était agriculteur, autodidacte, et qu’il vivait près de Verdun. Sa passion pour les nombres l’amena à écrire directement à l’Académie des sciences pour proposer des résultats et des hypothèses qui, aujourd’hui encore, portent son nom. On appelle ainsi « nombres de Proth » les nombres premiers de la forme k × 2n + 1, avec k impair et k < 2n. On sait de plus les caractériser : le « théorème de Proth » assure qu’un nombre n de cette forme est premier si, et seulement si, il existe un nombre entier a compris entre 1 et (n – 1) tel que a(n-1)/2 + 1 est divisible par n. Lorsqu’un nombre de Proth est premier, la moitié des entiers a compris entre 1 et (n – 1) vérifient la condition recherchée dans la caractérisation. Cela permet de construire un algorithme probabiliste efficace pour trouver de grands nombres premiers.

L’AUTEUR

Jean-Paul

Delahaye professeur émérite à l’université de Lille et chercheur au laboratoire Cristal (Centre de recherche en informatique, signal et automatique de Lille)

Le plus grand nombre de Proth connu est 10 223 × 231 172 165 + 1. Il possède 9 383 761 chiffres décimaux et a été découvert en 2016. C’est le treizième dans le classement des plus grands nombres premiers connus.

Ce qui vaut pourtant à François Proth son plus beau titre de gloire est la formulation qu’il fit en 1878 de ce qu’on appelle la « conjecture de ProthGilbreath », et qu’on pourrait simplement nommer « conjecture de Proth ». Car même si Norman Gilbreath, un illusionniste professionnel américain, a reformulé l’hypothèse en 1958, il semble très injuste et navrant que certaines sources parlent simplement de « conjecture de Gilbreath ».

Cette conjecture assure que si l’on considère la suite infinie des nombres premiers, puis qu’on écrit en dessous la suite infinie des valeurs absolues de la différence entre deux termes consécutifs de cette première suite, qu’on recommence pour une troisième ligne, etc., alors en tête de chaque ligne à l’exception de la première il y aura un 1.

Une formulation de la conjecture évitant d’invoquer une infinité de lignes infinies est la suivante. Pour tout entier n , si l’on considère une ligne initiale comportant les n premiers nombres premiers, puis qu’on calcule une seconde ligne en

y inscrivant la valeur absolue de la différence entre deux termes consécutifs de la première ligne, et qu’on recommence n fois, alors on construit un tableau triangulaire – car chaque ligne possède un élément de moins que la précédente – à n lignes, dont toutes les lignes à l’exception de la première commencent par un 1. Pour n = 15, on obtient ainsi le tableau ci-contre.

Théorème probabiliste

La conjecture a donné lieu à bien des calculs et commentaires. Un théorème récent s’en approche… mais sans parvenir à la démontrer totalement.

Ce théorème provient de l’étude d’une généralisation classique de la conjecture de Proth-Gilbreath. Cette dernière assure que, quand on construit le tableau de la conjecture en partant non plus de la suite des nombres premiers mais d’une suite commençant par un 2 et suivie de nombres impairs croissants dont l’écartement augmente « assez lentement », alors en tête de chaque ligne (à l’exception de la première) se trouve un 1.

On s’assure, par exemple, que cette conjecture est vérifiée en partant de la suite définie par u0 = 2 et u n = 2n + 1 pour tout n ≥ 1. En effet, la deuxième ligne du tableau est alors [1, 2, 2, 2, 2, 2, …], la

La conjecture de François Proth assure que, si l’on construit le tableau de longueur infinie dont la première ligne est la suite des nombres premiers et où chaque ligne donne, terme à terme, la valeur absolue de la différence entre deux termes de la ligne précédente, alors toutes les lignes de ce tableau à l’exception de la première commencent par un 1. Dès la formulation de cette conjecture, François Proth faisait remarquer que, si l’on savait démontrer cette conjecture et si l’on disposait par ailleurs d’une compréhension des signes qui sont négligés en prenant les valeurs absolues des différences d’une ligne du tableau à la suivante, alors on disposerait d’une nouvelle méthode de calcul des nombres premiers.

Pour le comprendre, considérons par exemple le

Tableau avec les quinze premiers nombres premiers

tableau triangulaire construit à partir des huit premiers nombres premiers, en supposant qu’on connaît uniquement le signe de chaque élément du tableau et que l’on sait que l’oblique de gauche commence par un 2 puis ne contient que des 1 (voir le dessin 1). En utilisant le fait que chaque élément du tableau, à partir de la deuxième ligne, est la différence des deux nombres juste au-dessus de lui, et connaissant le signe de cette différence, on en déduit une par une les autres obliques (voir les dessins 2 à 8). En particulier, de proche en proche, on calcule toute la première ligne, qui est la suite des nombres premiers. En effet, comme le montre le dessin 2, on détermine que le deuxième nombre premier p2 vaut + 3, car (p2 – ( + 2)) = + 1. De la même façon, le +2 se calcule avec les deux +1, etc.

troisième [1, 0, 0, 0, 0, …], et toutes les lignes suivantes sont identiques à la troisième. De même, en partant de la suite définie par v 0 = 2, v 1 = 3 et v n = 4(n – 1) + 1 pour tout n ≥ 2, on constate que la deuxième ligne du tableau est [1, 2, 4, 4, 4, …], la troisième [1, 2, 0, 0, 0, …] et que toutes les lignes suivantes sont identiques à cette dernière. D’autres expériences partant de suites aléatoires ayant cette propriété de commencer par 2 et d’être constituées de nombres impairs croissants ne s’écartant « pas trop vite » les uns des autres semblent appuyer l’idée qu’il existe un résultat général de cette sorte.

Malheureusement, le caractère assez vague de la formulation fait qu’il est aisé de trouver des contreexemples. C’est le cas, entre autres, de la suite des nombres premiers dont on a simplement retiré le 7 : la quatrième ligne du tableau qu’on construit en partant de cette ligne commence par un 3, de même que la cinquième ligne, comme le montre le tableau au-dessus de l'encadré 2.

Il faut donc préciser ce qu’on définit comme une suite dont les termes « ne s’écartent pas trop vite » les uns des autres. Le meilleur théorème dont on dispose aujourd’hui est un énoncé probabiliste, qui provient d’un article de Zachary Chase, de l’Institut de mathématique de l’université d’Oxford, publié

Loïc Mangin

Une exposition rend hommage aux folles inventions géométriques et poétiques de l’artiste néerlandais M. C. Escher, un univers où art et mathématiques s’ingénient à brouiller notre perception.

en 1961, en avril, paraissait un article de Martin Gardner dans la revue Scientific American (vous en lisez l’édition française !).

Le mathématicien, dans sa rubrique « Jeux mathématiques », y rendait compte de l’ouvrage An Introduction to Geometry, du britannique Harold Scott MacDonald Coxeter, alors à l’université de Toronto, au Canada.

Le livre explorait les géométries non euclidiennes et, en guise d’illustration, montrait des œuvres de l’artiste néerlandais Maurits Cornelis Escher, plus souvent nommé M. C. Escher.

Deux de ces gravures figuraient dans le magazine qui par ailleurs offrit à une troisième, sollicitée pour l’occasion et après colorisation, les honneurs de la couverture !

Dans les trois cas, il s’agit de pavages du plan par des motifs s’imbriquant les uns dans les autres de façon à ne laisser aucun vide, à la manière des pièces d’un puzzle : à la une de Scientific American, ces motifs sont des oies volant pour moitié vers la gauche, les autres vers la droite. Quelque cinq ans plus tard, Gardner consacra l’entièreté d’une de ses chroniques à celui qui allait devenir le « chouchou » des mathématiciens.

Et de fait, Escher écrivit à son ami Cornelius Roosevelt (agent de la CIA et petit-fils de l’ancien président Theodore Roosevelt) : « Après l’article de Monsieur Gardner, mes clients, en particulier aux États-Unis, ne me laissent plus aucun répit. » Par exemple, Stanley Kubrick lui proposa de représenter une scène pour la fin de 2001, l’Odyssée de l’espace, tandis que Mick Jagger souhaitait utiliser l’une de ses œuvres pour la couverture d’un album des Rolling Stones.

De Grenade à Amsterdam

De cette époque date un engouement jamais démenti pour les compositions de l’artiste où le cerveau s’évertue à comprendre des constructions impossibles, des explorations de l’infini, des pavages complexes… Une rétrospective d’envergure, présentée à la Monnaie de Paris, permet d’explorer ces liens intimes entre art et science, entre rigueur de la construction et imagination sans bornes. Comment Escher s’est-il aventuré entre ces deux mondes qu’il a réconciliés à sa façon ?

Une première source d’inspiration importante est, en 1936, une visite de l’Alhambra, à Grenade, en Espagne, où les zelliges, ces mosaïques décoratives

typiques de l’architecture mauresque, le marquent profondément. Il s’en ouvre à son demi-frère, Berend Escher, professeur de cristallographie à l’université de Leyde, aux Pays-Bas, qui lui fait découvrir les travaux des pionniers de ce domaine, Evgraf Fedorov et George Pólya. En s’intéressant aux cristaux bidimensionnels, tous deux ont montré qu’il existe dix-sept groupes de symétrie capables de paver le plan. De là, Escher comprend qu’il est possible de déformer les trois seuls polygones réguliers (le carré, le triangle équilatéral et l’hexagone) pouvant remplir le plan sans créer d’espaces vides si l’on respecte les symétries précédentes. Dès lors, lézards, oiseaux, poissons, cavaliers… pouvaient, emboîtés, envahir le plan de plusieurs œuvres. Les pavés, ou « tesselles », sont parfois identiques, mais pas toujours (ainsi, dans Remplissage du plan I, de 1951, tous les motifs sont différents), et dans certaines compositions, on observe une transformation d’un type vers un autre. Par exemple, dans Air et eau (voir la reproduction page 76), de 1938, la zone centrale est entièrement comblée par des oiseaux et des poissons, les premiers dominant progressivement le haut et les seconds le bas.

Arthropodes, vers, mollusques, vertébrés… Les animaux n’ont pas colonisé la terre ferme en une fois, mais en plusieurs phases, que l’on commence à entrevoir.

la sortie des eaux des plantes et des animaux est un des grands changements qui ont jalonné l’histoire de la Terre. Or, si celle des plantes est bien décrite, des zones d’ombre entourent encore celle des animaux. Et pour cause : ces deux groupes n’ont pas du tout suivi le même processus. Selon la paléontologie et la phylogénie (l’étude des liens de parenté entre espèces), le phylum qui s’est épanoui sur le milieu terrestre sous la forme de mousses, fougères et plantes à fleurs est monophylétique : il a conquis le milieu terrestre une seule fois, au Cambrien, il y a environ 500 millions d’années. Au contraire, chez les animaux multicellulaires, les réussites correspondent à de multiples tentatives de différents phylums. Par exemple, les vertébrés et les arthropodes sont arrivés indépendamment sur le milieu terrestre.

L’AUTEUR

Hervé Le Guyader professeur honoraire de biologie évolutive à Sorbonne Université, à Paris

Grâce à la paléontologie et à l’anatomie comparée, la dynamique de la sortie des eaux – ou « terrestrialisation » – des vertébrés est bien connue. Les fossiles des plus anciens tétrapodes décrits (Acanthostega, Ichthyostega) remontent au Dévonien supérieur, vers 365 millions d’années. Mais il a fallu attendre le Carbonifère, avec l’apparition de l’œuf amniotique vers 340 millions d’années, pour que des tétrapodes soient capables de se reproduire hors de l’eau. Les arthropodes, eux, avaient résolu le problème bien avant : un gisement de l’île de Kerrera, en Écosse, a révélé des myriapodes (ou mille-pattes) et des araignées datant du Silurien, vers 420 millions d’années. Mais quelle est l’histoire de leur terrestrialisation ? Et comment s’articule-t-elle avec celle des nématodes, des mollusques, des tardigrades et de tous les autres animaux terrestres actuels ? C’est cette question qu’une équipe rassemblée par Jordi Paps, de l’université de Bristol, au RoyaumeUni, a récemment explorée au moyen d’une vaste étude génomique.

Un mode de vie terrestre nécessite de nombreuses adaptations, bien

différentes suivant les phylums : une peau (chez les vertébrés) ou une cuticule (chez les arthropodes) retenant l’eau, un système immunitaire adapté, des changements du squelette et du système de locomotion, un taux métabolique plus élevé, des systèmes sensoriels adaptés (vision, olfaction, audition), de nombreuses modifications du système de reproduction. D’un point de vue évolutif, on parle de « convergence » : les différents phylums qui ont conquis le milieu terrestre ont chacun, indépendamment et à leur façon, résolu un même problème adaptatif, vivre hors de l’eau.

S’adapter à la vie hors de l’eau

Dès la fin du XIX e siècle, des discussions acharnées ont porté sur la dynamique d’apparition de ces adaptations. Les naturalistes se sont rendu compte que certains caractères étaient déjà présents chez l’ancêtre aquatique, comme la structure du membre d’Ichthyostega – ce qui a été appelé une « exaptation ». D’autres, en revanche, se sont construits bien plus tardivement, comme l’œuf amniotique. Ainsi, des

Le myriapode d’Afrique de l’Est vit principalement dans la forêt. C’est la plus grande des 14 250 espèces

Deux gènes ont subi une intense sélection au début de la domestication du cheval. L’un d’eux, ZFPM1, est connu

À la fin du Carbonifère, il y a quelque 300 millions d’années, vivait dans les milieux humides de l’hémisphère Nord

L’autre gène, GSDMC, influe sur l’anatomie du dos et la locomotion. Chez une majorité de chevaux,

Cela suggère que chez le cheval, la sélection sur ce gène, notamment d’une diminution de son expression,

Les arthropodes terrestres étaient à l’époque bien plus grands qu’aujourd’hui, sans doute en partie

Iule géant d’Afrique (Archispirostreptus gigas)

Taille : de 10 à plus de 30 cm

154

C’est le nombre de génomes, issus de 21 phylums, que l’équipe de Jordi Paps a comparés pour étudier la terrestrialisation animale.

11

L’équipe a mis en évidence 11 taxons d’animaux sortis indépendamment de l’eau.

469

Les myriapodes sont arrivés sur la terre ferme il y a environ 469 millions ± 60 millions d’années. Avec les nématodes (473 millions ± 56 millions d’années), ce sont les premiers animaux qui ont colonisé le milieu terrestre.

Comment nettoyer sans frotter ni abîmer les surfaces délicates, comme les dorures d’anciens carrosses ? Grâce à des mousses appropriées !

mille heures de travail. C’était récemment la durée nécessaire pour nettoyer les dorures et les stucs des carrosses d’apparat du château de Nymphenburg, à Munich, en procédant délicatement à la main avec des tiges munies d’un embout de coton. Aujourd’hui c’est deux fois plus rapide grâce à un procédé conçu par la physicienne Wiebke Drenckhan, de l’université de Strasbourg, et ses collaborateurs. Son secret ? Une mousse qui nettoie et frotte toute seule !

Pour rendre bien propres les surfaces sales, l’huile de coude ne suffit pas. Il faut aussi utiliser les bons produits. Pourquoi ? Parce que l’eau seule ne permet pas de dégraisser efficacement. Et cela pour deux motifs :

LES AUTEURS

Jean-Michel Courty professeur de physique à Sorbonne Université, au laboratoire Kastler-Brossel

Édouard Kierlik professeur de physique à Sorbonne Université, au LPTMC (CNRS, SU)

d’abord, les corps gras, ou lipides, ne sont pas miscibles avec l’eau et ensuite la majorité des surfaces – la peau, les plastiques, les bois peints ou vernis –sont hydrophobes, c’est-à-dire qu’elles préfèrent de loin le contact des lipides à celui de l’eau.

Des molécules ambivalentes

La raison est à chercher du côté des forces intermoléculaires. L’eau, H 2 0, est une molécule polaire, car les électrons contribuant à la liaison entre l’oxygène et les hydrogènes sont décalés vers l’oxygène. L’hydrogène d’une molécule, chargé positivement, est fortement attiré par l’oxygène d’une molécule voisine. Cette force d’attraction électrostatique est à l’origine de ce que l’on appelle la « liaison hydrogène », responsable de la forte cohésion de l’eau liquide.

Les lipides en revanche sont constitués de longues chaînes composées essentiellement d’atomes de carbone et d’hydrogène, avec quelques rares d’oxygène. Les charges électriques y sont réparties de façon plutôt uniforme, empêchant l’eau de nouer des liaisons hydrogènes avec les lipides, ce

qui explique le peu d’affinité des molécules d’eau avec ces derniers ou les surfaces non polaires. Pour y remédier, la chimie nous offre les tensioactifs. Ces molécules sont dites « amphiphiles », car elles possèdent à la fois une tête hydrophile (qui aime l’eau) et une queue lipophile (qui aime le gras). C’est par exemple le cas du laureth sulfate de sodium (voir la figure page 86, en bas), couramment utilisé dans les produits ménagers ou

C’était le nombre d’heures nécessaires au nettoyage des carrosses d’apparat du château de Nymphenburg, à Munich.

Se dit de molécules ayant à la fois une partie hydrophile (qui aime l’eau) et une autre hydrophobe, ou lipophile (qui aime le gras).

C’est la différence de pression entre l’atmosphère et l’intérieur des bulles d’une mousse très fine et pauvre en liquide.

les cosmétiques. Ces molécules se positionnent à l’interface eau-lipide avec la tête hydrophile dans l’eau et la queue lipophile dans le gras. Il en résulte une augmentation significative de l’affinité entre l’eau et les lipides. Cela réduit considérablement la tension de surface, c’est-à-dire l’énergie nécessaire pour former une interface entre deux milieux. Pour l’huile et l’eau, cette énergie vaut environ 30 millijoules par mètre carré (mJ · m–2). Avec une

Nettoyer des dorures, par exemple d’un carrosse, réclamait beaucoup de temps et le maniement minutieux d’un grand coton-tige (à gauche). Aujourd’hui, grâce à de nouvelles mousses appliquées avec une seringue (à droite), l’opération est plus simple et plus rapide.

solution lavante, un détergent – de l’eau avec le tensioactif –, elle chute drastiquement à quelques mJ · m–2.

Quelle est la conséquence pour le nettoyage à l’échelle microscopique ?

Plongeons une assiette sale dans de l’eau et versons du produit vaisselle. Au début, les tensioactifs commencent par s’installer… en surface, entre l’air et l’eau (voir la figure page suivante, en

haut). N’oublions pas qu’ils n’aiment l’eau qu’à moitié ! Ensuite, au-delà d’une certaine concentration, ces tensioactifs forment des micelles, des petits agglomérats de molécules avec les têtes hydrophiles qui pointent vers l’eau et les queues lipophiles qui restent ensemble à l’intérieur. Quid au niveau du gras ?

Si l’affinité avec le matériau de l’assiette est forte, le gras « mouille » bien la surface solide et se présente comme