Pour la PHYTO

Des galaxies sans matière noire

Les premiers pas des biocalculateurs

Un implant sous-rétinien pour soigner la DMLA La science expliquée par ceux qui la font

Des symbioses microscopiques au cycle du carbone

Des galaxies sans matière noire

Les premiers pas des biocalculateurs

Un implant sous-rétinien pour soigner la DMLA La science expliquée par ceux qui la font

Des symbioses microscopiques au cycle du carbone

Quel lien unit le foisonnement des microorganismes dérivant dans les courants océaniques aux grands équilibres planétaires ?

La question paraît relever de l’appétit pour les analogies qui guidait les savants jusqu’à la Renaissance. Ces derniers cherchaient ce qu’avaient en commun microcosme et macrocosme, rapprochant par exemple la physiologie et le mouvement des planètes, comme le rappelle l’anthropologue Philippe Descola dans ce numéro. Mais nulle analogie à trouver ici : notre planète ne flotte pas entre deux eaux, les trajectoires du plancton ne suivent aucune orbite. Le lien existe, assurément. Il est cependant bien plus intéressant qu’une analogie, car c’est en fait un lien de dépendances et d’actions réciproques, aux conséquences déterminantes. On sait par exemple désormais que ce sont de minuscules algues qui, dans l’océan, fixent l’azote et le CO2 atmosphériques, fournissant oxygène et nourriture à de vastes communautés d’organismes vivants. Et si l’œuvre invisible de ces plantes microscopiques étend sa portée à l’échelle de la planète, c’est parce qu’elle est le produit de subtiles interactions, façonnées par l’évolution, où les symbioses tiennent le premier rôle, comme le montrent les biologistes Flora Vincent et Laure Planat.

Osons une analogie… contemporaine : quand des astronomes soviétiques et américains ont eu l’audace de franchir le rideau de fer (non sans rocambolesques difficultés), à la fin des années 1960, pour synchroniser les observations de leurs radiotélescopes et faire ainsi de l’interférométrie un atout déterminant de la cosmologie moderne, n’était-ce pas à nouveau le signe que ce sont les connexions qui ouvrent le champ des possibles ? Et, au passage, comme le souligne l’historienne des sciences Rebecca Charbonneau, que l’entreprise scientifique sait être facteur de paix.

L’interconnexion de neurones humains et de systèmes informatiques (de tels « biocalculateurs » sont déjà accessibles aux laboratoires de recherche, via internet), en vue de créer des ordinateurs puissants et sobres en énergie, sera-t-elle aussi fructueuse ? Nous en détaillons les premiers pas, et ne manquerons pas d’en rapporter les avancées dans ces pages. n

Céline Bon, paléogénéticienne (MNHN), Éric Darrouzet, entomologiste (université de Tours) Pierre-Alain Duc, astronome (ObAS), Carole Escartin, neuroscientifique (CNRS), Nicolas Goepfert, archéologue (CNRS), Bernard Javot, ingénieur de recherche (institut Max-Planck pour les systèmes intelligents), Mathieu Lancry, physicien (université Paris-Saclay)

06 Du verre pour stocker des données pendant 10 000 ans

08 Le bruit des baskets sur le parquet enfin expliqué

09 Alzheimer : la piste des tanycytes

10 L’« intelligence physique » des poils de la trompe des éléphants

13 Métissage Néandertal-sapiens : les indices d’une préférence sexuelle

– Points de vue –

62 La vie dans tous ses états De la fragilité des formes de vie Perig Pitrou

64 Les sciences à la loupe Budgets de recherche américains : le pouvoir réel de Donald Trump Yves Gingras

66 Redresseur de code OpenClaw, ou le complexe du homard Thomas Gerbaud

68 Retour sur image Cartographier toutes les étoiles, un vieux rêve Charlotte Bigg

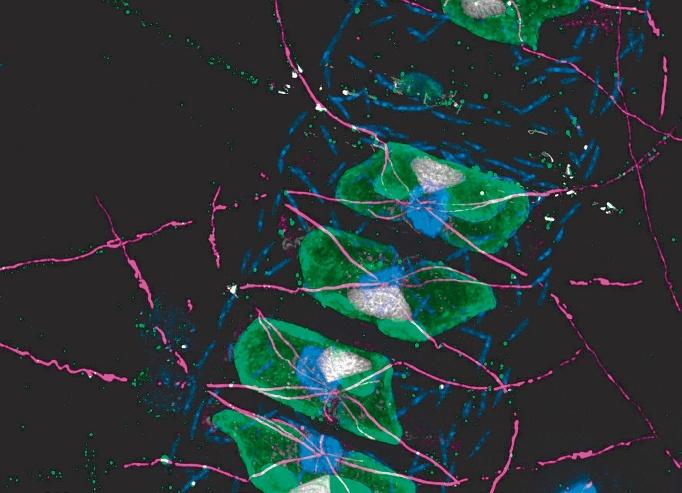

NEUROSCIENCES

Biocalcul : des ordinateurs fondés sur des neurones humains

David Adam

Connecter puces et neurones, une nouvelle approche pour des ordinateurs puissants qui consomment peu d’énergie.

ANTHROPOLOGIE

« En mettant en évidence d’autres façons de faire monde que la nôtre, l’anthropologie est révolutionnaire »

Entretien avec Philippe Descola

Le naturalisme a été le creuset du capitalisme industriel. Mais d’autres ontologies sont possibles.

COSMOLOGIE

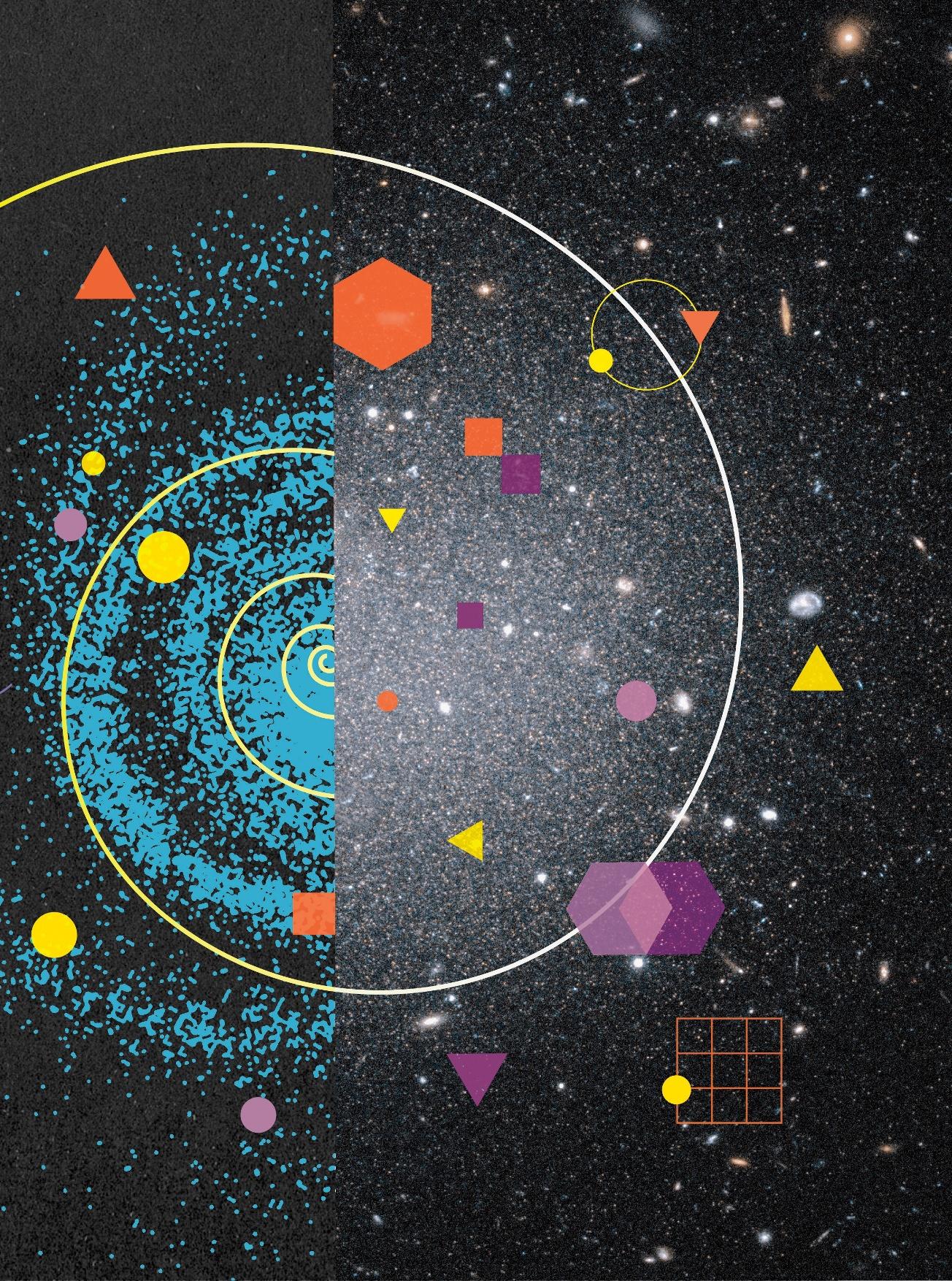

Des galaxies sans matière noire

Maria Luísa Buzzo

La découverte de galaxies dépourvues de matière noire invite à revoir en profondeur les modèles de formation galactique.

INFORMATIQUE Sculpter les paysages des mondes virtuels

David Louapre

Comment naissent forêts, montagnes et rivières de pixels.

24 30 44 36

LETTRES D’INFORMATION

Toutes les semaines, l’essentiel de Pour la Science Soyez informé chaque mois des sorties de toutes nos publications

Profitez de nos offres promotionnelles

Et aussi : des newsletters thématisées

Inscrivez-vous ou scannez ce code : www.pourlascience.fr

BIOLOGIE ENVIRONNEMENTALE

Flora Vincent et Laurine Planat

Invisible à l’œil nu, le phytoplancton régule pourtant le climat, nourrit les océans et fixe une part immense du carbone mondial. Les scientifiques découvrent aujourd’hui

que ses interactions avec d’autres microorganismes pourraient expliquer certains des mécanismes les plus fondamentaux de la vie marine.

50 58

HISTOIRE DES SCIENCES

Interférences constructives sous la guerre froide

Rebecca Charbonneau

En 1969, astronomes américains et soviétiques se sont alliés pour construire un radiotélescope virtuel de plusieurs milliers de kilomètres.

MÉDECINE

« Cet implant sous-rétinien a donné des résultats assez extraordinaires chez des patients atteints de DMLA »

Entretien avec José-Alain Sahel

Les résultats d’un essai clinique ouvrent la voie vers la prise en charge de la dégénérescence maculaire liée à l’âge (DMLA).

– Culture –

70 Logique & calcul

Indécidabilité et physique : l’étonnante rencontre Jean-Paul Delahaye

Le concept d’indécidabilité, bien connu en mathématiques, semble avoir aussi du sens en physique. Avec quelles implications concrètes ?

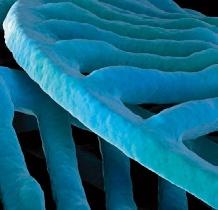

76 Art & Science Plongée en poésie sous-marine Loïc Mangin

78 Les livres du mois

80 Chroniques de l’évolution Comment les oiseaux inventèrent le croupion Hervé Le Guyader

84 Idées de physique Le goût de la parabole Jean-Michel Courty et Édouard Kierlik

88 Science & gastronomie Les fibres, digestes alliées des gourmands Hervé This

90 L’équation Mathématiques des bombardements aériens Florian Freistetter

En couverture : © Science Photo Library / Nanoclustering

Ce numéro comporte un courrier de réabonnement posé sur le magazine sur une sélection d’abonnés.

Les supports actuels de stockage de données ont des durées de vie très courtes, ce qui rend difficile l’archivage de long terme.

Microsoft présente une technique d’inscription dans des plaques de verre d’informations qui seraient encore lisibles dans 10 000 ans.

Que restera-t-il de notre époque, dans 1 000 ou 10 000 ans ? Les plus anciennes écritures connues remontent à plus de cinq millénaires, probablement des données comptables, inscrites sur des tablettes d’argile découvertes dans l’actuel Irak. Nos disques durs modernes ne conservent quant à eux l’information guère plus d’une dizaine d’années et on ne saurait consigner dans l’argile

l’ensemble des bibliothèques, des films et du reste des dizaines de milliards de téraoctets que produit l’humanité chaque année. Le verre semble être un support intéressant. C’est la piste explorée par l’équipe de Microsoft qui vient d’annoncer les résultats de son projet Silica, avec un système d’archivage complet sur des plaques de verre, de l’écriture à la lecture.

La technique repose sur la modification locale de la structure du verre

Sur une plaque de verre de 12 centimètres de côté ont été enregistrées toutes les données de la carte du jeu Flight Simulator.

par des impulsions laser pour former des « voxels », l’équivalent de pixels en trois dimensions, d’environ 500 nanomètres de côté. « Ils exploitent intelligemment deux types de voxels qui existaient déjà », explique Matthieu Lancry, de l’université Paris-Saclay. Les premiers, les voxels biréfringents, sont de minuscules cavités, des « nanovides » allongés dans une direction. Les seconds sont des « voxels de phase », pour lesquels l’indice de réfraction du matériau est localement modifié. Chaque voxel est inscrit dans le verre par une unique impulsion laser. La vitesse d’écriture permet d’inscrire jusqu’à 66 mégabits par seconde. La lecture, qui fonctionne par microscopie optique, est cependant encore très lente. « L’information est là, pérenne, mais elle ne peut pas être lue à la volée, résume Matthieu Lancry. Cela limite pour l’instant l’utilisation de cette technique à du stockage de long terme. »

Encodage adaptable

L’encodage passe par un symbolisme adaptable en fonction des circonstances. Par exemple, on peut imaginer utiliser une base 4, avec quatre symboles arbitraires a, b, c et d qui correspondent à quatre orientations différentes de nanovides pour les voxels biréfringents et à quatre valeurs d’indice de réfraction pour les voxels de phase. Ce choix est alors

simple à transposer en base 2, la plus utilisée en informatique, en définissant par exemple : a = 00, b = 01, c = 10 et d = 11. L’octet « 011 10 100 » se traduit par « bdba », écrit dans la structure du verre en 4 voxels.

L’équipe a testé son système en enregistrant 301 couches de voxels biréfringents dans un carré de 12 centimètres de côté et de 2 millimètres d’épaisseur, pour un total de 4,8 téraoctets de données, soit l’équivalent de plus de 100 heures de film en haute définition (4K). Ces voxels ne peuvent cependant être inscrits que sur du verre de silice ultrapure, un matériau relativement coûteux. Quant aux voxels de phase, ils offrent une densité d’information environ deux fois et demie plus faible, mais sont compatibles potentiellement avec tous types de verre, y compris les plus communs.

Les chercheurs ont utilisé du verre borosilicate, qui est dur et se dilate peu avec les variations de température. En soumettant les plaques de verre à des tests de vieillissement accéléré, l’équipe a estimé que l’information resterait lisible même en étant soumise à une température de 290 °C pendant 10 000 ans. À température ambiante, les données stockées seraient donc conservées pendant bien plus longtemps encore.

La promesse de « capsule temporelle » que laisse imaginer ce support reste à nuancer. Car même en supposant qu’une telle bibliothèque de verre résiste à la casse et à l’érosion pendant des millénaires, les générations futures auront-elles une pierre de Rosette pour décoder un archivage si complexe ? n

Pierre Giraudeau

Microsoft Research Project Silica Team, Nature, 2026

Le guano expliquerait la prospérité du Royaume chincha et sa place privilégiée dans l’Empire inca

Dans le sud de l’actuel Pérou, un ancien petit État côtier, qui a prospéré entre 1000 à 1400 de notre ère, intrigue les spécialistes. Il s’agit du Royaume chincha, qui jouissait d’un statut privilégié : alors que les Incas pouvaient se montrer très durs avec les peuples conquis, les Chinchas n’étaient soumis qu’à un impôt. Pourtant, nulle mine d’or dans ce pays constitué autour de la vallée du fleuve Pisco. Dès 1997, s’appuyant sur des textes contemporains de la conquête hispanique, l’historien péruvien Marco Curatola Petrocchi postulait que la bonne fortune chincha devait beaucoup au guano, un fertilisant tiré des montagnes de fientes d’oiseaux de mer, culminant à 40 ou 50 mètres d’altitude, accumulées sur les îles. Réunie autour de l’archéologue Jacob Bongers, de l’université de Sydney, en Australie, une équipe internationale vient d’apporter une solide confirmation physicochimique aux conjectures de l’historien. Prélevés en surface de tombes locales et datés entre 1155 et 1675, trente-cinq épis de maïs, possiblement

des dépôts funéraires, ont été analysés. Les scientifiques ont notamment mesuré le ratio de deux isotopes stables, l’azote 14 et l’azote 15. Selon leurs résultats, la teneur très élevée en azote 15 dans le maïs ne s’explique que par l’usage de fertilisants ayant communiqué leur propre azote à la plante ; et parmi tous ceux connus et expérimentés, seul le guano permet d’atteindre les valeurs obtenues.

Conclusion des chercheurs : la mainmise des Chinchas sur l’accès, par radeaux, aux gisements de guano – ressource vitale pour la culture du maïs, dans un territoire peu arrosé par les pluies – expliquerait pourquoi les empereurs incas ont tant ménagé le petit royaume. Et protégé les îles guanières : leur accès était interdit à la saison des amours, et chasser un oiseau marin était passible de la peine de mort. L’or le plus précieux des « peuples du soleil » était blanc, et sortait du cloaque d’oiseaux de mer. n Olivier Voizeux J. L. Bongers et al., Plos One, 2026.

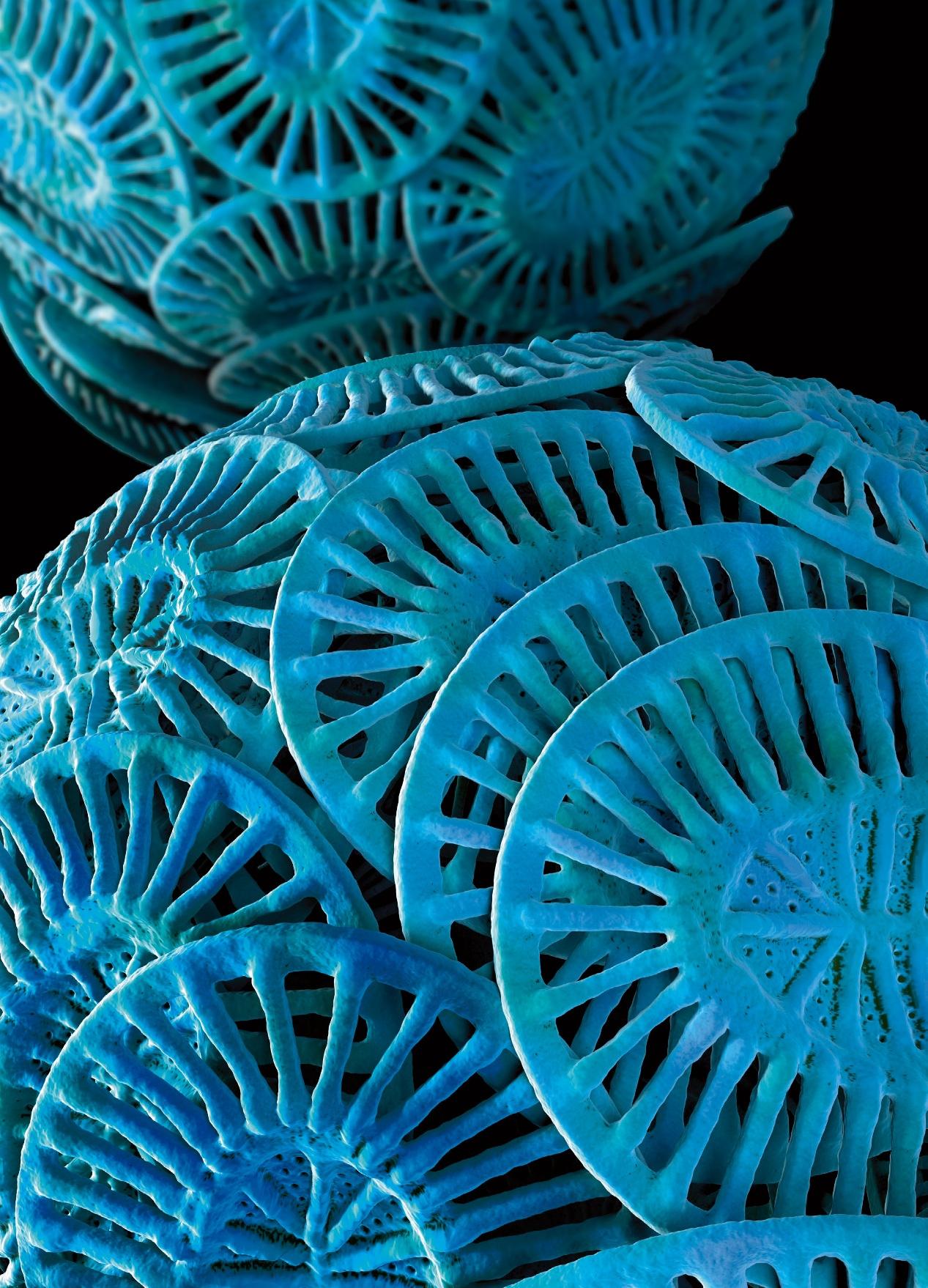

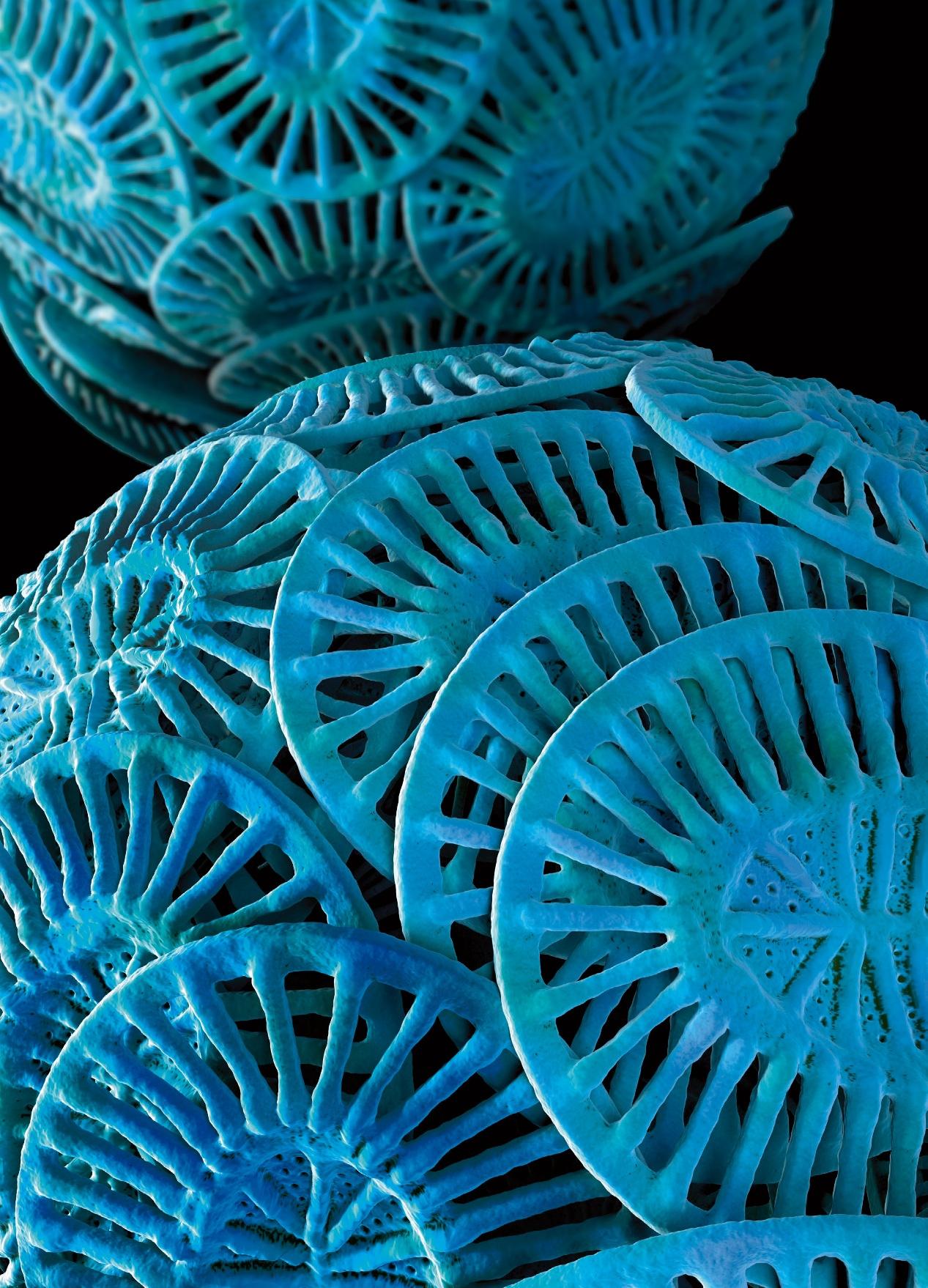

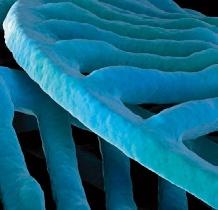

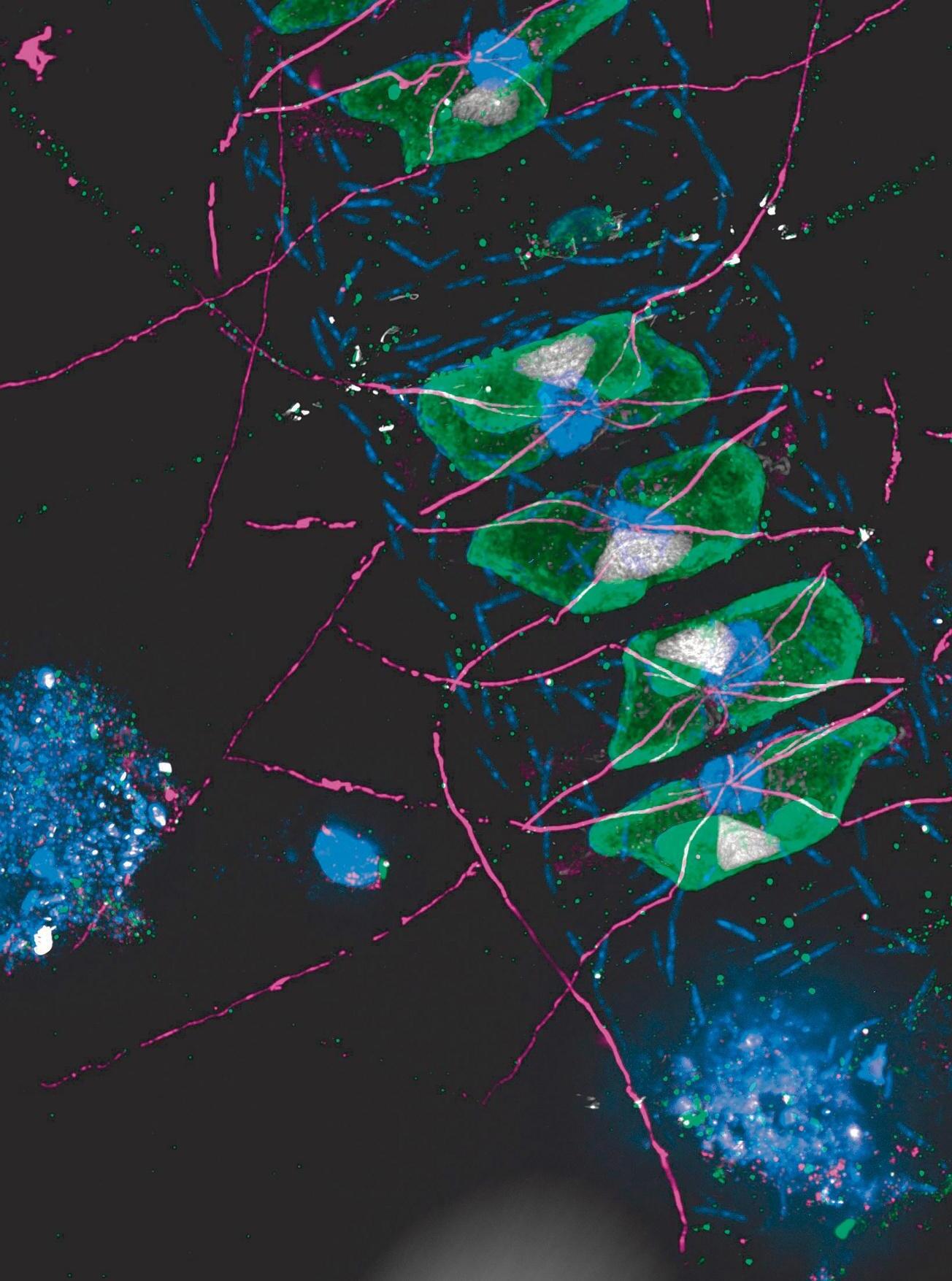

Symbiose entre une microalgue (une diatomée

Chaetoceros) et des bactéries (en bleu), observée par microscopie à expansion, à partir d’un échantillon environnemental de Tallinn, collecté pendant l’expédition Trec

10 µm

L’essentiel

Le phytoplancton joue un rôle central dans le fonctionnement de l’océan et du climat.

Il assure 45 % de la production primaire mondiale et fixe chaque année 40 % du CO₂ atmosphérique.

Il soutient la chaîne alimentaire marine, produit de l’oxygène et contribue au transport d’environ 10 milliards de tonnes de carbone vers les profondeurs océaniques.

Ses interactions symbiotiques, avec des bactéries notamment, modifient profondément son métabolisme, son évolution et, donc, la dynamique des écosystèmes marins.

Flora Vincent et Laurine Planat

© S. Flori et al.,

Invisible à l’œil nu, le phytoplancton régule pourtant le climat, nourrit les océans et fixe une part immense du carbone mondial. Les scientifiques découvrent aujourd’hui que ses interactions avec de nombreux autres organismes pourraient expliquer certains des mécanismes les plus fondamentaux de la vie marine.

les scientifiques étaient perplexes depuis des décennies… ils ne comprenaient pas qui fixait l’azote atmosphérique dans l’océan Atlantique, nutriment essentiel aux organismes marins. Seules certaines bactéries, dont les cyanobactéries, en sont capables. Elles le transforment en ammoniac, assimilable par d’autres organismes. Toutefois, les estimations basées sur les bactéries vivant librement dans l’eau ne correspondaient pas aux mesures d’azote fixé. C’est presque par erreur qu’en 2024 des chercheurs de l’institut Max-Planck, en Allemagne, ont découvert la clé de cette énigme en plein milieu de l’océan Atlantique : une symbiose entre une autre bactérie (Rhizobia), capable de fixer l’azote, et une microalgue (une diatomée). La bactérie donne une partie de l’azote à la microalgue, celle-ci partage en retour du carbone organique qu’elle a produit par photosynthèse. Et la quantité d’azote fixé ainsi est considérable ! À l’échelle globale, cette découverte permet enfin d’expliquer les observations de Biologie

terrain : ce sont les bactéries vivant à l’intérieur des microalgues, via les symbioses, qui expliquent les taux de fixation.

Cette découverte majeure n’est pas isolée. D’année en année, on mesure à quel point ces interactions phytoplanctoniques sont fondamentales pour maintenir un océan fonctionnel. De manière incroyable, de nombreuses fonctions océaniques comme la régulation du climat, l’équilibre de la chaîne alimentaire, la production d’oxygène dissous (essentiel pour les organismes marins comme les poissons ou même la vie microscopique) ou encore le stockage de carbone reposent en grande partie sur le plancton (de planktos, qui signifie « errer, dériver » en grec ancien) – les animaux et plantes aquatiques qui dérivent dans l’océan –, et en particulier sur ses microorganismes. Parmi eux, le phytoplancton possède un pouvoir exceptionnel : la photosynthèse, qui utilise l’énergie solaire pour convertir le CO₂ et l’eau en matière organique et en oxygène. En se divisant grâce à la photosynthèse, ces organismes majoritairement unicellulaires, parfois organisés en colonies, deviennent appétissants pour d’autres organismes qui dépendent d’eux pour leur survie. Ils sont donc à la base de la chaîne alimentaire marine, comme le sont les plantes sur Terre. À l’échelle de la planète, environ 45 % de la production primaire nette, la matière organique issue de la photosynthèse, provient du phytoplancton marin ! Chaque année, il est responsable de 40 % du CO2 atmosphérique fixé, soit environ 50 gigatonnes de carbone par an. Cela représente une contribution équivalente, voire supérieure, à celle de toutes les forêts et plantes terrestres combinées. C’est donc un acteur majeur du cycle du carbone, rouage essentiel pour l’équilibre des écosystèmes et la régulation du climat. Mais l’immense puits de carbone océanique est mis à mal par le surplus de CO2 anthropogénique : l’eau s’acidifie, menaçant le fonctionnement

Laurine Planat doctorante au Laboratoire européen de biologie moléculaire (EMBL) de Heidelberg, en Allemagne

Flora Vincent directrice de recherche à l’EMBL, à Heidelberg, en Allemagne ; co-coordinatrice de l’expédition Trec, membre du consortium Tara Oceans

de la pompe à carbone biologique dont fait partie le phytoplancton.

Or cette pompe permet également le maintien de la vie dans les profondeurs : chaque année, environ 10 milliards de tonnes de carbone sont transportées vers les couches inférieures des océans, par l’intermédiaire des organismes en décomposition ou des pelotes fécales. Une partie nourrit les organismes vivant dans la colonne d’eau, et entre 0,6 et 1,3 % de la production primaire annuelle termine sur le plancher océanique, où elle est stockée à l’échelle de millions d’années.

Le phytoplancton peut aussi former des efflorescences localisées, appelées blooms (de l’anglais « floraison »). Lors de ces événements qui durent de quelques jours à quelques mois, la population de microalgues (diatomées, dinoflagellés, coccolithophores) prolifère vite et massivement, au point de créer des nappes de couleur verte, rouge ou brune sur des kilomètres carrés, visibles même depuis l’espace grâce aux images satellites. C’est d’ailleurs ce qui nous a permis de les étudier au cours de l’expédition Gayoso, que nous avons menée à bord de la goélette Tara, en décembre 2021. Après ce bloom, les algues meurent, devenant ainsi un gros réservoir de nourriture pour d’autres espèces. Ces phénomènes font partie de la vie marine rythmée par les saisons, et sont très importants écologiquement. Mais certaines algues peuvent produire des toxines, rendant ces blooms dangereux pour les autres organismes marins et terrestres. Par exemple, ceux des dinoflagellés Alexandrium peuvent produire de puissantes toxines qui s’accumulent dans les huîtres, les rendant impropres à la consommation. De manière générale, les blooms peuvent être dérégulés par la pollution chimique des eaux, notamment liée à l’agriculture, et des études sont encore nécessaires pour élucider leurs mécanismes.

Le phytoplancton est donc un acteur clé des océans, mais son impact va bien au-delà ! Prenons le cas des nuages : dès 1987, des scientifiques ont suggéré que le phytoplancton, en rejetant du sulfure de diméthyle (DMS), influençait la formation et les propriétés des nuages. Ce processus a depuis été étudié sur le terrain, permettant d’identifier une nouvelle boucle de rétroaction négative : l’océan Arctique contient de nombreuses espèces planctoniques produisant du DMS ; cela accentue la formation de nuages, augmentant l’albédo (le pouvoir réfléchissant), créant ainsi un phénomène refroidissant. Cependant, le phytoplancton peut également faire partie de boucles de rétroaction positives : toujours en Arctique, la fonte des glaces

Quand la science en train de se faire se donne à entendre

Les scientifiques du Collège de France partagent leurs découvertes, dernières recherches, réflexions sur la science, et anecdotes de labo... Découvrez le podcast de Pour la Science

DES ENTRETIENS EXCLUSIFS

LES DERNIÈRES AVANCÉES SCIENTIFIQUES

LE MEILLEUR DE LA SCIENCE

Disponible sur toutes les plateformes

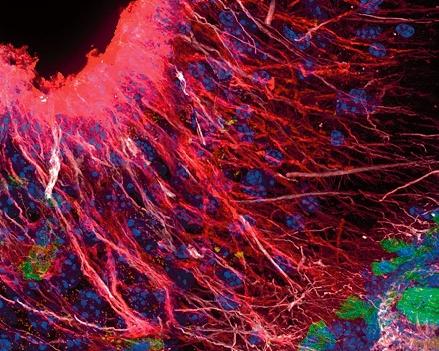

David Adam

Certains scientifiques cherchent à exploiter des neurones pour fabriquer des ordinateurs puissants qui consomment très peu d’énergie.

Les biocalculateurs sont fabriqués en connectant des neurones, obtenus à partir de cellules de peau reprogrammées, à un ordinateur classique.

dans une ville au bord du lac Léman, des amas de cellules cérébrales humaines sont disponibles à la location. Ces amas de cellules vivantes, de la taille d’un grain de sable, sont capables de recevoir des signaux électriques et d’y répondre, un peu comme les ordinateurs. Des équipes de recherche du monde entier peuvent leur proposer diverses tâches, dans l’espoir qu’ils traitent les informations et renvoient un signal. Bienvenue dans le monde du wetware, ou des ordinateurs biologiques (biocomputers, en anglais, aussi traduisible par « biocalculateurs »). Au sein de quelques laboratoires universitaires et entreprises, des chercheurs cultivent ces neurones humains et tentent de les transformer en systèmes fonctionnels équivalents à des transistors biologiques. Selon eux, ces réseaux de neurones pourraient un jour atteindre la puissance d’un superordinateur, sans la consommation d’énergie démesurée qui l’accompagne.

Les résultats obtenus jusqu’à présent sont limités. Mais des scientifiques enthousiastes acquièrent déjà un accès en ligne à ces processeurs fondés sur des cellules cérébrales, voire

investissent des dizaines de milliers d’euros pour construire leurs propres modèles. Certains cherchent à les utiliser comme de simples remplaçants des ordinateurs ordinaires, tandis que d’autres y voient un outil pour étudier le fonctionnement du cerveau. « L’intelligence biologique pose un problème scientifique très intéressant », explique Benjamin Ward-Cherrier, chercheur en robotique à l’université de Bristol, au Royaume-Uni, qui loue du temps sur les organoïdes cérébraux suisses. « Et je pense qu’il vaut mieux l’aborder en partant de la base – avec des modèles réduits et simplifiées de notre cerveau, que l’on complexifie progressivement (approche bottom-up) –, plutôt que selon une approche descendante (top-down). »

Les partisans du biocalcul affirment que ces systèmes pourraient un jour rivaliser avec les capacités de l’intelligence artificielle et le potentiel des ordinateurs quantiques. Mais d’autres chercheurs qui travaillent sur des neurones humains sont plus sceptiques. Ils mettent en garde contre le battage médiatique et les fantasmes de science-fiction autour de ce qu’on appelle parfois le brain-in-a-jar (« cerveau dans un bocal »), qui risquent de se révéler contreproductifs. En particulier si l’idée que ces systèmes possèdent une sensibilité et une conscience s’impose…

Réduire la consommation d’énergie

Les informaticiens convoitent depuis longtemps l’étonnante efficacité énergétique du cerveau humain. Fonctionnant avec moins de 20 watts, soit à peu près la consommation d’un petit ventilateur de bureau, ses milliards de neurones effectuent l’équivalent de 1 milliard de

L’essentiel

Des chercheurs développent des ordinateurs biologiques, ou biocalculateurs.

Ils cultivent pour cela des réseaux de neurones capables de recevoir des signaux électriques, de traiter l’information et d’y répondre.

Il est possible, d’utiliser à des fins de recherche ces réseaux neuronaux, proposés via internet par certaines entreprises. Encore expérimentaux, ces systèmes se sont déjà révélés capables d’effectuer certaines tâches, comme jouer à des jeux vidéo simples.

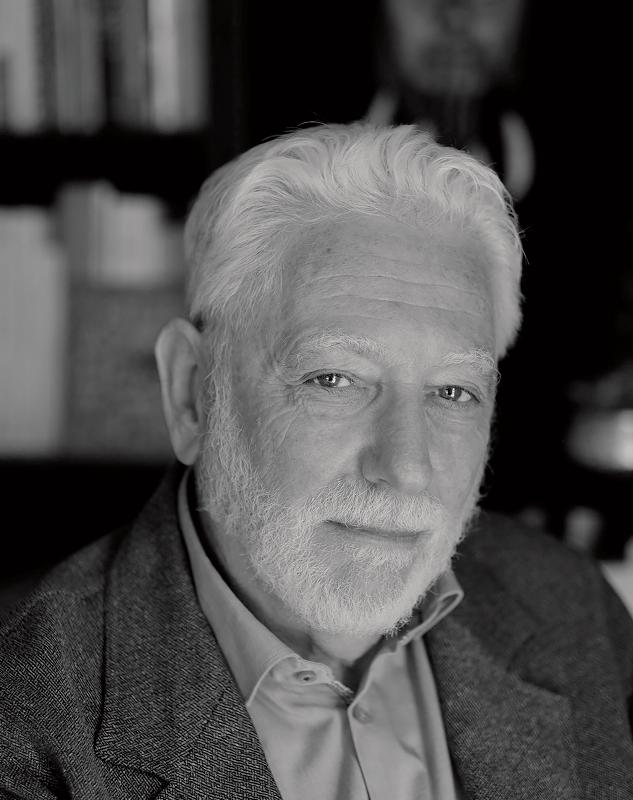

Vingt ans après « Par-delà nature et culture », Philippe Descola revient sur cinquante ans de recherche, et notamment sur les quatre ontologies, ou « façons de faire monde », qu’il a définies, dont l’une, le naturalisme, a été le creuset du capitalisme industriel. Et il fait le pari que mieux connaître les autres, ailleurs sur la planète, ouvre des pistes pour envisager une relation moins destructrice avec notre environnement.

PHILIPPE DESCOLA anthropologue, médaille d’or du CNRS, est professeur émérite au Collège de France, où il occupa la chaire d’anthropologie de la nature jusqu’en 2019.

En quoi a consisté votre séjour chez les Achuars à la fin des années 1970, là où tout a commencé ?

Philippe Descola : Ce fut une enquête ethnographique classique qui consista en une immersion de longue durée parmi une population amérindienne de la haute Amazonie, en Équateur, qui avait accepté les contacts pacifiques peu de temps auparavant. Son mode de vie, son organisation sociale… avaient donc été peu affectés par le monde extérieur. J’avais choisi cette destination parce que je m’intéressais aux rapports qu’entretiennent les populations amazoniennes, en général, avec ce que j’appelais la « nature » encore à l’époque, c’est-à-dire avec leur environnement. Je voulais étudier les techniques matérielles et intellectuelles au moyen desquelles cette population, les Achuars, tissait des liens avec des autres qu’humains, des plantes, des animaux, des esprits… J’y ai passé presque trois ans, avec ma compagne, Anne-Christine Taylor. Je me suis aperçu que ce que j’étais venu étudier n’avait guère de sens, car d’abord les Achuars ne disposaient d’aucun terme qui soit traduisible dans un équivalent du mot « nature ». Et ensuite, de toute façon, leur rapport quotidien avec les autres qu’humains, avec les plantes, les animaux, les esprits, les rivières… étaient des rapports de personne à personne. La nature n’était donc pas quelque chose d’extérieur à eux, mais elle était fondée sur une continuité morale et cognitive : les autres qu’humains étaient considérés comme ayant les mêmes dispositions mentales, une intériorité analogue à celle des humains, ce qui faisait d’eux des personnes. Le terme « personne », aénts, en achuar, est utilisé pour désigner aussi bien les humains que les autres qu’humains, à condition qu’on puisse communiquer avec eux.

De là, vous avez élargi votre analyse aux différentes formes de « mondiation » de par la planète. Pourriez-vous détailler cette idée ?

P. D. : De mes observations sur le terrain, j’ai déduit que notre façon, disons, à ce stade, occidentale, de séparer le monde, entre d’un côté la nature, de l’autre la société et les cultures, était tout à fait originale, exotique. Elle entrait en contradiction avec ce que j’avais vu chez les Achuars, pour qui il y a une continuité entre humains et autres qu’humains sur le plan moral et cognitif – alors que nous faisons des premiers une exception.

Cette continuité, ou non, de l’intériorité se double d’une alternative similaire sur la physicalité.

P. D. : En effet, pour les Achuars, du point de vue physique, chaque forme de vie a des dispositions qui lui sont propres et qui lui ouvrent des mondes singuliers. À l’inverse, à nos yeux, il y a une continuité entre l’humain et le reste du monde parce que nous sommes gouvernés par les mêmes lois physiques ou biologiques quand il s’agit du vivant.

On distingue ainsi notre façon de faire monde, que j’ai appelée « naturalisme », et celle, caractéristique des Achuars, et dont j’ai retrouvé des traces dans bien d’autres régions du monde, que j’ai appelée « animisme ». Il y a un croisement puisqu’on ne fait pas passer les continuités et les discontinuités au même endroit : continuité de la physicalité entre humains et le reste du monde chez les naturalistes et discontinuité chez les animistes ; discontinuité de l’intériorité pour nous entre humain et autres qu’humain, et continuité chez les animistes. On a donc deux formes distinctes de continuité (et de discontinuité).

De mon séjour, j’avais donc déduit que nous étions face à deux formes de mondiation, deux façons de faire monde très différentes, dont l’une, le naturalisme, a longtemps été perçue en Europe comme le seul modèle possible. Mais il n’est qu’une variante d’un système de continuités et de discontinuités plus ample, que j’ai étudié au fil du temps, en particulier en mettant en évidence deux autres formes de relations au non-humain.

Quelles sont-elles ?

P. D. : Il y a d’abord le totémisme, en reprenant un terme forgé par les premiers ethnographes des populations aborigènes d’Australie à la fin du xixe et au début du XXe siècle, dans lequel des humains et des autres qu’humains partagent, au sein d’un groupe nommé, des dispositions physiques et morales héritées, incorporées, génération après génération depuis un prototype. De ce dernier, on sait peu de choses sinon qu’il s’est déplacé à la surface de la Terre, et y a laissé des traces. Dans la plupart des cas, ces êtres dits « du rêve » sont désignés par le nom d’un animal, mais il s’agit surtout de mettre en avant une de leurs qualités maîtresses, qui se retrouve dans tout le groupe. Ce n’est donc pas le totémisme tel qu’on l’a longtemps pensé, fondé sur une vraie généalogie biologique, avec un ancêtre animal commun.

On doit y voir une ontologie, c’est-à-dire une manière d’organiser le « mobilier » du monde, de le structurer, de répartir ses différentes composantes et les relations qui les lient. Et cette ontologie a ceci

LIRE

P. Descola et N. Truong, Nous sommes les hôtes de la Terre, Arthaud, 2026.

Maria Luísa Buzzo

La découverte de galaxies dépourvues de matière noire invite à revoir en profondeur les modèles de formation galactique.

Avant mon tout premier cours de master à l’université de São Paulo, je n’avais jamais entendu parler de galaxies dépourvues de matière noire. Nous étions en 2018, et la découverte venait tout juste d’être rendue publique. Plus précisément, une équipe d’astronomes venait d’annoncer avoir identifié une étrange petite galaxie qui semblait privée de cette composante invisible, pourtant censée constituer l’essentiel de la matière de l’Univers et jouer un rôle déterminant dans la formation, l’évolution et la stabilité des structures cosmiques. L’annonce était donc pour le moins marquante, au point même d’être relayée à la télévision brésilienne. C’est d’ailleurs sur cette actualité que notre enseignant s’est appuyé pour commencer le semestre. Elle a par la suite alimenté nombre de nos discussions, durant de longs mois. En effet, elle entrait en contradiction directe avec ce que l’on pensait savoir des galaxies naines. Jusqu’alors, on supposait que ces amas stellaires, plus petits et plus boursouflés que les galaxies spirales comme la Voie lactée, étaient fortement dominés par la matière noire. Comment concevoir qu’elles puissent se former et survivre sans elle ? Le résultat nouvellement publié était-il robuste ? Cachait-il des hypothèses fragiles ? Ou bien étions-nous confrontés à une limite de nos modèles de formation galactique, qui ne prédisaient pas l’existence de telles structures ?

L’essentiel

La matière noire est considérée comme indispensable à la formation et à la survie des galaxies. La découverte de galaxies ultradiffuses comme DF2 et DF4, dépourvues de cette composante, interroge les modèles cosmologiques. DF2, DF4 ainsi que FCC 224, tout juste identifiée, sont anciennes et possèdent des amas globulaires anormalement brillants, ce qui suggère un mode de formation inédit.

Elles seraient le fruit d’une collision violente entre deux galaxies naines. Ce choc séparerait la matière noire de la matière ordinaire, créant ainsi des galaxies orphelines de matière noire, souvent par paires ou par groupes.

David Louapre

Dans les jeux vidéo dits « en monde ouvert », les joueurs sont libres d’explorer des environnements extrêmement réalistes.

Le physicien et créateur de la chaîne YouTube « Science étonnante » en détaille les secrets dans cet extrait de son dernier livre, « Le Labo du jeu vidéo ».

qu’il s’agisse des contrées médiévales fantastiques de The Witcher III, de l’Ouest américain de Red Dead Redemption 2 ou de l’Hyrule de Zelda : Breath of the Wild, ces mondes virtuels s’étendent parfois sur des dizaines de kilomètres carrés. D’une quête à l’autre, on y découvre des régions aux caractères bien distincts, peuplées de forêts denses, de plaines arides, de chaînes de montagnes enneigées et de marécages brumeux…

Générer des terrains réalistes

Pour créer ces régions aux environnements riches, les développeurs s’efforcent de reproduire de nombreux éléments géophysiques comme les plateaux ou les vallées. Mais le relief n’est qu’une première couche. Il faut aussi faire serpenter des rivières depuis les sommets jusqu’aux lacs et océans, parfois creuser des réseaux de grottes souterraines, puis habiller ces paysages d’une végétation crédible. Comment générer tous ces éléments d’une façon qui soit à la fois plausible, plaisante visuellement et intéressante pour le gameplay ?

Comme souvent dans le jeu vidéo, la création de terrains résulte d’un équilibre à trouver entre

le réalisme et le besoin de contrôle artistique des développeurs. Plusieurs techniques existent, chacune ayant ses forces et ses faiblesses.

Première option : faire appel à la génération procédurale. Certains jeux comme Minecraft ou No Man’s Sky créent leurs terrains en temps réel, au moment même où le joueur les explore. La plupart des jeux « AAA » [dont la production implique des centaines de personnes et le budget est comparable aux blockbusters, ndlr] en monde ouvert ont une approche différente : la génération procédurale y sert d’outil de conception pendant le développement. Les designers les génèrent, les modifient, puis, quand ils en sont satisfaits, ils les « figent » dans la version finale. Le joueur parcourt alors un monde soigneusement conçu, sans jamais voir les algorithmes à l’œuvre.

Dans les années 1970, le mathématicien Benoît Mandelbrot a mis en évidence l’existence de nombreuses géométries fractales dans la nature. Une fractale est une structure qui présente des motifs similaires à différentes échelles d’observation : quand on zoome sur une partie, on retrouve des formes qui rappellent l’ensemble. Les côtes bretonnes en sont

L’île Auroa dans le jeu Tom Clancy’s Ghost Recon

Breakpoint. Sur la série des jeux Ghost Recon, les équipes d’Ubisoft Paris ont collaboré avec le laboratoire Liris, à Lyon, pour produire l’environnement naturel. Ici, l’île s’inspire des paysages contrastés qu’on peut croiser en Nouvelle-Zélande, associant plages paradisiaques et chaînes de montagnes aux pentes abruptes et enneigées.

David Louapre

Le Labo du jeu vidéo Albin Michel, 2026 432 pages, 25,90 euros

« Sculpter les paysages naturels d’un monde virtuel » – titre du chapitre du livre

Le Labo du jeu vidéo dont nous publions ici un large extrait – s’appuie sur de nombreux outils mathématiques et informatiques. Mais un environnement ne serait pas complet sans ses habitants. Il faut des cerfs entre les arbres, des poissons dans les rivières… C’est à la simulation de cette vie sauvage que se consacre le chapitre suivant de l’ouvrage. David Louapre se penche également sur la prise en compte des lois de la physique, l’animation des personnages, l’analyse du comportement des joueurs, les ressources de calcul et les effets spéciaux, au fil de trente chapitres passionnants et solidement documentés.

Le télescope de 43 mètres de diamètre de l’observatoire de Green Bank, aux États-Unis, photographié en 1965 – l’une des deux antennes utilisées pour la première expérience d’interférométrie à très grande base.

L’essentiel

Dans les années 1960, plusieurs équipes d’astronomes imaginèrent indépendamment un interféromètre géant pour augmenter la précision des observations spatiales en radiofréquence.

Des premiers essais encourageants eurent lieu aux États-Unis, qui combinaient les signaux reçus de radiotélescopes distants de quelque 200 kilomètres. Pour augmenter la précision, une équipe américaine lança une collaboration avec une station en Crimée, dans la république socialiste soviétique d’Ukraine.

Malgré de nombreux obstacles tant techniques que diplomatiques, la coalition mena l’expérience avec succès, ouvrant la voie à une nouvelle façon d’observer l’Univers.

En 1969, des astronomes américains se sont alliés à leurs homologues soviétiques pour construire un radiotélescope virtuel de plusieurs milliers de kilomètres.

en 1969, alors que les tensions entre l’Est et l’Ouest étaient vives, des scientifiques américains et soviétiques ont mené une expérience transfrontalière sans précédent en radioastronomie. Conçue pour repousser les limites d’une nouvelle technique, l’interférométrie à très grande base (VLBI, pour very long baseline interferometry), cette expérience exigeait confiance et coopération entre les deux parties. Surmontant une multitude d’obstacles politiques, culturels et logistiques, les astronomes américains et soviétiques ont relié deux radiotélescopes – l’un à Green Bank, en Virginie-Occidentale, l’autre dans la péninsule de Crimée, au sein de la république socialiste soviétique d’Ukraine – pour créer un seul télescope virtuel dont la base était aussi grande que la distance les séparant. Le résultat fut non seulement un bond historique en matière de capacités d’observation, mais aussi une collaboration surprenante entre rivaux.

Inventée au milieu des années 1960, la VLBI est encore aujourd’hui au cœur des observations astronomiques de pointe. Les images d’un trou noir publiées par l’Event Horizon Telescope depuis 2019, par exemple, ont été rendues possibles grâce à cette

technique. Celle-ci permet en effet aux astronomes d’améliorer la résolution des radiotélescopes en reliant plusieurs antennes à coupole sur de grandes distances et en utilisant le décalage temporel de l’arrivée du signal à chacune d’elles pour en simuler une seule beaucoup plus grande.

Ces antennes n’ont même pas besoin d’être physiquement connectées pour atteindre une résolution angulaire sans précédent. Grâce à leur répartition sur le globe, les radioastronomes ont observé les émissions d’objets impossibles à distinguer auparavant, comme des quasars lointains, des étoiles à neutrons et des trous noirs supermassifs. Cependant, comme cette technique repose sur une synchronisation précise et sur un partage de données au-delà des frontières politiques, elle fait souvent appel tant à l’astrophysique qu’à la diplomatie.

La radioastronomie a vu le jour dans les années 1930, lorsque l’ingénieur américain Karl Jansky, qui travaillait dans les laboratoires Bell, a détecté par hasard des ondes radio émanant du centre de la Voie lactée alors qu’il étudiait les

En octobre 2025, les résultats de l’essai clinique de l’implant sous-rétinien du dispositif Prima ouvrent la voie vers la prise en charge de la dégénérescence maculaire liée à l’âge (DMLA), dont la forme la plus courante n’a aucun traitement à ce jour. Éclairage de José-Alain Sahel, qui a participé à son élaboration.

JOSÉ-ALAIN SAHEL est professeur émérite d’ophtalmologie à Sorbonne Université, à l’hôpital national des Quinze-Vingt et à l’hôpital Fondation Rothschild, à Paris. Il est également professeur à l’École de médecine de l’université de Pittsburgh, aux États-Unis. Il a fondé et dirigé l’Institut de la vision. Il a notamment été lauréat de la médaille de l’innovation du CNRS en 2012 et a reçu le prix Wolf de médecine en 2024. Il est membre de l’Académie des sciences.

Qu’est-ce que la dégénérescence maculaire liée à l’âge ?

José-Alain Sahel : La dégénérescence maculaire liée à l’âge (DMLA) est une maladie oculaire affectant la macula, une zone située au centre de la rétine et responsable de la vision détaillée. La DMLA est due à une accumulation de débris liés au renouvellement incomplet et au métabolisme des photorécepteurs, des cellules qui captent la lumière et la transforment en signal électrique transmis au cerveau. Ces débris peuvent s’accumuler chez des individus jeunes sans avoir de conséquences pendant des décennies. Avec l’âge, les dépôts s’accroissent et peuvent perturber le fonctionnement de la rétine : il s’agit alors d’une « dégénérescence maculaire liée à l’âge ». Pour ce qui est de la prévalence de la DMLA, en incluant les stades précoces, 1 à 2 % de la population en est atteinte à 55 ans, environ 10 % à 65 ans, 25 % à 75 ans et 60 % à 90 ans.

Quelle est la différence entre les deux formes de DMLA ?

J.-A. S. : Dans la forme dite « humide », l’accumulation de débris provoque la prolifération de vaisseaux sanguins qui envahissent la couche de photorécepteurs, qui en est dépourvue en temps normal. Cela entraîne un œdème, des hémorragies et une déformation de la rétine. Dans l’autre forme, qualifiée de « sèche » ou « atrophique », les débris forment une barrière empêchant l’alimentation correcte des photorécepteurs et des cellules de l’épithélium pigmentaire situées en dessous, qui finissent par s’atrophier. La rétine s’amincit et ce phénomène est observable par différentes techniques d’imagerie. Parfois des stades précoces de DMLA sont qualifiés à tort de « forme sèche/atrophique » en l’absence d’atrophie de la rétine : il s’agit d’une erreur qui prête à confusion. En outre, les deux formes de DMLA peuvent coexister au sein d’une même rétine.

Quels sont les symptômes de cette maladie ?

J.-A. S. : Le symptôme le plus précoce est la vision d’une sorte de tache au plafond le matin au réveil. C’est probablement dû à une différence d’adaptation à l’obscurité entre les zones saines et les zones malades de la rétine. Ensuite, le symptôme principal est la baisse de vision : il peut s’agir soit d’une baisse d’acuité visuelle soit de taches centrales ou paracentrales appelées « scotomes ». Une perte de sensibilité au contraste est également possible, mais

les patients ne s’en rendent pas forcément compte. Dans la forme humide, les néovaisseaux déforment la rétine – cela fait comme un écran ondulé –, donc l’image perçue apparaît déformée.

Quels facteurs favorisent le développement d’une DMLA ?

J.-A. S. : Les principaux facteurs de prédisposition à la DMLA connus sont l’âge, le tabac, les facteurs génétiques et hygiéno-diététiques (sédentarité, régime alimentaire gras et sucré). On constate une prédominance de la maladie chez les femmes et les personnes ayant des iris de couleur claire. Il existerait aussi des liens avec l’hypermétropie, les maladies cardiovasculaires, l’hypertension artérielle et l’hypercholestérolémie.

Au cours de la dernière décennie, les recherches menées sur la DMLA ont souligné le rôle essentiel de l’alimentation et mis en lumière l’effet protecteur du régime méditerranéen. Et ce même chez les personnes présentant une très forte prédisposition génétique à la maladie. Concernant la génétique, de nouvelles mutations ont été identifiées ces dernières années sur les chromosomes 1 et 10 puis classées en fonction de leur lien avec la maladie.

Une fois la DMLA installée, existe-t-il un traitement ?

J.-A. S. : Concernant la forme humide, la prise en charge inclut des injections dans l’œil de molécules dirigées contre le facteur de croissance endothélial vasculaire (VEGF). Celles-ci stoppent la croissance des néovaisseaux et surtout l’œdème. J’ai vécu leur apparition au milieu des années 2000 et cela a vraiment révolutionné notre façon de soigner les malades. D’autres pistes ont été explorées depuis, incluant des molécules à administrer par voie orale, des greffes de photorécepteurs et d’épithélium pigmentaire, des anticorps pour limiter l’inflammation ou la thérapie génique afin de faire produire par l’œil des anti-VEGF. Mais pour l’instant, aucune n’a eu un effet aussi majeur que les injections d’anti-VEGF. Dans la forme atrophique, des facteurs contrôlant la réponse inflammatoire [ensemble de réactions en chaîne du système immunitaire qui amplifient l’inflammation et la destruction de cellules, ndlr] semblent ralentir la croissance des lésions. Une complémentation alimentaire et une maîtrise des facteurs de risque hygiéno-diététiques contribuent aussi à ralentir la progression

Perig Pitrou

Les fréquentes situations de violence, d’inégalité… s’opposent à l’idée d’un équilibre naturel qui fonderait l’ordre social. La notion de « forme de vie » cherche à penser cette tension en rendant attentif à l’essentielle fragilité des vies humaines.

la notion de « vie sociale » est d’un usage si courant que l’on oublie parfois qu’elle résulte d’une élaboration scientifique sophistiquée. À la fin du XIX e siècle, Émile Durkheim établit les fondements d’une nouvelle science – la sociologie moderne – visant à expliquer les faits humains par des déterminismes sociaux ne relevant ni de la biologie, ni de la psychologie.

Tout en la distinguant des sciences de la nature, il a souvent recours à des analogies entre vie organique et vie sociale. Le crime est ainsi appréhendé à travers la distinction du normal et du pathologique : les punitions infligées aux actions des personnes transgressant les règles sociales sont autant de moyens de réaffirmer ces dernières – de même que le médecin rétablit la santé après un épisode de maladie.

En dépit de l’intérêt heuristique de ces comparaisons, l’anthropologie contemporaine critique désormais cette conception qui affirme implicitement l’existence d’un ordre social normal autour duquel les sociétés humaines s’organiseraient. Les violences, les guerres, les catastrophes, tout ce qui occasionne désordres et souffrances chez les humains, sont si fréquentes, qu’il s’avère indispensable de reconnaître la fragilité intrinsèque de l’organisation des collectifs, vue auparavant comme plus robuste que les vies individuelles, toujours plus éphémères.

Ce changement de perspective théorique s’accompagne d’une réflexion sur la notion de « forme de vie », qui réarticule les relations entre le social et le biologique. L’anglais distingue la locution life form, qui identifie des catégories biologiques (poissons, oiseaux, arbres…), et l’expression form of life, souvent empruntée à la philosophie de Ludwig Wittgenstein par les sciences sociales pour décrire les règles régissant les interactions humaines.

Dans La Vie et les Mots, Veena Das, anthropologue à l’université Johns-Hopkins, à Baltimore, emploie toutefois le concept de « forme de vie » (forms of life) d’une façon plus critique afin de mettre au jour les liens entre la fragilité des organismes et les règles sociales. Ses enquêtes sur les violences qui ont meurtri l’Inde lors de la partition avec le Pakistan et des émeutes provoquées par l’assassinat d’Indira Gandhi la conduisent à rejeter l’équivalence entre

ordre social et forme de vie. Avec cette notion, elle suggère au contraire d’être attentifs aux efforts menés au quotidien, en particulier par les femmes victimes des pires agressions, pour continuer à vivre normalement, faisant ainsi de l’ordre social le résultat d’un travail plutôt qu’un point d’équilibre naturel.

Chez Didier Fassin, professeur d’anthropologie au Collège de France et à l’Institut des études avancées, à Princeton, la notion de forme de vie sert à aborder la vie comme un phénomène biologique et biographique. Elle révèle le caractère instable de l’ordre social du fait des rapports de pouvoir qui engendrent des inégalités. Dans La Vie. Mode d’emploi critique, il assigne une nouvelle direction au programme de l’anthropologie sociale. En même temps que cette discipline compare les différences entre aires culturelles et modes de vie, elle doit savoir identifier les similitudes entre des conditions de vie qui mettent en danger l’intégrité physique des individus et les règles organisant la vie en commun. Son investigation porte ainsi sur « une forme de vie qui hante l’imaginaire des sociétés contemporaines : celle des nomades transnationaux précaires – réfugiés ou migrants, demandeurs d’asile ou étrangers en situation irrégulière ».

Pour les sciences sociales en général, le défi épistémologique est donc de continuer à affirmer la scientificité d’une démarche étudiant le fonctionnement objectif des sociétés humaines, tout en développant des méthodes pour mieux cerner l’expérience individuelle, vécue par des milliards d’humains, de situations menaçant la fragilité des vies humaines et des organisations collectives. n

BIBLIOGRAPHIE

V. Das, La Vie et les Mots. Violence et descente dans l’ordinaire, Le Cerf, 2023. D. Fassin, La Vie. Mode d’emploi critique, Seuil, 2013. Perig Pitrou directeur de recherche au CNRS, au laboratoire d’anthropologie sociale du Collège de France, où il dirige l’équipe Anthropologie de la vie

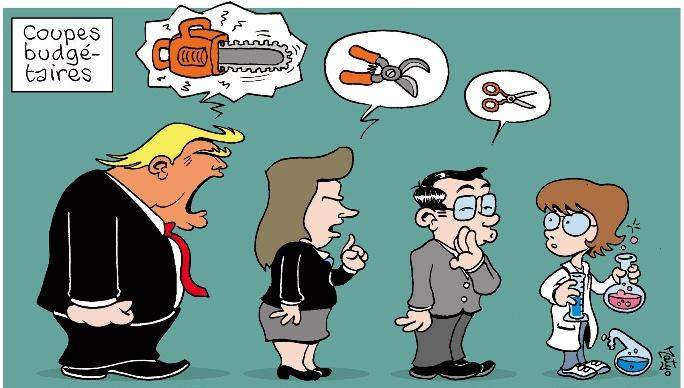

Yves Gingras

Alors que le projet de budget pour 2026 du président des États-Unis annonçait des coupes massives pour les principaux organismes de recherche du pays, la loi finalement adoptée est bien plus mesurée.

depuis son élection en 2024, Donald Trump réussit l’exploit de toujours garder l’attention sur lui quel que soit le domaine pour lequel il affirme prendre une décision. Cette personnalisation extrême d’un gouvernement amène ainsi de nombreux observateurs à croire que le président des États-Unis, tel un roi, est seul à décider, oubliant au passage que les dirigeants d’autres pays comme le Canada ou la France ont en fait beaucoup plus de pouvoirs discrétionnaires.

Prenons l’exemple des multiples déclarations de Donald Trump concernant la recherche scientifique. Début mai 2025, il a fait connaître son projet de budget pour 2026, annonçant aux principaux organismes de recherche fédéraux des coupures allant d’un tiers à la moitié. Plus précisément, le document indiquait que la National Science Foundation (NSF), la principale agence qui finance la recherche fondamentale (hors médecine) aux États-Unis, et la Nasa verraient leur budget réduit d’environ 50 %, alors que celui des NIH, les instituts américains de santé, serait rogné de près de 40 %. Aussitôt, les scientifiques ont naturellement

hurlé au désastre, annonçant une catastrophe pour un pays dont le niveau habituel d’investissement dépasse largement celui de tous les autres. On prévoyait rien de moins que le déclin rapide de la science américaine face à d’autres pays dont, au premier chef, la Chine. La crise de confiance

8,75 milliards

de dollars : c’est la dotation pour l’année fiscale 2026 de la NSF, la principale agence américaine qui finance la recherche fondamentale. En 2025, son budget s’élevait à 9,06 milliards de dollars.

Source : FYI : Science Policy News

a été exacerbée par le gel arbitraire des subventions pour les chercheurs et les universités traitant de sujets que le gouvernement Trump considère comme « idéologiques », et par le climatoscepticisme et la critique des vaccins qu’affiche l’équipe choisie par le président pour diriger les divers organismes fédéraux.

Observant ce mouvement de panique largement diffusé dans les médias, j’étais toutefois de ceux

qui prédisaient qu’aucune de ces coupures extravagantes ne se matérialiserait. Pourquoi ? Pour s’en convaincre, il suffit d’observer le mécanisme de décision qui mène à l’adoption du budget des États-Unis.

La première étape est la soumission d’un projet par le président (la branche exécutive) à la Chambre des représentants et au Sénat, les branches législatives du gouvernement. Ce processus budgétaire se décline en 12 projets de lois associés aux 12 sous-commissions qui, dans ces deux institutions, sont dédiées aux crédits, lesquelles couvrent différents domaines des dépenses fédérales. Les membres de ces sous-commissions examinent alors en détail les propositions du président et les modifient en fonction des intérêts des élus des deux chambres, qui se réunissent ensuite pour négocier leurs différends et s’accorder sur un projet commun. Chaque projet modifié est alors renvoyé au président qui peut l’approuver ou le refuser. Mais un tel véto est risqué, car il entraîne un shutdown , un gel des paiements, notamment celui des employés fédéraux. Ce manège a toujours été le même et, chaque année, reconduit la lutte entre

républicains et démocrates pour se terminer par un compromis acceptable par tous.

Le premier test de ma prédiction est survenu en novembre 2025 avec l’adoption du projet de loi qui couvrait la recherche en alimentation et en agriculture. Alors que Donald Trump réclamait une coupure de 38 %, le résultat final fut… zéro baisse ! Puis, début janvier 2026, la Chambre des représentants et le Sénat ont refusé encore une fois la coupe drastique de 55 % pour la NSF et l’ont ramenée à 3,4 % (soit 300 millions de dollars sur un total de 9,06 milliards) alors que le budget de la Nasa n’a été amputé que de 1,1 % (84 millions de

toujours mettre un véto final, mais alors il faut recommencer. La négociation se fait donc de manière qu’il signe finalement un budget de compromis. Une autre raison qui justifiait de mettre en doute la mise en œuvre de ces demandes extravagantes est que, depuis le début des années 1980, les élus, tant démocrates que républicains, ont refusé toutes les demandes présidentielles de coupure importante des budgets alloués à la recherche et qu’à chaque fois, le président a signé des compromis en leur faveur. D’ailleurs, comme le montre une étude récente, les augmentations de budget ont été plus souvent adoptées sous des présidences républicaines que démocrates.

Les scientifiques américains jouiront encore en 2026 des budgets de recherche les plus importants du monde

dollars sur un total de 7,25 milliards) au lieu des 47 % réclamés par l’exécutif. Mieux encore, le budget des NIH a vu sa dotation augmentée de 415 millions de dollars, soit de près de 1 % ! Quant à celui du département de l’Énergie, il s’est accru de presque 2 %, passant de 8,24 à 8,4 milliards de dollars alors qu’une coupure d’un milliard était demandée.

Ces exemples suffisent amplement à rappeler qu’aux États-Unis, le président ne décide pas des budgets, lesquels relèvent des élus à la Chambre des représentants et au Sénat. Il peut

Une raison qui contribue à expliquer l’énorme décalage entre les demandes de coupure des présidents et les décisions des élus est bien sûr que ces derniers sont plus proches de leurs électeurs et que les coupes demandées affectent des emplois dans des organismes dispersés dans la plupart des États des gouverneurs et des sénateurs. Ainsi, la Nasa insiste sur le fait que « les 50 États américains aident la Nasa à explorer l’espace ». Le fait que les gouverneurs et les sénateurs peuvent mettre un frein aux ambitions souvent délirantes

du président reflète bien la théorie des checks and balances (contrôles et contrepoids) à la base de la Constitution américaine, laquelle vise justement à éviter la tyrannie des rois. Bien sûr, cela n’empêche pas un gouvernement élu d’avoir un pouvoir de nuisance et d’imposer certaines de ses convictions en agissant à l’intérieur des organisations pour redéfinir leurs objectifs prioritaires. Mais quoi qu’on puisse en penser, les États-Unis demeurent une démocratie et malgré les perturbations importantes apportées par le président Trump, les scientifiques américains jouiront encore en 2026 des budgets de recherche les plus importants du monde. n

Yves Gingras professeur d’histoire et sociologie des sciences à l’université du Québec à Montréal, directeur scientifique de l’Observatoire des sciences et des technologies, au Canada L’AUTEUR

Jean-Paul Delahaye

Le concept d’indécidabilité, bien connu en mathématiques, semble avoir aussi du sens pour certains problèmes en physique. Avec quelles implications concrètes ?

en mathématiques, nombreuses sont les personnes qui considèrent que les théorèmes d’incomplétude de Kurt Gödel (1906-1976), et le développement subséquent de la théorie de la calculabilité, comptent parmi les avancées les plus importantes du vingtième siècle. Pourtant, dans un ouvrage paru en 2004, le célèbre physicien britannique Roger Penrose soulignait que, malgré l’étroite relation entre les mathématiques et la physique, ces développements n’avaient presque pas eu d’impact sur notre conception du monde physique. Il assurait cependant : « Personnellement, je suis convaincu que nous découvrirons que les questions de calculabilité sont d’une importance capitale dans les futures théories physiques. » L’histoire lui a donné raison : depuis vingt ans, des physiciennes et physiciens de plus en plus nombreux s’intéressent à ces questions. Notons que Kurt Gödel, dont les travaux sont à la racine de ce champ de recherche en mathématiques, semblait peu disposé à questionner l’impact de ses résultats en physique. Le physicien américain John Wheeler (1911-2008), relate en effet : « Un

L’AUTEUR

Jean-Paul Delahaye professeur émérite à l’université de Lille et chercheur au laboratoire Cristal

(Centre de recherche en informatique, signal et automatique de Lille)

jour, j’étais à l’Institut d’études avancées, et je me suis présenté au bureau de Kurt Gödel. C’était l’hiver, il était près d’un radiateur électrique, les jambes enveloppées dans une couverture. Je l’ai interrogé : “Professeur Gödel, quel lien voyez-vous entre votre théorème d’incomplétude et le principe d’incertitude de Heisenberg ?” Ma question l’a mis en colère et il m’a demandé de sortir de son bureau. »

Indécidable, incalculable

La théorie de l’indécidabilité fournit d’abord des résultats concernant les théories axiomatiques. Celles-ci sont, en quelque sorte, des systèmes de calcul, car on y fixe des règles parfaitement précises définissant ce qu’est une démonstration correcte : cela permet de « mécaniser » la vérification des démonstrations, qui sont donc ramenées à des calculs.

L’un de ces résultats indique que, dès qu’une théorie axiomatique non contradictoire est « suffisamment puissante », elle permet de formuler certains énoncés qu’elle est pourtant incapable de démontrer, et dont elle ne peut pas non plus démontrer la négation. Ces énoncés sont appelés des « indécidables de la théorie ». On parle d’« incomplétude », et même d’« incomplétabilité », de la théorie. Pour la théorie classique des ensembles, par exemple, l’axiome du choix est un indécidable : la théorie ne permet ni de le démontrer, ni de démontrer sa négation. Bien d’autres formules faisant appel à des infinis sont également des indécidables

de cette théorie. En fait, toute théorie non contradictoire et capable de manipuler l’arithmétique élémentaire – nous appellerons cela une « théorie satisfaisante » – sera dans l’incapacité de démontrer certaines affirmations ne portant que sur les nombres entiers. En particulier, elle ne pourra jamais établir qu’elle est elle-même non contradictoire. Ces étonnants résultats, démontrés en 1931, constituent les célèbres théorèmes d’incomplétude de Kurt Gödel.

Il y a par ailleurs des résultats concernant les méthodes algorithmiques, c’est-à-dire programmables

sur ordinateur. Ces résultats indiquent que certaines fonctions F, pourtant parfaitement définies, ne pourront jamais être programmées – autrement dit, on ne pourra jamais écrire un programme informatique qui, pour toute entrée valide d, calcule la valeur de F ( d ). On dit que la fonction F est « incalculable », et on parle alors d’« indécidabilité algorithmique ». On peut par exemple définir la fonction F qui associe à tout programme informatique Pr la valeur 0 si Pr finit par arriver au bout de son calcul, et la valeur 1 si au contraire Pr ne s’arrête jamais de calculer. Cette fonction est incalculable.

Dans le jeu de la vie, inventé en 1970 par le mathématicien britannique John Horton Conway (1937-2020), tout se passe sur une grille carrée infinie dont chaque case (ou « cellule ») est soit vivante, soit morte. Le temps se déroule par pas discrets appelés « étapes » ou « générations ». À l’étape 0, toutes les cellules sont mortes sauf un nombre fini d’entre elles. Lorsqu’on passe de l’étape n à l’étape n + 1, chaque case C change ou non d’état en fonction de la configuration des huit cases qui l’entourent :

– Si C est morte à l’étape n et que trois des huit cases qui l’entourent sont vivantes à l’étape n, C devient vivante à l’étape n + 1. On dit que la règle est : « naissance si 3 ».

– Si C est vivante à l’étape n et deux ou trois des huit cases qui l’entourent sont vivantes à l’étape n, C reste vivante à l’étape n + 1. On dit « survie si 2 ou 3 ». – Dans tous les autres cas, C est morte à l’étape n + 1.

L’étude de ce jeu a produit des résultats extraordinaires. En particulier, il existe

des configurations de départ du jeu qui sont équivalentes à des calculateurs universels, c’est-à-dire des systèmes capables de simuler toute fonction calculable par algorithme.

Conséquence de cette universalité du jeu : le devenir ultime d’une configuration est indécidable. Autrement dit, il n’existe pas d’algorithme qui, partant de n’importe quelle condition initiale, indique si le jeu de la vie aboutit à une configuration où toutes les cases sont mortes, ou si au contraire la grille continue à évoluer indéfiniment. Les dispositifs physiques simulant les règles du jeu de la vie sont donc l’objet d’indécidabilité.

Le dessin ci-contre représente l’évolution d’une configuration possédant 3 465 cellules vivantes (en noir) dans la situation initiale, et telle que toutes les cellules sont mortes à l’étape 64. On représente les étapes 0, 1, 5, 10, 20, 30, 50 et 63.

Loïc Mangin

Jean Painlevé, artiste et fondateur du documentaire scientifique, fait l’objet d’une rétrospective. L’occasion de découvrir une œuvre admirée par les surréalistes.

tout aurait commencé à Roscoff, dans le Finistère, en 1911, quand un enfant de 9 ans visitant l’aquarium de la station biologique s’extasie devant une pieuvre : « Je pense qu’elle est à la base de ma vocation », dira plus tard le garçon devenu adulte. Celui qui s’exprime est Jean Painlevé, biologiste spécialisé dans la faune sous-marine et surtout père fondateur du cinéma scientifique à qui l’on doit plus de deux cents documentaires. Le musée de Pont-Aven lui consacre une rétrospective conçue et organisée en collaboration avec le Jeu de paume, à Paris.

L’œuvre navigue entre deux eaux, celles de la science et de l’art. Qu’il filme un oursin, un œuf d’épinoche, un hippocampe… Jean Painlevé est d’abord soucieux d’exactitude pour révéler les mystères, anatomiques et comportementaux, de ces organismes avec lesquels, en ce début de XXe siècle, le public est peu familier. Pour y parvenir, il multiplie les bricolages (optiques adaptées, épaulière pour caméra…) et recourt

Loïc Mangin

rédacteur en chef adjoint à Pour la Science

À VOIR

« Jean Painlevé, les pieds dans l’eau », au musée de Pont-Aven (29), jusqu’au 31 mai 2026. www.museepontaven.fr

à de nombreuses techniques, comme le ralenti, l’accéléré, le changement d’échelle… pour en fin de compte rendre visible l’invisible. L’aspect pédagogique est renforcé par des informations distillées entre les plans.

Cependant, il a aussi à cœur de partager son émerveillement et son émotion face à la faune aquatique en laissant dans ses images une place importante à la poésie de l’étrange que les organismes filmés portent en eux. De fait, André Breton, et avec lui tout le mouvement surréaliste, admiraient la vision plastique et évocatrice de ses films, « le seul public sur lequel je puisse compter », selon Painlevé. Il restera toute sa vie proche des milieux artistiques, notamment de son ami Alexander Calder.

Un artiste inclassable, donc, et au départ méprisé par le monde scientifique pour qui le cinéma ne peut prétendre être un outil d’observation. Ainsi, en 1925, alors qu’il est étudiant en anatomie comparée, il présente à l’Académie des sciences son premier film sur le développement de l’œuf d’épinoche. Un des spectateurs s’enflamme : « Un scandale ! Le cinéma c’est de la prostitution ! » Pour défendre ce cinéma scientifique naissant, Painlevé fonde en 1930 l’Institut de cinématographie scientifique avec l’appui de Jean Perrin, Frédéric Joliot-Curie… Mais la reconnaissance viendra bien plus tard.

Ce n’est que justice si l’on regarde son documentaire le plus célèbre, consacré à l’hippocampe, réalisé en 1932 (voir page ci-contre). On y découvre toutes les caractéristiques de l’animal : morphologie, locomotion… et surtout la reproduction avec l’accouchement des juvéniles assuré par le mâle. Cette étrangeté fit dire à Painlevé : « Les opérations de la gestation se passent chez le mâle avec une telle apparence de maternité qu’on se demande, vraiment, si le fait de produire des spermatozoïdes suffit pour maintenir le nom de mâle ou de père. » En gros plan, on découvre aussi les étapes du développement de ce poisson si particulier.

Une fois les vertus du cinéma scientifique reconnues, Painlevé œuvrera avec des zoologistes, mais aussi avec des médecins, des mathématiciens, des physiciens. Ainsi, dans les années 1970, il travaillera à plusieurs films sur les transitions de phases dans les cristaux liquides, avec Yves Bouligand, spécialiste des structures organisées de la matière vivante. Qu’en est-il aujourd’hui des liens entre cinéma et science ? Momoko Seto, réalisatrice scientifique au CNRS, à qui l’on doit Planètes, primé au festival de Cannes en 2025 et sorti en mars 2026, résume sa position : « Un des buts dans ma vie, c’est d’être le Jean Painlevé du XXIe siècle. » n

Entretien avec Francis Albarède

Archéologie

« Athènes n’aurait jamais été Athènes sans ses mines d’argent »

Plus que l’or ou le cuivre, l’argent est le métal monétaire par excellence. À vous lire, on comprend pourquoi : il a le profil idéal.

circuit commercial. On ne peut pas séparer les deux.

Quel est le lien entre l’argent et les grandes civilisations antiques de la Méditerranée ?

Athènes n’aurait jamais été Athènes sans les mines du Laurion, au sud de l’Attique. Ce sont des mines de sulfure de plomb dans lequel il peut y avoir jusqu’à 1 % d’argent. L’argent natif est rarissime. Géologiquement, il est étroitement associé au plomb, en particulier dans les minerais situés en zone volcanique. La Méditerranée a été bénie des dieux, Cosmologie

Sébastien Carassou et Jean-Philippe Uzan, Les Arènes, 2026 412 pages, 23 euros « Ces clichés ont nécessité la synchronisation de huit observatoires terrestres, formant un télescope virtuel de la taille de la Terre, capable de distinguer un beignet posé sur la Lune. » Voilà le type de prouesse que doivent réaliser les astrophysiciens, tant les échelles de temps et d’espace qu’ils étudient sont démesurées ! Cet ouvrage offre un voyage fascinant à travers leurs découvertes, tout en insistant sur les failles des grands modèles, germes des révolutions scientifiques de demain.

On a d’abord essayé de produire des monnaies en or, mais ce métal est trop rare. Qui irait acheter son croissant avec un fragment d’or ? L’argent a cette première qualité : il y en avait suffisamment dans les mines antiques – de l’ordre de quarante fois plus que l’or – pour que tout le monde puisse en avoir un peu. C’est un métal qui ne s’altère pas, assez dur et résistant pour circuler de main en main, et – j’insiste –qui existe en quantité suffisante pour satisfaire des besoins importants. Sa deuxième qualité est son caractère foncièrement inutile. Il est prestigieux comme objet funéraire ou décoratif, mais on ne fait ni épées ni outils agricoles en argent, ni rien d’indispensable. Ces deux qualités expliquent pourquoi, à partir de 550-530 avant notre ère, le monde eurasiatique a orienté une partie des ressources en ce métal vers la fabrication de monnaie.

Quel fut le moteur de la création de la monnaie : le commerce ?

Ou la guerre ?

C’est une chose dont je discute souvent avec les historiens. Je leur

La Naissance de l’argent. Le métal qui a changé le cours de l’histoire

Francis Albarède Dunod, 2026

336 pages, 23 euros

Toutefois, ils sont très gentils avec moi, car j’ai des choses à leur apporter. Comme aimait à le rappeler un professeur de Yale : aucun domaine de la science n’est immunisé contre l’intrusion de la géochimie ! Je dispose de techniques d’analyse auxquelles notre laboratoire de l’École normale supérieure de Lyon a beaucoup contribué. Elles permettent de mesurer les isotopes du plomb et de l’argent, à la fois dans les pièces et dans le minerai des anciennes mines ; quand on fait correspondre les signatures isotopiques des pièces avec celles du minerai, on peut tracer le déplacement de la richesse d’un endroit à un autre, et donc reconstituer les échanges économiques. À la surprise de tous, nous avons démontré que l’essentiel de l’argent de l’énorme trésor pillé par Alexandre le Grand dans les palais perses avait été extrait de la mer Égée et capté sous forme de tributs. Et quand je dis énorme, je parle de l’équivalent de 150 poids lourds de 35 tonnes… Autre acquis : nous avons montré que la victoire de Rome sur Carthage lors de la Seconde Guerre punique a été possible grâce aux quantités invraisemblables d’argent récupérées par les Romains après les sièges de Capoue et de Syracuse.

Patrick Clervoy, Odile Jacob, 2026 288 pages, 23,90 euros

Dans le contexte géopolitique actuel, cet ouvrage est d’une douloureuse actualité. Patrick Clervoy, psychiatre auprès des armées, nous y décrit les épreuves et les transformations psychiques que traversent les soldats. Il rappelle au passage que l’horreur de la guerre ne s’arrête pas avec la fin des combats – en témoignent les nombreux suicides de vétérans, qui ont causé plus de morts que les affrontements directs au sein de l’armée américaine au XXIe siècle.

dis : payer une armée de 50 000 ou 60 000 hommes avec de l’argent en vrac, c’est compliqué. Primo, il vous faut prouver que c’est de l’argent pur. Deuzio, il faudra peser cet argent – imaginez 60 000 hommes qui font la queue pour se faire payer… Tandis qu’avec la monnaie, vous n’avez pas besoin de peser, et si la confiance est établie vous n’avez pas besoin de démontrer la pureté. Son invention, au VIe siècle avant notre ère, fait alors exploser le commerce, comme on le constate avec le nombre d’épaves de navires marchands découvertes. En définitive, commerce et mercenariat sont liés. Quand un mercenaire rentre chez lui, qu’est-ce qu’il fait ? Il dépense son argent, et cela s’intègre dans un

Sabrina Krief, Grasset, 2026 240 pages, 20 euros

Fondatrice d’un centre de recherche et de conservation en Ouganda, la primatologue Sabrina Krief étudie les chimpanzés sauvages depuis plus de trente ans. Après avoir décrit le patient travail d’une éthologue de terrain, elle nous présente quelques-uns d’entre eux avec un sens aigu du portrait, où transparaît tant la richesse de leurs comportements que la singularité de chacun : Aragon le percussionniste, Kitaka l’empathique, Woody le bricoleur… Un témoignage exceptionnel.

si je puis dire, parce qu’elle disposait de cet argent de par l’activité tectonique et volcanique dans la région. C’est un endroit unique dans le monde. Si de nombreuses civilisations s’y sont développées, c’est parce qu’on y trouve la plus grande source d’argent qui existait à cette époque-là !

Le plomb était un sous-produit de l’extraction de l’argent. Faut-il en conclure que Rome n’aurait jamais autant utilisé ce métal si elle n’avait pas frappé de deniers d’argent ?

Le plomb est arrivé assez tard à Rome, où l’on trouve énormément de tuyaux de canalisation dans ce métal. Il était aussi utilisé sous forme de plaques pour protéger les carènes des bateaux. Vous avez raison, le plomb est bien un sous-produit minier auquel il a fallu trouver un emploi. Son succès est donc intimement lié à celui de l’argent.

Comme géochimiste, de quelle façon contribuez-vous à la connaissance de l’histoire de l’argent en Occident ?

Je n’ai pas de légitimité comme historien. Si je l’oubliais, mes collègues historiens ne se priveraient pas de me le rappeler !

Qu’est-ce qui vous a amené à l’étude de l’économie antique, domaine dont vous n’êtes pas expert ?

Il y a des scientifiques qui aiment la spécialisation – c’est même vivement encouragé par le milieu –, et d’autres prêts à adopter les principes de base d’autres disciplines. Je fais partie de ceux-ci. Je vois dans la géochimie une forme simplifiée de l’économie. En économie, tout peut être représenté en termes de stocks, par exemple les richesses, et de flux, par exemple les salaires, la consommation, etc. On doit établir des bilans, calculer des dettes. La géochimie sait gérer cela, d’autant que nous avons des techniques mathématiques assez proches de celles des économistes.

Propos recueillis par Olivier Voizeux

Francis Albarède géochimiste, professeur émérite à l’ENS de Lyon et membre de l’Académie des sciences. Il est porteur du projet européen SILVER, qui vise à étudier la composition des pièces d’argent des mondes antiques.

Mathématiques

Sylvia Serfaty Flammarion, 2026 224 pages, 20 euros

Agronomie

Quel chocolat pour demain ?

Katherine Khodorowsky Dunod, 2026 224 pages, 17,90 euros

La découverte d’un nouveau fossile de la fin du Jurassique

Tout le monde connaît l’ar chéoptéryx (« aile ancienne »), trouvé en 1861 dans le calcaire lithogra phique de Bavière et décrit par le paléontologue allemand Hermann von Meyer sous le nom d’Archaeop teryx lithographica . Charles Darwin a vu dans ce fossile, que l’on date aujourd’hui de la fin du Jurassique, il y a environ 150 millions d’années, une « forme transitoire » entre les reptiles et les oiseaux. De fait, c’est grâce à cet animal qu’on a commencé à penser que les oiseaux pourraient descendre des dinosaures, alors considérés comme des reptiles. De la taille d’un pigeon, il présente des ailes pourvues de plumes, et tous les ana tomistes s’accordent pour affirmer qu’il pouvait pratiquer le vol battu.

L’archéoptéryx possède bien sûr des caractères archaïques, comme les ailes ornées de trois longues griffes et

L’AUTEUR

Hervé Le Guyader professeur honoraire de biologie évolutive à Sorbonne Université, à Paris

Busautour pâle

(Butastur liventer)

Taille : 41 cm

Envergure : 83 à 91 cm

Poids : 336 à 340 g

6

C’est le nombre de paires de rectrices que portent la plupart des oiseaux (dont le busautour pâle). Portées par le pygostyle ou croupion, ces plumes leur servent de gouvernail de vol et d’aérofrein pour l’atterrissage.

5

Le pygostyle de Baminornis zhenghensis, le nouveau fossile d’oiseau archaïque exhumé, est constitué de 5 vertèbres soudées.

100

La traîne du paon compte plus de 100 plumes et mesure jusqu’à 1,5 mètre. Le pygostyle de l’oiseau porte aussi une vingtaine de rectrices brunes plus courtes.

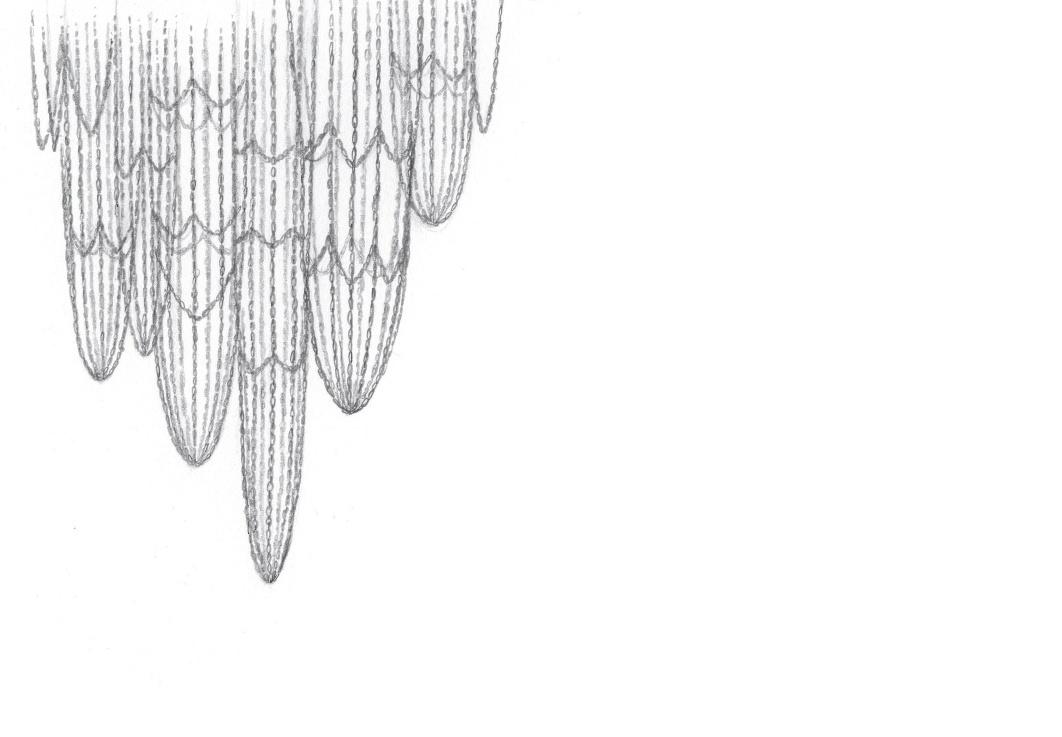

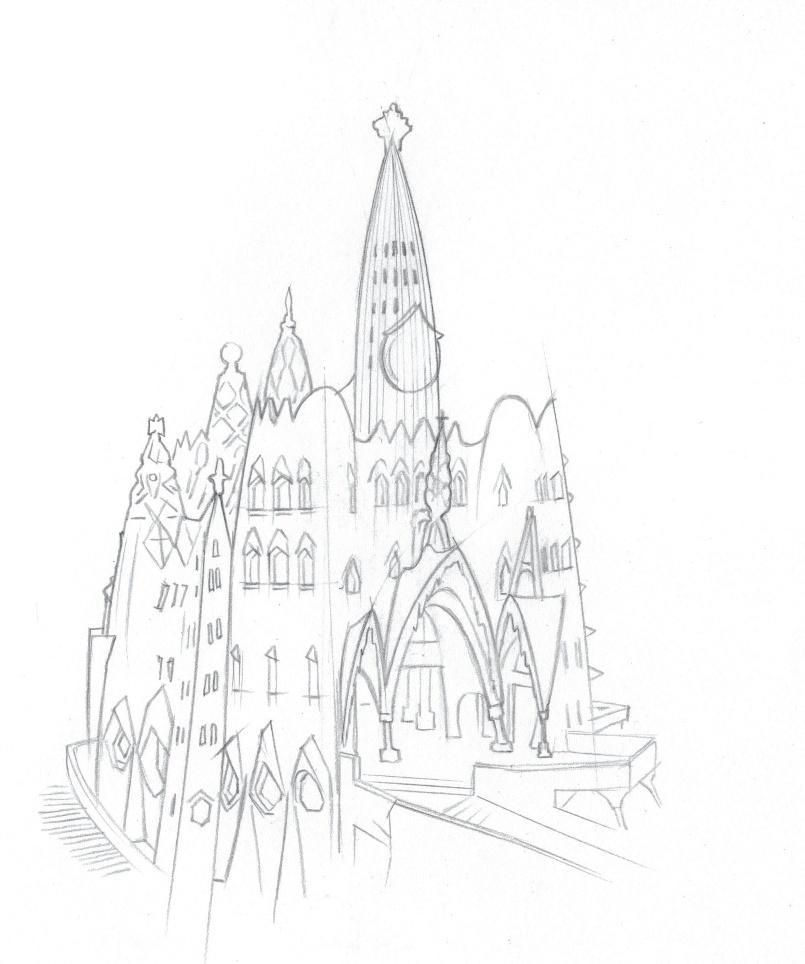

Pour concevoir voûtes, arches et ponts, les architectes peuvent s’appuyer sur deux courbes : la parabole et la chaînette. Cette dernière, plus rare, est au cœur d’œuvres d’Antoni Gaudí comme la Sagrada Familia.

pour imaginer la forme des voûtes et des colonnes de son grand œuvre, la Sagrada Familia, à Barcelone, l’architecte espagnol Antoni Gaudí a mis au point une méthode pour le moins étonnante. Il a confectionné un modèle renversé de l’édifice au moyen de fils entrelacés et lestés de petits sacs. Quelle idée saugrenue ! Comment la forme d’équilibre de ce dispositif peut-elle inspirer une architecture ? La physique nous permet d’élucider ce mystère.

Pour concevoir un ouvrage d’art ou un bâtiment, l’architecte doit s’interroger sur les types d’efforts auxquels les matériaux de construction seront soumis et comment ils réagiront. Il n’a que l’embarras du choix

LES AUTEURS

Jean-Michel Courty professeur de physique à Sorbonne Université, au laboratoire Kastler-Brossel

Édouard Kierlik professeur de physique à Sorbonne Université, au LPTMC (CNRS, SU)

entre la traction, la compression, la flexion, le cisaillement et la torsion. Si l’acier subit assez bien tous ces types de contraintes, ce n’est pas le cas de la pierre qui ne résiste bien qu’à la compression. Pour construire en pierre, il importe donc que les efforts soient uniquement (au moins essentiellement) des efforts de ce type.

C’est aisé pour un mur de pierres empilées, mais dès que l’on cherche à y ménager une porte ou une fenêtre, ou bien à fabriquer un pont ou un toit, cela se complique. Une solution commode est d’utiliser un autre matériau, le bois par exemple, qui résiste mieux à la flexion. Ainsi, pour les petites ouvertures, une poutre suffit pour un linteau qui porte le poids du mur au-dessus de l’ouverture.

Pour des portées plus grandes, des charpentes plus complexes sont indispensables. Mais la taille ou la résistance aux efforts restent nécessairement limitées. Qu’en est-il pour les grands ouvrages ? La solution est sous nos yeux : il faut prévoir des arches ou des voûtes. Mais quelle forme leur donner pour s’assurer que le matériau qui les constitue travaille en

compression ? La physique offre une solution élégante : renverser le problème et s’intéresser aux structures composées de fils, câbles ou cordes.

La ballade des suspendus

L’idée est qu’en architecture, l’origine de toutes les contraintes provient du poids des matériaux, toujours dirigé selon la verticale vers le bas. Si, par la pensée, nous inversons la direction de la gravité en conservant la géométrie de la structure – en supposant bien sûr qu’elle garde sa cohésion –tous les efforts internes sont renversés et en particulier les compressions vont devenir des tractions et vice versa Or les fils, câbles ou ficelles, s’ils sont tendus, ont la propriété de ne travailler qu’en tension c’est-à-dire en traction ! Le tour est joué, car contrairement aux structures en compression pour lesquelles il faut définir à l’avance la forme pour éviter qu’elles ne s’effondrent, dans une structure suspendue souple, c’est l’action des forces, en l’occurrence le poids et la tension des câbles, qui détermine la forme d’équilibre. Il suffit donc de suspendre et d’observer le résultat,

Pour plusieurs de ses œuvres, notamment l’intérieur de la Sagrada Familia, l’architecte espagnol Antoni Gaudí s’est inspiré des formes que prennent des chaînes suspendues par leurs extrémités.

Une courbe dont l’équation est y(x) = a ⨯ cosh(x/a), ou bien a ⨯ (e x/a + e – x/a). 2

Robert Hooke comprend que « la forme d’une chaîne souple suspendue est, une fois renversée, celle d’une arche rigide en équilibre ».

Dans un pont suspendu, ces câbles verticaux relient le tablier au câble porteur.

inspiration géniale qu’a eue Gaudí à la fin du XIX e siècle.

Étudions la forme d’un fil lesté par des poids et que l’on maintient à ses extrémités. On peut envisager deux configurations typiques : celle d’une chaîne composée de maillons identiques qui pend sous son propre poids et celle du pont suspendu dont le câble principal, le câble porteur, soutient le tablier et supporte donc son poids. Les deux courbes obtenues sont connues des mathématiciens.