EDITORIALE

Anno IX - N. 2 Febbraio 2026

Edizione mensile di Bio’s

Testata registrata al n. 113/2021 del Tribunale di Roma

Diffusione: www.fnob.it

Direttore responsabile: Vincenzo D’Anna

Questo magazine digitale è scaricabile on-line dal sito internet www.fnob.it

Questo numero del “Giornale dei Biologi” è stato chiuso in redazione il 26 febbraio 2026.

Gli articoli e le note firmate esprimono solo l’opinione dell’autore e non impegnano la Federazione Nazionale degli Ordini dei Biologi.

Immagine di copertina: @ Shutterstock AI/shutterstock.com

Si informano gli iscritti che gli uffici della Federazione forniranno informazioni telefoniche di carattere generale dal lunedì al giovedì dalle 9:00 alle ore 13:30 e dalle ore 15:00 alle ore 17:00. Il venerdì dalle ore 9:00 alle ore 13:00

Tutte le comunicazioni dovranno pervenire tramite posta (presso Federazione Nazionale degli Ordini dei Biologi, via Icilio 7, 00153 Roma) o all’indirizzo protocollo@cert.fnob.it, indicando nell’oggetto l’ufficio a cui la comunicazione è destinata.

È possibile recarsi presso le sedi della Federazione Nazionale degli Ordini dei Biologi previo appuntamento e soltanto qualora non sia possibile ricevere assistenza telematica. L’appuntamento va concordato con l’ufficio interessato tramite mail o telefono.

Centralino 06 57090 200

Ufficio protocollo protocollo@cert.fnob.it

di Vincenzo D’Anna

Presidente della Federazione Nazionale degli Ordini dei Biologi

Se non avessimo a soffrire dell’incomunicabilità, dell’indifferenza che una parte degli iscritti

all’Albo dei Biologi manifesta per le molteplici attività che la Federazione Nazionale degli Ordini, la Fondazione italiana e gli Ordini territoriali più attivi propongono agli iscritti, l’articolato progetto delle Scuole di Formazione permanenti sul campo sarebbe già noto a tutti.

E tuttavia così non è ancora, ancorché il numero degli accessi al sito istituzionale della FNOB (che fa registrare

mediamente oltre 350mila visualizzazioni al mese) sia sensibilmente aumentato e che, al contempo, l’ottanta per cento degli iscritti acceda all’Area Riservata dello stesso portale.

Farà piacere sapere - a coloro che già ne conoscono tipologia di attività e modalità di funzionamento, e spero anche a quanti solo adesso

Le Scuole di Formazione sono una realtà già funzionante per quella di Genetica e Genomica con sede in Roma

L’ammissione avverrà per avviso pubblico e le domande saranno vagliate da una Commissione di esperti del settore e dal direttore della Scuola

ne hanno avuto conoscenza - che tali Scuole sono, penso, una realtà già funzionante per quella di Genetica e Genomica con sede in Roma, e siano in procinto di partire per tutte le altre cinque. Queste ultime verranno inaugurate nel corso dell’anno e, repetita iuvant, riguardano: l’Embriologia Clinica e PMA (Roma); la Biologia Marina (Reggio Calabria); la Bioinformatica (Firenze); la Nutrizione Sportiva e quella Generale (Milano); il Biorestauro dei monumenti e delle opere d’arte (Pompei). Altre ne sa -

ranno aperte in Tossicologia Ambientale, Ecotossicologia e Sicurezza Alimentare.

Le domande che giungono più frequentemente da parte dei colleghi che si mostrano interessati sono prevalentemente due: come avviene l’ammissione alle scuole e se parteciparvi ha un costo. Ebbene, l’ammissione avverrà per avviso pubblico e le domande saranno vagliate da una Commissione di esperti del settore e dal direttore della Scuola, già individuato per competenza nel ramo. Gli oneri economici, minimi e volti alla copertura delle spese vive, saranno di gran lunga accessibili a tutti e molto più bassi di quelli che normalmente costa l’iscrizione ad un Master. Borse di studio, inoltre, ver -

ranno assegnate ai colleghi che saranno in possesso dei requisiti opportunamente individuati, per merito e per reddito, oltre che per la priorità che sarà valutata per i colleghi che avranno raggiunto il livello minimo di rating. Quest’ultimo, lo rammentiamo, è calcolato sulla base delle frequenze di accesso ai canali di informazione della Federazione e della partecipazione agli eventi scientifici patrocinati oppure organizzati dalla medesima.

La terza domanda, credo la più dirimente, è quella che chiede quale scopo e quale utilità abbiano le iniziative fin qui illustrate. La risposta è semplice: permettere ai colleghi inesperti in un determinato campo di esercizio della professione, ossia

quelli indicati, l’acquisizione di una capacità operativa, di una minima pratica professionalizzante acquisita sul campo dell’applicazione.

L’introduzione a breve dei

Decreti Interministeriali, contenenti la nuova normativa riguardante l’aggiornamento e l’implementazione delle competenze professionali assegnate ai Biologi, varrà come ulteriore stimolo a fare pratica di "esercizio" nelle nuove acquisizioni di competenze professionali. Non è esagerato affermare che stiamo transitando, come categoria, nel Terzo

L’introduzione a breve dei Decreti Interministeriali varrà come ulteriore stimolo a fare pratica di "esercizio" nelle nuove competenze

Nessuno sarà lasciato in balia dell’indeterminatezza sulle scelte che potrà fare. In fondo il nostro compito è quello di guidare i colleghi

Millennio di una professione che si espande continuamente e che, assecondata con la teoria e la pratica, dischiuderà a centinaia di nuovi iscritti prospettive di inserimento lavorativo impensabili e insperate. Ma non è che l’inizio e ci attrezziamo a dare tutele giuridiche e nuovi saperi a coloro che dovranno attraversare questo secolo.

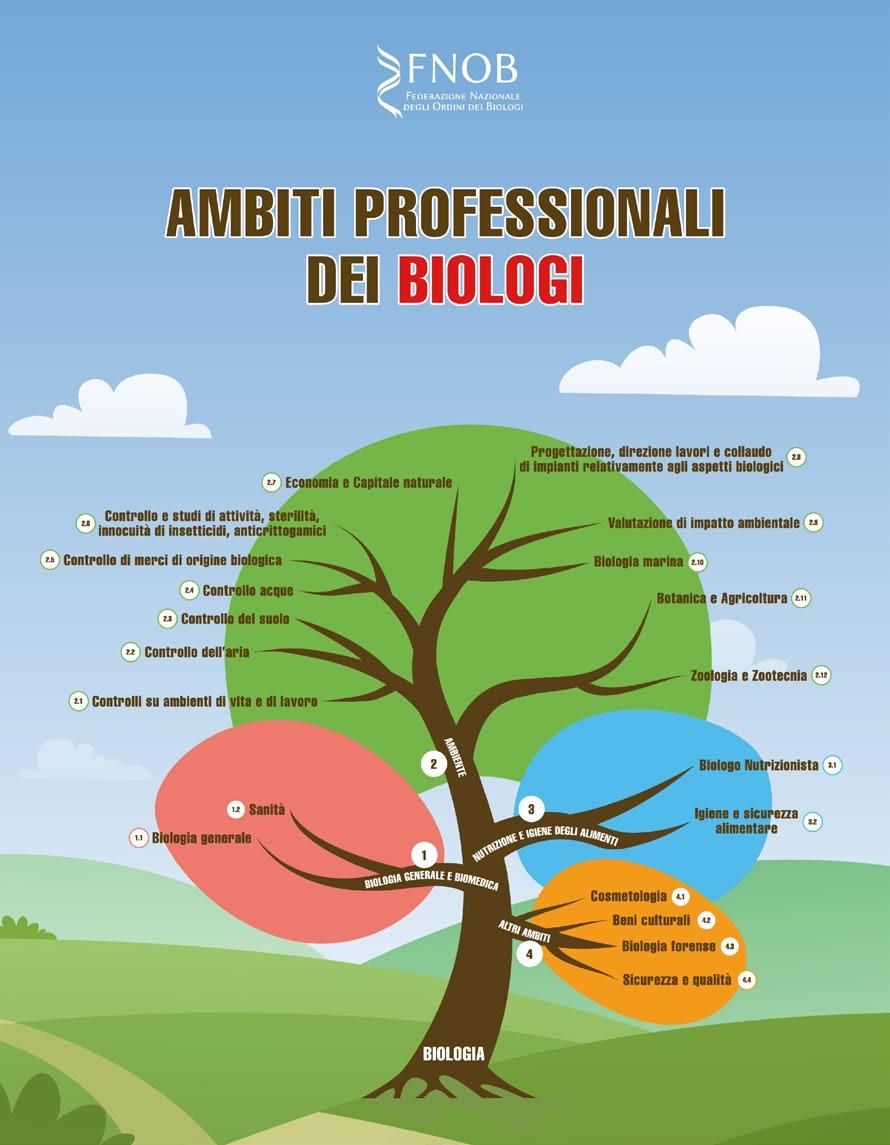

E per indicare le nuove strade - dopo aver ampliato e ammodernato quelle già battute nel secolo scorsopresenteremo l'Albero delle opportunità con l’ausilio

dell’intelligenza artificiale. I giovani e coloro che, meno giovani, intendono cambiare ambito di esercizio professionale potranno consultare tale "modello" con l’ausilio di un Avatar che indicherà a ciascuno una delle ottanta diverse possibilità di inserimento nel mondo del lavoro. All'inizio di ogni sentiero gli interpellanti troveranno un filmato prodotto da un autorevole collega che indica e spiega le opportunità, le difficoltà, gli inserimenti nel mondo delle professioni. Nessuno sarà lasciato in balia dell’indeterminatezza sulle scelte che potrà fare. In fondo il nostro compito è quello di guidare e di accompagnare i colleghi a vincere la battaglia con l'esistenza, sotto la tazza capovolta del cielo.

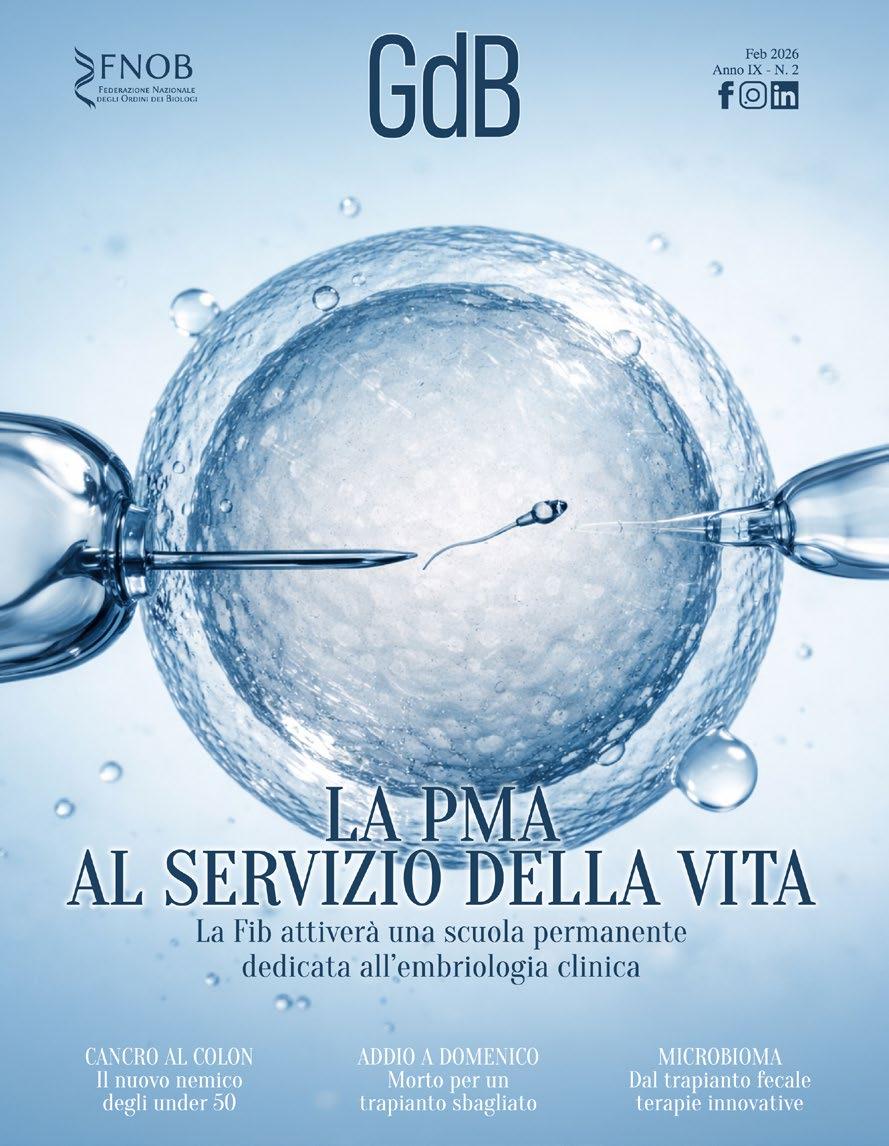

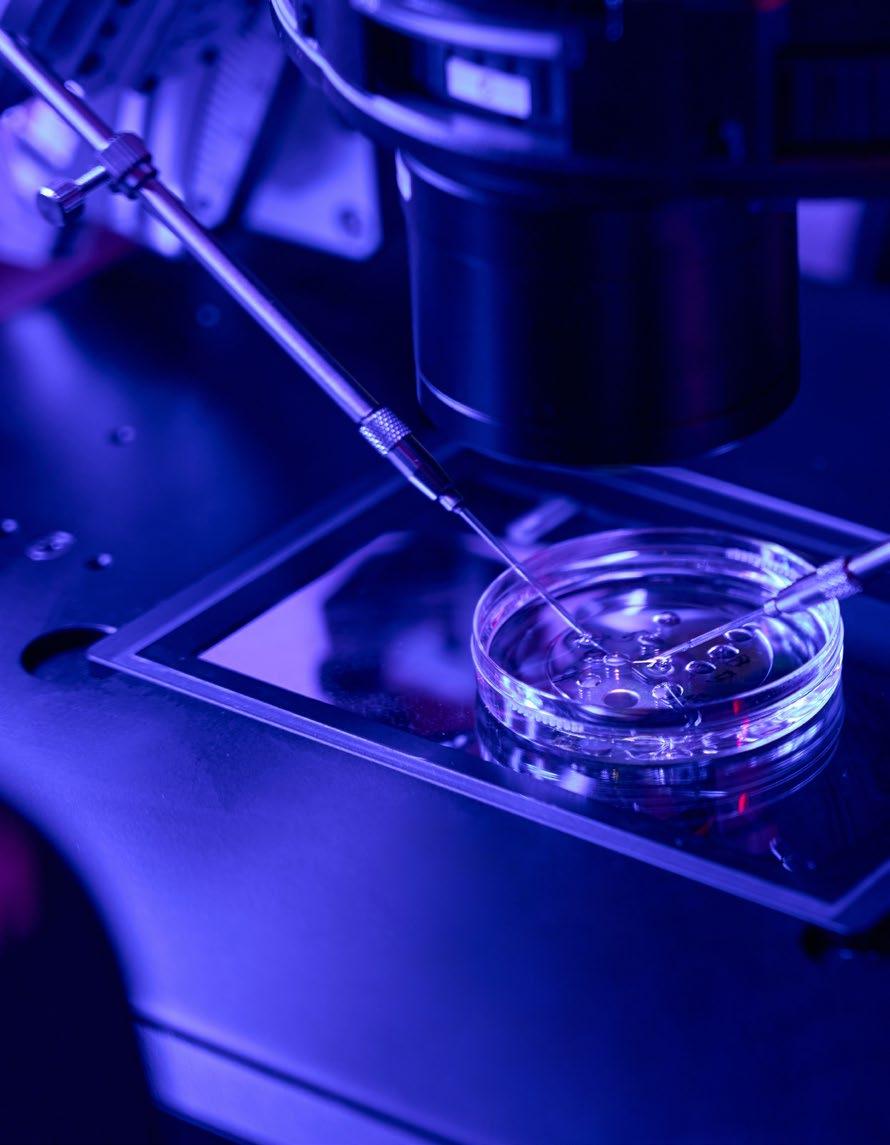

Procedure di laboratorio, gestione di gameti ed embrioni, tecniche di fecondazione: presto l'attivazione di una scuola permanente dedicata al settore da parte della Fib

©YAKOBCHUKVIACHESLAV/shutterstock.com

LA FONDAZIONE ITALIANA BIOLOGI SI OCCUPA DI PROMUOVERE LA RICERCA

SCIENTIFICA, LA FORMAZIONE

PROFESSIONALE E DI VALORIZZARE

L'IMMAGINE DELLA CATEGORIA, AFFINCHÉ I BIOLOGI POSSANO

RICEVERE UN'ACCURATA

PREPARAZIONE SCIENTIFICA E PRATICA

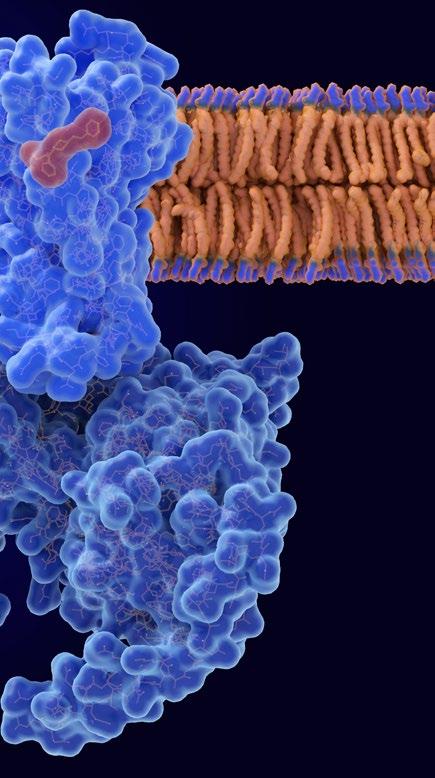

Una Scuola permamente dedicata all'Embriologia clinica, disciplina in cui il ruolo dei biologi è attivo, preminente ed essenziale. La attiverà presto la Fib, la Fondazione Italiana Biologi, costola operativa della FNOB che si occupa di promuovere la ricerca scientifica, la formazione professionale e di valorizzare l'immagine della categoria, affinché i biologi possano ricevere un'accurata preparazione scientifica e pratica in questo settore cruciale.

Il progetto preliminare è nero su bianco, con le sedi per i tirocini che coinvolgono strutture pubbliche e private e il gruppo di coordinamento scientifico e organizzativo già all'opera con la definizione dei moduli per le 100 ore di docenza frontale e le 150 di frequentazione nelle sedi coinvolte per i tirocini pratici. Un corso senza oneri a carico della Federazione Nazionale degli Ordini dei Biologi e la cui partecipazione avverrà a titolo gratuito, senza corresponsione di quote di iscrizione da parte dei partecipanti.

Alla figura del biologo della riproduzione fanno capo le responsabilità delle procedure di laboratorio nella PMA, la procreazione medicalmente assisita, la gestione di gameti ed embrioni, l'esecuzione delle diverse tecniche di fecondazione. Si tratta di un ruolo centrale, determinante. Il biologo, in base alla sua preparazione ed esperienza, sceglie gli strumenti, i terreni di coltura e i materiali più adatti per i gameti e gli embrioni, seleziona gli spermatozoi, prepara gli embrioni per il trasferimento all'interno dell'utero, ma anche i trattamenti specifici per il trattamento dei gameti maschili e femminili allo scopo di

IL BIOLOGO SPECIALISTA IN EMBRIOLOGIA CLINICA È IL

PROFESSIONISTA DI RIFERIMENTO PER LE COPPIE CHE

HANNO DIFFICOLTÀ NEL CONCEPIMENTO O CHE SONO ALLE

PRESE CON DIAGNOSI DI INFERTILITÀ, CON PROBLEMATICHE

GENETICHE CHE IMPEDISCONO LA PROSECUZIONE DI UNA

GRAVIDANZA AVVIATA, POLIABORTIVITÀ E CON ALTRI TIPI DI

OSTACOLI ALLE LORO LEGITTIME ASPIRAZIONI

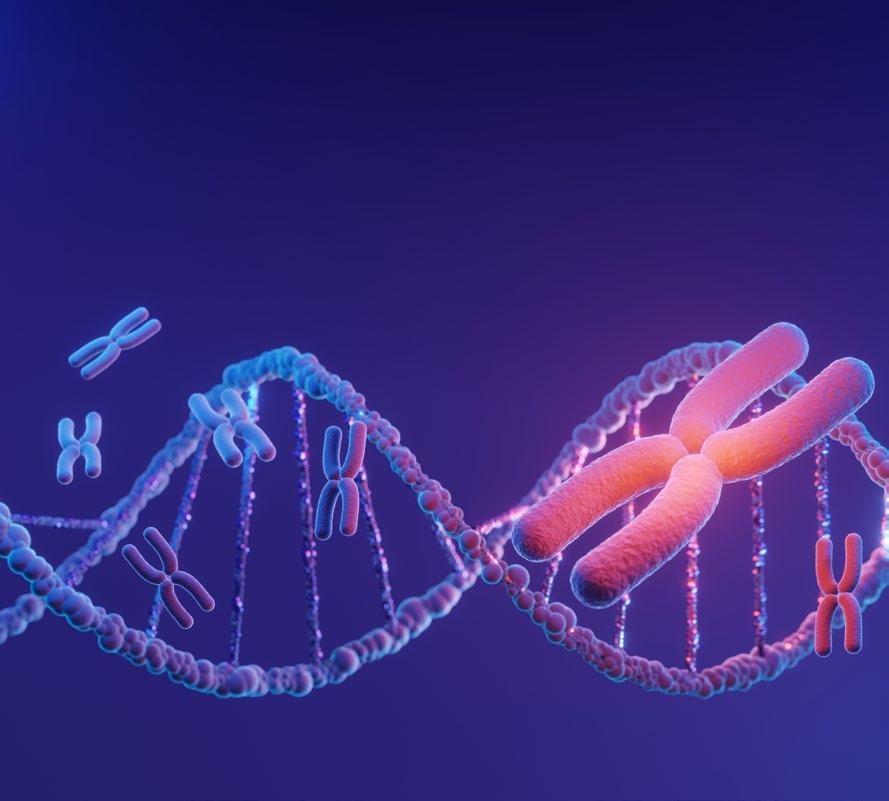

ottenere la fecondazione in vitro e la successiva formazione e trasferimento dell'embrione in utero. Non solo. Col perfezionarsi delle procedure di ricerca genetica, l'embriologo clinico (che è sinonimo di biologo della riproduzione) riveste un ruolo cruciale anche nell'individuazione dei disordini genetici alla base di malattie trasmissibili note o delle aneuploidie (alterazioni del numero dei cromosomi) di embrioni e gameti.

Il biologo specialista in Embriologia clinica, dunque, è il professionista di riferimento per le coppie che hanno difficoltà nel concepimento o che sono alle prese con diagnosi di infertilità, con problematiche genetiche che impediscono la prosecuzione di una gravidanza avviata, poliabortività e con altri tipi di ostacoli alle loro legittime aspirazioni.

L'OMS considera l'infertilità una patologia e suggerisce accertamenti se non si arriva al concepimento dopo 12 mesi di rapporti regolari e non protetti, che scendono a sei in caso la donna abbia un'età superiore a 35 anni o in presenza di fattori di rischio quali precedenti interventi chirurgici, infezioni uterine o particolari patologie. Anche in questo ambito, naturalmente, più tempestiva è la diagnosi, più alta è la percentuale di successo degli interventi.

Ma come funziona la PMA e quali sono le tecniche e i trattamenti messi in campo per favorire o garantire lo sviluppo di una gravidanza? Le tecniche di procreazione medicalmente assistita si distinguono in tre livelli. Del primo fa parte l'inseminazione intrauterina, dove il liquido seminale viene preparato in laboratorio e depositato all'interno dell'utero al fine di aumentare la densità dei gameti, facilitando l'incontro tra spermatozoi e ovocita. La percentuale di successo è del 10-20% per ogni ciclo. Al secondo appartengono le tecniche di inseminazione in vitro, basate sul prelievo chirurgico degli spermatozoi e la crioconservazione di

gameti maschili, femminili ed embrioni.

Nella FIVET gli ovociti e gli spermatozoi vengono messi a contatto su piastre, favorendo la fecondazione del gamete femminile attraverso l'ingresso spontaneo dello spermatozoo. Le probabilità di successo vanno dal 30-45% per le donne più giovani al 10% per le donne over 43, ma salgono al 90% dopo tre cicli di trattamento. Nella ICSI, che si adotta nei casi di infertilità maschile più severi o in caso di insuccesso della tecnica FIVET, lo spermatozoo è iniettato direttamente all'interno dell'ovocita. La percentuale di succeso della fecondazione è del 30-50%, che sale al 75% dopo tre cicli.

Mentre le tecniche di secondo livello sono eseguibili in anestesia locale, quelle di terzo livello necessitano di anestesia generale con intubazione e prevedono il prelievo microchirurgico di gameti dal testicolo, il prelievo degli ovociti per via laparoscopica e il trasferimento intratubarico dei gameti maschili

e femminili (GIFT) per via laparoscopica, con percentuali di successo del 30-50% che però scendono drasticamente dopo i 40 anni.

Dal 2014 in Italia è consentita la fecondazione eterologa, che prevede il ricorso a ovulo o seme di donatori esterni alla coppia: nel caso di ovulo e seme interni alla coppia si parla di fecondazione omologa.

Alla fecondazione eterologa, riservata a coppie eterosessuali maggiorenni, conviventi o sposate, si può ricorrere in presenza di sterilità assoluta femminile (menopausa precoce) o maschile (assenza di spermatozoi) certificate, ma anche dopo ripetuti fallimenti di tecniche di fecondazione omologa o in caso di rischio che il nascituro possa sviluppare malattie genetiche. Il limite di età per la donna per questo tipo di trattamenti è 46 anni. Sempre dal 2014 è consentito l'utilizzo di embrioni e ovociti crioconservati attraverso tecniche quali FER e FO, precedentemente vietate dalla legge 40/2004.

Quando una donna non riesce a sviluppare una gravidanza si è portati a pensare che possa avere pro blemi di fertilità.

Più difficilmente, o solo in un secondo momento, l'attenzione si sposta sul partner. In realtà l'infertilità è questione che coinvolge tanto le donne quanto gli uomini. Soprattutto nei paesi industrializzati come l'Italia si fanno figli sempre più tardi.

Questo può influire sulla fecondazione e sulla buona riuscita di una gravidanza. Abbiamo visto, infatti, quanto l'età dell'aspirante madre sia rilevante nella buona riuscita dei trattamenti di Embriologia clinica e PMA.

Per l'uomo non è tanto l'anagrafe a contare, quanto la qualità spermatica. Soprattutto negli ultimi anni, sono sempre di più i giovani che mostrano segni di infertilità o comunque di ridotta capacità riproduttiva. Si stima che l'infertilità interessi il 7% della popolazione maschile, intendendo per infertilità una produzione insufficiente di spermatozoi o anomalie nella qualità degli spermatozoi prodotti.

Nei casi di sterilità, invece, c'è assenza totale di spermatozoi nel liquido seminale (azoospermia) oppure nel liquido seminale sono presenti spermatozoi morti (necrozoospermia).

Anche fattori ambientali sono coinvolti nella riduzione della conta degli

Negli ultimi anni la qualità spermatica è in peggioramento, in Italia e nel mondo, ed è più difficile procreare

spermatozoi. Stili di vita irregolari, inquinamento, sedentarietà, fumo e diete poco sane sembrano influenzare direttamente l'astenozoospermia, la condizione di cui soffrono uomini con un ridotto contenuto di spermatozoi mobili. Le cause dell'infertilità maschile possono dipendere da ragioni pre-testicolari (malattie endocrine, dell'ipotalamo o dell'ipofisi), testicolari (alterazioni nella produzione degli spermatozoi) o post-testicolari (alterazioni e disfunzioni sessuali).

Le condizioni che portano all'infertilità nell'uomo non hanno sintomi evidenti. Fa eccezione il varicocele, una dilatazione delle vene spermatiche interne che determina una concentrazione di sostanze tossiche, che spesso provoca una sensazione di fastidio o di peso a livello dello scroto. Le infiammazioni dei canali uroseminali sono invece accompagnate da bruciori e fastidi. Per la valutazione della fertilità maschile l'esame principale è costituito dallo spermiogramma, che consente di valutare volume, concentrazione, morfologia e viscosità dello sperma.

Il test di capacitazione valuta invece la capacità degli spermatozoi di sopravvivere a contatto con l'apparato riproduttivo femminile. Negli ultimi tempi sono sempre più prescritti esami genetici: analisi dei cromosomi, ricerca di microdelezioni del cromosoma Y, analisi di mutazioni geniche per la fibrosi cistica, che rappresentano le alterazioni genetiche più comuni associate a infertilità maschile. L'epigenetica, lo studio delle modificazioni strutturali del genoma che non alterano la sequenza del DNA, è cruciale nello studio dei problemi di infertilità maschile. Uno dei principali meccanismi epigenetici, la metilazione del DNA, è infatti un processo chiamato in causa nella spermatogenesi e in grado di influenzare direttamente la fertilità. (R. D.).

Riconosciuta come trattamento essenziale per la salute riproduttiva, ma restano ritardi e disuguaglianze

Da quando è stata autorizzata dalla legge 40/2004, la Procreazione Medicalmene Assisita ha consentito la nascita di più di 200mila bambini in Italia. Il Registro Nazionale della PMA, istituito presso l'Istituto Superiore di Sanità, ha certificato nel 2024 in 217mila le gravidanze a termine in venti anni, con una percentuale di succeso dei trattamenti via via più alta.

Numeri che testimoniano l'importanza della PMA e dei trattamenti a essa correlati e che potrebbero migliorare ancora nel prossimo futuro, visto che dal 2025 la PMA è stata inserita nei LEA, i livelli essenziali di assistenza del Servizio Sanitario Nazionale. Una svolta che dovrebbe garantire un accesso più equo e più generalizzato ai trattamenti, riducendo disparità territoriali ed economiche e offrendo delle possibilità in più a un numero maggiore di coppie. La PMA è stata riconosciuta come un trattamento essenziale per la salute riproduttiva.

La fecondazione assistita, sia omologa sia eterologa, deve essere erogata come prestazione ambulatoriale e non in regime di ricovero, con sei tentativi di PMA coperti dal SSN per le donne fino ai 46 anni, senza esclusione di tecniche, a costi uniformi per tutte le regioni. Tra i trattamenti garantiti quelli di inseminazione intrauterina (IUI), la fecondazione in vitro (FIVET) e l'iniezione intracitoplasmatica dello spermatozoo (ICSI). Restano esclusi dai LEA, invece, la diagnosi genetica preimpianto (PGT), la conservazione degli ovociti per motivi non strettamente medici oltre a specifici percorsi personalizzati con l'ausilio di tecnologie più avanzate, che rimangono disponibili presso strutture private.

L'inserimento della PMA nei LEA

non garantisce, purtroppo, uniformità su tutto il territorio nazionale: le prime applicazioni della nuova normativa evidenziano già differenze piuttosto significative tra le diverse regioni, soprattutto per quanto riguarda i tempi di attesa e di erogazione dei rimborsi. Una questione che non riguarda soltanto questo settore specifico, ma un po' tutte le prestazioni inserite nei LEA. Ecco perché in tanti continuano a rivolgersi alle strutture private. L'assenza di liste d'attesa, la possibilità di accedere a percorsi personalizzati e a tecniche specifiche sono fattori che inducono tante coppie a privilegiare cliniche e centri privati alle strutture pubbliche. Il rovescio

della medaglia è costituito dai costi. Per le strutture pubbliche o convenzionate è previsto il pagamento di un ticket, che può costare tra i 500 e i 1500 euro circa. Nel privato i prezzi lievitano in modo considerevole. L'inseminazione artificiale, tecnica di primo livello, costa generalmente tra i 1000 e i 1200 euro, mentre l'eterologa può arrivare fino a 5-6mila euro. Le tecniche di secondo livello quali la FIVET e l'ICSI, pur con differenze tra struttura e struttura, oscillano invece tra i 3.500 e i 5.500 euro. Sono costi che per molte coppie restano proibitivi: ecco perché la concreta applicazione della nuova normativa sulla PMA è quantomai auspicabile. (R. D.).

©

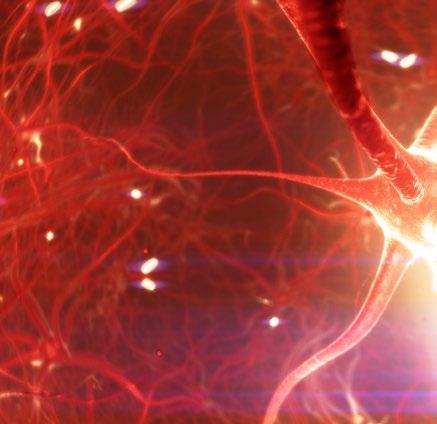

La storia del "piccolo guerriero", Domenico Caliendo, non è solo la cronaca di un lutto straziante, ma rappresenta un punto di rottura che impone una riflessione profonda all'intera comunità scientifica e istituzionale. È una vicenda iniziata nel cuore dell’inverno, il 23 dicembre, e conclusasi dopo sessanta giorni di agonia il 21 febbraio, sollevando interrogativi inquietanti sulla gestione della catena dei trapianti in Italia.

Quello che doveva essere un miracolo della medicina si è trasformato in un "fallimento sistemico", dove l’errore umano e procedurale ha annullato i benefici dell’innovazione tecnologica. Domenico, due anni e quattro mesi, era affetto da una miocardiopatia dilatativa congenita, una patologia severa che rende il trapianto l’unica opzione terapeutica risolutiva.

Dopo il ricovero avvenuto il 23 dicembre, la speranza si era accesa con l'individuazione di un donatore compatibile a Bolzano. Tuttavia, il passaggio dalla speranza alla tragedia è avvenuto durante il trasferimento dell'organo verso la struttura ospedaliera Monaldi di Napoli. Secondo quanto emerso dalle indagini condotte dai carabinieri del NAS guidati dal colonnello Alessandro Cisternino e dalla Procura di Napoli retta dal Procuratore Nicola Gratteri (l’inchiesta affidata al sostituto procuratore Giuseppe Tittaferrante con il procuratore aggiunto Antonio Ricci), il cuore

di Domenico è arrivato a destinazione compromesso in modo irreversibile.

Il termine tecnico emerso dalle informative è agghiacciante: un "cuore bruciato". La causa risiederebbe in una gestione errata della "catena del freddo". Invece del ghiaccio naturale o sintetico, utilizzato per mantenere l’organo in ischemia fredda a circa 4°C, sarebbe stato impiegato ghiaccio secco (anidride carbonica solida).

Il ghiaccio secco raggiunge temperature di -78,5°C, un freddo siderale incompatibile con la vita cellulare di un organo umano. In questo contesto, la biologia clinica e la medicina dei trapianti si interrogano sui protocolli di validazione.

Il ruolo dei biologi e dei patologi è cruciale: spetta a loro l'ispezione dei marker biochimici di danno miocardico e la valutazione della vitalità cellulare. L’organo è giunto a Napoli inglobato in un blocco di ghiaccio; i chirurghi hanno dovuto attendere circa 20 minuti solo per estrarlo e procedere al decongelamento. La cristallizzazione intracellulare, un fenomeno biologico devastante indotto dal gelo estremo, avrebbe causato la lisi delle membrane cellulari, rendendo il muscolo cardiaco una massa inerte.

L’aspetto più controverso dell’intera vicenda riguarda la dotazione tecnologica. Il Monaldi è un centro di eccellenza dotato (dal 2024) di dispositivi Organ Care System (OCS), che permettono la perfusione ossigenata e il monitoraggio costante della temperatura. Eppure, per il trasferimento da Bolzano, è stata utilizzata una box passiva di tipo tradizionale e obsoleta. Le indagini, anche gli audit interni del Monaldi, suggeriscono che vi fosse una grave carenza nella formazione del personale, non ancora addestrato all'uso delle tecnologie di ultima generazione.

Come sottolineato dall’avvocato della famiglia, Francesco Petruzzi, resta da chiarire «perché un centro di tale livello abbia permesso che un organo vitale viaggiasse in condizioni tecniche così precarie». Nonostante i sospetti immediati sull'integrità dell'organo, l'equipe medica ha deciso di procedere comunque con il trapianto poiché il cuore originario di Domenico era già stato espiantato e non vi erano alternative immediate. Il nuovo cuore, tuttavia, non ha mai ripreso a

battere autonomamente.

Per due mesi, Domenico è rimasto attaccato all’ECMO (Extracorporeal Membrane Oxygenation), una tecnica di supporto vitale avanzata che ha sostituito le funzioni del suo cuore inerte. È stato un periodo di attesa estenuante, durante il quale, paradossalmente, il 17 febbraio si era reso disponibile un altro cuore compatibile.

Tuttavia, il fisico del bambino era ormai troppo compromesso per sopportare un secondo intervento. Quel cuore ha poi ridato speranza a un altro piccolo paziente a Bergamo, a dimostrazione che il sistema dei trapianti, sebbene in questo caso abbia mostrato una falla fatale, resta un pilastro vitale della medicina moderna. Il 20 febbraio, di comune accordo tra medici e famiglia di Domenico, le terapie sono state sospese per evitare l'accanimento terapeutico.

La magistratura indaga ora per omicidio colposo con sei avvisi di garanzia già notificati. Ma il legale della famiglia Petruzzi ha dichiarato: «Dall'esame della cartella clinica ci sono tutti i presupposti per configurare il dolo eventuale, che comporta l'omicidio volontario». L’autopsia fornirà in ogni caso dati istopatologici essenziali, analizzati dai biologi legali, per comprendere l’esatta entità del danno d’organo iniziale.

Per i professionisti del settore, la vicenda di Domenico deve tradursi in un impegno verso l'ottimizzazione dei processi di screening: non basta la compatibilità immunologica, la qualità biologica dell'innesto è il presupposto imprescindibile.

Mentre l'inchiesta segue il suo corso, la madre di Domenico, Patrizia Mercolino, ha annunciato la nascita di una fondazione intitolata al figlio: «Ora è un angioletto - dice tra le lacrime - ma non dovremo mai dimenticarlo. Anche per questo creeremo una fondazione a lui intitolata, per aiutare i bambini che si trovino nelle sue stesse condizioni».

L'obiettivo è trasformare il dolore in un presidio di controllo, affinché la ricerca progredisca e i protocolli di assistenza vengano blindati contro la negligenza.

La storia di Domenico deve diventare il catalizzatore per un’ottimizzazione dei processi: la vita di un bambino non può dipendere da una manciata di ghiaccio secco.

Per il biologo che opera nell'ambito dei trapianti, il caso del piccolo Domenico richiama l'attenzione sulla necessità di implementare sistemi di monitoraggio sempre più sofisticati, come le tecniche di perfusione ex vivo, che permettono di valutare la funzionalità dell'organo in un ambiente controllato prima del trapianto, riducendo il rischio di primary graft dysfunction (PGD).

Sotto la lente degli inquirenti non c’è solo l’atto chirurgico, ma la filiera del trasporto: l’uso di ghiaccio secco al posto del ghiaccio umido ha causato il congelamento del cuore, rendendolo un "organo bruciato".

Il dato più inquietante emerso dalle indagini riguarda la dotazione tecnologica: l’ospedale Monaldi pare avesse già in dotazione box di ultima generazione per il trasporto monitorato, ma per il prelievo a Bolzano sarebbe stata utilizzata una box obsoleta, priva di sensori termici e sistemi di isolamento avanzati.

Questo paradosso - avere la tecnologia ma non impiegarla - ha trasformato una procedura di eccellenza in un fallimento sistemico. Se fosse stato seguito un protocollo di validazione biologica rigido all'arrivo dell'organo, i parametri biochimici avrebbero

probabilmente mostrato un danno cellulare incompatibile con la vita. Il ruolo del biologo è fornire al chirurgo dati oggettivi per dire: «Questo organo non è biologicamente idoneo», evitando il rischio di procedere con un impianto senza speranza.

Per il biologo operante nei centri trapianti, questo evento infausto richiama la necessità impellente di implementare sistemi di monitoraggio sofisticati e protocolli rigidi. Non è più accettabile l'uso di contenitori passivi che affidino alla discrezionalità umana la gestione di temperature critiche.

La tecnologia OCS (Organ Care System) e le tecniche di perfusione ex vivo rappresentano oggi lo standard di sicurezza necessario: queste metodiche permettono di mantenere l'organo in uno stato fisiologico semipulsante, consentendo di valutarne la funzionalità metabolica e biochimica prima dell'impianto, riducendo drasticamente il rischio di Primary Graft Dysfunction (PGD).

La biologia clinica deve farsi garante di una «certificazione di qualità» dell'organo che sia indipendente dalle variabili logistiche. L'autopsia dovrà chiarire l'entità del danno cellulare subito dai miociti, ma il verdetto etico è già scritto: l'innovazione tecnologica è un requisito di sicurezza.

ÈImmunologia e Tipizzazione (HLA)

il compito più critico. Il biologo analizza il complesso maggiore di istocompatibilità (HLA).

Cross-match: Esegue test di compatibilità in tempo reale tra il siero del ricevente e i linfociti del donatore per escludere la presenza di anticorpi preformati che causerebbero un rigetto iperacuto (spesso fatale in pochi minuti).

Screening anticorpale: Monitora costantemente i pazienti in lista d'attesa per identificare eventuali sensibilizzazioni che potrebbero limitare le probabilità di trapianto.

Valutazione della Viabilità e del Danno Cellulare Nel caso di Domenico, questo è il punto dove la biologia clinica diventa centrale.

Analisi dei biomarcatori: Il biologo valuta i marker di citolisi (come le troponine per il cuore o le transaminasi per il fegato) che indicano se l'organo ha subito danni durante la fase di agonia del donatore o durante l'ischemia.

Perfusione ex vivo: I biologi gestiscono le macchine da perfusione che mantengono l'organo in vita fuori dal corpo. Qui monitorano parametri come il lattato, il pH e il consumo di glucosio per determinare se l'organo sta "recuperando" o se è troppo danneggiato per essere impiantato.

Sicurezza Infettivologica

Il biologo molecolare e il microbiologo de -

vono garantire, in tempi record (spesso poche ore), che il donatore non trasmetta patogeni pericolosi (HIV, Epatiti, CMV, o batteri multiresistenti). L'uso delle tecniche NAT (Nucleic Acid Testing) permette di ridurre il "periodo finestra" infettivo, aumentando la sicurezza del ricevente.

Conservazione e Catena del Freddo

Il biologo è responsabile della validazione dei protocolli di conservazione.

Soluzioni di preservazione: Studia e gestisce le soluzioni elettrolitiche ipertoniche che servono a "fermare" il metabolismo cellulare senza causare edema o lisi.

Validazione dei sistemi di trasporto: Come evidenziato dal caso del Monaldi, il biologo deve certificare che i contenitori (box) e i mezzi refrigeranti utilizzati mantengano l'organo in un range di temperatura rigoroso (solitamente 4 +-2°C), evitando sia il riscaldamento che, come purtroppo accaduto, il congelamento da ghiaccio secco.

Ricerca e Ingegneria Tissutale

Oltre la routine clinica, il biologo lavora alla frontiera della medicina:

Decellularizzazione: Ricerca su come "pulire" organi non idonei per usarli come impalcature biologiche da ricolonizzare con cellule del paziente.

Xenotrapianti: Studio della compatibilità tra organi animali (suini geneticamente modificati) e umani.

Il caso del piccolo Tommaso, il bambino napoletano che ha ricevuto un trapianto di cuore rivelatosi poi danneggiato, sta scuotendo l'opinione pubblica e accendendo i riflettori sulla tenuta del sistema trapiantologico italiano. Il timore principale, espresso chiaramente dal Ministro della Salute Orazio Schillaci, è il cosiddetto "effetto rebound": una brusca frenata delle donazioni alimentata dalla sfiducia e dal timore dei cittadini.

«Bisogna capire cosa è successo per non far perdere la fiducia verso un atto di grande altruismo», ha dichiarato Schillaci, sottolineando come la trasparenza sia l’unico antidoto alla paura. Il rischio è che un singolo evento critico possa vanificare anni di campagne di sensibilizzazione che hanno portato l'Italia a toccare vertici di eccellenza nel settore.

I primi segnali, seppur contenuti, sono già visibili. Secondo i dati forniti dall’Aido (Associazione Italiana per la Donazione di Organi), nell'ultima settimana di metà febbraio si è registrata una leggera flessione delle adesioni e qualche revoca di consensi precedentemente accordati. Flavia Petrin, presidente dell'associazione, getta però acqua sul fuoco: a fronte di 1,5 milioni di soci, le disdette degli ultimi giorni si contano nell'ordine di una decina. Un dato che non desta allarme immediato, ma che impone vigilanza, considerando che a gennaio si era registrato un "boom" con 4.500 nuove adesioni. La sfida comunicativa è ora quella di bilanciare il dolore per la vicenda di Tommaso con la realtà di un sistema che, nel solo 2024, ha superato i 4.500 trapianti eseguiti con successo.

Attualmente, circa 8.000 persone restano in lista d'attesa, sperando in quel "sì" che può cambiare il destino di intere famiglie. A sostegno del valore della donazione è intervenuto anche Reginald Green, padre del piccolo Nicholas, il cui gesto nel 1994 rivoluzionò la cultura del dono in Italia.

Dall'alto dei suoi 97 anni, Green ricorda come ogni famiglia in lutto abbia il potere di trasformare una tragedia in vita: «La storia di Tommaso ci ricorda quanto sia preziosa ogni donazione». Il messaggio delle istituzioni e del mondo del volontariato è univoco: l'errore o la fatalità non devono oscurare l'efficacia di un sistema che restituisce ogni anno migliaia di cittadini alla vita produttiva e sociale. (M. A.).

© H_Ko/shutterstock.com

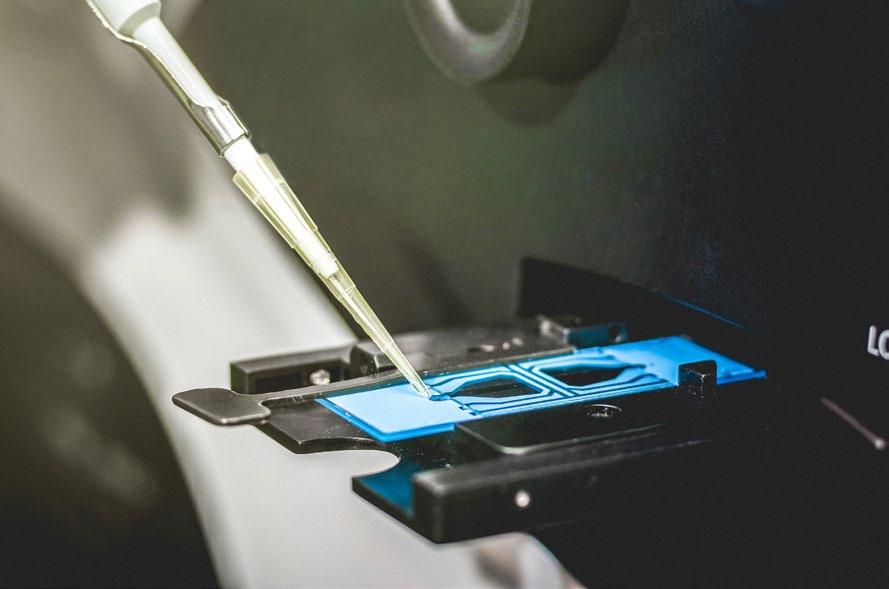

A Milano, il convegno della Fnob dedicato alla medicina di laboratorio

D’Anna «La nuova veste della nostra professione è più vicina alle esigenze dei professionisti»

La professione del biologo in Italia sta vivendo una fase di profonda e storica trasformazione, caratterizzata da una maggiore autonomia, un riconoscimento ampliato delle competenze e prospettive occupazionali in forte crescita. Questo cambiamento epocale è stato illustrato dal Presidente della Federazione Nazionale degli Ordini dei Biologi (FNOB), Vincenzo D’Anna, che ha delineato il percorso di evoluzione della categoria in apertura dei lavori del convegno dal titolo “Medicina di laboratorio: qualità, innovazione e sostenibilità”, organizzato il 10 febbraio scorso a Milano, presso la Casa del Cardinale Ildefonso Schuster.

La riforma ha segnato il passaggio da un ordine centralizzato a una struttura basata su ordini territoriali, una scelta strategica per garantire una rappresentanza più efficace e vicina alle esigenze locali. «I biologi non potevano continuare a essere esclusi dalle professioni sanitarie, ma vi dovevano essere inseriti a pieno titolo» ha dichiarato D’Anna, sottolineando come l’ordine centralizzato potesse favorire “cricche di potere” a discapito della volontà degli iscritti. Questa transizione ha conferito ai biologi la facoltà di eleggere i propri dirigenti e di definire attività e prospettive specifiche per il proprio territorio, riconoscendo che le problematiche di un biologo a Trapani sono diverse da quelle di un biologo a Milano. Un pilastro fondamentale di questa “rifondazione” è rappresentato dai futuri decreti della legge 161/2021 sulle lauree abilitanti. Questi riepilogheranno le competenze dei biologi, superando la genericità della legge originaria del 1967 che non esplicitava discipline moderne come la genetica, la genomica, la nutrizione o la bioinformatica. La professione sarà separata in tre ambiti distinti: biologi generali e sanitari, biologi ambientali e biologi nutrizionisti, garantendo finalmente una chiara declaratoria di competenze e una certezza giuridico-legislativa finora carente. Le statistiche confermano il successo di questa evoluzione: i biologi, insieme ai matematici, vantano il maggior indice di occupazione professionale, con un incremento del 14%. I nuovi decreti aprono inoltre a campi innovativi nella medicina di laboratorio, come la medicina di precisione, predittiva e personalizzata, offrendo prospettive che superano quelle mediche in termini di innovazione. La biologia spaziale è un altro grande settore in espansione. In generale i biologi oggi possono svolgere fino a 80 diverse tipologie di attività.

Il Presidente D’Anna ha espresso grande orgoglio e rivendicato il ruolo della FNOB per aver contribuito a superare un passato in cui i biologi erano considerati “figli di un Dio minore” o “fratelli scelti dei medici”, soggetti a fenomeni di “apartheid” professionale. Ha esortato la categoria a non cadere nella “trappola” del campanilismo e del nazionalismo, definiti “l’ultimo rifugio di un briccone”, ma a lavorare per l’unità basata su sapienza, afflato, entusiasmo e intelligenza. La Federazione, ha ribadito, è qui per “aiutare, consigliare, tutelare”, senza interferire con l’autonomia degli ordini territoriali. Questa rivoluzione non solo rafforza la posizione dei biologi nel panorama professionale italiano, ma li proietta verso un futuro di nuove sfide e opportunità, consolidando il loro ruolo insostituibile nella scienza e nella società. (M. A.).

Dalla biologia molecolare alla biopsia liquida: le nuove frontiere della medicina di precisione nella lotta al tumore al colon che ha colpito l’attore a soli 48 anni

di Matilde Andolfo

La notizia della sua scomparsa, avvenuta l’11 febbraio, ha scosso l’opinione pubblica e, in breve tempo, ha fatto il giro del mondo. James Van Der Beek, l’indimenticabile Dawson dell’iconica serie TV, se n’è andato a soli 48 anni a causa di un cancro al colon-retto. Una malattia che lo stesso attore aveva reso nota nel 2023, scoperta quasi per caso durante un banale controllo di routine.

Colpisce la dimensione umana di questa tragedia, che ha coinvolto una famiglia numerosa trovatasi ad affrontare non solo il dolore, ma anche le ingenti difficoltà economiche legate alle cure. La solidarietà non è mancata: la raccolta fondi avviata dopo la sua morte ha raggiunto il milione di euro in pochi giorni, con donazioni arrivate anche da giganti del cinema come Steven Spielberg.

Restano le immagini potenti di un uomo che non si è mai piegato. James ha affrontato mesi difficili con una

dignità rara, circondato da sprazzi di luce e dall'affetto dei suoi cari.

Indimenticabile resterà l'evento di beneficenza “Dawson’s Creek Class Reunion” dello scorso settembre: mentre la moglie Kimberly e i sei figli cantavano sul palco la storica sigla della serie - "I Don't Want to Wait" di Paula Cole - James, assente per un'infezione, inviava un video colmo di speranza.

Le ultime settimane sono state un mosaico di tenerezza e di potenza: gli scatti sulla sedia a rotelle davanti al tramonto e la carezza finale dell'amico di sempre, Alfonso Ribeiro, il mitico Carlton della serie Willy, il principe di Bel-Air, accorso al suo capezzale. Oggi, dopo il ringraziamento della moglie Kimberly che ha chiesto un rispettoso silenzio, resta la sua eredità umana e un monito per tutti noi.

Il caso di Van Der Beek è lo specchio di un mutamento preoccupante: un uomo giovane, sportivo e senza familiarità per la patologia, colpito

da un adenocarcinoma allo stadio 3. I dati dell'American Cancer Society parlano chiaro: l'incidenza di questo tumore negli under 50 cresce dell'1-2% ogni anno dalla metà degli anni '90.

La ricerca oggi indaga su nuovi colpevoli: alterazioni del microbiota intestinale, esposizione precoce alle microplastiche, ceppi di Escherichia coli che producono colibactina, una tossina capace di danneggiare il DNA.

La testimonianza di James Van Der Beek è diventata un potente manifesto sulla necessità di non ignorare i sintomi, anche quando si è nel pieno della giovinezza, e sottolinea quanto sia cruciale abbassare la soglia di attenzione e anticipare i controlli se il corpo lancia dei segnali. Ecco perché in questo numero proveremo a dare risposte coinvolgendo la medicina ma anche la biologia.

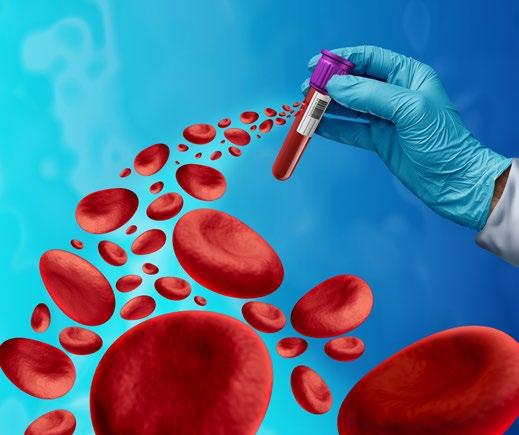

Il futuro della lotta contro il cancro risiede nella biologia molecolare. Se i controlli tradizionali restano il "gold standard", la vera svolta è rappresentata dalla biopsia liquida, capace di intercettare frammenti di DNA tumorale nel sangue molto prima che i sintomi diventino evidenti.

I DATI DELL'AMERICAN CANCER

SOCIETY PARLANO CHIARO:

L'INCIDENZA DI QUESTO TUMORE

NEGLI UNDER 50 CRESCE

DELL'1-2% OGNI ANNO

DALLA METÀ DEGLI ANNI '90

Il tumore del colon-retto non è più solo una patologia dell'età avanzata. Tra stili di vita moderni e l'importanza vitale dello screening, facciamo chiarezza su come riconoscere i segnali e intervenire in tempo. L'intervista al professor Luigi Pasquale, direttore dell’UOC Gastroenterologia Ospedale Monaldi di Napoli.

Professore, quali sono i sintomi più comuni a cui dobbiamo prestare at tenzione?

«Il corpo ci invia segnali precisi, ma è fondamentale che questi siano persistenti per destare reale allarme. I campanelli d'allarme principali includono la presenza di sangue nelle feci (sia rosso vivo che scuro), dolori addominali ricorrenti, un’improvvisa alterazione delle abitudini intestinali - come stitichezza o diarrea prolungata, o l'alternanza tra le due - e un'anemia da carenza di ferro non altrimenti spiegata».

Un tempo si pensava fosse un tumore "da anziani". È ancora così?

«Tradizionalmente sì, l’età media alla diagnosi superava i 60 anni. Tuttavia, stiamo assistendo a un fenomeno preoccupante: l'aumento dei casi tra i soggetti sotto i 50, e talvolta anche sotto i 40 anni. È un incremento numericamente contenuto ma significativo, perché

coinvolge generazioni che un tempo non erano considerate a rischio. Il problema principale è psicologico: a 35 anni raramente si sospetta una neoplasia del colon, ritardando così la diagnosi».

Si parla spesso di "tumore silenzioso". Cosa succede all'interno dell'intestino?

«Esatto. Nelle fasi iniziali è quasi sempre asintomatico. Nel 90% dei casi, tutto ha origine da un polipo intestinale, chiamato adenoma. È un processo lento: dalla formazione del polipo alla comparsa del carcinoma passano circa sette anni, e ne servono altri tre perché si sviluppino metastasi. Identificare e rimuovere un polipo durante una colonscopia significa, di fatto, prevenire il tumore prima ancora che nasca».

Quanto pesano le nostre abitudini quo tidiane e quanto conta la familiarità?

«L'ambiente gioca un ruolo chiave. Negli ultimi vent’anni il nostro stile di vita è peggiorato: l’aumento di obesità, il consumo di alcol, carni rosse e cibi ultra-processati, uniti a una drastica riduzione delle fibre, hanno creato un terreno fertile per la malattia.

Esiste poi una componente genetica: sindromi specifiche o una semplice suscettibilità familiare aumentano il rischio. Anche patologie infiammatorie croniche come il Morbo di Crohn o la

rettocolite ulcerosa richiedono un monitoraggio più stretto. Chi ha familiari colpiti da polipi o tumori dovrebbe parlarne subito con il proprio medico per un piano di prevenzione personalizzato».

In Italia come funziona il protocollo di prevenzione?

«Lo screening nazionale offre gratuitamente il test del sangue occulto fecale tra i 50 e i 70 anni. È un esame semplice che va eseguito senza timore. Se il risultato è positivo, si procede con la colonscopia: un passaggio fondamentale che permette non solo la diagnosi, ma spesso la guarigione immediata tramite la rimozione delle lesioni precancerose».

Se la diagnosi è confermata, la chirur gia è l'unica strada?

«La chirurgia resta il pilastro del trattamento, ma oggi è molto meno invasiva. Utilizziamo tecniche laparoscopiche o robotiche che riducono i tempi di recupero. Il percorso è poi multimodale: in base all'esame istologico, possiamo integrare chemioterapia, radioterapia o immunoterapia. In alcune situazioni chemio e radio vengono eseguite prima dell’intervento. Anche situazioni che vent’anni fa apparivano disperate, oggi possono essere affrontate con ottime prospettive grazie a cure sempre più personalizzate». (M. A.).

Il professor Luigi Pasquale è un'eminenza nel campo della gastroenterologia e dell'endoscopia digestiva italiana. Dal 16 febbraio 2024, ricopre il ruolo di Direttore della UOC di Gastroenterologia ed Endoscopia Digestiva presso l'AORN Ospedali dei Colli - Monaldi di Napoli.

La sua carriera è strettamente legata alla Società Italiana di Endoscopia Digestiva (SIED), di cui è stato Presidente Nazionale nel quadriennio 2018-2022. In questo ambito ha ricoperto ruoli di vertice, tra cui:

Direttore del Corso Nazionale Annuale SIED (2022-2024), Coordinatore del Comitato Scientifico SIED-AGENAS (2018-2022), Responsabile Amministrativo e Segretario Nazionale/Tesoriere (2016-2018).

Prima del prestigioso incarico al Monaldi, il professor Pasquale ha diretto per anni la stessa unità operativa presso l’ASL di Avellino (P.O. Ariano Irpino), dove è stato anche responsabile clinico per lo screening del cancro del colon-retto tra il 2006 e il 2009.

È noto per il suo impegno nella divulgazione scientifica e nella formazione, partecipando regolarmente come esperto a forum medici e iniziative di prevenzione.

GUIDA PRATICA ALLO SCREENING IN ITALIA

In Italia, lo screening è un servizio gratuito offerto dal Sistema Sanitario Nazionale, senza bisogno di impegnativa medica.

• Il Test (SOF): Ricerca del sangue occulto nelle feci. È un kit semplice da usare a casa e consegnare in farmacia o ai centri ASL.

• Target Standard: Generalmente offerto ogni 2 anni a uomini e donne tra i 50 e i 70 anni.

• Informazioni Regionali: Ogni Regione gestisce il proprio programma. Puoi trovare i dettagli specifici sulla guida di Fondazione AIRC agli screening regionali o sui portali dedicati come Salute Lazio e ATS Milano.

• Casi Speciali: Se hai familiarità (parenti di primo grado colpiti) o patologie infiammatorie, lo screening deve iniziare prima dei 45-50 anni su consiglio del gastroenterologo.

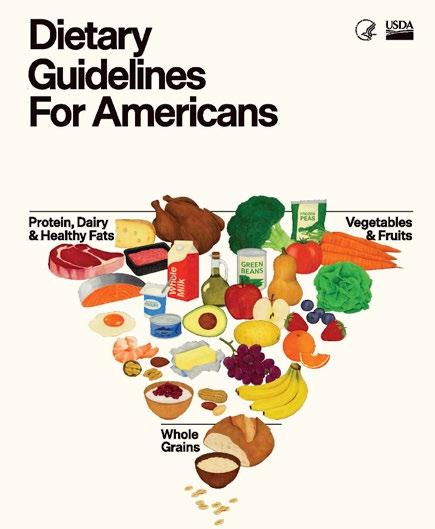

PREVENZIONE A TAVOLA: LE LINEE GUIDA

La salute dell'intestino passa da ciò che mangiamo. Secondo le raccomandazioni di Fondazione AIRC e delle principali autorità sanitarie, la dieta è la nostra prima difesa.

Cosa privilegiare:

• Fibre (almeno 25-30g al giorno): Cereali integrali (orzo, avena, farro), legumi, frutta e verdura fresca. Le fibre accelerano il transito intestinale, riducendo il tempo di contatto tra sostanze tossiche e pareti del colon.

• Antiossidanti naturali: Alimenti come aglio e cipolla contengono composti solforati che possono migliorare il sistema immunitario e rallentare la crescita di cellule anomale.

Cosa limitare o evitare:

• Carni rosse e processate: Limitare la carne fresca (bovina, suina, ovina) a non più di 300-500g a settimana ed evitare salumi e insaccati, classificati come cancerogeni certi per il colon.

• Alcol: Anche consumi ridotti aumentano il rischio.

• Zuccheri raffinati e grassi saturi: Correlati all'infiammazione e all'obesità, fattore di rischio per oltre 13 tipi di cancro.

La prof.ssa Marangoni ci guida tra evidenze scientifiche, sicurezza e strategie innovative per modularli a vantaggio della salute

di Emanuela Birra

Negli ultimi anni, il microbioma umano è passato dall’essere un semplice oggetto di studio a un protagonista della ricerca biomedica. Si è rivelato un elemento chiave nel modulare infezioni, risposta immunitaria e salute sistemica. Questa nuova consapevolezza ha messo in discussione una visione esclusivamente "patogeno-centrica" della malattia. Ha aperto la strada a strategie terapeutiche che si basano sulla modulazione degli ecosistemi microbici.

In questo contesto, il trapianto di microbiota fecale è uno degli esempi più concreti di come la conoscenza dei microrganismi possa diventare pratica clinica, soprattutto in campo infettivologico. Oggi, a distanza di alcuni anni dai primi studi clinici, l’attenzione si è spostata dalla novità del trattamento alla valutazione della sua affidabilità, sicurezza, riproducibilità e integrazione nei percorsi terapeutici.

Per fare il punto su ciò che è stato acquisito dalla ricerca e su quali sfide restino aperte, abbiamo intervistato Antonella Marangoni, Microbiologa clinica presso il Policlinico Sant’Orsola di Bologna, dove svolge attività di ricerca e diagnostica in microbiologia. Nel corso della sua carriera, si è concentrata nello studio delle infezioni batteriche, delle interazioni tra microrganismi e ospite e del ruolo del microbioma umano nei processi patologici e terapeutici.

La sua attività scientifica ha approfondito le applicazioni cliniche del trapianto di microbiota fecale e le strategie per modulare il microbioma. Ha mantenuto un’at -

tenzione costante sulla sicurezza, sulla validazione delle evidenze e sul trasferimento dei risultati della ricerca nella pratica clinica. Ha partecipato a numerosi studi e collaborazioni scientifiche, contribuendo al dibattito nazionale e internazionale su uno dei settori più attivi della medicina moderna.

Quando si parla di trapianto di microbioma, si tende spes so a presentarlo come una terapia “innovativa”. A suo avviso, qual è l’aspetto davvero rivoluzionario di questo approccio dal punto di vista scientifico e clinico?

Più che l’atto tecnico del trapianto in sé, l’aspetto davvero rivoluzionario del trapianto di microbiota fecale è il cambio di paradigma che introduce. Per la prima volta, in ambito clinico, non interveniamo su un singolo patogeno o su una specifica via molecolare, ma su un ecosistema biologico complesso.

È interessante notare come questa apparente “novità” abbia in realtà radici antiche: pratiche riconducibili al trasferimento di materiale fecale vengono già descritte nell’antica medicina cinese: infatti, abbiamo una testimonianza del IV secolo d.C. di un medico chiamato Ge Hong che prescriveva una “zuppa gialla” a base di feci umane per la cura di intossicazioni o diarree severe. Ciò che è cambiato oggi è la cornice scientifica che ci consente di comprenderne - almeno in parte - i meccanismi, di valutarne l’efficacia e di discuterne criticamente i limiti.

Dal punto di vista clinico, il trapianto di microbiota fecale o FMT (Fecal Microbiota Transplanation) ha mostrato

che ripristinare una funzione ecologica, più che eliminare un agente, può essere terapeuticamente decisivo. In questo senso, non è solo una terapia innovativa, ma un banco di prova per una medicina che integra ecologia microbica, fisiologia dell’ospite e pratica clinica.

In quali condizioni cliniche il trapianto di microbiota può oggi essere considerato una strategia terapeutica solida, supportata da evidenze sufficienti, e dove invece la ricer ca è ancora in una fase esplorativa?

Oggi è possibile distinguere con relativa chiarezza tra ambiti in cui il trapianto di microbiota fecale può essere considerato una strategia terapeutica solida e altri in cui la ricerca è ancora esplorativa. L’indicazione con il livello più alto di evidenza rimane l’infezione ricorrente da Clostridioides difficile, dove l’FMT agisce efficacemente come ripristino di una funzione ecologica fondamentale, la colonizzazione-resistenza. In questo contesto, l’effetto clinico è robusto e riproducibile.

Accanto a questo, stanno emergendo dati incoraggianti sull’uso dell’FMT in disbiosi severe associate a colonizzazione e/o infezioni da batteri multiresistenti, soprattutto in pazienti fragili. Anche qui il razionale è in primis ecologico: ristabilire una comunità microbica complessa può ridurre la persistenza dei patogeni e la probabilità di reinfezione, sebbene le evidenze siano meno standardizzate e forti rispetto a quelle relative a C. difficile.

In altre condizioni, come le malattie infiammatorie croniche intestinali - in particolare la rettocolite ulcero -

IL MICROBIOMA UMANO È PASSATO

DALL’ESSERE UN SEMPLICE OGGETTO DI STUDIO

A UN PROTAGONISTA DELLA RICERCA BIOMEDICA. SI È RIVELATO UN ELEMENTO CHIAVE NEL

MODULARE INFEZIONI, RISPOSTA IMMUNITARIA E SALUTE SISTEMICA

sa - i segnali di efficacia esistono, ma sono più eterogenei e fortemente dipendenti da variabili chiave: la selezione del donatore, la modalità di preparazione del materiale, la via e la frequenza di somministrazione, nonché il profilo microbiologico e immunologico di partenza del paziente.

Infine, per disturbi funzionali intestinali e per le indicazioni extra-intestinali (metaboliche, neurologiche, immunologiche), il razionale biologico è spesso convincente, ma le evidenze cliniche restano frammentarie. In questi casi, la sfida principale è distinguere correlazioni microbiota-fenotipo da reali relazioni causali e capire se l’FMT sia lo strumento più adatto o solo una tappa verso interventi microbici più definiti.

Nel suo percorso di ricerca, quali studi o ri sultati ritiene abbiano contribuito in modo più significativo a chiarire il ruolo del mi crobioma nelle infezioni e nelle applicazioni cliniche del trapianto?

Nel mio percorso di ricerca sono stati particolarmente formativi alcuni studi che han -

no contribuito a ridefinire il ruolo del microbioma nella suscettibilità alle infezioni.

Tra i lavori fondamentali ricorderei innanzitutto quello di van Nood et al. (“Duodenal Infusion of Feces for Recurrent Clostridium difficile”, New England Journal of Medicine, 2013), primo studio randomizzato controllato, pietra miliare in ambito di FMT e l’articolo di Buffie et al. (“Precision microbiome reconstitution restores bile acid mediated resistance to Clostridium difficile”, Nature, 2015) sul concetto di resistenza alla colonizzazione come base ecologica della protezione contro patogeni intestinali.

Un altro riferimento cruciale per la comunità clinica è il Consensus europeo di Roma (“European consensus conference on faecal microbiota transplantation in clinical practice”, Gut, 2017), che ha codificato le indicazioni, i criteri di selezione dei donatori, le modalità di somministrazione e gli aspetti di sicurezza dell’FMT nella pratica clinica.

Infine, è fondamentale un lavoro uscito lo scorso anno, dal titolo “International Consensus Statement on Microbiome Testing in Clinical Practice” (Porcari et al., The Lancet, 2025), in cui si riflette sul tema più ampio dell’integrazione del microbioma nella pratica clinica, sottolineando la necessità di rigore metodologico, appropriatezza clinica e interpretazione funzionale dei dati microbiologici e l’attenzione che si deve porre per evitare usi distorti della mappatura del microbioma.

Con il passaggio dalla ricerca alla pratica cli nica, come è cambiato nel tempo il suo ruolo di scienziata e quali responsabilità ha senti to crescere maggiormente?

Nel mio caso, il rapporto tra ricerca e pratica clinica non è mai stato un passaggio netto, ma piuttosto un percorso intrecciato fin dai tempi di giovane specializzanda in Microbiologia e Virologia. Questo ha reso naturale concepire la ricerca non come un esercizio puramente accademico, ma come uno strumento per rispondere a bisogni clinici concreti, spesso emergenti e complessi. Con il tempo, tuttavia, è cresciuta soprattutto la responsabilità di tradurre correttamente la complessità biologica, evitando sia semplificazioni eccessive, sia promesse non

supportate dai dati. Nel campo del microbioma, dove il confine tra innovazione e hype è particolarmente sottile, il ruolo del microbiologo clinico diventa anche quello di garante del rigore: definire indicazioni appropriate, contribuire a standard condivisi e comunicare in modo onesto limiti, incertezze e potenzialità.

È fondamentale promuovere una cultura del microbioma fondata su evidenze solide, interdisciplinarità e senso critico, affinché il passaggio dalla ricerca alla clinica avvenga in modo sostenibile e realmente utile.

Per tale motivo, all’interno della società scientifica AMCLI (Associazione Microbiologi Clinici Italiani) esiste dal 2022 un gruppo di lavoro sul microbiota e ci siamo impegnati a fare uscire entro l’anno il percorso per FMT, che potrà essere di aiuto per i centri che vogliono implementare tale pratica.

Ogni innovazione terapeutica porta con sé entusiasmo ma anche rischi di semplificazione. Dove, secondo lei, è necessario oggi mantenere maggiore cautela quando si parla di trapianto di microbioma?

Oggi la cautela è necessaria soprattutto nel modo in cui il trapianto di microbiota viene raccontato e utilizzato. Il rischio principale è ridurlo a una procedura plug-and-play, come se il trasferimento di un microbioma “sano” potesse produrre effetti prevedibili e universalmente replicabili.

In realtà, il trapianto interviene su un ecosistema dinamico e altamente contestuale, profondamente influenzato dal profilo dell’ospite, e questo impone prudenza nelle aspettative e nell’interpretazione dei risultati.

È inoltre fondamentale mantenere un atteggiamento critico nell’estensione delle indicazioni cliniche: l’interesse verso applicazioni extra-intestinali o multifattoriali è scientificamente stimolante, ma deve procedere di pari passo con studi ben

disegnati, evitando di confondere correlazioni biologiche con reali relazioni causali.

Infine, la cautela riguarda anche la responsabilità collettiva della comunità scientifica. Standardizzazione, sicurezza, regolazione e comunicazione corretta sono elementi imprescindibili affinché il trapianto di microbiota non resti un’innovazione affascinante ma fragile, bensì diventi uno strumento clinico solido, inserito in una visione più ampia di medicina basata sull’ecologia dei sistemi biologici.

La professoressa Tatjana Baldovin, coordinatrice del laboratorio di Igiene e Microbiologia Applicata dell’Università di Padova, ci spiega perché il fenomeno è così diffuso e come combatterlo

di Ester Trevisan

Antibiotico-resistenza: tutti ne parlano ma in pochi la conoscono davvero. Professoressa Baldovin, spieghiamo cos’è e come si sviluppa?

L’antibiotico resistenza è un fenomeno evolutivo naturale, che avviene come forma di adattamento all’ambiente, in cui i batteri acquisiscono o selezionano mutazioni e geni che li rendono insensibili agli antibiotici. L’uso improprio o eccessivo di questi farmaci accelera la selezione di ceppi resistenti, riducendo l’efficacia terapeutica e complicando il trattamento delle infezioni.

Secondo un recente report dell’Istituto superiore di sani tà, i tassi alti di antibiotico-resistenza in Italia mostrano qualche segno di miglioramento. Ma si tratta comunque di un fenomeno ancora troppo dif fuso. Perché?

Purtroppo, nonostante gli sforzi messi in atto da anni per contrastare il fenomeno, l’antibiotico-resistenza continua a rappresentare uno dei principali problemi di Sanità Pubblica, con un forte impatto sanitario ed economico. I motivi sono diversi, in particolare legati ancora ad un uso inappropriato ed eccessivo nell’uomo, a livello zootecnico e in agricoltura, ai meccanismi biologici intrinseci dei microrganismi indotti dalla pressione selettiva e a dinamiche come la mobilità globale e la mancanza di nuove molecole antibiotiche.

È un fenomeno complesso e rappresenta una delle sfide sanitarie più importanti a livello globale.

Ogni anno miete circa 12mila vittime, pari a un terzo di tutti i decessi registrati tra i pazienti ricoverati in ospe dale. Come si può combattere questo nemico?

L’antibiotico resistenza va combattuta efficacemente attraverso azioni coordinate e multidisciplinari, adottando un approccio “One Health” che coinvolga la salute umana, animale e dell’ambiente, strettamente interconnesse e secondo una logica quanto più completa e integrata. Anche una governance di sistema, sostenuta da una leadership forte, è fondamentale per definire politiche e strategie di contrasto al problema.

Quali strategie si possono adottare per prevenirla?

Per contrastarla servono stewardship antibiotica rigorosa, diagnosi microbiologica rapida, controllo delle infezioni, igiene ospedaliera, sorveglianza epidemiologica dei ceppi resistenti, ricerca e sviluppo di nuovi vaccini e antibiotici e, infine, educazione e formazione.

Quali sono i batteri più difficili da debellare?

I batteri più difficili da debellare sono quelli che sviluppano resistenze multiple e meccanismi di adattamento avanzati. In Italia, le percentuali di resistenza alle principali classi di antibiotici per gli otto patogeni sotto sorveglianza continuano a mantenersi elevate, con criticità elevate nei Gram negativi - Klebsiella pneumoniae, Acinetobacter spp., Pseudomonas aeruginosa resistenti ai carbapenemi ed Escherichia coli multiresistente - e Gram-positivi come Staphylococcus aureus meticillina re -

sistente, Enterococcus faecium vancomicina resistente e Streptococcus pneumoniae.

Nel resto dell’Europa qual è la situazione? Ci sono Paesi che hanno messo in campo buone pratiche da cui trarre esempio?

In Europa la situazione è eterogenea, peggiore nelle regioni meridionali, centrali e orientali. I Paesi del Nord, come Svezia, Danimarca e Paesi Bassi, mostrano bassi livelli di antibiotico resistenza grazie ad un uso controllato degli antibiotici, attenta sorveglianza microbiologica e prevenzione delle infezioni. Anche Germania e Francia hanno rafforzato programmi di stewardship e monitoraggio. Queste buone pratiche dimostrano che politiche coordinate e continuità nel tempo riducono la diffusione dei ceppi resistenti.

Microscopio, batteri, virus e camice bianco erano la sua aspirazione sin da bambina oppure è stata folgorata sulla via degli studi?

La passione per il mondo microscopico c’è sempre stata, poi si è consolidata nel tempo, alimentata dallo studio e dalla curiosità scientifica per diventare, successivamente, una scelta consapevole e convinta. Più che una folgorazione, è stato un percorso fatto di interesse costante e approfondimento.

Tra attività didattica, formazione, ricerca, convegni e se minari in giro per l’Italia, riesce a trovare il tempo anche per la vita privata? E come le piace trascorrere le ore li bere dal lavoro?

Non è sempre facile conciliare tutto, ma è essenziale trovare spazi per sé e da dedicare agli altri. Il contatto diretto con la natura per me è fondamentale: stare all’aria aperta, fare escursioni e condividere il tempo libero con la famiglia e gli amici mi aiuta a recuperare le energie e a mantenere un buon equilibrio tra impegni e vita privata.

Un consiglio per i giovani biologi che vogliono dedicare la loro carriera professionale alla ricerca.

A chi desidera intraprendere una carriera nella ricerca suggerirei di coltivare curiosità e interesse, senza scoraggiarsi davanti alle difficoltà. La ricerca richiede impegno e formazione continua, perché i risultati si ottengono con la costanza e la dedizione. Rigore scientifico e spirito di squadra, inoltre, sono fondamentali per una ricerca efficace e innovativa.

I BATTERI PIÙ DIFFICILI DA DEBELLARE

SONO QUELLI CHE SVILUPPANO RESISTENZE

MULTIPLE E MECCANISMI DI ADATTAMENTO

AVANZATI. IN ITALIA, LE PERCENTUALI

DI RESISTENZA ALLE PRINCIPALI

CLASSI DI ANTIBIOTICI PER GLI

OTTO PATOGENI SOTTO SORVEGLIANZA

CONTINUANO A MANTENERSI ELEVATE

Tatjana Baldovin ha conseguito la laurea in Scienze Biologiche con orientamento biologico fisio-patologico e il dottorato all’Università di Padova. Attualmente è professoressa associata di Igiene alla Scuola di Medicina e Chirurgia dell’ateneo patavino. La sua attività di ricerca si concentra principalmente sull’epidemiologia e la prevenzione delle malattie infettive, documentata da numerose pubblicazioni su riviste internazionali. Coordina le attività del laboratorio universitario di Igiene e Microbiologia Applicata.

In questo primo scorcio di 2026

l’attenzione dei media si è concentrata su Mariano Barbacid, biochimico molecolare spagnolo e direttore del gruppo di Oncologia sperimentale del Centro Nazionale Spagnolo per la Ricerca sul Cancro (Cnio), in seguito alla pubblicazione di uno studio che presenta risultati incoraggianti nella ricerca sul cancro al pancreas. Si tratta di un ambito particolarmente complesso, caratterizzato da una mortalità elevata e da limitate opzioni terapeutiche. Per comprendere il significato di questi dati è utile analizzare il profilo dello studioso, il contesto epidemiologico della malattia e il contenuto della ricerca.

Mariano Barbacid è nato a Madrid nel 1949. Si è laureato in Chimica presso l’Universidad Complutense, per poi proseguire la sua formazione negli Stati Uniti con studi di specializzazione in biologia molecolare. Negli anni successivi ha svolto attività di ricerca in alcuni dei principali centri oncologici americani, tra cui l’MD Anderson Cancer Center di Houston.

In seguito, è stato direttore del National Cancer Institute del Maryland, incarico che ha ricoperto fino al 1998. In quell’anno è rientrato in Spagna con il compito di fondare e dirigere il Centro Nazionale Spagnolo per la Ricerca sul Cancro. Sotto la sua guida, il Cnio è diventato uno dei principali poli europei per lo studio delle malattie oncologiche.Nel corso della sua carriera, Barbacid ha pubblicato oltre 300 articoli scientifici su riviste internazionali ed è stato coinvolto in numerosi progetti

di ricerca finanziati a livello europeo e internazionale. Il lavoro di Barbacid è noto soprattutto per i contributi allo studio degli oncogeni, ovvero i geni che, in presenza di specifiche mutazioni, favoriscono la trasformazione delle cellule normali in cellule tumorali.

Nel 1982 ha partecipato all’isolamento del primo oncogene umano e all’identificazione di una mutazione direttamente associata allo sviluppo di tumori. Questa scoperta ha rappresentato un passaggio importante nella comprensione molecolare del cancro.

Successivamente ha contribuito all’isolamento dell’oncogene

Trk e allo studio di altri meccanismi genetici coinvolti nella proliferazione cellulare incontrollata. Queste ricerche hanno posto le basi per lo sviluppo delle terapie mirate, oggi utilizzate in diversi ambiti dell’oncologia.

Come è noto, il tumore al pancreas è una delle forme più aggressive. È caratterizzato da una diagnosi spesso tardiva, da una progressione rapida e da una risposta limitata ai trattamenti disponibili.

Chi è Mariano Barbacid: tutto quello che del suo studio sulla neoplasia dalla

In Italia si stimano circa 14mila nuovi casi all’anno. La sopravvivenza a cinque anni dalla diagnosi resta inferiore al 10%. La mortalità è molto elevata: nella maggior parte dei casi, il numero dei decessi è simile a quello delle nuove diagnosi annuali.

A livello globale, il cancro al pancreas colpisce oltre 500mila persone ogni anno. Nei Paesi industrializzati rappresenta una delle principali cause di morte per tumore e le proiezioni indicano un possibile aumento nei prossimi decenni, anche in relazione all’invecchiamento della popolazione.

Le opzioni terapeutiche attuali comprendono chirurgia, chemioterapia e, più recentemente, farmaci a bersaglio molecolare. Tuttavia, solo una minoranza dei pazienti è candidabile all’intervento chirurgico e le terapie farmacologiche mostrano spesso un’efficacia limitata nel tempo.

Il recente lavoro coordinato da Barbacid si concentra su una strategia di trattamento basata sull’uso combinato

di tre farmaci, progettati per interferire con specifici meccanismi molecolari coinvolti nella crescita tumorale. In particolare, la terapia agisce su tre bersagli: le proteine Egfr e Stat3, implicate nei processi di proliferazione cellulare, e l’oncogene Kras, mutato nella maggioranza dei casi di tumore pancreatico.

Secondo quanto riportato dagli autori della ricerca che è stata pubblicata sulla rivista Pnas, i risultati dei primi esperimenti indicano una riduzione significativa delle cellule tumorali, accompagnata da una limitata tossicità.

La risposta osservata risulta prolungata nel tempo rispetto a quanto registrato con altri approcci sperimentali

Lo studio è frutto del lavoro congiunto di diversi ricercatori del Cnio, coordinati da Barbacid insieme alla biologa Carmen Guerra: pur essendo i primi segnali incoraggianti, gli esperti sottolineano che i risultati ottenuti non consentono, al momento, un’applicazione immediata in ambito clinico. Sono necessari ulteriori studi per confermare l’efficacia e la sicurezza del trattamento e per valutarne la possibile traduzione in protocolli terapeutici per i pazienti. Negli ultimi anni, alcuni farmaci diretti contro Kras sono stati approvati per l’uso clinico, ma la loro efficacia è spesso limitata dallo sviluppo di resistenze. L’approccio combinato proposto dal gruppo spagnolo mira proprio a superare questo problema, intervenendo simultaneamente su più vie molecolari. Resta da verificare se questa strategia potrà essere confermata in studi successivi e se potrà portare a benefici concreti per i pazienti. (D. E.).

dalla

sapere e i risultati incoraggianti

mortalità ancora molto elevata

Capire come agiscono le cellule tumorali è una sfida che la ricerca ha posto da tempo in cima alla lista delle priorità. Proprio di recente si è celebrata la Giornata Mondiale del Cancro, iniziativa promossa dall’Unione Internazionale per il Controllo del Cancro e dall’Organizzazione Mondiale della Sanità per mantenere alta l’attenzione su quella che è una delle principali cause di morte nel mondo.

I numeri e le previsioni restano allarmanti, nonostante gli evidenti passi avanti compiuti negli ultimi anni: le stime riferiscono che entro il 2050 si potrebbe superare quota 35 milioni di diagnosi. Per intenderci: nel 2022 sono

state 20 milioni le persone a cui è stato diagnosticato un tumore per un totale di 9,7 milioni di decessi. La speranza, allora, passa dai nuovi studi, dalle ore trascorse in laboratorio con l’obiettivo di provare a far luce su un male che costituisce una minaccia globale. Proprio dall’Italia arriva una scoperta importante, che può segnare un punto di svolta.

Un gruppo interdisciplinare dell’Istituto Airc di Oncologia Molecolare Ets (Ifom) di Milano, dell’Università Statale di Milano e dell’Università degli Studi di Perugia, del Cnrs-Institut Curie di Parigi e dell’Istituto Officina dei materiali del Consiglio nazionale delle ricerche (Cnr-Iom) di Perugia ha messo a punto una nuova piattafor -

Possibile svolta nella lotta al cancro: sviluppata una piattaforma innovativa che apre le porte a nuove terapie

ma di microscopia fotonica integrata che consente di osservare in tempo reale come agiscono le cellule tumorali, come ricevono e trasformano gli stimoli meccanici e come le risposte a tali stimoli possono influenzare la crescita di un tumore, la sua invasività e la capacità di dare metastasi.

I risultati della ricerca, coordinata da Giorgio Scita e Brenda Green dell'Ifom e da Silvia Caponi del Cnr-Iom, sono stati pubblicati sull’autorevole rivista Advanced Science: grazie a questa intuizione, sarà possibile capire meglio come progrediscono i tumori e, di conseguenza, l’obiettivo è riuscire a ottenere nuove ed efficaci terapie per contrastarli.

Nel dettaglio, la piattaforma, che combina per la prima volta la tecnica Brillouin, in grado di misurare tramite la luce le proprietà meccaniche, e la tecnologia Raman, capace di rivelare invece le proprietà biochimiche, consente di misurare simultaneamente proprietà meccaniche e risposte biochimiche in sferoidi, ossia masse cellulari microscopiche in tre dimensioni, ottenuti da cellule di tumore del seno. Ebbene, dagli esperimenti condotti è emerso che deformazioni cicliche attivano rapidamente il gene dello stress ATF3, da cui conseguono comportamenti più invasivi. Nelle parole di Silvia Caponi, fisica del Cnr-Iom di Perugia, la portata di quanto venuto a galla: «Per la ricerca sul cancro questo progresso è fondamentale. La piattaforma rappresenta un salto di qualità nella diagnostica ottica».

«Questa tecnologia - evidenzia il direttore del laboratorio Meccanismi di migrazione delle cellule tumorali di Ifom Ets, Giorgio Scita - apre una nuova prospettiva per lo studio dei tumori in sistemi tridimensionali come gli sferoidi tumorali. Un importante passo avanti». (D. E.).

RICERCATORI DELL’IOCB DI PRAGA

SONO RIUSCITI A OSSERVARE

L’INIZIO DELLA TRASCRIZIONE

IN VITRO E HANNO DESCRITTO

UN NUOVO MECCANISMO LEGATO

AI CAP ALARMONE E ALLO STRESS CELLULARE

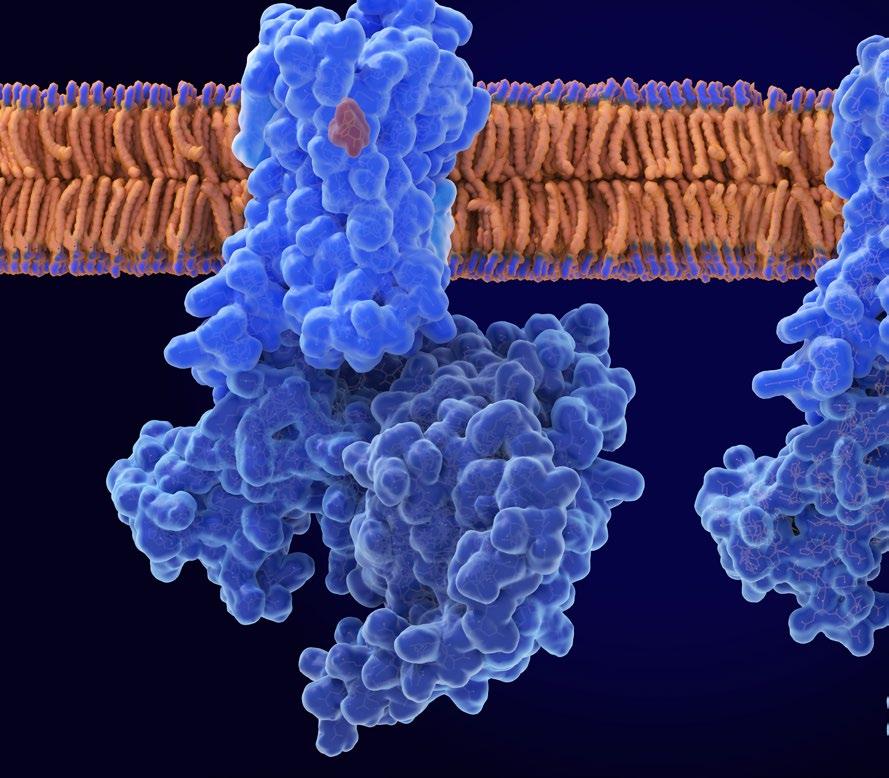

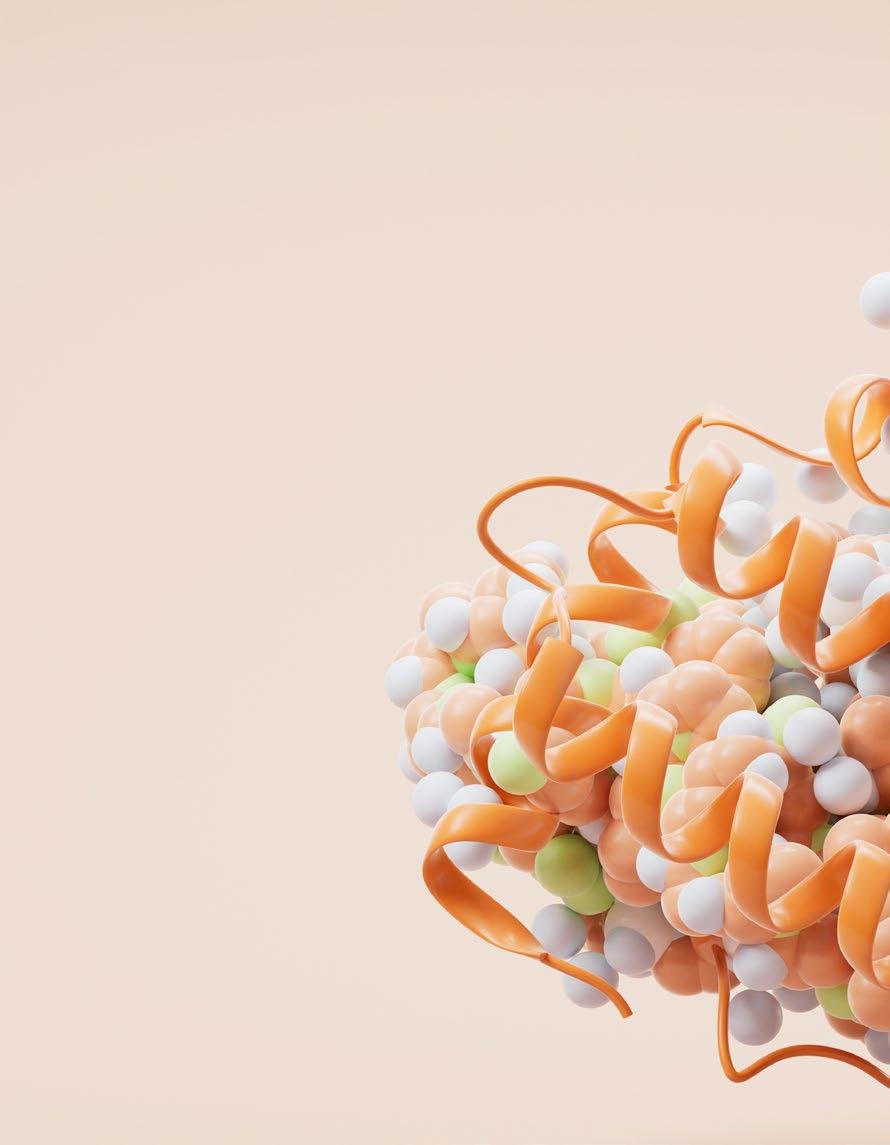

Gli scienziati dell’Istituto di Chimica Organica e Biochimica dell’Accademia Ceca delle scienze di Praga (IOCB) hanno identificato un meccanismo molecolare finora sconosciuto attraverso il quale può essere avviata la trascrizione delle informazioni genetiche dall’acido desossiribonucleico (DNA) all’acido ribonucleico (RNA). I ricercatori hanno focalizzato il loro studio su una specifica classe di molecole note come alarmoni, che si trovano nelle cellule di una vasta gamma di organismi e i cui livelli spesso aumentano in condizioni di stress cellulare. I risultati della ricerca sono stati pubblicati sulla rivista Nature Chemical Biology.

Come spiegano gli autori dello studio, le molecole di acido ribonucleico possono presentare alla loro estremità una serie di modificazioni chimiche, denominate “cappucci” (cap). Negli organismi eucarioti, comprese le cellule umane, il cap più classico dell’mRNA svolge un ruolo fondamentale nel garantire la stabilità della molecola e nel regolarne il destino successivo all’interno della cellula. Negli ultimi anni, tuttavia, è diventato chiaro che esistono anche cap alternativi e non canonici, sebbene la loro formazione e i meccanismi con cui si legano all’RNA rimangano solo parzialmente compresi. Questi, come spiegato nello studio, includono i cap alarmone, formati da molecole di dinucleoside polifosfato, che proteggono l’RNA cellulare nei momenti in cui la cellula è minacciata.

L’RNA con cappuccio di polifosfati dinucleosidici è stato scoperto solo di recente nei bat-

teri e negli eucarioti e rappresenta una classe di modifiche all’estremità 5’ che si differenzia dal classico cappuccio di 7-metilguanosina. Mentre il cappuccio standard serve a proteggere l’mRNA e facilitare la traduzione, i cappucci di polifosfati dinucleosidici sono spesso derivati da metaboliti cellulari. In molti organismi, inclusi batteri e cellule eucariotiche, questi cappucci vengono incorporati durante l’inizio della trascrizione quando l’RNA polimerasi utilizza un dinucleoside polifosfato come “primer” invece di un singolo nucleoside trifosfato (NTP).

Nello studio, Hana Cahová e i suoi colleghi hanno osservato la RNA polimerasi batterica e hanno studiato come questo enzima possa avviare la trascrizione utilizzando polifosfati dinucleosidici (NpN) invece dei normali mattoni dell’RNA. Negli organismi procarioti ed eucarioti, la concentrazione di dinucleosidi polifosfati aumenta drasticamente durante lo stress cellulare ossidativo o termico. L’inserimento di questi cappucci nell’RNA funge quindi da segnale o risposta a tali condizioni.

Nello studio gli autori hanno descritto per la prima volta a livello atomico come l’RNA con un cappuccio alarmone possa essere generato direttamente all’inizio della trascrizione genica. Gli scienziati hanno utilizzato una serie di modelli di DNA in combinazione con polifosfati dinucleosidici e RNA polimerasi modello proveniente dal Thermus thermophilus. Dalla ricerca è emerso che il sito di inizio della trascrizione può variare in base alla compatibilità tra il modello specifico e il polifosfato dinucleosidico. Gli scienziati hanno anche osservato che i NpN si legano attraverso un tipo di accoppiamento di basi diverso da quello tipicamente osservato.

Il lavoro, chiariscono gli autori, fornisce una spiegazione strutturale di come i polifosfati

dinucleosidici iniziano la trascrizione dell’RNA. Utilizzando dati di microscopia elettronica criogenica, il team ha mostrato come le molecole di polifosfati dinucleosidici si legano all’interno del sito attivo della RNA polimerasi, ovvero il nucleo dell’enzima dove viene trascritta l’informazione genica. Hana Cahová ha affermato: «Stiamo descrivendo qualcosa che accade realmente nelle cellule e che ora siamo in grado di osservare direttamente a livello delle singole molecole. Questo ci permette di rispondere a domande fondamentali sui processi cellulari, come ad esempio il modo in cui le cellule si adattano allo stress. L’RNA svolge un ruolo centrale in questo processo, poiché trasporta la cascata di informazioni alla base di qualsiasi risposta cellulare, ad esempio alle condizioni di pericolo causate dalla carenza di nutrienti o dallo shock termico».

L’impiego della microscopia elettronica criogenica è stato determinante per il progetto. Nella microscopia crioelettronica il campione viene studiato a temperature criogeniche e osservato nel suo ambiente nativo senza essere colorato o fissato in alcun modo. Si tratta pertanto di una tecnica particolarmente utile in biologia strutturale dove è fondamentale poter osservare le macromolecole biologiche nella loro conformazione nativa.

Tomáš Kouba, uno degli autori dello studio, ha spiegato quali sono i vantaggi della tecnica: «La microscopia elettronica criogenica ci permette di congelare le molecole biologiche in uno stato molto vicino alla loro forma naturale e quindi di determinarne la struttura tridimensionale». «Ciò ci ha permesso - ha proseguito Kouba - di guardare direttamente nei centri attivi degli enzimi e di osservarne la funzione fino al livello atomico». (S. B.).

Corso Ecm

Nutrizione Clinica in Oncologia e Pediatria

Evidenze, Esperienza e Casi reali

23 aprile 2026

Milano

4.2 Ecm

Uno studio americano ha individuato un meccanismo che consente ai batteri di trasmettere informazioni genetiche che favoriscono virulenza e multiresistenza agli antibiotici

LA RESISTENZA AGLI ANTIBIOTICI È IN AUMENTO A LIVELLO GLOBALE. I CEPPI BATTERICI STANNO DIVENTANDO SEMPRE PIÙ VIRULENTI E RESISTENTI A PIÙ TIPI DI FARMACI, LE OPZIONI

TERAPEUTICHE A DISPOSIZIONE SI STANNO RIDUCENDO

Un team di biologi dell’Università americana di Albany ha identificato nei batteri un sistema di comunicazione che permette lo scambio di informazioni genetiche e favorisce l’acquisizione di resistenze a più classi di antibiotici.

La nuova ricerca approfondisce la comprensione dei meccanismi attraverso cui i microrganismi sviluppano la resistenza a farmaci un tempo efficaci, un tema sempre più centrale e urgente per la ricerca biomedica.

Oggetto dello studio, pubblicato sulla rivista Nature Communications, è il batterio Listeria monocytogenes, presente nel suolo, nell’acqua e nella vegetazione. Questo microrganismo può contaminare numerosi alimenti, tra cui latte, verdure, formaggi molli e carni poco cotte, ed è responsabile della listeriosi, una patologia che può diffondersi anche al sangue e al cervello, dando origine a condizioni potenzialmente letali come sepsi, meningite ed encefalite.

Il nuovo studio potrebbe fornire informazioni utili per lo sviluppo di nuovi farmaci e, potenzialmente, di futuri approcci per la medicina personalizzata.

Cheryl Andam, autore responsabile dello studio e professore presso l’Università di Albany, ha affermato: «La resistenza agli antibiotici è in aumento a livello globale. I pazienti contraggono infezioni un tempo curabili, ma poiché i ceppi batterici stanno diventando sempre più virulenti e resistenti a più tipi di farmaci, le opzioni terapeutiche a disposizione si stanno riducendo».

«Nella corsa per capire come ciò avvenga –ha continuato Andam - le nostre ultime sco -

perte svelano un pezzo fondamentale del puzzle: i batteri possiedono intricate reti di comunicazione, all’interno delle quali i diversi componenti sono in grado di interagire e collaborare in modi finora sconosciuti».

Come spiegato dagli autori dello studio, nelle cellule dei batteri esistono brevi frammenti di DNA chiamati “elementi genetici mobili” che trasportano informazioni e si presentano in molte forme diverse, tutte con funzioni e strutture differenti. In genere questi elementi sono raggruppati, in base alle loro caratteristiche, in categorie come plasmidi, fagi e trasposoni.

«Prima di questo studio – rivela Andam - sapevamo che gli elementi genetici mobili di un particolare tipo potevano scambiarsi informazioni tra loro; quello che non sapevamo è che anche tipi diversi di elementi genetici mobili possono comunicare