ROK AI Z CAŁĄ PEWNOŚCIĄ

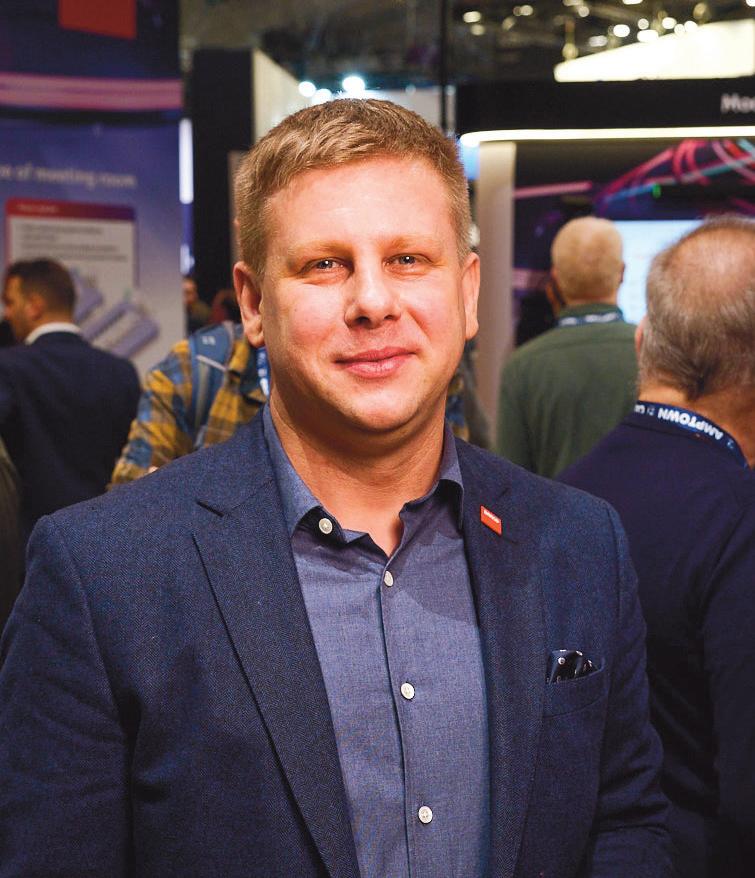

MARIUSZ ZIÓŁKOWSKI, VICE PRESIDENT, POLAND & SEE

TD

SYNNEX

WIELE OSÓB Z BRANŻY IT TWIERDZI, ŻE JESTEŚMY

TYTUŁEM PIERWSZEGO WYBORU

DRODZY CZYTELNICY,

Branża IT nigdy nie znosiła próżni, ale ostatnie miesiące przypominają, że funkcjonujemy w bardzo dynamicznym środowisku. Z jednej strony zmagamy się z bardzo realnymi wyzwaniami rynkowymi, z drugiej –wchodzimy w kolejne etapy transformacji, niesionymi przez AI, ale i zmiany w polskim prawie. Jednocześnie wiele się dzieje w obszarze branżowych wydarzeń. W tym numerze „IT Reseller” staramy się uchwycić ten fascynujący, momentami złożony, technologiczny krajobraz.

Nie uciekamy od tematu, który w ostatnich miesiącach spędza sen z powiek wielu dystrybutorom i integratorom – kryzysu na rynku pamięci. Niedobory na globalnym rynku, wzrost cen i zmieniający się popyt konsumencki sprawiają, że planowanie długoterminowych strategii zakupowych stało się wyjątkowo skomplikowane. Na naszych łamach bez owijania w bawełnę analizujemy obecną sytuację, ale też szukamy światełka w tunelu, wskazując, kiedy możemy spodziewać się stabilizacji i jak w tym trudnym czasie chronić swoje marże.

Tam, gdzie jeden segment rynku łapie zadyszkę, inny przyspiesza. Sztuczna inteligencja przestała być tylko chwytliwym hasłem marketingowym, a stała się realnym narzędziem biznesowym. Doskonałym tego przykładem jest start programu Destination AI przygotowanego przez TD SYNNEX. Przyglądamy się wraz z globalnym dystrybutorem, jak ta inicjatywa ma pomóc partnerom kanałowym w poruszaniu się po zawiłym świecie rozwiązań opartych na sztucznej inteligencji, od infrastruktury po usługi, dając im konkretne narzędzia do monetyzacji tego trendu.

Rozwój AI i zaawansowanych algorytmów nie miałby racji bytu bez odpowiedniego zaplecza sprzętowego. Dlatego zapraszam Was także do lektury rozmowy na temat stacji roboczych. Dyskutujemy w niej z przedstawicielami Dell Technologies, AB i Microsoft o tym, jak lokalna moc obliczeniowa wraca do łask i jak potężne maszyny stają się niezbędnym narzędziem w rękach dzisiejszych profesjonalistów, twórców i inżynierów.

W tym wydaniu zabieramy Was również na Półwysep Iberyjski, który na kilka dni stał się technologicznym pępkiem Europy. Targi ISE w Barcelonie to jak co roku garść nowinek ze świata profesjonalnego AV. Przywozimy dla Was obszerną relację z największego święta tej branży. Pokazujemy, jak zacierają się granice między tradycyjnym IT a nowoczesnym rynkiem audiowizualnym.

Za nami trzecia już edycja AVDS Awards! Warto z całą mocą podkreślić, że to wydarzenie to unikalna inicjatywa i jedyne miejsce w Polsce, gdzie w jednym czasie spotyka się cała branża AV – przedstawiciele vendorów, dystrybutorów oraz integratorów. AVDS Awards to nie tylko wyróżnienia, ale także przestrzeń do wymiany myśli i inspiracji. Wszystkim laureatom jeszcze raz bardzo serdecznie gratulujemy i życzymy kolejnych sukcesów!

Niezależnie od tego, czy zmagacie się z optymalizacją stanów magazynowych, czy właśnie wdrażacie u klientów pierwsze duże projekty oparte na AI, wierzę, że ten numer dostarczy Wam nie tylko rzetelnej wiedzy, ale i solidnej dawki inspiracji. Przyjemnej lektury i udanego biznesu!

Krzysztof Bogacki

Redaktor naczelny IT Reseller

Aby pobrać magazyn w wersji elektronicznej, zeskanuj kod QR

www.itreseller.pl

NIEZASTĄPIONE ŹRÓDŁO INFORMACJI Z BRANŻY IT, TYTUŁ WYDAWANY

NIEPRZERWANIE OD 2002 ROKU.

NAKŁAD DRUKOWANY 5 000 egzemplarzy

WERSJA ELEKTRONICZNA +15 000 egzemplarzy

PRENUMERATA prenumerata@itreseller.pl ISSN 1730-010X

WYDAWCA

SMART MEDIA SP. Z O.O. Domaniewska 47/10 02-672 Warszawa, PL biuro@itreseller.pl

REDAKCJA

ADRES BIURA REDAKCJI ul. Domaniewska 47/10 02-672 Warszawa, PL redakcja@itreseller.pl

+48

MARIUSZ LAURISZ CEO / Wydawca m.laurisz@itreseller.pl

KRZYSZTOF BOGACKI Redaktor naczelny k.bogacki@itreseller.pl

RAFAŁ SKRZYPEK Sekretarz redakcji r.skrzypek@itreseller.pl

MIECZYSŁAW T. STARKOWSKI m.starkowski@itreseller.pl

EWELINA STÓJ e.stoj@itreseller.pl

REKLAMA I WSPÓŁPRACA

ADRES BIURA Domaniewska 47/10 02-672 Warszawa, PL reklama@itreseller.pl +48 601 583 698

SERWISY INTERNETOWE www.itreseller.pl

Zdjęcia: archiwum IT Reseller, materiały prasowe, AdobeStock, Piotr Gamdzyk

TO BĘDZIE ROK AI #369

Z CAŁĄ PEWNOŚCIĄ

19

SPIS TREŚCI

MARIUSZ ZIÓŁKOWSKI, VICE PRESIDENT, POLAND & SEE W TD SYNNEX

6 UROCZYSTA GALA AVDS AWARDS 2026 –POZNALIŚMY LAUREATÓW BRANŻY AV

14 Z CAŁĄ PEWNOŚCIĄ TO BĘDZIE ROK AI

MARIUSZ ZIÓŁKOWSKI, VICE PRESIDENT, POLAND & SEE W TD SYNNEX

20 WINDOWS I AI: FUNDAMENT NOWEJ ERY CHRIS PAPAPHOTIS, EMEA HEAD OF DISTRIBUTION, COMMERCIAL DEVICES & SOLUTION SALES W MICROSOFT

26 DESTINATION AI JAK ZARABIAĆ NA TRANSFORMACJI W CIENIU NIEDOBORÓW SPRZĘTOWYCH?

JACEK KOTYNIA, BUSINESS UNIT MANAGER CLOUD ORAZ RAFAŁ CIEMIĘGA, BUSINESS DEVELOPMENT MANAGER, DATA ANALYTICS, AI & IOT W TD SYNNEX

32 OD EKSPERYMENTÓW DO STRATEGII – JAK LIDERZY WDRAŻAJĄ AI W ORGANIZACJACH

36 SERCE EKOSYSTEMU PROFESJONALISTY –CZY MOŻNA SOBIE POZWOLIĆ NA BRAK CIĄGŁOŚCI?

ARKADIUSZ KWIATKOWSKI, SENIOR PARTNER DEVELOPMENT MANAGER W MICROSOFT; KONRAD PLEBAN,

CENTRAL EASTERN EUROPE WORKSTATIONS LEAD W DELL TECHNOLOGIES ORAZ JAROSŁAW BANAŚ, SENIOR BUSINESS UNIT MANAGER PC SYSTEMS W AB S.A.

40 THE TIME IS NOW! AXENCE STAWIA NA ROZWÓJ SPRZEDAŻY PARTNERSKIEJ

42 W DOBIE AUTOMATYZACJI –KARIERA M-SHAPE JAKO POLISA UBEZPIECZENIOWA

46 STRONA INTERNETOWA W 1 MINUTĘ ANETA RUTKOWSKA, COO LH.PL

48 AMBITNE PLANY MINISTERSTWA CYFRYZACJI

52 HP UMACNIA SWOJĄ POZYCJĘ W POLSCE

54 NAJLEPSZY PIERWSZY KWARTAŁ W HISTORII – MOCNE OTWARCIE ROKU GRUPY AB

58 ETYKA W AI cz.1 – MIĘDZY KODEM A SUMIENIEM A KOMU TO W OGÓLE POTRZEBNE?

62 JAK BOOM NA AI DRENUJE RYNEK PAMIĘCI

64 ZDECYDOWANIE TO PAMIĘĆ TERAZ NADAJE TON MACIEJ KAMIŃSKI, DYREKTOR DYWIZJI MEMORY W SAMSUNG ELECTRONICS NA POLSKĘ I CEE

68 NIEUNIKNIONA OPTYMALIZACJA ZAKUPÓW IT?

DARIUSZ OKRASA, SENIOR CHANNEL SALES MANAGER W DELL TECHNOLOGIES

72 ETYKA W AI cz. 2 – MIĘDZY KODEM A SUMIENIEM JEDNYM ETYKA UMYKA, DRUGI SIĘ O NIĄ POTYKA

76 ACER „ROAD TO 50” W MEDIOLANIE –NOWY EKOSYSTEM TECHNOLOGII DLA BIZNESU

80 INTEGRATED SYSTEMS EUROPE 2026 – REKORDY, SKALA I TARGI, KTÓRE PRZESTAŁY BYĆ TYLKO TARGAMI

98 MWC 2026 – AI, SKŁADANE SMARTFONY I ROBOTYZACJA

AVDS AWARDS 2026

POZNALIŚMY LAUREATÓW BRANŻY AV

DESTINATION AI

JAK ZARABIAĆ NA TRANSFORMACJI W CIENIU NIEDOBORÓW SPRZĘTOWYCH?

REKORDY, SKALA I TARGI, KTÓRE PRZESTAŁY BYĆ TYLKO TARGAMI

WINDOWS I AI

FUNDAMENT NOWEJ ERY

SERCE EKOSYSTEMU PROFESJONALISTY

CZY MOŻNA SOBIE POZWOLIĆ NA BRAK CIĄGŁOŚCI?

AVDS AWARDS 2026

WYDARZENIE, KTÓREBRANŻĘ AVŁĄCZY

Wyjątkowy wieczór dla branży AV i DS – tak można w wielkim skrócie opisać tegoroczną edycję AVDS Awards – wydarzenia, które jest unikatowym spoiwem dla tego niezwykle złożonego sektora

Trzecia edycja AVDS Awards już za nami! Najważniejsze wydarzenie dla polskiej branży audio-wideo i digital signage po raz kolejny pokazało, że wspólne świętowanie sukcesów to niezwykle ważny element naszego rynku. Tegoroczną ceremonię poprowadził Krzysztof Bogacki, redaktor naczelny IT Reseller. Miejscem wydarzenia był prestiżowy, warszawski hotel Bellotto, który mieści się w zabytkowych murach XVI-wiecznego Pałacu Prymasowskiego – miejsca o niezwykle bogatej historii, które mimo wielokrotnych przebudów i wojennych zawirowań przetrwało do naszych czasów jako jedna z architektonicznych pereł stolicy.

– To już trzeci raz, kiedy mamy wielką przyjemność gościć Was na jedynej w branży – corocznej, uroczystej gali wręczania nagród branży AV w Polsce – AVDS Awards 2025. To bez wątpienia wielki zaszczyt, ale i niezwykła przyjemność, nie tylko móc gościć, ale i nagradzać tak znakomitych gości, z całą pewnością elitę branży AV w Polsce. – podkreślił Mariusz Laurisz, CEO IT Reseller. – Chciałbym Wam bardzo ser-

decznie podziękować za zaufanie i za to, że nasza gala doskonale wpisała się w kalendarz naszej branży, stając się idealną okazją do ukoronowania Waszej ciężkiej pracy. Drodzy przyjaciele dziękuję, że jesteście z nami. Pamiętajcie, że zawsze możecie na nas liczyć, życzę udanego i pełnego sukcesów wieczoru! O tym, jak ważne są takie spotkania dla całej społeczności, przypomniał prowadzący wydarzenie: – Idea AVDS Awards wzięła się z potrzeby stworzenia jednego miejsca, w którym spotykają się przedstawiciele polskiej branży AV. Kiedyś, na prowadzonych jeszcze w Amsterdamie, targach ISE, były, chociaż nieoficjalnie, takie miejsca, które polską branżę AV skupiały. Dziś organizujemy AVDS Awards, także po to, by przywrócić tamtą atmosferę – powiedział Krzysztof Bogacki, redaktor naczelny IT Reseller – Cieszymy się, że po raz kolejny jesteście z nami. Chciałbym Wam ogromnie podziękować za nasze niedawne spotkania podczas tegorocznych targów ISE w Barcelonie oraz za to, że tak licznie przybyliście dzisiaj

na galę AVDS Awards. Wiedzcie, że obserwujemy i doceniamy wasz całoroczny wysiłek, a ta gala jest za ów wysiłek podziękowaniem.

Mimo klasycznej i eleganckiej oprawy nie zabrakło tego, co w AVDS Awards najważniejsze – doskonałej, swobodnej atmosfery. Zamiast sztywnej, formalnej gali, po raz kolejny udało się nam stworzyć przestrzeń przypominającą spotkanie dobrych znajomych i partnerów biznesowych. I nie jest to wrażenie złudne. Wyjątkową cechą branży AV i DS są prawdopodobnie właśnie owe ciepłe relacje na gruncie ludzkim, nawet jeśli na rynku trwa rywalizacja o każdy przetarg i klienta.

Oczywiście na scenie nie mogło zabraknąć naszego zespołu redakcyjnego, dzięki któremu nasza prestiżowa gala odbyła się w tak wyjątkowej atmosferze. Ewelina Stój oraz Rafał Skrzypek, choć zazwyczaj ukryci za ekranami monitorów i redakcyjnymi kulisami, to także ich determinacja, dbałość o każdy detal i codzienne zaangażowanie sprawiają, że możemy wspólnie celebrować takie wydarzenia, jak AVDS Awards.

Warto z całą mocą podkreślić, że AVDS Awards to unikalna inicjatywa i jedyne miejsce w Polsce, gdzie w jednym czasie spotyka się cała branża AV – przedstawiciele vendorów, dystrybutorów oraz integratorów. AVDS Awards to nie tylko wyróżnienia, ale także przestrzeń do wymiany myśli i inspiracji. W rozmowach przewijały się kluczowe zagadnienia dotyczące przyszłości branży, a eksperci podkreślali rosnące znaczenie innowacji i adaptacji do zmieniających się oczekiwań rynku. Najważniejsza była jednak świetna atmosfera podczas wydarzenia. Podobnie jak rok temu przyjęliśmy formułę wydarzenia łączącą galę rozdania nagród branżowych, swobodnego wieczornego spotkania znajomych i… koncertu.

Podobnie jak rok temu, świętowaliśmy na rockowo. Jak co roku branża AV świetnie się bawiła przy muzyce Adama Kalinowskiego, finalisty The Voice of Poland.

Laureaci AVDS Awards 2026

Najważniejszym punktem programu było oczywiście nagrodzenie firm, roz-

wiązań i osób, które w minionym roku wyróżniły się szczególnym wkładem w rozwój sektora. Poniżej prezentujemy pełną listę tegorocznych triumfatorów:

q Zwycięzcą kategorii Monitory Interaktywne została firma iiyama.

q Kategorię Monitory LCD nabiurkowe wygrała firma Samsung Electronics.

q Zwycięzcą kategorii Monitory Wielkoformatowe została firma LG Electronics

q Kategorię Ekrany LED wygrała firma Samsung Electronics.

q Zwycięzcą kategorii Projektory została firma Panasonic.

q Kategorię Edukacja wygrała firma Newline Interactive.

q Zwycięzcą kategorii Retail została firma Hisense.

q Kategorię Systemy do Bezprzewodowej Komunikacji wygrała firma Barco.

q Zwycięzcą kategorii Systemy i Rozwiązania Audio została firma HP Poly / HP Inc Polska.

q Kategorię Infrastruktura dla sal konferencyjnych wygrała firma Crestron.

q Zwycięzcą kategorii Innowacje w video collaboration została firma HP Poly / HP Inc Polska.

q Kategorię Innowacje w sali konferencyjnej wygrała firma Logitech.

q Zwycięzcą kategorii Innowacje w prezentacji obrazu została firma LG Electronics.

q Kategorię Ekosystem wideokonferencyjny wygrała firma Barco.

q Kategorię Debiut roku wygrała firma Dahua Technology

q Zwycięzcami w kategorii Lider integracji AV w Polsce, przyznawanymi wraz z firmą Samsung Electronics, zostały firmy: AVC Edukacja PROMEDIO

q Zdobywcami nagród w kategorii Lider integracji AV w Polsce, przyznawanymi wraz z firmą LG Electronics okazały się firmy: GMT Sp. z o.o. Trocon Sp. z o.o.

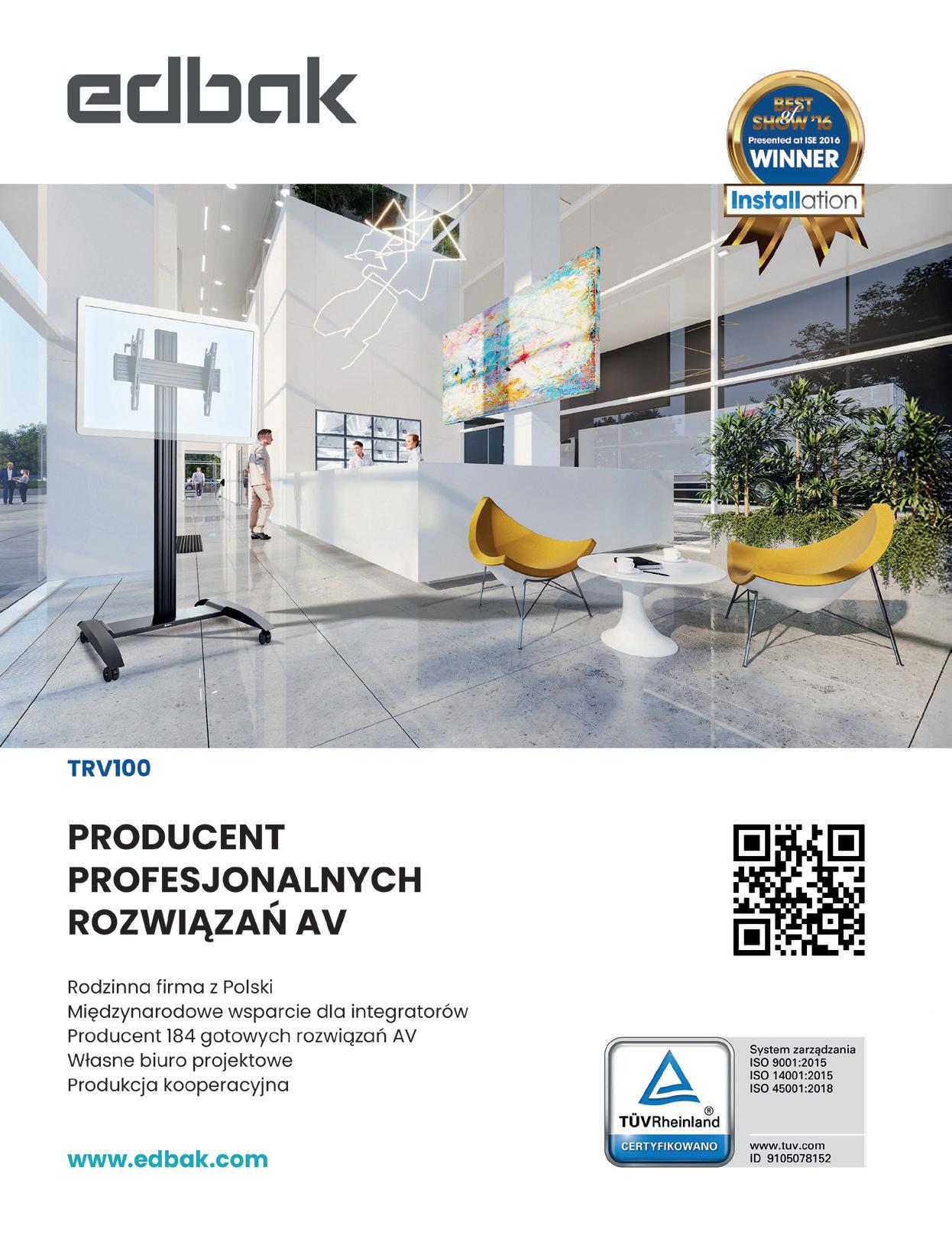

q Zwycięzcą w kategorii Lider integracji AV w Polsce, przyznawanej wraz z firmą Edbak, została firma Dimension4

q Zwycięzcą kategorii Wydarzenie roku została firma TD SYNNEX

q Zwycięzcą w kategorii Wdrożenie roku została firma Edbak

q Kategorię Dystrybutor Roku wygrała firma AB S.A.

q Zwycięzcą w kategorii Osobowość branży został Mariusz Kuczyński, iiyama.

AVDS Awards 2026 – wyjątkowe wydarzenie, które doskonale łączy ludzi i branżę Podziękowań tego wieczoru padło wiele. Nie tylko kierowane w stronę własnych zespołów, ale też innych uczestników łańcucha dostaw, konkurencji czy wreszcie czytelników naszego magazynu. Pomimo iż na sali byli przedstawiciele firm, które na co dzień intensywnie konkurują, ta serdeczność nie ograniczała się jedynie do słów na scenie.

Wszystkim laureatom jeszcze raz bardzo serdecznie gratulujemy i życzymy kolejnych sukcesów! Już dziś, zapraszamy na kolejną, czwartą już edycję AVDS Awards 2027 za rok! Do Zobaczenia!

Trzecia edycja AVDS Awards po raz kolejny pokazała, że to nie tylko prestiżowe wyróżnienia, ale przede wszystkim fantastyczna okazja do spotkania ludzi z pasją. Świetna muzyka, inspirujące rozmowy i swobodna atmosfera sprawiły, że uczestnicy opuszczali wydarzenie z uśmiechem na twarzy. Już teraz nie możemy doczekać się kolejnej edycji w 2027 roku! – Wszystkim laureatom jeszcze raz bardzo serdecznie gratulujemy i życzymy kolejnych sukcesów – podkreślił Mariusz Laurisz, CEO IT Reseller, zapraszając na kolejną, czwartą już edycję AVDS Awards 2027 za rok. n

Skomentuj, polub lub udostępnij! Artykuł dostępny w wersji cyfrowej

www.itreseller.pl

LAUREACI AVDS AWARDS 2026

◆ Zwycięzcą kategorii Monitory Interaktywne została firma: iiyama

◆ Kategorię Monitory LCD nabiurkowe wygrała firma: Samsung Electronics

◆ Zwycięzcą kategorii Monitory Wielkoformatowe została firma: LG Electronics

◆ Kategorię Ekrany LED wygrała firma: Samsung Electronics

◆ Zwycięzcą kategorii Projektory została: firma Panasonic

◆ Kategorię Infrastruktura dla sal konferencyjnych wygrała firma: Crestron

◆ Kategorię Edukacja wygrała firma: Newline Interactive

LAUREACI AVDS AWARDS 2026

◆ Zwycięzcą kategorii Retail została firma: Hisense

◆ Kategorię Systemy do Bezprzewodowej Komunikacji wygrała firma: Barco

◆ Zwycięzcą kategorii Systemy i Rozwiązania Audio została firma: HP Poly / HP Inc Polska

◆ Zwycięzcą kategorii Innowacje w video collaboration została firma: HP Poly / HP Inc Polska

◆ Kategorię Innowacje w sali konferencyjnej wygrała firma: Logitech

◆ Zwycięzcą kategorii Innowacje w prezentacji obrazu została firma LG Electronics

◆ Kategorię Ekosystem wideokonferencyjny wygrała firma Barco

LAUREACI

AVDS AWARDS 2026

◆ Zwycięzcą w kategorii Wdrożenie roku została firma Edbak

◆ Kategorię Debiut roku wygrała firma Dahua Technology

◆ Zwycięzcami w kategorii Lider integracji AV w Polsce, przyznawanymi wraz z firmą Samsung Electronics, zostały firmy: AVC Edukacja oraz PROMEDIO

◆ Zwycięzcą w kategorii Lider integracji AV w Polsce, przyznawanej wraz z firmą Edbak, została firma: Dimension4

LAUREACI

AVDS AWARDS 2026

◆ Zdobywcami nagród w kategorii

LIDER INTEGRACJI AV w Polsce, przyznawanymi wraz z firmą

LG Electronics okazały się firmy: Trocon oraz GMT

◆ Zwycięzcą kategorii Wydarzenie roku została firma: TD SYNNEX

◆ Kategorię Dystrybutor Roku wygrała firma: AB S.A.

◆ Zwycięzcą w kategorii Osobowość branży został: Mariusz Kuczyński, iiyama

Wszystkim

laureatom jeszcze

raz bardzo serdecznie gratulujemy

i życzymy kolejnych sukcesów!

Do zobaczenia

na kolejnej, czwartej już edycji AVDS

Awards 2027 za rok!

Z CAŁĄ PEWNOŚCIĄ TO BĘDZIE ROK AI

Mariusz Ziółkowski, Vice President, Poland and South East Europe w TD SYNNEX, wyjaśnia, dlaczego skuteczna transformacja cyfrowa wymaga modelu hybrydowego, jak uniknąć błędów we wdrożeniach i jak przygotować się na nadchodzące wyzwania sprzętowe.

Rozpocznijmy od tematu, który zdominował ostatnie dyskusje biznesowe, czyli sztucznej inteligencji. Często jednak w tym zachwycie nad ułatwiającymi życie i pracę algorytmami, zapominamy o fundamencie, na którym stoją modele AI. Mam na myśli oczywiście chmurę. Jak z perspektywy TD SYNNEX wygląda obecnie symbioza między technologiami chmurowymi a rozwojem AI? Czy w ogóle możemy mówić o skutecznym wdrożeniu sztucznej inteligencji w przedsiębiorstwie bez wcześniejszej transformacji chmurowej?

To świetne pytanie, które dotyka sedna obecnych wyzwań cyfrowych i problemów, z jakimi mierzą się firmy, a w których my, jako globalny dystrybutor, staramy się wspierać naszych partnerów na polskim rynku. Warto przypomnieć, że TD SYNNEX wywodzi się z tradycji dystrybucji sprzętowej – pamiętamy czasy Avnetu, kiedy dystrybucja była stricte ukierunkowana na hardware, bo wówczas IT nie było właściwie niczym innym. Naturalnym etapem rozwoju było uzupełnienie tej oferty o software, a później oczywiście o rozwiązania chmurowe.

Jesteśmy największym dystrybutorem na świecie i – według naszej wiedzy –jako jedyni na polskim rynku posiadamy kontrakty ze wszystkimi trzema amerykańskimi hyperscalerami. Z naszej perspektywy transformacja chmurowa to proces ciągły, który postępuje i który aktywnie wspieramy. Dostarczamy naszym partnerom i ich klientom na-

rzędzia oraz programy edukacyjne, takie jak Akademia TD SYNNEX, gdzie pokazujemy integrację hardware’u, software’u i chmury. Tworzymy środowiska hybrydowe, prowadząc jednocześnie projekty dedykowane stricte AI i chmurze. Odpowiadając wprost: skuteczne wdrożenie AI jest nierozerwalnie związane z dojrzałością chmurową i hybrydową.

Wspominasz o partnerach wywodzących się z rozwiązań sprzętowych. Tutaj chyba najbardziej jaskrawym przykładem transformacji jest Microsoft Copilot.

Zgadza się. Na przykład Microsoft Copilot w M365 zadebiutował w segmencie Enterprise, a dopiero później został udostępniony szerzej firmom i konsumentom. To wywołało duże zapotrzebowanie na wiedzę – o tym, jak działa, jak przetwarza dane i jakie realne korzyści może przynieść.

My, jako globalny dystrybutor Microsoftu, od premiery nowej generacji urządzeń Copilot+ PC aktywnie edukujemy rynek na temat zalet lokalnego przetwarzania AI.

Nowe urządzenia wyposażone w dedykowane układy NPU (Neural Processing Unit) zapewniają wymierne korzyści: przejmują obliczenia AI z CPU i GPU, co wydłuża czas pracy na baterii i przyspiesza działanie aplikacji. Lokalne przetwarzanie sprawia, że wiele procesów – zwłaszcza tych związanych z multimediami i personalizacją – jest znacznie szybszych i bardziej responsywnych.

Windows 11 na Copilot+ PC integruje się z zaawansowanymi funkcjami, takimi jak dedykowany klawisz Copilot, tłumaczenia na żywo czy filtrowanie tła. Wiele z nich działa bezpośrednio na urządzeniu z wykorzystaniem mocy NPU, co poprawia wydajność, prywatność i stabilność pracy.

Osobiście, jako właściciel niewielkiego psa, najbardziej cenię sobie chyba jeden drobiazg – wycinanie dźwięków z tła podczas spotkań na Teams.

To dobry przykład AI działającego w tle, o którym nawet nie musimy myśleć. Z czasem zupełnie zapomnimy o tym, że kiedyś spotkania online mogły być “wzbogacone” o niechciane efekty dźwiękowe. Uważam, że to właśnie takie “niewidoczne AI”, działające dyskretnie, w tle, jest dziś prawdziwym, nieco pomijanym bohaterem rewolucji AI.

To prowadzi nas do kolejnego zagadnienia. Dlaczego obserwujemy ten wyraźny zwrot w stronę przetwarzania lokalnego?

Najbardziej istotną częścią tego trendu w biznesie jest konieczność wykorzystania modelu hybrydowego. Mówimy tu o sytuacji, gdzie każde opóźnienie generuje zbędny koszt lub wręcz uniemożliwia pracę. Wyobraźmy sobie autonomiczne roboty w magazynie. W przypadku przesyłania danych wyłącznie do chmury, opóźnienie rzędu 200, 300 czy 400 milisekund jest nie do przyjęcia. Dzięki rozwiązaniom hybrydowym i edge’owym, ten czas reakcji

Nasza główna rada? Nie rób wszystkiego naraz. Należy budować wdrożenia krok po kroku, systematycznie, dając pracownikom czas na adaptację i zdobycie niezbędnych umiejętności

Mariusz Ziółkowski Vice President, Poland and South East Europe w TD SYNNEX

spada do poziomu 5–15 milisekund, co pozwala na efektywną pracę w czasie rzeczywistym.

Jednak jest jeszcze drugi, równie ważny aspekt – dane i regulacje prawne. Prawo Unii Europejskiej oraz wewnętrzne regulacje firm obligują organizacje do specyficznego traktowania danych wrażliwych.

Czyli chodzi o to, że dane muszą być przetwarzane „tu i teraz”, bez wychodzenia na zewnątrz?

Dokładnie tak. Dane związane z HR, finansami czy innymi wrażliwymi obszarami często nie mogą opuścić organizacji. Muszą być one odpowiednio oznaczone i zabezpieczone wewnątrz infrastruktury, tak aby osoba bez uprawnień nie miała do nich wglądu. Suwerenność danych jest tutaj kluczowa.

Dodatkowym atutem jest redukcja kosztów. Inwestując w urządzenia, które przetwarzają dane lokalnie, zmniejszamy opłaty za zużycie zasobów chmurowych, ponieważ część operacji wykonujemy „u siebie”. Przepustowość łącza przestaje być wąskim gardłem.

Na pewno firmowa sieć na tym zyskuje, bo pracownicy nie pobierają masowo wygenerowanych dokumentów czy materiałów wideo, tylko tworzą je na żywo na urządzeniu, nie zapychając prostymi zadaniami mocy obliczeniowych, za które płaci się wcale niemałe pieniądze. Właśnie o to chodzi. To pewnego rodzaju optymalizacja, bo przecież nie musimy angażować dużego modelu AI, do zadań podstawowych, prostych. Byłoby to marnotrawieniem zasobów firmy z jednej strony, ale też wysoce nieekologicznym działaniem z drugiej. Do takich zadań zdecydowanie

lepiej jest używać mniejszych modeli, takich, które z powodzeniem mogą działać na komputerach Copilot+ PC. Jednocześnie tam, gdzie potrzeba mocy obliczeniowej dla znacznie bardziej złożonych modeli AI, należy postawić czy to na chmurę, czy na rozwiązania hybrydowe, czy wreszcie na moc własnej, firmowej serwerowni.

Mówiąc wprost – AI w firmie może działać na wielu poziomach, a my jesteśmy w stanie pomóc we wdrożeniu na każdym z nich. Jako dystrybutor staramy się łączyć to, co dają najwięksi producenci hardware’u ze światem chmurowym, wyciągając z obu tych światów to, co najlepsze. Mamy znakomite kontakty i kompetencje w obu tych obszarach. Nasi partnerzy są więc doskonale wyposażeni do tego, aby podejmować się takich realizacji.

Wspomniałeś o ryzyku wycieku danych. To chyba jeden z głównych argumentów za rozwiązaniami lokalnymi? Zdecydowanie. Dla przykładu, w dziale prawnym kluczowe jest, aby dane nie wyciekły i nie były wykorzystywane do trenowania modeli publicznych poza środowiskiem pracy. Microsoft w rozwiązaniach biznesowych, takich jak Microsoft 365 Copilot, gwarantuje tzw. Enterprise Data Protection. Oznacza to, że dane klienta nie są używane do uczenia modeli AI, a dostęp do nich jest ściśle kontrolowany. Tu wchodzi w grę kwestia Data Governance, czyli ustalenia hierarchii dostępu. Nie może być tak, że każdy ma dostęp do wszystkiego. Ja nie powinienem mieć wglądu w finanse, a Ty w HR. Musi istnieć jasna struktura uprawnień.

Właściwie jak przy okazji dowolnego narzędzia – trzeba wiedzieć jak je stosować. Z AI nie jest inaczej. Sztuczna inte-

ligencja jest w stanie pomóc, usprawnić procesy w firmie, zdjąć z pracowników uciążliwe, powtarzalne obowiązki. Jednak źle wdrożona, lub używana bez wdrożenia w ogóle, w sposób nieautoryzowany, AI może wyrządzić szkody w organizacji.

Co, niestety, nie jest wcale jakimś fikcyjnym scenariuszem. Widać to w badaniach, w których, udział pracowników deklarujących korzystanie z AI, jest znacząco wyższy niż deklaracje ze strony firm. Oznacza to, że wykorzystywane są prawdopodobnie modele powszechnie dostępne, które z podanych danych korzystają, aby się szkolić.

To prawda. Takich przypadków było wiele, a o większości wywołanych w ten sposób wycieków danych pewnie nigdy się nie dowiemy. Podobna praktyka będzie miała miejsce zawsze, gdy firma realnie może na AI skorzystać, pracownicy mogą ułatwić sobie pracę, ale nie zapadła decyzja o wdrożeniu.

Dlatego tak ważne jest, aby mieć odpowiednie wsparcie w całym procesie projektowania wdrożenia AI w firmie. Nie każdy musi mieć w tym względzie kompetencje we własnym zespole, ale trzeba wiedzieć gdzie tych kompetencji poszukiwać. Na polskim rynku działa wielu partnerów TD SYNNEX, którzy są już teraz wysoce wykwalifikowani do udzielania takiej pomocy. Z każdym nowym szkoleniem, które dla nich organizujemy, z każdym zrealizowanym wdrożeniem, stają się ekspertami. Co najważniejsze, oni też mają wsparcie: nas.

Przejdźmy do weryfikacji rynkowej. Mimo entuzjazmu, badania PwC wskazują, że 56 proc. inicjatyw związanych z AI globalnie nie przynosi oczekiwanych korzyści biznesowych. Z czego wynika tak wysoki odsetek niepowodzeń i czy widać to też w Polsce?

Obserwujemy bardzo podobne statystyki na rynku polskim. Najczęściej wynika to z braku przygotowania oraz luki kompetencyjnej po stronie klientów i partnerów. Największym błędem jest brak jasno zdefiniowanych celów projektu. AI spowodowało taką zmianę w podejściu biznesowym, że precyzyjne określenie, co chcemy osiągnąć, wcale nie jest łatwe. Cel musi być sprecyzowany – musimy wiedzieć, do czego narzędzie ma służyć. Kolejnym problemem jest jakość danych wejściowych. Jeśli „karmimy” AI danymi niskiej jakości, to – kolokwialnie

mówiąc – otrzymamy „śmieciowe” wyniki. Dlatego w TD SYNNEX prowadzimy program „Destination AI”. Wspólnie z vendorami, takimi jak Microsoft, oferujemy programy edukacyjne (np. AI Practice Builder), udostępniamy demo oraz wspieramy partnerów poprzez Center of Excellence, dzieląc się doświadczeniem z wdrożeń europejskich i światowych. Nasza główna rada? Nie rób wszystkiego naraz. Należy budować wdrożenia krok po kroku, systematycznie, dając pracownikom czas na adaptację i zdobycie niezbędnych umiejętności.

To pytanie może być nieco kontrowersyjne. Mówi się o boomie, ale pada też hasło „bańka”. Czy biznes nie przeinwestował w AI? Patrząc na wyceny niektórych spółek, można mieć skojarzenia z bańką tuż przed pęknięciem. Rozdzieliłbym to na „bańkę startupową” i realne wdrożenia AI. Rzeczywiście, powstało wiele startupów, z których – jak to w statystyce bywa –przetrwa zdecydowanie mniej niż 100 proc. Wiele z nich zostało już wchłoniętych przez globalnych graczy. Jednak, jeśli chodzi o technologię, nie nazwałbym tego bańką.

Rozwój rynku AI jest niezwykle dynamiczny. To już nie jest etap prostych chatbotów sprzed lat. Dziś mówimy o Copilot Studio, o tworzeniu własnych, autonomicznych agentów dopasowanych do specyfiki firmy. Skończyło się też kupowanie chmury „na wyrost”. Klienci nie zamawiają mocy obliczeniowej z kilkumiesięcznym wyprzedzeniem jak hardware’u, lecz skalują ją dynamicznie, płacąc nawet za roboczo-sekundy wykorzystania modeli AI.

Czyli to sytuacja bez precedensu, być może porównywalna do upowszechnienia się elektryczności. Przykładowo, taki General Electric do dziś jest potęgą, bo stał za fundamentalną zmianą, a nie chwilową modą. Dokładnie. To ogromna rewolucja. Giganci tacy jak Visa czy Mastercard inwestują ogromne środki, przejmując firmy z sektora AI i fintech. Nvidia czy Intel inwestują miliardy w infrastrukturę. Gdyby ci gracze nie „czuli pieniądza” i realnej wartości, nie angażowaliby tak potężnego kapitału.

Microsoft również wspaniale ewoluuje –zaczął od Copilota dla Enterprise, a teraz, widząc potrzeby rynku, wspiera producentów sprzętu, jak Dell, HP czy Lenovo w tworzeniu komputerów z wbudowanym AI. To synergia chmury, hardware’u i oprogramowania. Pieniądze w tym sektorze nie są przepalane, to są strategiczne inwestycje. Co więcej, to wszystko prowadzi do korzyści dla użytkow -

Jesteśmy największym dystrybutorem na świecie i – według naszej wiedzy – jako jedyni na polskim rynku posiadamy kontrakty ze wszystkimi trzema amerykańskimi hyperscalerami

Mariusz Ziółkowski

Vice President, Poland and South East Europe w TD SYNNEX

ników. Trudno kwestionować przydatność AI w codziennej pracy. Wystarczy skorzystać np. z Copilota, by zauważyć potencjał do wzrostu produktywności.

Nie mam wątpliwości – to będzie rok AI. Nie jest to slogan, czy puste hasło. To prognoza, którą widzimy w wynikach, w badaniach rynku, w rozmowach z partnerami. Wiele firm i organizacji dojrzało do wdrożeń AI, to będzie się działo w 2026 roku.

Na koniec chciałbym poruszyć temat bardziej przyziemny, ale kluczowy dla dystrybucji. Jakie są prognozy odnośnie dostępności komponentów, zwłaszcza pamięci? Wiemy, że producenci tacy jak Samsung, Micron czy SK Hynix przestawili linie produkcyjne na pamięci HBM (High Bandwidth Memory) m.in. pod nowe układy Nvidii, co wpływa na rynek PC. Micron zamknął nawet swoją konsumencką, dobrze odbieraną markę, Crucial.

To jest strategiczna zmiana, która nastąpiła w ostatnich miesiącach. Analizy rynkowe przewidują, że trudności w dostępie do pamięci RAM i dysków SSD będą się zwiększać. To wymusza na partnerach zmianę podejścia. Należy planować zakupy z dużym wyprzedzeniem. Można to porównać do czasów pandemii – łańcuchy dostaw są napięte, a czas oczekiwania wydłużony. Jeśli coś kiedyś przyjeżdżało w miesiąc, teraz może to trwać cztery i być droższe. Strategia „just-in-time” w tym momencie się nie sprawdzi. Jest to wyzwanie, ale traktujemy je jako okres przejściowy. Łańcuchy dostaw w końcu się ustrukturyzują. Obecnie doradzamy partnerom trzy rzeczy: po pierwsze, planowanie zamiast impulsywnych zakupów. Po drugie, rozbudowę i optymalizację tego, co już posiadają. A po trzecie – skorzystanie z siły strategicznego dystrybutora. Dzięki naszym globalnym kontraktom jesteśmy w stanie lepiej zabezpieczyć dostępność towaru, a w przypadku luk sprzętowych – oferujemy alternatywy w postaci rozwiązań chmurowych, które pozwalają zachować ciągłość biznesową klientów. n

WINDOWS I AI:

FUNDAMENT

NOWEJ ERY

O zmianie systemów Windows i rewolucji AI mówi Chris Papaphotis, EMEA Head of Distribution, Commercial Devices & Solution Sales, Microsoft w rozmowie z redaktorem naczelnym Krzysztofem Bogackim. Dotykamy zarówno tematu migracji z Windows 10, na Windows 11, ale też tego, co nadejdzie później. Pochylamy się także nad tematem sztucznej inteligencji i tego, jak na niej zarabiać.

Koniec wsparcia dla systemu Windows 10 był ważnym tematem pod koniec 2025 roku. Rynek z dużym napięciem wyczekiwał znaczącego cyklu wymiany sprzętu. Zdaje się, że ów proces nie przebiegł dostatecznie intensywnie. Jak to wygląda z dzisiejszej perspektywy?

Czy ta zmiana faktycznie nastąpiła w zakładanej skali i czy dla Waszych partnerów okazała się ona strategiczną szansą, czy raczej wyzwaniem sprzedażowym?

Szczerze mówiąc, to ciekawe stwierdzenie, ponieważ z naszej perspektywy dane sugerują bowiem, że ten proces okazał się ogromnym sukcesem. Zastanawiałem się, czy to nie jest kwestia polskiej perspektywy, dlatego chciałbym podzielić się konkretnymi dostępnymi danymi.

Poza naszymi wewnętrznymi statystykami, warto spojrzeć na dane StatCounter, które mierzą udział systemów operacyjnych. W Polsce jeszcze w sierpniu 2025 roku udział Windows 10 i Windows 11 był niemal równy. Na dzień dzisiejszy najnowsze dane StatCounter dla Polski są jednoznaczne: Windows 11 ma już około 72 proc. udziału w rynku, a Windows 10 spadł do poziomu 27 proc.. To znacząca zmiana.

Jak to przekłada się na sprzedaż? W całym regionie EMEA notowaliśmy wzrosty rzędu 10, 20, a nawet 30 proc. Niemcy urosły o ponad 45 proc., Wielka Brytania podobnie. Jeśli miałbym wskazać trend, to rynki Europy Zachodniej zareagowały błyskawicznie, osiągając około 85 proc. udziału Windows 11. Europa Środkowo-Wschodnia i rynki wschodzące pozostały odrobinę z tyłu. Jednakże Polska z wynikiem 72 proc. wypada świetnie na tle np. Hiszpanii czy Włoch, gdzie te wskaźniki oscylują w granicach 50–60 proc.

Zróżnicowanie geograficzne jest więc wciąż widoczne, ale dynamika u nas jest potężna. Nasi partnerzy raportują, że ostatnie 6–8 miesięcy to był najlepszy okres „sell-outu” urządzeń w ich historii. Wrzesień był rekordowy, a październik ten rekord powtórzył. Ten wzrost był napędzany głównie przez duże przedsiębiorstwa, dla których kluczowa jest zgodność z przepisami. Wiemy, że wiele firm dokonało zakupów, a teraz etapowo realizuje wdrożenia.

Dlatego z naszej perspektywy zakończenie wsparcia dla Windows 10 to sukces, choć praca nie jest jeszcze zakończona. W zależności od kraju, wciąż pozostaje od 20 do 30 proc. urządzeń do zmodernizowania. To jest ten wspomniany „długi ogon”, czyli głównie sektor MŚP (SMB).

To obszar, w którym musimy intensywnie współpracować z kanałem partnerskim. Firmy z sektora SMB często nie posiadają dedykowanych działów IT. O ile duży dział IT doskonale wie, co oznacza serwisowanie, aktualizacje i bezpieczeństwo, o tyle właściciel firmy z jednym, dwoma czy dziesięcioma komputerami polega na dorywczym wsparciu resellera. W segmencie Enterprise i Mid-market odnieśliśmy sukces, teraz czas na pełne zagospodarowanie przestrzeni w sektorze mniejszych przedsiębiorstw.

Windows 10 ma już ponad dziesięć lat. To relatywnie stare oprogramowanie, a jednak wciąż korzysta z niego mnóstwo osób. Wiem doskonale, że Microsoft kładzie duży nacisk na komunikację dotyczącą konieczności aktualizacji. Czy to wystarczy?

Przede wszystkim dziękuję za możliwość rozmowy na ten temat i przekazania tych informacji dalej. Windows 10 był projektowany i budowany w czasach, gdy komunikacja oraz współpraca przez internet wyglądały zupełnie inaczej. Stan cyberbezpieczeństwa na świecie również był wtedy na innym etapie.

Oczywiście doceniamy fakt, że klienci tak efektywnie wykorzystywali swoje zasoby i przez lata polegali na Windows 10. To był świetny system… na swoje czasy. Jednak czas go pożegnać. To Windows 11 został zbudowany z myślą o współczesnej erze. Przeszedł on gruntowny proces przeprojektowania, aby oferować bezpieczeństwo w modelu „od procesora do chmury” (chip-to-cloud). To poziom ochrony, którego wymaga dzisiejsze, niezwykle wymagające środowisko cyfrowe.

Dla nas jest to nieustanny proces edukowania naszych partnerów i resellerów. Chcemy, aby mogli oni przekazywać te nieco bardziej techniczne argumenty bezpośrednio do klientów końcowych. Z moich obserwacji wynika,

że za każdym razem, gdy mamy okazję przeprowadzić szkolenie lub szczegółowo wyjaśnić te różnice, klienci reagują w ten sam sposób: „muszę zrobić ten upgrade natychmiast”. Kiedy uświadamiają sobie, zwłaszcza w kontekście bezpieczeństwa, nie tylko płynące korzyści, ale i realne zagrożenia, na jakie się wystawiają, modernizacja staje się priorytetem. Naszym zadaniem jest więc jeszcze lepsza i szersza komunikacja, aby dotrzeć do każdego użytkownika na rynku.

Przejdźmy do AI – obecnie najważniejszego hasła w branży. Mamy nowe kategorie sprzętu, jak Copilot+ PC, wykorzystujące NPU. Jakie realne, codzienne korzyści przynoszą one użytkownikom biznesowym? Co zyska firma, inwestując w takie urządzenia, i jak partnerzy powinni rozmawiać o tym z decydentami, którzy często nie wiedzą jeszcze, jak przełożyć AI na konkretne rozwiązania potrzeb biznesowych?

Tematyka jednostek NPU (Neural Processing Unit) może wydawać się nieco zbyt techniczna dla części odbiorców czy klientów końcowych, ale to właśnie one są sercem nowej kategorii, którą stworzyliśmy. Copilot+ PC to nie tylko kolejna generacja komputerów; to zupełnie nowa kategoria urządzeń, które na niespotykanym dotąd poziomie pozwalają lokalnie uruchamiać małe modele językowe (SLM – Small Language Models) i korzystać z funkcji AI całkowicie offline.

Budując nową kategorię, musimy zadbać o synergię wielu elementów, aby osiągnąć maksymalne korzyści. W technologii kluczowe jest, aby deweloperzy tworzyli aplikacje z myślą o danej platformie – to oni odblokowują jej największą wartość. Jesteśmy obecnie w fazie przejściowej: deweloperzy zaczynają tworzyć soft, gdy widzą odpowiednio dużą bazę zainstalowanych urządzeń, a ta baza rośnie szybciej, gdy pojawia się więcej aplikacji. Nasze prognozy są jednak jasne: w ciągu najbliższych dwóch lat większość, bo ponad 80 proc. nowych urządzeń na rynku, będą stanowiły komputery klasy AI PC. To oznacza wykładniczy wzrost liczby scenariuszy użycia. W Microsoft skupiamy się na kilku priorytetach. Po

Doceniamy fakt, że klienci tak efektywnie wykorzystywali swoje zasoby i przez lata polegali na Windows 10. To był świetny system… na swoje czasy. Jednak czas go pożegnać.

Chris Papaphotis EMEA Head of Distribution, Commercial Devices & Solution Sales, Microsoft

pierwsze: jak sprawić, by po włączeniu komputera od razu był bardziej produktywny? Chcemy oszczędzać użytkownikom minuty, a nawet godziny pracy tygodniowo. Jednym z flagowych przykładów jest funkcja Recall. Pozwala ona odnaleźć to, nad czym pracowałeś, nie poprzez żmudne wpisywanie nazw plików, ale za pomocą naturalnych opisów. Zamiast szukać „prezentacji X”, możesz zapytać: „gdzie jest ten slajd z zieloną grafiką, o którym rozmawialiśmy z Krzysztofem, gdy w tle było widać śródziemnomorski port?”. To realna oszczędność czasu.

Oczywiście widzimy też ogromne wzmocnienie w konkretnych aplikacjach zewnętrznych, które już teraz potrafią wykorzystywać moc jednostek NPU. Copilot+ PC to obecnie szczytowe osiągnięcie designu – to najszybsze, najbezpieczniejsze i najbardziej zaawansowane urządzenia na rynku.

Jak na tę nową kategorię reaguje biznes? Czy AI to dla biznesu wciąż tylko modne hasło?

To zależy od wielkości firmy. Duże przedsiębiorstwa są znacznie dalej w swojej „podróży z AI”. One najpierw starają się zrozumieć technologię, testują ją wewnętrznie i dopiero wtedy wdrażają konkretne funkcjonalności. Te firmy szybko zrozumiały, gdzie model pracy offline ma dla nich największy sens. Z kolei dla mniejszych firm i konsumentów przygotowujemy gotowe funkcje działające „prosto z pudełka”. Dla nas kluczowe jest dostrzeżenie kierunku, w którym zmierza AI: przechodzimy od prostego czatu, przez konkretne aplikacje, aż do agentów i systemów wieloagentowych. Obecnie budujemy Windowsa tak, aby stał się „płótnem dla AI” (Canvas for AI), szczególnie dla biznesu. Dlaczego to ważne?

Ponieważ agenci AI potrzebują odpowiednich uprawnień dostępu do danych, aby móc skutecznie wykonywać swoje zadania. Do tego niezbędne jest solidne bezpieczeństwo i centralna administracja, co zapewnia właśnie Windows. Co ciekawe, widzimy wyraźną korelację: klienci, którzy już wcześniej ruszyli w drogę z AI poprzez Microsoft 365, są tymi samymi, którzy najchętniej kupują dziś komputery Copilot+ PC. Oni po prostu już wiedzą, jak tę moc realnie wykorzystać w biznesie.

To jasne, że AI może realnie wspierać codzienną pracę biurową. Jednak partnerzy często zadają pytanie: jak na tym budować realną wartość biznesową? Wielu z nich wciąż szuka drogi do zyskowności w tym nowym trendzie. Poza prostą odsprzedażą licencji, gdzie widzi Pan największą szansę dla kanału partnerskiego w ekosystemie AI? Krótko mówiąc – jak partnerzy mogą na tym zarabiać?

To fundamentalne pytanie. Prawda jest taka, że prawdziwa monetyzacja AI płynie z usług, a nie tylko z marży na sprzęcie czy samym oprogramowaniu. Aby partnerzy mogli odblokować potencjał AI u swoich klientów, muszą skupić się na gotowości danych (data readiness), bezpieczeństwie i zarządzaniu dostępem.

Z doświadczenia wiemy, że każdy projekt AI musi zacząć się od tego, co nazywamy „krokiem zero”. Chodzi o uporządkowanie uprawnień i struktury danych. Ostatnią rzeczą, jakiej życzyłby sobie szef firmy, jest sytuacja, w której pracownik pyta Copilota o zarobki prezesa, a system generuje mu kompletną tabelę płac zarządu. Bez precyzyjnego zarządzenia dostępem do danych (access rights), takie incydenty będą miały miejsce. Dlatego audyt środowiska da-

nych i wdrożenie odpowiednich zabezpieczeń to dla partnerów priorytetowa usługa o wysokiej marży.

Kolejnym obszarem jest przedefiniowanie procesów. Nie chodzi o to, by wziąć to, co robimy dzisiaj, i „posypać” to odrobiną AI. Partnerzy muszą pomóc klientom wymyślić ich workflow na nowo. Czasami dany proces okazuje się w ogóle niepotrzebny, bo AI pozwala osiągnąć docelowy rezultat zupełnie inną drogą. Partner musi więc stać się doradcą, który rozumie nie tylko technologię, ale przede wszystkim potrzeby biznesowe klienta.

Podam prosty, ale bardzo wymowny przykład z mojej codziennej pracy. Zarządzam dystrybucją w całym regionie EMEA. Muszę regularnie zbierać spostrzeżenia (insights) od naszych zespołów z Wielkiej Brytanii, Niemiec, Polski czy RPA. Kiedyś był to żmudny, manualny proces: menedżerowie musieli wszystko spisywać, wysyłać, a ktoś inny musiał to konsolidować. W trakcie tej „papierkowej roboty” gubiło się mnóstwo cennych detali.

Dziś po prostu włączamy nagrywanie spotkania. AI działa jak superprecyzyjny asystent: wykonuje transkrypcję, tworzy streszczenie i pozwala mi zadawać pytania bezpośrednio do treści rozmowy. Dzięki temu błyskawicznie wyłapujemy trendy w całym regionie. Oszczędzamy godziny pracy, a jakość informacji jest o niebo wyższa.

Naszą radą dla partnerów jest strategia „Klienta Zero”. Zachęcamy ich, by sami zaczęli używać AI we własnych strukturach. Tylko wtedy będą w stanie zrozumieć realne korzyści, ale i ograniczenia tej technologii. Wygrają ci, którzy przez najbliższe lata staną się dla swoich klientów niezbędnymi przewodnikami po świecie AI, dostarczającymi konkretną wartość doradczą i wdrożeniową.

Wdrożenie AI w ekosystemie klienta końcowego to ogromne wyzwanie. Wielu partnerów wciąż tkwi w starym modelu – sprzedaży „pudełek” z urządzeniami i oprogramowaniem. Wciąż widać pewną lukę w wiedzy i kompetencjach niezbędnych, by wytłumaczyć klientowi realną wartość AI. Jak w tym procesie zmienia się rola dystrybucji? Dzisiaj nie chodzi już tylko o logistykę,

ale o bycie pomostem kompetencyjnym między ekspertami Microsoftu a partnerami, którzy dopiero uczą się tej technologii.

Rola dystrybucji pozostaje absolutnie krytyczna w kontekście demokratyzacji sztucznej inteligencji. To właśnie dystrybutorzy są tymi, którzy umożliwiają nam skalowanie technologii – od największych przedsiębiorstw aż po najmniejsze firmy. Unikalną wartością, jaką dystrybutor wnosi do ekosystemu, jest orkiestracja tysięcy partnerów i ich stałe wspieranie (enablement).

Kiedy mówimy o największych klientach, mamy wielu integratorów systemowych, którzy konkurują o te projekty, dysponując ogromną wiedzą. Jednak gdy spojrzymy na tzw. „długi ogon” rynku (long tail), to właśnie dystrybutorzy stają się niezbędnym kręgosłupem dla mniejszych resellerów. Co ciekawe, na rynkach takich jak polski, ten „długi ogon” często generuje większy całkowity wolumen sprzedaży niż sektor

największych przedsiębiorstw. Dlatego tak ściśle współpracujemy z dystrybutorami nad programami szkoleniowymi i rozwojem gotowych rozwiązań. Jesteśmy zachwyceni współpracą z TD SYNNEX. Wspólnie dostarczamy partnerom konkretną, wymierną wartość: od architektur referencyjnych i ustrukturyzowanych szkoleń, po modele finansowania i spakietowane rozwiązania dla partnerów. Działamy wielotorowo – zarówno na poziomie lokalnym, w krajach takich jak Polska, Niemcy czy Wielka Brytania, jak i na poziomie całego regionu EMEA. Pozwala to na zachowanie spójności i dzielenie się najlepszymi praktykami pomiędzy rynkami. TD SYNNEX jest dla nas partnerem strategicznym, ponieważ oni również przeszli głęboką transformację. Dziś nie są już tylko pośrednikami w handlu sprzętem, ale rzeczywistym fundamentem dla dostarczania kompleksowych rozwiązań, które wspierają resellerów w całym kanale sprzedaży.

Często słyszy się, że projekty AI kończą się niepowodzeniem, nie z powodu ograniczeń technologicznych, lecz przez błędy na etapie planowania. Jak TD SYNNEX i Microsoft pełnią w tym procesie rolę architektów, dbając o to, by partnerzy nie ograniczali się jedynie do dostarczania „pudełek” czy oprogramowania, ale oferowali skuteczne, długofalowe rezultaty oparte na sztucznej inteligencji, które faktycznie rozwiązują realne problemy biznesowe ich klientów?

Jak wspomnieliśmy wcześniej, skuteczna adopcja sztucznej inteligencji wymaga solidnych fundamentów: gotowości danych, najwyższych standardów bezpieczeństwa oraz jasno zdefiniowanych procesów biznesowych. W tym kontekście kluczową rolę odgrywa inicjatywa TD SYNNEX o nazwie „Destination AI”. Jej celem jest pokazanie partnerom, jak zintegrować w jednym ekosystemie sprzęt, oprogramowanie i usługi, a wszystko to w oparciu o realne scenariusze biznesowe klientów.

Chcemy pomóc partnerom wyjść poza tradycyjny, czysto transakcyjny model sprzedaży. Naszym celem jest ewolucja partnera w stronę Zaufanego Doradcy AI (Trusted AI Advisor). Taki doradca nie tylko sprzedaje produkt, ale potrafi przeprowadzić klienta przez cały proces bezpiecznej, praktycznej i skalowalnej implementacji AI.

Widzimy już pierwsze owoce tego podejścia w różnych krajach – świetnym przykładem jest Francja, ale podobne procesy zachodzą już w Polsce. Łączymy tam świat rozwiązań chmurowych z urządzeniami końcowymi. Na rynku francuskim nasi partnerzy oferują już konkretne rozwiązania z Agentami AI – zarówno te prekonfigurowane, jak i rozwiązania szyte na miarę (bespoke).

Dzięki temu resellerzy otrzymują od nas i od dystrybutora gotową, spakietowaną wartość, którą mogą zaoferować swoim klientom wraz z niezbędnymi usługami wdrożeniowymi. To ogromna szansa zwłaszcza dla mniejszych resellerów, którzy dzięki takiemu wsparciu zyskują kompetencje dotychczas zarezerwowane dla największych graczy. Cała ta strategia jest w pełni spójna z misją TD SYNNEX: wspierania kanału sprzedaży tak, aby nasi partnerzy stali się najbardziej skutecznymi doradcami AI dla swoich klientów.

W ubiegłym roku AI było zdecydowanie najgorętszym hasłem w branży. Czy uważasz, że ten trend się utrzyma, czy może czeka nas przesyt?

Co będzie drogowskazem dla partnerów Microsoftu w nadchodzących latach?

Bez wątpienia AI z nami zostanie. Skala globalnych inwestycji nie idzie już w miliardy, ale w biliony dolarów. To ma swoje skutki uboczne, choćby w obszarze dostępności pamięci czy komponentów, co z kolei wpływa na ceny urządzeń. Jednak nie patrzymy tylko na rok 2026 – mówimy o całej dekadzie transformacji.

Wierzę, że w ciągu najbliższych dziesięciu lat dokonamy większego postępu technologicznego niż przez ostatnie sto lat. Za dekadę będziemy patrzeć wstecz i zastanawiać się: „Jak my w ogóle dawaliśmy sobie radę bez tego?”. AI będzie wbudowane w każdy smartfon, każdy komputer i każde urządzenie wokół nas. To nie jest kwestia jednego roku; to era, w której innowacja napędza kolejną innowację. Konkurencja na tym polu jest ogromna i to świetna wiadomość dla użytkowników końcowych, ponieważ otrzymają oni lepsze usługi w coraz bardziej przystępnych cenach.

To brzmi jak ogromna szansa dla kanału sprzedaży, ale też wyzwanie kompetencyjne.

To idealny moment, by wejść w ten biznes jako partner lub reseller. Kluczem jest jednak

Nasze prognozy są jednak jasne: w ciągu najbliższych dwóch lat większość, bo ponad 80 proc. nowych urządzeń na rynku, będą stanowiły komputery klasy AI PC.

Chris Papaphotis

EMEA Head of Distribution, Commercial Devices & Solution Sales, Microsoft

inwestycja w usługi i umiejętności. Popyt na ekspertów od AI jest obecnie tak wysoki, że znalezienie odpowiednich ludzi graniczy z cudem – każdy chce ich mieć u siebie. Dlatego tak mocno promujemy strategię „Klienta Zero”: najpierw sami wdrażamy i testujemy te rozwiązania u siebie, a potem uczymy tego klientów. Ci, którzy pierwsi zainwestują w kompetencje doradcze, odnotują wykładniczy wzrost. W tym obszarze „sky is the limit”. Możemy dziś realizować scenariusze biznesowe, które jeszcze niedawno były niewyobrażalne, i to przy bardzo optymalnych kosztach.

Na koniec wróćmy do systemów operacyjnych. W tym roku Windows 11 kończy pięć lat. Znając cykl życia systemów operacyjnych Microsoft, można przypuszczać, że kolejna wersja systemu jest już tuż za rogiem. Czy AI będzie głównym argumentem sprzedażowym wszystkiego, co nadejdzie po „jedenastce”?

Nie mogę wypowiadać się na temat przyszłych wersji, o których obecnie nie mamy oficjalnych informacji. Wiem natomiast jedno: Windows 11 będzie wspierany aż do 2031 roku. Obecnie to właśnie ten system jest naszym priorytetem i „płótnem dla AI” (Canvas for AI). Stale go aktualizujemy, aby był najbezpieczniejszą i najbardziej niezawodną platformą dla biznesu.

Niezależnie od tego, co przyniesie przyszłość, każda kolejna odsłona oprogramowania Microsoftu będzie nierozerwalnie związana z AI. Nasza strategia opiera się na dwóch filarach: innowacyjności i ogromnej skali. Obsługujemy obecnie 2 miliardy użytkowników – od najbardziej zaawansowanych startupów po firmy, które wciąż używają drukarek igłowych do drukowania faktur. Musimy dbać o ten potężny ekosystem, dlatego zawsze będziemy łączyć rozwój sztucznej inteligencji z zachowaniem wstecznej kompatybilności. Chcemy być absolutnie najlepszą platformą, która pozwala zarządzać, przewidywać i bezpiecznie wdrażać nowoczesne rozwiązania w każdym biznesie. Stabilnie, pewnie i bezpiecznie. n

DOŁĄCZ DO NASZYCH PRENUMERATORÓW

WYBORU

Wyślij zgłoszenie na adres: prenumerata@itreseller.pl

Prenumerata bezpłatna-kwalifikowana, wyłącznie dla osób i firm związanych z branżą IT

Bądź na bieżąco, wejdź na stronę: www.itreseller.pl

Dołącz do nas na YouTube

Dołącz do nas na LinkedIn

DESTINATION AI

JAK ZARABIAĆ

NA TRANSFORMACJI W CIENIU NIEDOBORÓW SPRZĘTOWYCH?

Wiemy, że warto. Nie zawsze wiemy jak. Wdrożenia AI w przedsiębiorstwach potrzebują drogowskazu i przewodnika. O symbiozie chmury ze sztuczną inteligencją, końcu ery „doktrynalnych wojen” między dostawcami technologii, nadchodzącym kryzysie na rynku pamięci oraz o tym, jak program Destination AI pomaga partnerom przejść od sprzedaży pudełek do wysokomarżowych usług – rozmawiamy z ekspertami TD SYNNEX: Jackiem Kotynią, Business Unit Manager Cloud oraz Rafałem Ciemięgą, Business Development Manager, Data Analytics, AI & IoT.

Zacznijmy od fundamentów. Sztuczna inteligencja zdominowała dyskusje biznesowe, ale czy w dzisiejszych realiach możemy w ogóle mówić o skutecznym wdrożeniu AI bez chmury?

Jacek Kotynia, TD SYNNEX: Odpowiedź brzmi: nie. I składa się na to kilka czynników, w tym, o czym więcej powiem później, wyzwania związane z dostępnością sprzętu. Chmura stała się niezbędna przede wszystkim ze względu na niski próg wejścia. To, co obserwujemy, to tzw. „demokratyzacja chmury“ – koszt dostępu do potężnej mocy obliczeniowej spadł na tyle, że stał się osiągalny nie tylko dla gigantów, ale i dla mniejszych firm.

Jako TD SYNNEX mamy unikalną pozycję na polskim rynku, oferując rozwiązania wszystkich trzech największych hyperskalerów: Microsoft, Google i AWS. Dzięki temu nasi partnerzy nie muszą ograniczać się do jednego ekosystemu – mogą dobierać najmocniejsze strony każdego z tych dostawców pod konkretny projekt. Staramy się łączyć świat on-premise, czyli tradycyjnego hardware‘u, z chmurą poprzez nasz autorski program Destination AI. Uzupełniamy luki kompetencyjne, uczymy planowania i łączymy te dwa światy, wspierając to naszą platformą StreamOne Ion, która pozwala zarządzać subskrypcjami i usługami różnych dostawców w jednym miejscu. A to otwiera drogę do budowania kreatywnych scenariuszy biznesowych, w oparciu o AI.

Wspomniałeś o łączeniu światów. Polska jest specyficznym rynkiem – wiele firm i instytucji wciąż woli trzymać dane „u siebie”, a nie w chmurze publicznej.

Rafał Ciemięga, TD SYNNEX: To prawda, polski rynek, podobnie jak inne rynki europejskie, ma swoją specyfikę, zwłaszcza w sektorze publicznym czy regulowanym, gdzie wymogi bezpieczeństwa danych są bardzo restrykcyjne. Często spotykamy się z wyzwaniami, gdzie pełna chmura nie wchodzi w grę. Dlatego kluczem jest zawsze analiza konkretnego przypadku. Czasami wystarczy proste, tanie wdrożenie w chmurze, ale w innych przypadkach, gdy w grę wchodzą dane wrażliwe, rozwiązanie musi być lokalne.

Najczęściej jednak sprawdza się model hybrydowy. To podejście, które łączy stare, dobre środowisko on-premise z możliwościami chmury. Możemy mieć bazę u siebie, ale w momentach szczytowego obciążenia „dopakować“ mocy obliczeniowej, wynajmując zasoby z AWS,

Microsoftu czy Google Cloud. To daje elastyczność – jeśli brakuje nam sprzętu lub nie chcemy inwestować w potężne serwery na start, chmura jest idealnym buforem.

Jacek Kotynia: Warto dodać, że dostępność sprzętu, a konkretnie pamięci RAM, staje się tu powoli wąskim gardłem. Fabryki przestawiają linie produkcyjne na pamięci HBM pod układy GPU służące do trenowania modeli AI, co ogranicza podaż standardowych kości RAM. W takiej sytuacji chmura wygrywa dostępnością – tam zasoby są dostępne niemal od ręki, co pozwala ominąć problemy z fizycznymi dostawami.

Obserwujemy też ciekawą zmianę w podejściu samych gigantów technologicznych. Kiedyś ekosystemy były zamknięte, dziś widzimy coraz większą otwartość.

Jacek Kotynia: Jeszcze 6-10 lat temu bycie „microsoftowym” czy „googlowym” przypominało wyznawanie religii – jeśli byłeś w jednym obozie, reszta była „zła”.

Chmurowa plemienność? To dało się rzeczywiście zauważyć, za każdym razem gdy rozmawiałem z osobami pracującymi z daną chmurą. Czy dziś jest inaczej?

Jacek Kotynia: Tak, ta sytuacja zmieniła się diametralnie. Moim zdaniem przełomem było udostępnienie przez Metę (Facebooka) modelu LLaMA jako open source. To wymusiło na hyperskalerach otwarcie się na współpracę.

Dziś każdy z wielkich graczy oferuje wtyczki i integracje z konkurencją. Dla nas, jako dystrybutora, to ogromna szansa. Nie podchodzimy już do projektu sprawdzając, co dany producent ma w cenniku. Sprawdzamy, co klient chce osiągnąć i uprawiamy swoisty „technological cherry-picking“. Dobieramy komponenty od różnych dostawców tak, aby obniżyć koszty (nawet o 20 proc.) i zwiększyć niezależność klienta.

Rafał Ciemięga: Jest w tej zmianie także inspiracja sprzętowa. Nvidia również odegrała tu dużą rolę, pokazując, że można współpracować ze wszystkimi. My działamy jako doradca – nie patrzymy na logo, ale na to, czy rozwiązanie spełni wymagania klienta.

Przejdźmy do praktyki. Wiele firm mówi o AI, ale w rzeczywistości często kończy się na hasłach. Jak pomagacie partnerom, którzy mają klienta chętnego na wdrożenie AI, ale nie wiedzą, jak się za to zabrać?

To, co obserwujemy, to tzw. „demokratyzacja chmury“ – koszt dostępu do potężnej mocy obliczeniowej spadł na tyle, że stał się osiągalny nie tylko dla gigantów, ale i dla mniejszych firm.

Jacek Kotynia TD SYNNEX

Jacek Kotynia: Zacznijmy od tego, że w firmach AI jest już obecne, nawet jeśli zarząd o tym nie wie. Pracownicy sami korzystają z narzędzi typu ChatGPT czy Gemini, co rodzi ryzyko wycieku danych – jak w głośnym przypadku Samsunga. Nasz program Destination AI służy właśnie temu, by ucywilizować ten proces.

Oferujemy kompleksowy framework: od analizy stanu obecnego (assessment), przez weryfika-

cję celów biznesowych, aż po wdrożenie. Mamy w Europie Center of Excellence, gdzie zatrudniamy ekspertów ze specjalizacjami w każdej z chmur oraz w dziedzinach takich jak security czy Data & AI.

Rafał Ciemięga: Do tego dochodzi potężne zaplecze sprzętowe. Mamy infrastrukturę demo, na której można postawić niemal każdego „AI-a”. Dysponujemy kartami L40, H200, a nawet potężnym serwerem Nvidia DGX B300 z ośmioma kartami GPU – to unikalna maszyna w tej części Europy.

Możemy udostępnić partnerowi kompletne środowisko: serwery, macierze, oprogramowanie, aby przeprowadził Proof of Concept (PoC) u klienta. To nasz ogromny wyróżnik – nie tylko slajdy, ale realny sprzęt i oprogramowanie do testów. Można z nami pracować nad tym, by wybrać najlepsze rozwiązanie.

Z chmur zejdźmy na ziemię. Kluczowe pytanie dla każdego partnera brzmi: „Gdzie jest w tym marża dla mnie?“. Skoro chmura to subskrypcja, a AI kojarzy się z drogimi inwestycjami, jak na tym zarobić?

Rafał Ciemięga: AI wcale nie musi być drogim projektem. Można zacząć od małych kroków –chatbotów wewnętrznych, analizy dokumentów czy prostych procesów RPA. Nie zawsze potrzebujemy setek GPU, czasem wystarczy wynajęcie mocy w chmurze na godziny.

Pieniądze dla partnera leżą w usługach: wdrożeniu, a przede wszystkim w utrzymaniu. Partnerzy zarabiają na swojej wiedzy eksperckiej.

Jacek Kotynia: Następuje zmiana modelu biznesowego – z jednorazowej transakcji na długofalową współpracę. My jako TD SYNNEX wspieramy to, oferując np. usługi „White Label“. Możemy

Działamy jako doradca – nie patrzymy na logo, ale na to, czy rozwiązanie spełni wymagania klienta.

dostarczyć całą platformę i obsługę techniczną (pierwszą, drugą linię wsparcia, security), która dla klienta końcowego wygląda jak usługa partnera.

Dodatkowo dzielimy się naszymi globalnymi kontraktami. Dzięki temu mniejszy partner może zaoferować klientowi wsparcie na poziomie enterprise (np. Microsoft Premier Support), na które samodzielnie nie byłoby go stać. Inwestujemy też w marketing i wspólne aktywności z partnerami.

Mimo entuzjazmu, badania PwC wskazują, że 56 proc. inicjatyw AI nie przynosi oczekiwanych korzyści. Skąd tak wysoki odsetek porażek?

Jacek Kotynia: Głównym powodem jest brak jasnego celu biznesowego oraz niska jakość danych. Firmy często wdrażają AI, bo jest „hype“, a nie dlatego, że mają przemyślany proces. Obowiązuje tu zasada „garbage in, garbage out“ – jeśli zasilimy model słabymi danymi, otrzymamy słabe wyniki. Dlatego w Destination AI kładziemy nacisk na edukację i precyzyjne określenie, co klient chce osiągnąć, zanim wydamy pierwszą złotówkę na technologię.

To pytanie musi paść, bo coraz częściej pojawia się w rozmowach o AI warstwa dotycząca inwestycji i giełdy. Czy mamy do czynienia z bańką AI?

Rafał Ciemięga: Nie nazwałbym tego bańką. Owszem, wiele startupów upada lub jest wchłanianych, ale to naturalny proces rynkowy. Kluczowi gracze inwestują w to gigantyczne środki. Spójrzmy na Visę czy Mastercard – ilość firm AI, które przejęli w ostatnim roku, pokazuje, że

sektor finansowy widzi w tym realną wartość, a nie tylko modę.

Na koniec, spójrzmy w przyszłość na rok 2026. Jakie są Wasze prognozy dotyczące dostępności sprzętu i cen?

Jacek Kotynia: Rynek pamięci przechodzi strategiczną zmianę. Producenci przestawiają się na produkcję pamięci dla rozwiązań AI, co drenuje rynek konsumencki. Należy spodziewać się trudności w dostępie i wzrostu cen.

Rafał Ciemięga: To upodobnić może rynek do tego z czasów pandemii – terminy dostaw się wydłużą, a ceny będą mniej przewidywalne. Nasza rada dla partnerów: nie czekajcie na promocje czy „Black Friday“. Planujcie zakupy z dużym wyprzedzeniem.

Jacek Kotynia: Warto też budować strategię w oparciu o to, co mamy. Zamiast czekać miesiącami na nowy sprzęt, można rozbudować obecną infrastrukturę lub wykorzystać chmurę jako bufor, który pozwoli zachować ciągłość biznesową w oczekiwaniu na dostawy hardware‘u. To czas na sprytne, hybrydowe podejście do IT. n

OD EKSPERYMENTÓW DO STRATEGII

JAK LIDERZY WDRAŻAJĄ AI W ORGANIZACJACH

W najnowszym AI Radar Trendbook jeden z rozdziałów poświęcony jest tematowi „Przywództwo w erze AI”. Pokazuje on jasno: skuteczne wdrożenie sztucznej inteligencji zaczyna się nie od wyboru modelu czy narzędzia, lecz od decyzji strategicznych liderów — gdzie sztuczna inteligencja ma realnie tworzyć wartość, które procesy zmieni i jak przygotować organizację na nowy sposób pracy.

Nasza publikacja AI Radar

Trendbook spotkała się z dużym zainteresowaniem wśród CEO, członków zarządów oraz liderów transformacji. Zebrane przykłady z wielu branż jasno pokazują, że sztuczna inteligencja nie jest już koncepcją przyszłości — jest obecna tu i teraz i realnie zmienia sposób funkcjonowania biznesu. Dziś osoby decyzyjne nie pytają już, czy wdrażać AI, lecz jak zacząć. W artykule przedstawiam praktyczną ścieżkę wdrożenia AI w organizacji: od budowy business case i identyfikacji pierwszych zastosowań, przez wybór architektury technologicznej, aż po stworzenie kultury organizacyjnej, która pozwala ludziom i algorytmom skutecznie współpracować.

Jak przekonać zarząd do inwestycji w AI

Wdrożenie sztucznej inteligencji w organizacji powinno zaczynać się nie od technologii, lecz od jasno zdefiniowanego uzasadnienia biznesowego. Kluczowym krokiem jest identyfikacja realnych

problemów operacyjnych – wąskich gardeł w procesach, które mogą zostać rozwiązane dzięki AI. Może to być np. automatyzacja analizy danych, przyspieszenie obsługi klienta czy wsparcie decyzji strategicznych. Na tej podstawie organizacje budują business case, pokazując potencjalne korzyści w postaci skalowania działalności bez liniowego wzrostu kosztów zatrudnienia.

Równolegle konieczne jest uwzględnienie aspektów regulacyjnych i etycznych, m.in. poprzez wstępną klasyfikację systemu zgodnie z wymogami EU AI Act oraz analizę ryzyka związanego z potencjalną stronniczością algorytmów. W praktyce oznacza to m.in. weryfikację, czy modele nie powielają historycznych błędów w danych – na przykład w procesach rekrutacyjnych lub oceny kredytowej. Dopiero po połączeniu perspektywy biznesowej, technologicznej i regulacyjnej organizacja może określić długofalowe cele strategiczne wdrożenia AI oraz uzyskać zgodę zarządu opartą na twardych danych i realistycznych prognozach wartości dla firmy.

Firmy przyszłości nie będą konkurować wyłącznie produktami, lecz architekturą swoich systemów decyzyjnych.

Gdzie AI przyniesie najszybszą wartość dla organizacji

Skuteczne wdrożenie AI w organizacji zaczyna się od rzetelnej diagnozy zasobów i identyfikacji obszarów, w których technologia może przynieść szybkie i mierzalne rezultaty – tzw. nisko wiszące owoce. Pierwszym krokiem jest audyt gotowości cyfrowej, obejmujący ocenę infrastruktury technologicznej, dostępnych narzędzi oraz poziomu integracji systemów w organizacji. Równolegle konieczna jest weryfikacja jakości danych: czy są one uporządkowane, kompletne i odpowiednio przygotowane do trenowania modeli AI.

Coraz częściej firmy odkrywają także zjawisko Shadow AI, czyli nieformalnego korzystania z narzędzi AI przez pracowników, które warto zidentyfikować i objąć odpowiednimi zasadami zarządzania. Kolejnym elementem diagnozy jest analiza potencjalnych projektów

pod kątem relacji ROI do bezpieczeństwa, tak aby wybierać inicjatywy o wysokiej wartości biznesowej, a jednocześnie niskim ryzyku.

Istotną rolę odgrywa również dokumentowanie pochodzenia danych poprzez praktyki Data Lineage (pochodzenie danych), co pozwala uniknąć problemów związanych z prawami autorskimi i zgodnością regulacyjną. Całość powinna być domknięta mapą procesów wskazującą konkretne miejsca, w których AI może wspierać codzienną pracę zespołów.

Największym błędem wdrożeń AI jest zaczynanie od narzędzi zamiast od problemów biznesowych.

Od pilotażu do skalowania: architektura AI w organizacji

Po zdefiniowaniu celów biznesowych i przeprowadzeniu diagnozy organizacyjnej kolejnym krokiem jest zaprojektowanie architektury technologicznej wdrożenia AI. Na tym etapie organizacje decydują o ścieżce implementacji – czy rozpocząć od szybkich testów w modelu proof-first, pozwalających zweryfikować potencjał rozwiązania, czy rozwijać system w podejściu lean AI, opartym na wykorzystaniu istniejących komponentów i gotowych narzędzi.

Kluczowym dylematem jest również wybór między platformami typu SaaS a integracją modeli poprzez API, co wpływa na poziom kontroli nad rozwiązaniem i koszty jego utrzymania. Równolegle organizacje powinny przygotować strategię wyjścia (exit strategy), minimalizującą ryzyko uzależnienia od jednego dostawcy technologii. Coraz większe znaczenie ma także kwestia lokalizacji i bezpieczeństwa danych, szczególnie w kontekście rozwiązań takich jak Sovereign Cloud, umożliwiających przechowywanie wrażliwych informacji w określonych jurysdykcjach. Istotnym elementem architektury jest również dobór partnerów technologicznych oraz przygotowanie infrastruktury na przyszłe skalowanie systemów AI – tak, aby były one zdolne obsłużyć rosnącą liczbę zapytań i procesów biznesowych wraz z rozwojem organizacji. Firmy, które wygrywają w erze AI, nie eksperymentują więcej – eksperymentują mądrzej.

Jak zarządzać kosztami i jakością systemów AI

Gdy architektura technologiczna jest już określona, kluczowym wyzwaniem staje się operacjonalizacja wdrożenia AI – czyli zarządzanie kosztami, jakością oraz ryzykiem związanym z codziennym wykorzystaniem modeli. Coraz

więcej organizacji wprowadza praktyki FinOps dostosowane do środowisk AI, umożliwiające monitorowanie w czasie rzeczywistym zużycia tokenów, mocy obliczeniowej GPU oraz kosztów zapytań do modeli. Równolegle firmy redefiniują wskaźniki sukcesu: obok oszczędności czasu coraz większe znaczenie mają jakość, trafność i stabilność odpowiedzi generowanych przez systemy AI. Kluczowym narzędziem zarządzania staje się także techniczna roadmapa, określająca kolejne etapy wdrożenia wraz z mierzalnymi kamieniami milowymi. W praktyce operacyjnej konieczne jest również monitorowanie zjawiska model drift, czyli stopniowego spadku jakości działania modelu w czasie, co wymaga systemów wczesnego ostrzegania i regularnej walidacji wyników. Dodatkowym elementem nadzoru jest zarządzanie ryzykiem dostawców w ramach praktyk Third-Party Risk Management oraz prowadzenie centralnego rejestru wszystkich rozwiązań AI działających w organizacji –tzw. AI inventory. Takie podejście pozwala firmom nie tylko kontrolować koszty i ryzyko, ale także budować przejrzysty system zarządzania technologią, która staje się coraz bardziej krytyczna dla działalności biznesowej.

Dlaczego transformacja AI zaczyna się od ludzi

Technologia sama w sobie nie tworzy przewagi konkurencyjnej — kluczowe jest połączenie rozwiązań AI z odpowiednią strukturą organizacyjną, kompetencjami i kulturą pracy. W wielu firmach pierwszym krokiem jest powołanie tzw. AI Championa, czyli lidera odpowiedzialnego za łączenie perspektywy biznesowej z technologiczną oraz koordynowanie inicjatyw związanych z AI. Równolegle pojawiają się nowe role operacyjne, takie jak inżynierowie zajmujący się utrzymaniem modeli w ramach praktyk MLOps czy LLMOps, które zapewniają stabilność i rozwój systemów po ich wdrożeniu. Kluczowym elementem transformacji jest również rozwój kompetencji pracowników poprzez programy AI Literacy, koncentrujące się nie tylko na umiejętności korzystania z narzędzi, lecz także na rozumieniu ich ograniczeń i interpretowaniu wyników. W wielu procesach biznesowych utrzymuje się także mechanizm Human-in-the-loop, gwarantujący, że ostateczne decyzje w krytycznych obszarach należą do człowieka. Organizacje wprowadzają również standardy transparentności, informując klientów o wykorzystaniu AI w usługach i komunikacji. Transformacja ta wymaga jednak także zmiany kultury pracy — systemy motywacyjne coraz częściej nagradzają innowacyjność

Krystyna Jarek Ekspertka Innowacji AI, założycielka Booster of Innovation

i efektywność, a liderzy świadomie zarządzają emocjonalnym aspektem zmiany, pomagając pracownikom przejść od obawy przed automatyzacją do aktywnego współtworzenia nowego modelu pracy.

Organizacje przyszłości będą budowane nie wokół technologii, lecz wokół ludzi, którzy potrafią z nią współpracować.

Od pilotaży do transformacji organizacji

Wdrożenie sztucznej inteligencji nie jest jednorazowym projektem technologicznym, lecz procesem transformacji organizacji — obejmującym strategię, architekturę systemów, kompetencje pracowników oraz sposób podejmowania

decyzji. Coraz wyraźniej widać, że w erze AI przewagę zdobywają nie te firmy, które najszybciej testują nowe narzędzia, lecz te, które potrafią systemowo włączyć AI w sposób działania całej organizacji.

To właśnie dlatego rośnie znaczenie liderów zdolnych łączyć technologię z biznesem, zarządzać ryzykiem regulacyjnym oraz budować kulturę współpracy między ludźmi a algorytmami.

Jeśli chcesz głębiej zrozumieć, jak zmienia się przywództwo i transformacja organizacji w świecie sztucznej inteligencji, warto sięgnąć po raport AI Radar Trendbook. Publikacja prezentuje kluczowe trendy technologiczne, scenariusze rozwoju AI oraz praktyczne wskazówki dla liderów i organizacji przygotowujących się na kolejną fazę rewolucji technologicznej. n

SERCE EKOSYSTEMU PROFESJONALISTY

CZY MOŻNA SOBIE POZWOLIĆ NA BRAK CIĄGŁOŚCI?

W świecie nowoczesnych technologii granica między „komputerem domowym” a „stacją roboczą” często wydaje się zacierać. Jednak dla architekta, montażysty wideo, inżyniera czy analityka danych, ta różnica jest krytyczna. Stacja robocza to nie po prostu mocniejszy PC – to precyzyjne narzędzie pracy, zaprojektowane do obsługi najbardziej wymagających procesów obliczeniowych przy zachowaniu maksymalnej stabilności.

Gdy Twoim źródłem utrzymania jest renderowanie skomplikowanych scen 3D, projektowanie konstrukcji mostów czy obróbka materiału 8K, wydajność przestaje być luksusem. Staje się walutą. Każda sekunda opóźnienia w reakcji interfejsu i każda minuta oczekiwania na zakończenie procesu to realna strata finansowa. W końcu czas to pieniądz, prawda?

Ciągłość pracy, a technologiczny wyścig zbrojeń

Kluczowym aspektem posiadania profesjonalnej stacji roboczej jest zasada „be up-to-date”. W branżach kreatywnych i technicznych polegamy na specyficznym, często bardzo kosztownym oprogramowaniu (takim jak pakiet Adobe, Autodesk, SolidWorks itd.). Producenci tych narzędzi nieustannie aktualizują swój kod, by wycisnąć maksimum z najnowszych architektur procesorów i kart graficznych. Tu pojawia się największe ryzyko dla profesjonalisty: brak aktualności. – Profesjonalna stacja robocza nie jest jedynie wydajnym komputerem, to przede wszystkim stabilne i przewidywalne narzędzie pracy. W środowisku projektowym czy inżynierskim liczy się pewność, że sprzęt będzie w stanie obsłużyć kolejne generacje oprogramowania, coraz większe pliki i bardziej złożone procesy obliczeniowe. Dlatego stacja robocza powinna oferować nie tylko wysoką wydajność tu i teraz, ale również odpowiedni zapas mocy obliczeniowej, certyfikowane komponenty oraz stabilność platformy, które gwarantują ciągłość pracy w dłuższej perspektywie – potwierdza Jarosław Banaś, Senior Business Unit Manager PC Systems w AB S.A. Scenariusz, w którym z dnia na dzień tracisz możliwość otwarcia plików od klienta, bo Twoja wersja oprogramowania nie jest już wspierana, to koszmar każdego freelancera i studia projektowego. Stacja robocza musi być zatem jednostką, która nie tylko „daje radę dzisiaj”, ale jest przygotowana na standardy jutra. Tak pod względem sprzętowym, jak i software’owym. – Dziś stacja robocza nie jest już tylko szybkim procesorem i mocną kartą graficzną – to cały, precyzyjnie zestrojony ekosystem. Klient pracując na Dell Pro Precision 5 czy 7, dostaje maszynę projektowaną od początku pod konkretne środowiska: od sterowników i firmware’u, przez Windows 11,

Komputery Copilot+ PC realnie poprawiają komfort codziennej pracy i komunikacji. […] Dynamicznie rośnie liczba aplikacji tworzonych przez ISV, których funkcjonalności oparte na AI będą wymagały wydajności rzędu 40 TOPS w NPU, co czyni Copilot+ PC rozwiązaniem bardziej przyszłościowym.

Arkadiusz Kwiatkowski Senior Partner Development Manager, Microsoft

aż po certyfikacje ISV dla pakietów pokroju Adobe, Autodesk czy SolidWorks. W praktyce oznacza to mniej niespodzianek po aktualizacjach, przewidywalną wydajność i pewność, że nowe wersje oprogramowania faktycznie wykorzystają możliwości sprzętu, zamiast je blokować – wyjaśnia Central Eastern Europe Workstations Lead w Dell Technologies, Konrad Pleban.

Traktowanie stacji roboczej jako stałej inwestycji, a nie jednorazowego wydatku na lata, to jedyny sposób na zachowanie płynności zawodowej. Bycie „up-to-date” to swoista polisa ubezpieczeniowa. Dzięki niej mamy pewność, że gdy rano siadamy do pracy, jedynym ograniczeniem będzie wyobraźnia, a nie komunikat o braku kompatybilności systemu.

Pożegnanie z honorami

Windows 10 służył zarówno użytkownikom domowym, jak i biznesowym i profesjonalnym przez lata. W chwili premiery był nowoczesny, stylowy i szybko zyskujący przychylność użytkowników. Problem w tym, że miało to miejsce w połowie 2015 roku. Tak, Windows 10 wkrótce osiągnie wiek 11 lat. Jego następca, Windows 11, miał swoją premierę w październiku 2021 roku. Czasu na aktualizację było więc naprawdę dużo.

Kończąc wsparcie dla Windows 10, Microsoft nie wyłącza działania tego systemu. Komputer z Windows 10 nadal się uruchomi, nadal pozwoli na uruchamianie programów… chociaż to będzie się zmieniać, czy właściwie zmienia się już teraz.

Nadchodzące mobilne stacje robocze

Dell Technologies z linii Dell Pro Precision to rzeczywiście tzw. wysoka półka. Producent zapewnił przy tym szeroki wybór (…) Wybór właściwej konfiguracji jest szczególnie istotny w przypadku stacji roboczych, gdyż nie są to komputery ogólnego zastosowania, a maszyny do „zadań specjalnych”

Konrad Pleban

Central Eastern Europe Workstations Lead Dell Technologies

O ile użytkownik domowy, jeśli zostanie zaskoczony tym, że po aktualizacji jego ulubiony program nie działa na starym systemie operacyjnym, może pozwolić sobie na przestój, tak w przypadku profesjonalisty, dla którego komputer to narzędzie pracy, jest wyraźnie inaczej.

– Oczywiście, brak wsparcia dla systemu Windows 10 nie oznacza, że stacje robocze oparte na tym systemie nagle przestaną działać. Kluczowe z perspektywy użytkowników i organizacji są jednak bezpieczeństwo oraz ciągłość pracy –wyjaśnia Arkadiusz Kwiatkowski, Senior Partner Development Manager w Microsoft.

Bezpieczeństwo jest, jak nietrudno zauważyć, jednym z najważniejszych obszarów współczesnych działów IT. Biorąc pod uwagę skalę ataków, wyzwania niesione tak przez pospolitych cyberprzestępców, jak i geopolitykę, dane firmy, często jej najważniejszy zasób, muszą być szczególnie dobrze chronione.

„Windows 11 został zaprojektowany w oparciu o zasady Zero Trust i standardowo wykorzystuje takie mechanizmy jak TPM 2.0, Secure Boot oraz Virtualization-Based Security. W praktyce przekłada się to na realne efekty — klienci korzystający z Windows 11 Pro odnotowują 58 proc. spadek liczby incydentów bezpieczeństwa w porównaniu do środowisk opartych na Windows 10” – wyjaśnia Arkadiusz Kwiatkowski, Microsoft, wskazując na inną, poważną zaletę aktualnego systemu – „Co istotne, największą przewagą tej migracji w porównaniu do wcześniejszych zmian wersji systemu jest bardzo wysoka kompatybilność aplikacji, która w tym przypadku sięga 99,7 proc., co znacząco ogranicza ryzyko operacyjne i wpływ na bieżącą pracę użytkowników” Na rynku nie brakuje interesujących pozycji w segmencie stacji roboczych. Szybkie zmiany w ostatnim czasie przyniosło pojawienie się pro-

cesorów z wbudowanym NPU, warto więc pomyśleć o uwolnieniu potencjału AI, także poprzez dostosowanie warstwy sprzętowej – wyposażenie się w nowoczesną stację roboczą. Zwłaszcza, że jesteśmy dziś w przededniu premiery nowej, imponującej linii od Dell Technologies. – Stacja robocza to konsekwentnie, od dekad, kategoria będąca ukoronowaniem inżynieryjnych możliwości swoich czasów, i nie inaczej jest obecnie. Już pod koniec marca pojawią się nasze nowe mobilne stacje robocze Dell Pro Precision 7 w rozmiarach 14” oraz 16” – podkreśla Konrad Pleban, Dell Technologies. – To linia komputerów, która przeszła długą drogę, w ostatnim czasie także modyfikację nazewnictwa, ale jedno pozostaje niezmienne – to najlepsze narzędzie w rękach mobilnego profesjonalisty. Nadchodzące mobilne stacje robocze Dell Technologies z linii Dell Pro Precision to rzeczywiście tzw. wysoka półka. Producent zapewnił przy tym szeroki wybór; od formatu (14 lub 16 cali) przez zróżnicowane CPU i GPU, na konfiguracjach pamięci skończywszy. Wybór właściwej konfiguracji jest szczególnie istotny w przypadku stacji roboczych, gdyż nie są to komputery ogólnego zastosowania, a maszyny do „zadań specjalnych”. – Dobranie właściwej stacji roboczej nie jest wcale zadaniem prostym – potwierdza Jarosław Banaś, AB S.A. – Komputer należy dopasować do stojących przed nim zadań, a w przypadku stacji roboczych, stacjonarnych, jak i mobilnych, są to zadania z kategorii szczególnych – czy to pod względem mocy obliczeniowej, długotrwałego obciążenia czy np. wymagań dotyczących ekranu. W AB dysponujemy szerokim wyborem stacji roboczych, a przy tym zespołem, który zna te komputery doskonale i stanowi skarbnicę wiedzy. Dzięki temu możemy zaoferować doradztwo na najwyższym poziomie w wybraniu właściwych stacji roboczych dla klientów o zróżnicowanych oczekiwaniach. Co więcej, oferujemy też szeroki wybór oprogramowania specjalistycznego. Stacje robocze, z racji korzystania na nich ze wspomnianego wyżej, bardzo specyficznego oprogramowania, często aktualizowanego, zyskującego nowe, lepsze funkcje z każdą kolejną wersją, po prostu powinny być up-to-date. W przypadku stacji roboczych kwestia przejścia na aktualny system operacyjny jest nawet łatwiejsza niż w wielu domowych PC. Dlaczego? Otóż te zaawansowane maszyny od lat są budowane także z myślą od podwyższonym poziomie bezpieczeństwa, dlatego nawet te liczące sobie już kilka lat zwykle zawierają moduł TPM, wymagany przez Windows 11. Zatem, jeśli dysponujemy kilkuletnią, ale wciąż mocną stacją roboczą, możemy pozwolić sobie na aktualizację systemu, bez wymiany sprzętu,

jeśli jego wydajność nadal zaspokaja nasze potrzeby. Jest tylko jedno “ale”..

System z plusem