Formulare. Testare. Decidere.

Digitalizzazione e intelligenza artificiale per accelerare l’innovazione nell’industria delle vernici e dei rivestimenti

Whitepaper

Dalla formulazione al pensiero sistemico

Perché l’innovazione richiede strutture nuove

Forti pressioni per l’innovazione, normative sempre più rigorose e obiettivi di sostenibilità ambiziosi: le richieste rivolte ai produttori di vernici e rivestimenti sono in costante aumento. La quotidianità della ricerca e dello sviluppo è però spesso caratterizzata da una situazione ben diversa: mancanza di tempo, silos di dati, test ridondanti. Non appena una formulazione viene ottimizzata, viene immediatamente resa obsoleta da nuovi substrati, limiti VOC modificati ed esigenze differenti espresse dai clienti nei settori dell’edilizia, dell’automotive e dell’arredamento. A ciò si aggiunge una pressione regolatoria notevole, ad esempio nei divieti relativi a PFAS e microplastiche. Per tenere il passo non servono soltanto know-how e competenze, ma anche, e soprattutto, strutture che permettano di utilizzare le proprie conoscenze in modo sistematico.

Sono già disponibili grandi quantità di dati necessari allo sviluppo di formulazioni: sperimentazioni, prove e test generano

Il potenziale nascosto dei dati

ogni giorno informazioni preziose che, però, finiscono sepolte in una serie di file Excel e report oppure semplicemente vanno perse nella routine quotidiana. Ma ciò che non è reperibile, chiaramente, non può essere utilizzato in ulteriori progetti. Le conseguenze di questo sono esperimenti ridondanti, processi di sviluppo lenti e un patrimonio di conoscenze che, purtroppo, resta inutilizzato. La soluzione a questi problemi risiede dunque nella raccolta intelligente e nell’impiego efficace dei dati già disponibili e di quelli generati ex novo. Integrare digitalmente formulazioni, valori di prova e dati di laboratorio e analizzarli con l’intelligenza artificiale significa promuovere l’innovazione in modo più mirato, affidabile e tracciabile.

Questo white paper mostra come le infrastrutture digitali e l’IA possono aiutare l’industria delle vernici e dei rivestimenti a portare lo sviluppo di nuovi prodotti a un livello superiore: più efficiente, conforme alle normative e con un time-to-market ridotto.

Flusso di dati

Lo sviluppo di materiali, dispendioso in termini di tempo e risorse, deve far fronte a requisiti sempre più elevati dei clienti e all’esigenza di ridurre il time-to-market. Opportunità

Colli di bottiglia nella R&S

Lo sviluppo di formulazioni genera enormi quantità di dati che spesso restano inutilizzati perché non vengono acquisiti e archiviati correttamente.

Preziose correlazioni restano nascoste per la mancanza di un’analisi dei dati intelligente e automatizzata.

Perché gli strumenti tradizionali hanno raggiunto il loro limite

E come una piattaforma può aiutare

Sebbene molti laboratori utilizzino già soluzioni di automazione individuali per importare dati di misura, generare report o controllare dispositivi, spesso manca un’infrastruttura sovraordinata che colleghi i processi, aggreghi i dati in modo coerente e li renda fruibili in modo sistematico. Esistono diverse soluzioni software, dai classici LIMS agli ELN fino ai sistemi cloud, ma la pratica quotidiana mette rapidamente in luce tutti i loro limiti.

Originariamente progettati per i laboratori di controllo qualità, i LIMS tradizionali sono oggi lo standard in molte aziende. Si prestano bene a processi di prova standardizzati, alla documentazione dei valori di misura e alla gestione di flussi di lavoro conformi alle normative. Nella ricerca, tuttavia, non sono i processi standardizzati a essere centrali, bensì la molteplicità di varianti, l’esplorazione dei dati e i cicli di iterazione rapidi. È proprio in questo contesto che i LIMS raggiungono i propri limiti strutturali e funzionali. Anche i quaderni di laboratorio elettronici (ELN) offrono un supporto limitato, poiché consentono di documentare le osservazioni, ma non di strutturare realmente i dati. Excel, pur rimanendo uno strumento universale ampiamente utilizzato nei laboratori, è soggetto a errori, difficilmente scalabile e complesso da consultare in modo sistematico.

I dati risultano spesso distribuiti tra file, sistemi e computer diversi. Quando un collaboratore o una collaboratrice lascia l’azienda, un patrimonio di conoscenze prezioso rischia così di perdersi in questa giungla di dati.

Oggi la ricerca richiede molto più di semplici archivi digitali: è necessaria una soluzione sostenibile che metta i dati al centro, consenta la generazione di nuove conoscenze, cresca in modo flessibile alle esigenze dell’organizzazione e offra strumenti che i team vogliano davvero utilizzare. Un software intuitivo non è un lusso, ma una condizione essenziale per garantire un elevato livello di accettazione.

Per lungo tempo le soluzioni on-premise hanno rappresentato lo standard, ma oggi, in molte aziende, mostrano chiaramente i loro limiti. Richiedono una manutenzione complessa, offrono scarsa flessibilità in fase di ampliamento e spesso non garantiscono il livello di sicurezza necessario. Chi desidera lavorare in modo realmente data-driven, integrare sistemi diversi e sfruttare in modo efficace l’intelligenza artificiale ha bisogno di una piattaforma che lo renda possibile. Solo il cloud offre l’apertura, la scalabilità e le basi tecnologiche necessarie a una soluzione realmente orientata al futuro.

Perché i LIMS tradizionali non sono più sufficienti nella R&S

Costi elevati di integrazione

Il collegamento delle apparecchiature di analisi risulta troppo costoso, favorendo così la formazione di silos di dati.

Ecosistema dei dati frammentato

Informazioni importanti restano nascoste in tabelle Excel oppure mancano del tutto.

Mancanza di contesto dei dati

Valori isolati senza tracciabilità della sperimentazione e parametri privi di storico non costituiscono una base solida per prendere decisioni nello sviluppo di formulazioni.

Flessibilità limitata

I nuovi requisiti sono difficili da implementare.

Obsolescenza tecnologica

I sistemi sono spesso datati, poco intuitivi e difficili da espandere.

Assenza di fondamenta per l’IA

La mancanza di dati strutturati e ricchi di contesto rende impossibile il passaggio all’ottimizzazione e all’automatizzazione.

Dal mosaico di dati alla piattaforma interconnessa

Che cosa devono offrire i sistemi moderni

I sistemi all’avanguardia devono fare molto più che archiviare dati: devono interconnettere le informazioni, strutturare i processi e fornire basi concrete per prendere decisioni. Questo schema mostra i tre elementi fondamentali che interagiscono in questo contesto.

Dati

Flussi di lavoro

Intelligenza artificiale

dati sui materiali

dati di processo dati di misurazione

gestione dei progetti gestione delle risorse gestione del laboratorio

co-ingegnerizzazione

IA predittiva

ottimizzazione

bayesiana

È qui che risiede il valore aggiunto: la piattaforma di material intelligence collega dati, processi e intelligenza in un ambiente integrato, fungendo da punto di riferimento centrale per la collaborazione, i processi decisionali e lo sviluppo mirato.

Primo: DATI

Dati strutturati e facilmente consultabili, provenienti da formulazioni, sperimentazioni, processi e misurazioni, costituiscono le fondamenta, poiché solo quando queste informazioni sono disponibili in modo completo è possibile prendere decisioni fondate. Per questo è necessaria una loro reale integrazione attraverso il collegamento delle apparecchiature di prova, dei dati di formulazione e di processo e, a seconda delle esigenze, anche dei sistemi MES ed ERP.

Secondo: FLUSSI DI LAVORO

Tutti i progetti, le risorse e i processi di laboratorio devono essere mappati digitalmente, inclusi formulazioni e campioni, nonché strumenti, apparecchiature e scorte di magazzino. Questo crea un flusso di lavoro coerente, in cui tutte le persone coinvolte operano sulla stessa base informativa e possono prendere decisioni informate e basate sui dati.

Terzo: INTELLIGENZA ARTIFICIALE

Su una solida base di dati è possibile applicare in modo mirato diverse soluzioni di intelligenza artificiale, ad esempio per eseguire valutazioni automatizzate, supportare l’ottimizzazione bayesiana basata sull’intelligenza artificiale o implementare modelli predittivi. È fondamentale che l’IA non agisca come uno strumento aggiuntivo isolato, ma che possa accedere direttamente ai dati reali di sviluppo e di test. Solo così diventa un vero valore aggiunto nello sviluppo di formulazioni.

In pratica: interconnettere invece di complicare

L’integrazione

intelligente di IT e strumentazioni per un laboratorio all’avanguardia

Le piattaforme moderne dimostrano che è possibile integrare le apparecchiature di prova e i sistemi IT senza progetti costosi o ad alto consumo di risorse. Nel caso di LabV, un cosiddetto mapper connette diversi strumenti di misurazione alla piattaforma, converte i dati raccolti in un formato uniforme e li archivia

Integrazione completa delle apparecchiature

Prove fisiche

Prove meccaniche

Prove chimiche

centralmente in un database strutturato. Anche il collegamento a sistemi già esistenti, come CRM, MES o applicazioni legate alla produzione, è facilmente realizzabile in base alle esigenze. La Figura 1 illustra come questa integrazione end-to-end consente di creare una base dati sostenibile.

ERP (SAP, NAV)

MES

Produzione

Figura 1

Il collegamento completo delle apparecchiature di prova e dell’infrastruttura IT fornisce una base dati sostenibile che, a sua volta, consente l’uso dell’intelligenza artificiale.

Una volta garantita la connettività, l’intero processo di laboratorio può essere mappato digitalmente. Dalla ricezione di un incarico di sviluppo nel CRM fino alla formulazione finale, ogni fase resta documentata. I dati di prova e di analisi sono conservati a lungo termine per essere confrontati in qualsiasi momento e

le varianti delle formulazioni possono essere ottimizzate sulla base di dati concreti. Le automazioni supportano le attività ricorrenti e alleggeriscono il lavoro quotidiano. La Figura 2 mostra come i processi digitali rendono il knowhow di laboratorio disponibile in modo duraturo.

Incarico di sviluppo

Ordine digitale dal CRM

Confronto automatico dei dati

Figura 2

Sviluppo della formulazione

Suggerimento automatico di formulazione sulla base di dati storici

Controllo e analisi

Acquisizione dei dati direttamente dagli strumenti

Report di prova generato automaticamente

Il processo di sviluppo delle vernici è ottimizzato grazie ai dati e alle interconnessioni.

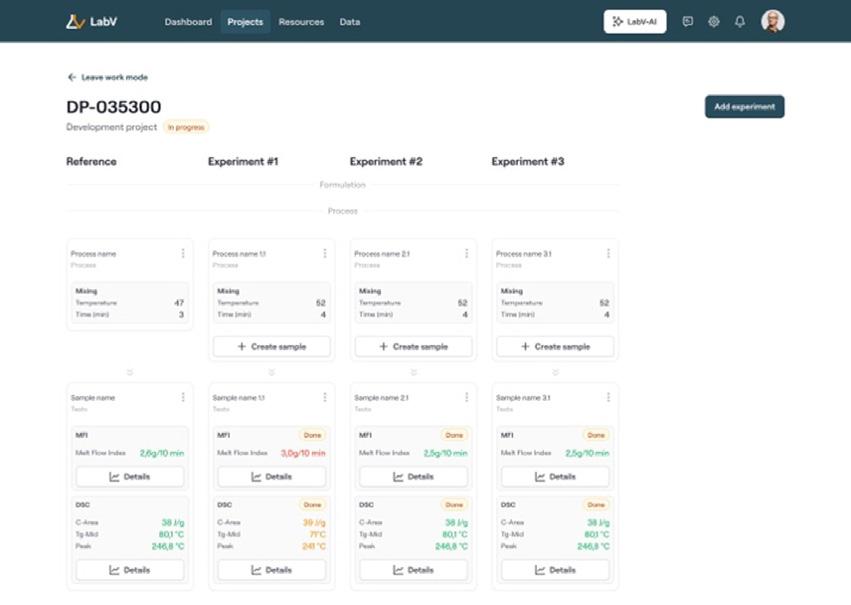

Una gestione centralizzata dei dati di formulazione e di prova garantisce trasparenza e tracciabilità. Tutte le varianti, i parametri misurati e i valori di risultato vengono acquisiti in modo strutturato, confrontabile e valutabile. Nell’esempio della Figura 3, emerge subito che la formulazione dell’Esperimento 1 non soddisfa i requisiti. Questo livello di trasparenza consente al laboratorio di perfezionare i prodotti in modo mirato e di prendere decisioni più rapidamente, definendo con maggiore precisione la strategia di sviluppo di una nuova formulazione sulla base di dati affidabili. Da singoli valori isolati si crea così una base solida per processi e, in ultima analisi, prodotti migliori.

Tuttavia, un archivio centrale rappresenta più di un semplice principio organizzativo, promuovendo un reale incremento dell’efficienza nella ricerca e nello sviluppo. Quando i dati vengono raccolti e consolidati in modo centralizzato, non aumentano soltanto trasparenza e comparabilità, ma migliorano anche in modo misurabile l’efficienza e la rapidità dello sviluppo di prodotto. Più concretamente, la piattaforma di material intelligence LabV rende i processi di sviluppo fino al 40% più efficienti, poiché le informazioni sono fornite in modo

4

Documentazione e archiviazione

Formulazione trasmessa all’ERP

Figura 3

L’archiviazione centralizzata dei dati di prova facilita l’individuazione di correlazioni e connessioni. Con LabV, diventa immediatamente visibile quali formulazioni soddisfano i requisiti (verde), quali risultano borderline (giallo) e quali non li rispettano (rosso).

mirato e l’accesso ai risultati precedenti risulta notevolmente semplificato. Inoltre, riduce fino al 50% il numero di prove, perché nessun valore va più perso e le conoscenze già disponibili possono essere riutilizzate direttamente, grazie a una banca dati affidabile su cui basare ogni esperimento e ogni sviluppo di formulazione, invece di ripartire da zero ogni volta. 30%

di iterazioni di formulazione in meno grazie al riutilizzo dei risultati storici 50%

di tempo in meno dedicato alla documentazione grazie all’automazione del trasferimento dati e della reportistica

66%

di tempo in meno per la ricerca sui dati grazie all’accesso diretto a tutti i dati rilevanti

Figure

Come abbiamo mostrato, il percorso verso uno sviluppo di prodotto digitale e supportato dall’intelligenza artificiale inizia con una solida base di dati. Un impiego efficiente delle informazioni richiede che tutti i dati siano integrati in modo coerente all’interno di una piattaforma strutturata. Questa base riveste un’importanza particolare nello sviluppo delle formulazioni, dove il processo decisionale è per sua natura sperimentale e ad alta intensità di risorse.

La sfida centrale consiste nell’identificare formulazioni che soddisfino le proprietà target con il minor numero possibile di esperimenti. Tradizionalmente, questo obiettivo è stato affrontato mediante il design of experiments (DoE), in cui le variabili di formulazione e di processo vengono modificate secondo un piano sperimentale predefinito. Sebbene il DoE fornisca un quadro statisticamente solido e migliori la riproducibilità, segue una logica prevalentemente statica: i piani sperimentali devono essere eseguiti integralmente, anche quando i risultati intermedi indicano già direzioni poco promettenti.

Il machine learning (ML) supera queste limitazioni perché apprende le relazioni tra le variabili di formulazione e le proprietà dei materiali a partire dallo storico dei dati sperimentali. Invece di valutare gli esperimenti solo a posteriori, il ML consente un’analisi virtuale e la previsione dei parametri prestazionali attesi, come la viscosità o la conducibilità. Le varianti più promettenti possono così essere priorizzate prima di avviare i test di laboratorio, riducendo il numero di iterazioni pur mantenendo centrale la validazione sperimentale.

Tuttavia, i modelli predittivi da soli possono non essere sufficienti a ottimizzare appieno i processi, soprattutto quando i set di dati sono limitati e gli obiettivi di sviluppo evolvono nel tempo. L’ottimizzazione bayesiana risponde a questa

esigenza perché consente di selezionare gli esperimenti in modo iterativo anziché seguire un piano fisso. Ogni esperimento aggiorna il modello e orienta la raccomandazione successiva, bilanciando lo sfruttamento delle aree più promettenti con l’esplorazione di regioni ancora incerte e richiedendo, in genere, un numero significativamente inferiore di prove rispetto al DoE classico.

Nel contesto della material intelligence, questi metodi possono essere orchestrati attraverso un sistema di co-ingegnerizzazione basato sull’IA. Si tratta di un’architettura agentica e contestuale che supporta gli specialisti di formulazione lungo l’intero processo di sviluppo, consentendo una ricerca strutturata, la contestualizzazione e l’analisi dei dati di formulazione e di prova, e rendendo accessibili risultati storici rilevanti, correlazioni e vincoli.

Modelli predittivi e metodi di ottimizzazione vengono così integrati direttamente nel flusso di lavoro della R&S. Il team definisce le proprietà target e i vincoli, mentre l’IA analizza i dati disponibili, genera raccomandazioni e le perfeziona man mano che nuovi risultati sperimentali vengono reinseriti nel sistema.

Il valore di questo approccio emerge in numerosi ambiti della ricerca e dello sviluppo (Figura 5), dove è possibile prendere decisioni più rapide e informate perché l’IA analizza in modo efficiente grandi quantità di dati, riconosce i pattern ricorrenti e rende tempestivamente visibili le correlazioni. Grazie all’apprendimento continuo dai set di dati esistenti, l’accuratezza aumenta mentre le fonti di errore diminuiscono. Allo stesso tempo, i sistemi intelligenti possono occuparsi di attività ripetitive come la documentazione o l’elaborazione dei dati, creando così spazio per compiti più complessi e qualificati.

Il valore aggiunto dei dati e dell’IA

Decisioni più rapide

L’IA analizza i dati più velocemente dell’essere umano.

Maggiore accuratezza

Riduce gli errori grazie all’apprendimento da grandi set di dati.

Automazione delle attività ripetitive

Libera tempo per attività più complesse e qualificate

Riconoscimento di pattern

Identifica correlazioni che potrebbero sfuggire all’osservazione umana.

Adattamento e apprendimento continuo

Migliora le prestazioni man mano che vengono elaborati più dati.

Prove sui materiali e sviluppo di formulazioni più rapidi

Riduce i cicli di prova ed errore e accelera la R&S

Controllo qualità più affidabile

Individua potenziali difetti prima che si manifestino e migliora l’affidabilità del prodotto

Elaborazione automatizzata dei dati

Elimina l’inserimento manuale, riduce gli errori e fa risparmiare tempo

Individuazione di relazioni tra materiali

Rende visibili i legami tra le formulazioni, i parametri di processo e le prestazioni finali

Previsioni migliori

Utilizza i dati dei test precedenti per suggerire formulazioni promettenti

Figura 5 Quando i dati sono disponibili in forma strutturata e l’IA viene utilizzata in modo mirato, si ottengono progressi tangibili in termini di efficienza, qualità e capacità decisionale.

Un ambito centrale di applicazione è la valutazione strutturata dei dati di prova e di formulazione. L’IA è in grado di individuare anomalie, tendenze o correlazioni che, nella pratica quotidiana, possono sfuggire facilmente all’osservazione. Questo non solo accelera l’analisi, ma aumenta anche la significatività dei risultati. Il carico di lavoro legato ai test viene ridotto in modo mirato perché le formulazioni più promettenti vengono riconosciute in anticipo e possono essere testate con priorità. Anche la qualità beneficia di questo approccio, poiché i parametri rilevanti vengono valutati in modo coerente e le correlazioni prestazionali vengono rese visibili in modo sistematico.

Un esempio: persino grandi serie di misurazioni con centinaia di punti dati possono essere visualizzate automaticamente, ad esempio evidenziando anomalie, valori comparativi o valori atipici. Questo fornisce una base decisionale affidabile, ad esempio nella selezione o nell’ulteriore sviluppo di varianti di formulazione. L’IA non prende decisioni, ma fornisce informazioni rilevanti che il team di sviluppo prodotto può discutere e valutare in modo approfondito.

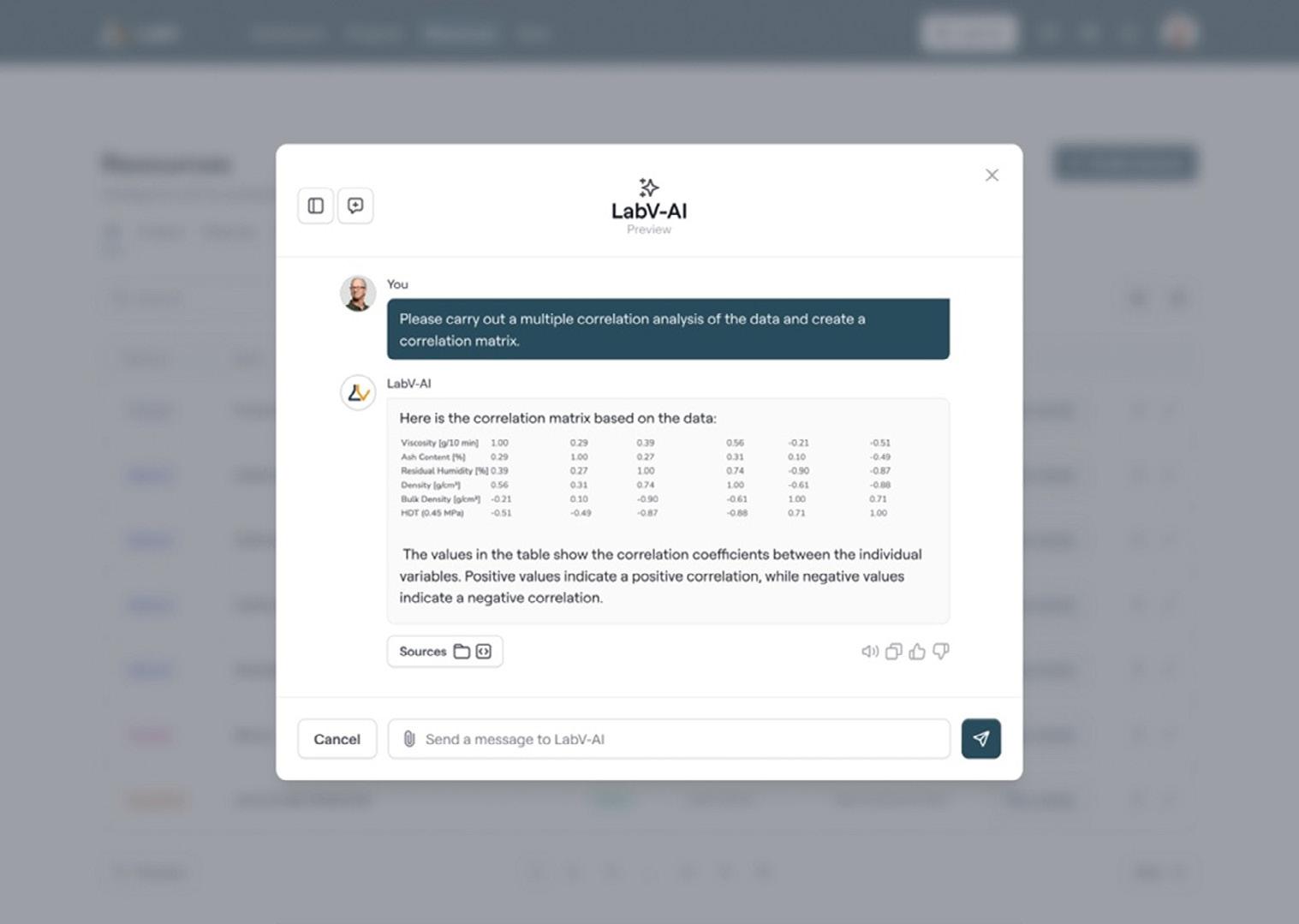

Un ulteriore campo di applicazione è la ricerca intelligente dei dati (Figura 6). A differenza delle funzioni di ricerca tradizionali, l’intelligenza

artificiale analizza i contenuti da un punto di vista non soltanto tecnico, ma anche semantico. Invece di produrre elenchi di risultati non strutturati, fornisce risposte dirette e contestualizzate, ad esempio su materie prime, proprietà specifiche, intervalli temporali o pattern ricorrenti. Inoltre, sa comprendere e valutare singoli campi di database, commenti o descrizioni di materie prime. In questo modo diventa visibile un patrimonio di conoscenze finora mai utilizzato.

Anche contenuti non strutturati, come protocolli di prova, norme, specifiche o report tecnici, possono essere analizzati automaticamente. Un document explorer supportato dall’IA identifica i passaggi di testo rilevanti, riassume i contenuti in modo sintetico e consente interrogazioni mirate. Questo consente di risparmiare tempo,

riduce i margini di interpretazione e aumenta la sicurezza nell’analisi di documenti complessi. Questi esempi dimostrano che l’intelligenza artificiale è ormai pienamente integrata nella pratica quotidiana. Rende accessibili le informazioni, aiuta a riconoscere le correlazioni e rafforza la capacità decisionale ovunque vi siano dati disponibili, seppure mai sfruttati. È proprio qui che risiede il suo valore aggiunto concreto per la ricerca e lo sviluppo.

Con ogni esperimento e ogni nuova informazione, il sistema diventa più preciso e, già dai primi approcci, emerge chiaramente la sua capacità di riconoscere le correlazioni tra materiali, parametri e valori di prestazione in modo sempre più automatizzato. Il capitolo seguente descrive le potenzialità di questa evoluzione.

6

Con pochi prompt, la piattaforma LabV, supportata dall’intelligenza artificiale, può offrire una visualizzazione e una valutazione intelligenti dei dati.

Figura

Analisi intelligente dei dati con l’IA

IA predittiva: dalla comprensione alla previsione

Rivoluzionare lo sviluppo delle formulazioni con il machine learning

Nell’industria delle vernici e dei rivestimenti, molti laboratori dispongono di database in cui, nel corso degli anni, sono state raccolte migliaia di formulazioni e risultati relativi a criteri prestazionali chiave quali viscosità, grado di brillantezza e resistenza. Questo patrimonio di conoscenze racchiude un enorme potenziale che il machine learning (ML) può rendere finalmente accessibile, favorendo processi di sviluppo più rapidi, mirati ed efficienti.

L’obiettivo è valutare in modo affidabile le prestazioni delle nuove formulazioni prima ancora di procedere alle prove pratiche e, così, generare proposte adeguate in base alle proprietà desiderate.

Sulla base di dati storici è possibile addestrare un modello ML in grado di riconoscere le correlazioni tra le componenti di una formulazione e i valori target. I modelli di machine learning apprendono dai dati esistenti, identificano pattern e suggeriscono in modo mirato i passi successivi per lo sviluppo di nuove formulazioni. Il ML non si limita quindi a confronti manuali o a report statici, ma fornisce un supporto attivo all’interno del processo di sviluppo di un prodotto.

Per valutare la qualità di queste previsioni, si utilizzano metodi di validazione consolidati, come la convalida incrociata o la suddivisione dei dati in set di addestramento e di test. I modelli più efficaci sono in grado di spiegare una quota elevata della varianza, un forte indicatore della loro capacità predittiva e della loro rilevanza pratica. Il team definisce valori target o criteri di ottimizzazione e il sistema, su questa base, calcola formulazioni adeguate alle proprietà prevedibilmente ottenibili. Il primo test di laboratorio può così partire in modo mirato, supportato da raccomandazioni basate sui dati. Questo consente di risparmiare tempo, risorse e iterazioni.

Inoltre, il modello può fornire ulteriori indicazioni preziose, ad esempio, su quali gruppi di materie prime contribuiscano in modo determinante al raggiungimento degli obiettivi, oppure sull’impatto dei leganti sulla resistenza meccanica o dei pigmenti sulla stabilità ai raggi UV. Queste conoscenze supportano decisioni informate e garantiscono maggiore chiarezza nella definizione delle priorità.

Da un caso d’uso concreto nello sviluppo di formulazioni, condotto nell’ambito di un progetto LabV, emergono alcuni insegnamenti fondamentali per l’impiego del machine learning nello sviluppo di materiali e formulazioni:

Più dati = modelli migliori

Una base dati pulita, strutturata e sufficientemente ampia è il presupposto fondamentale per ottenere previsioni affidabili.

La preparazione dei dati è decisiva

L’armonizzazione di dati non omogenei richiede molto tempo. Una raccolta strutturata fin dall’inizio rappresenta quindi un fattore di successo evidente. Non esiste un unico modello perfetto

La conoscenza del settore resta indispensabile I modelli migliori nascono dal dialogo con il team di sviluppo prodotto, che ha esperienza diretta dei fattori e delle correlazioni rilevanti.

Se i dati storici disponibili risultano limitati, un modello puramente predittivo può non essere sufficiente. In questi casi, l’ottimizzazione bayesiana offre un approccio efficace: consente di valutare iterativamente i risultati sperimentali tenendo

Spesso, una combinazione di diversi algoritmi, a seconda della disponibilità e della qualità dei dati, garantisce le migliori prestazioni predittive.

La manutenzione del modello è essenziale

Nuovi dati portano a previsioni più accurate. Il machine learning è quindi un percorso evolutivo continuo, non un’applicazione isolata.

conto dell’incertezza e di identificare varianti di formulazione promettenti con un numero minimo di esperimenti, anche quando i set di dati disponibili sono ridotti.

Dati complessi. Utilizzo semplice.

Perché l’utente deve mantenere il controllo

Anche la migliore piattaforma resta inefficace se non viene utilizzata nella pratica quotidiana. È qui che entra in gioco un aspetto spesso sottovalutato: la facilità d’uso. Chi lavora con formulazioni complesse, dati di prova, parametri e valori di misura non ha bisogno soltanto di funzionalità potenti, ma anche di un’interfaccia che offra chiarezza e semplifichi i processi.

Per questo i sistemi moderni puntano a un layout ben strutturato, in grado di soddisfare le esigenze tecniche senza sovraccaricare gli utenti con dettagli tecnologici. Al posto di menu annidati o tabelle poco chiare, si privilegiano strutture lineari, flussi di lavoro intuitivi e feedback visivi. In questo modo, anche le attività più complesse, dalla creazione di una formulazione fino all’analisi dei dati, possono essere svolte in modo efficiente e senza errori.

Questa facilità d’uso consente di risparmiare tempo e, al contempo, di ridurre l’impegno necessario per la formazione. I nuovi collaboratori si orientano più rapidamente, mentre gli utenti esperti lavorano in modo più mirato. Soprattutto, però, aumenta l’accettazione all’interno del team di sviluppo prodotto.

Questo è un fattore decisivo affinché un progetto di digitalizzazione non resti confinato alla teoria, ma produca un valore aggiunto concreto nella pratica quotidiana. Nessuno trae beneficio da una soluzione costosa che viene a malapena utilizzata. Prendere sul serio la digitalizzazione significa sempre considerare anche la prospettiva degli utenti.

Ripensare le formulazioni: dati che finalmente generano valore

Il primo passo è fatto

Con la lettura di questo white paper, avete già compiuto un passo importante e compreso le sfide poste dallo sviluppo digitale delle formulazioni.

Forse le condizioni nel vostro contesto non sono ancora le ideali, ma questo è il momento giusto per porsi le domande decisive. Prima di pensare alla scelta di strumenti o fornitori, vale la pena guardare innanzitutto alla propria situazione:

Come lavoriamo oggi?

Dove perdiamo tempo?

Quali dati utilizziamo e quali no?

Quali informazioni ci mancano quando dobbiamo prendere decisioni?

Delle schede descrittive dei casi d’uso, per esempio, possono aiutare a fare chiarezza, precisando che cosa debba essere migliorato concretamente, chi sia coinvolto e quali fonti di dati siano rilevanti.

La digitalizzazione, infatti, non inizia con la scelta di un sistema, ma con il desiderio di cambiare qualcosa. E mai come oggi è stato così semplice iniziare, grazie a piattaforme come LabV, sviluppate appositamente per rendere possibile un’innovazione data-driven nell’industria delle vernici e dei rivestimenti.

È un percorso che offre vantaggi concreti non solo nel lungo periodo, ma anche nell’immediato, su quattro livelli (Figura 7).

Prima di tutto, assicura una maggiore efficienza: processi automatizzati riducono il carico delle attività di routine e creano spazio per compiti a maggiore valore aggiunto.

In secondo luogo, accresce il patrimonio di conoscenze disponibile: l’esperienza esistente non va persa, ma viene acquisita sistematicamente, utilizzata in modo strutturato e condivisa tra team diversi.

In terzo luogo, rafforza la capacità innovativa: decisioni basate sui dati e cicli di sviluppo più brevi portano nuovi rivestimenti alla maturità di mercato più rapidamente.

Infine, migliora la qualità dei prodotti: le formulazioni ad alte prestazioni possono essere sviluppate in modo più mirato e valutate con maggiore solidità.

Più efficienza

Risparmio di tempo nelle attività senza valore aggiunto

Automazione delle attività ricorrenti

Più innovazione

Cicli di time-to-market più brevi

Maggiore competitività, aumento del fatturato

Prodotti migliori

Decisioni basate sui dati

Materiali e prodotti più efficaci

Figura 7

Più conoscenza

Salvaguardia delle competenze

Promozione della collaborazione

Maggiore efficienza, più conoscenza, maggiore capacità innovativa e prodotti migliori.

La ricerca e lo sviluppo traggono vantaggio dall’integrazione tra dati, processi e persone. Non in futuro, ma già oggi.

Autore

Charles Jouanique

Charles Jouanique opera da oltre 14 anni nel settore industriale, con particolare attenzione ai modelli di business digitali, alle applicazioni dell’intelligenza artificiale e ai processi data-driven. In qualità di imprenditore e business angel, supporta le aziende all’intersezione tra tecnologia e industria.

La piattaforma LabV

Dati migliori. Sviluppo più efficiente.

LabV è la piattaforma di material intelligence per la ricerca e lo sviluppo. Riunisce formulazioni, processi e dati sperimentali in un ambiente strutturato, interconnesso e analizzabile, offrendo uno sviluppo di prodotto più rapido, decisioni più fondate e, in ultima analisi, prodotti migliori.

LabV sostituisce il caos delle tabelle Excel e delle soluzioni isolate con una piattaforma centrale, flessibile e adatta sia a piccoli team sia a strutture di sviluppo complesse. I benefici sono immediatamente misurabili: meno iterazioni, meno coordinamento, maggiore efficienza.

Parte del Gruppo NETZSCH, LabV vanta oltre 60 anni di esperienza nell’analisi dei materiali. La nostra missione è ripensare l’innovazione dei materiali, utilizzando i dati come risorsa strategica per un’industria che vuole costruire attivamente il proprio futuro.

Pionieri della digitalizzazione – Una selezione dei nostri clienti